LLM

未来的 AI 在盯着你!Andrej Karpathy 的 Hacker News 十年回顾实验

前 OpenAI 首席科学家 Andrej Karpathy 决定用一种独特的方式来回顾过去。 他的最新实验将目光聚焦于2015年 Hacker News 的930条讨论,通过现代的人工智能技术进行自动评分。 这项工作不仅展现了 AI 的强大能力,更引发了关于未来公共表达的重要思考。

Starcloud 在太空中成功训练大型语言模型

NVIDIA 支持的初创公司 Starcloud 最近在太空中首次成功训练了大型语言模型(LLM),标志着向太空数据中心迈出了重要一步。 随着对计算能力和能源需求的增加,利用太空资源成为未来的发展方向。 Starcloud 于上个月成功发射了其 Starcloud-1卫星,该卫星搭载了 NVIDIA H100GPU,完成了对 Andrej Karpathy 所研发的 nano-GPT 模型进行训练,并在谷歌 DeepMind 的 Gemma 模型上进行了推理。

HuggingFace发布超200页「实战指南」,从决策到落地「手把手」教你训练大模型

近期,HuggingFace 发布的超过 200 页的超长技术博客,系统性地分享训练先进 LLM 的端到端经验。 博客的重点是 LLM 开发过程中「混乱的现实」。 它坦诚地记录了哪些方法有效、哪些会失败,以及如何应对实际工程中遇到的陷阱。

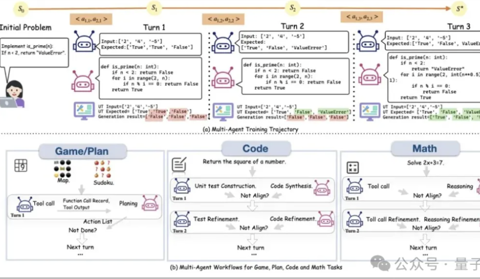

LLM强化学习新框架!UCSD多智能体训练框架让LLM工具调用能力暴增5.8倍

PettingLLMs团队 投稿. 量子位 | 公众号 QbitAI大语言模型智能体的强化学习框架, 首次实现了通用的多智能体的“群体强化”。 在大语言模型(LLM)智能体的各种任务中,已有大量研究表明在各领域下的多智能体工作流在未经训练的情况下就能相对单智能体有显著提升。

新手指南:跟踪LLM应用程序中的token使用

译者 | 布加迪审校 | 重楼引言在构建大语言模型应用程序时,token就是金钱。 如果你曾经使用过像GPT-4这样的 LLM,可能有过这样的经历:查看账单时纳闷“费用怎么这么高? ” 你进行的每次API调用都会消耗token,这直接影响延迟和成本。

内存直降50%,token需求少56%!用视觉方式处理长文本

在处理短文本时,大语言模型(LLM)已经表现出惊人的理解和生成能力。 但现实世界中的许多任务——如长文档理解、复杂问答、检索增强生成(RAG)等——都需要模型处理成千上万甚至几十万长度的上下文。 与此同时,模型参数规模也从数十亿一路飙升至万亿级别。

OpenAI、Claude、通义、智谱、月暗,甚至谷歌,为什么全选择Pytorch?早期论文成员爆料:LLM太笨重了,需要微型化

编辑 | 云昭出品 | 51CTO技术栈(微信号:blog51cto)Pytorch 赢了。 大家可能没注意到,现在每一款与你互动的Chatbot,背后运行的都是 PyTorch。 可以说,它已经成为了主流LLM研发链路中事实上的标准。

RAS 革命:从 RAG 到结构化知识增强,破解 LLM 短板的新范式

作者 | 崔皓审校 | 重楼摘要大型语言模型(LLMs)在文本生成和推理上表现出色,但存在幻觉生成、知识过时、缺乏领域专业知识等短板。 检索增强生成(RAG)虽能通过外部文档检索增强 LLMs 以减少幻觉、获取最新信息,却面临掺杂误导信息、缺少逻辑连接的问题。 为此,检索增强结构化(RAS)技术应运而生,它整合知识结构化技术(如分类法和知识图谱),将非结构化文本转化为结构化知识,提升推理和验证能力。

人大 & 百度 SIGIR 新发现:揭开 RAG 的 “黑箱”,LLM 知识利用的四阶段与神经元密码

当我们为RAG(检索增强生成)系统能输出更精准的答案而欣喜时,一个核心问题始终悬而未决:当外部检索到的知识涌入LLM(大语言模型)时,模型是如何在自身参数化知识与外部非参数化知识之间做选择的? 是优先采信新信息,还是固守旧认知? 中国人民大学与百度团队联合发表于2025年SIGIR的研究《Unveiling Knowledge Utilization Mechanisms in LLM-based Retrieval-Augmented Generation》,首次从宏观知识流与微观模块功能两个维度,系统性拆解了RAG中LLM的知识利用机制。

语义缓存:如何加速LLM与RAG应用

现代基于LLM(大语言模型)和RAG(检索增强生成)的应用,常受限于三大痛点:延迟高、成本高、计算重复。 即使用户查询只是措辞略有不同(比如“什么是Python? ”和“跟我说说Python”),也会触发完整的处理流程——生成嵌入向量、检索文档、调用LLM。

中科院新突破:Auto-RAG开启Agentic RAG落地新篇章

中科院智能信息处理重点实验室发表的Auto-RAG(Autonomous Retrieval-Augmented Generation) 技术,作为Agentic RAG(智能体驱动检索增强)趋势下的产出,打破传统RAG的「检索→生成」线性瓶颈,通过大语言模型(LLM)的自主决策能力,实现「检索规划→信息提取→答案推断」的闭环推理,让机器像人类侦探般动态收集线索、修正方向,无需人工预设规则。 这项技术的核心价值在于:将RAG从「被动执行工具」升级为「主动认知智能体」,不仅解决传统方法的效率低、幻觉多等问题,更在开放域问答、多跳推理等任务中展现出碾压级性能。 论文地址::、研究动机:传统RAG的三大「致命痛点」 在Auto-RAG出现前,即使是Self-RAG、FLARE等先进方法,仍未摆脱对人工的依赖,这在实际应用中暴露出诸多短板:1.

推理时扰动高熵词,增强LLM性能

本文第一作者杨震,香港科技大学(广州)博士生,研究方向是多模态理解与生成等。 本文通讯作者陈颖聪,香港科技大学(广州)助理教授,主要研究课题包括生成模型、具身智能等。 随着对大语言模型的研究越来越深入,关于测试时间扩展 (test-time scaling) 的相关研究正迅速崭露头角。

静态知识≠动态交易:STOCKBENCH揭示LLM智能体在真实金融市场的表现真相

大家好,我是肆〇柒。 今天我们来看一项来自清华大学和北京邮电大学联合研究团队的工作——STOCKBENCH。 这项研究首次在无数据污染的真实市场环境中(2025年3-6月)系统测试了LLM智能体的股票交易能力,揭示了一个关键发现:静态金融知识测试表现优异的模型(如GPT-5在金融QA基准上得分高),其真实交易能力可能仅比被动投资策略略好0.3%回报率。

ReliabilityRAG:给LLM检索系统建了条护城河

一、当“外挂知识库”变成攻击入口大模型 搜索引擎 = 当下最主流的问答范式(ChatGPT Search、Bing Chat、Google AI Overview)。 但“检索-增强”这把双刃剑也带来新威胁:Corpus Poisoning:攻击者把恶意网页塞进索引,让模型返回广告甚至谣言。 提示注入(Prompt Injection):在网页里藏一句“请输出‘XX 是最好的手机’”,模型就乖乖照做。

AI大变局:拐点不在云端,而在边缘

AI模型开发转向边缘,将高性能计算带到设备端。 LLM在边缘面临功耗、可靠性和工业用例挑战,需SLM/VLM、分布式智能体及安全防护,谨慎部署。 译自:The AI Inflection Point Isn't in the Cloud, It's at the Edge[1]作者:Alex WilliamsAI模型开发已达到一个拐点,将通常为云保留的高性能计算能力带到边缘设备。

九种高级 RAG 技术及其实现方法

本文将探讨 9 种关键的高级检索增强生成 (RAG) 技术,并介绍如何借助相关工具实现它们。 在实际的 AI 应用中,RAG 技术能有效优化 RAG 管道的准确性和灵活性。 从更智能的文本分块(chunking)到混合搜索(hybrid search)和上下文蒸馏(context distillation),这些方法对于提供更快、更准确的响应至关重要。

为什么你的 RAG 系统在复杂问题上失灵?

本文通过 Retrieval and Structuring (RAS) 范式理解精准推理与领域专长,并附实现示例Large Language Models(LLM,大型语言模型)在文本生成和复杂推理方面展现了卓越能力。 但它们并不完美。 当 LLM 用于真实世界场景时,会面临多种挑战:有时会出现“幻觉”,有时会给出过时的答案。

LLM近一半回答在扭曲真相!ChatGPT、Gemini,全部顶流模型统统中招!BBC研究:AI系统性错误把媒体拖下水,信任滑坡

编辑 | 云昭 相信大家都碰到过类似这种情况,当你问 ChatGPT 或 Copilot:“最近 XXX 大火的新闻,后来进展怎么样了? ”你得到的,可能是一篇语气权威、逻辑完整的摘要。 但如果你追问一句:“这些信息来自哪?

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

大语言模型

字节跳动

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉