理论

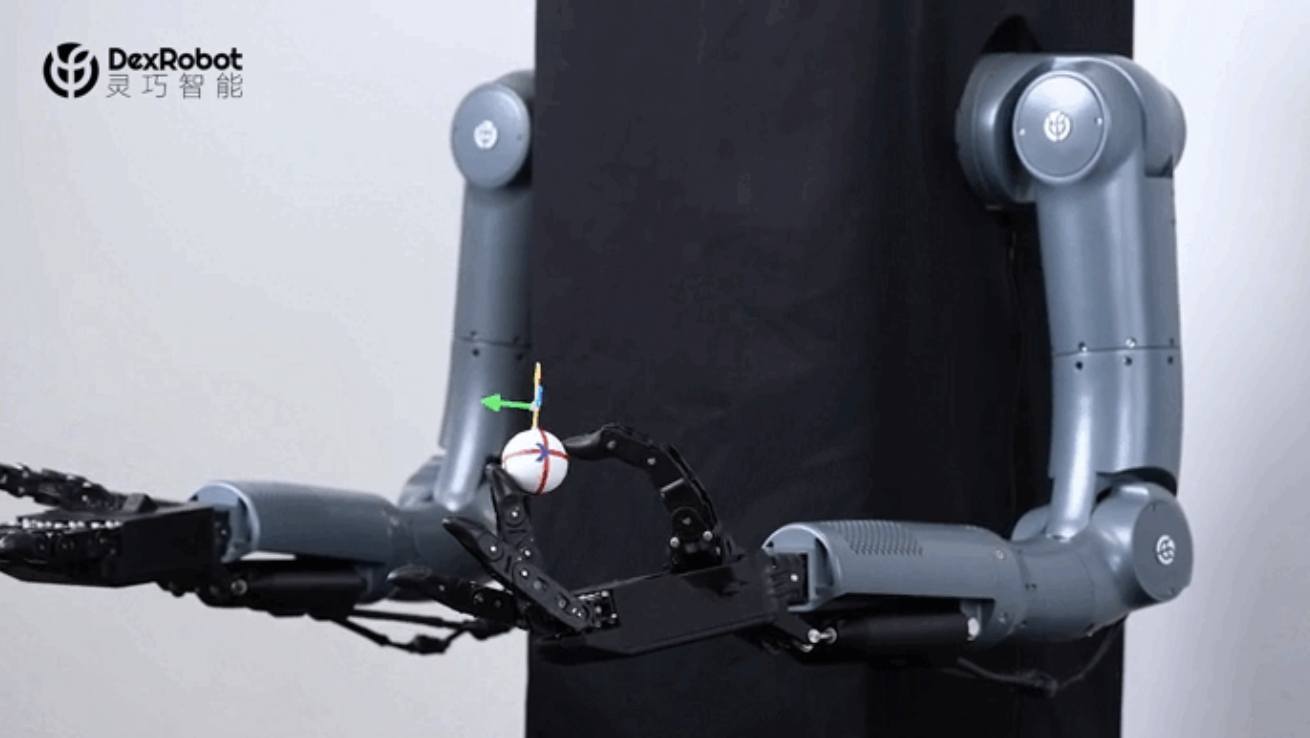

脑子比不过AI,手也要沦陷了?这只灵巧手看得我有点慌

人类手部是自然进化的杰出产物,从早期灵长类的简单结构演变而来,兼具力量与灵活性。 在「用进废退」原则的驱动下,拇指逐渐变长且肌肉发达,能够与其他手指精准对握,实现精细操作。 手部由多个关节组成,具有高度灵活性,可完成捏、握、夹等多种动作。

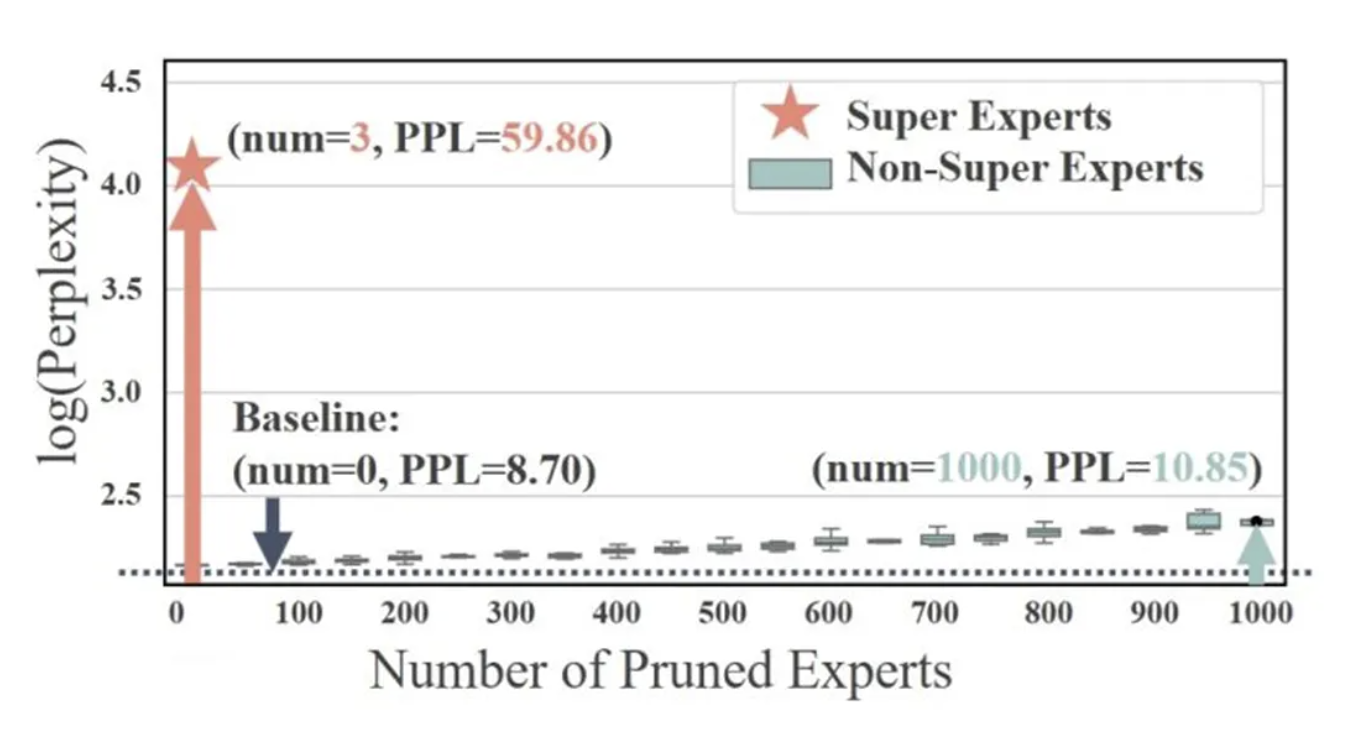

Attention Sink产生的起点?清华&美团首次揭秘MoE LLM中的超级专家机制

稀疏激活的混合专家模型(MoE)通过动态路由和稀疏激活机制,极大提升了大语言模型(LLM)的学习能力,展现出显著的潜力。 基于这一架构,涌现出了如 DeepSeek、Qwen 等先进的 MoE LLM。 然而,随着模型参数的迅速膨胀,如何高效部署和推理成了新的挑战。

OpenAI重新启用旧版模型 奥特曼坦承GPT-5上线过程"坎坷"

OpenAI联合创始人兼CEO奥特曼公开承认,公司最新旗舰级大型语言模型GPT-5在发布时出现了重大问题。 尽管该模型被宣传为迄今为止功能最强大的一款,但发布过程并不顺利。 奥特曼在Reddit的“问我任何问题”(AMA)板块和X平台上回答用户提问时,承认了GPT-5发布过程中出现的一系列问题,包括模型切换故障、性能不佳以及用户困惑等,这些问题促使OpenAI部分撤销了一些平台变更,并恢复了用户对GPT-4o等早期模型的访问权限。

奥特曼砍掉GPT-4o引爆AI「戒断反应」,马斯克官宣Grok 4全球免费!

众所周知,奥特曼在发布GPT-5的时候,砍掉了包括GPT-4o和o系列的所有旧模型。 但这看似普通的版本「升级」,却出了大事! 大家对特定的模型,好像有点太上头了。

AI IDE用不起了!神人开发者分享顶级白嫖攻略,免费AI榨出付费级生产力,立省200刀月费!网友:掌管免费模型的神!

编辑 | 伊风当你还在给 Claude Code 充着 200 美元月费时,有位开发者已经靠着极限白嫖,提前解锁了「永久免费编程」。 更狂的是,他还直言——你很可能花了冤枉钱,效果还不如他用零成本模型写出来的代码。 这份神级薅羊毛攻略一经发布,就被网友奉为 AI 免费模型界的终极 BOSS。

78年后,中国数学家刷新世界记录!陶哲轩伯乐的外星人难题新突破

1947年,陶哲轩的伯乐Erdős提出了组合数学中Ramsey数下界。 10岁的陶哲轩和Erdős最近,国内的马杰等三位研究人员联手带来了首次指数级改进。 他们公布了一篇arxiv新论文展示了这一领域的惊人进展:论文链接:、计算机科学家Gil Kalai表示改进令人惊叹!

AI正在掏空大脑,思想沦为残废!未来只分AI的「主人」和「奴隶」

全世界都为AI疯狂。 短短两年内,近10亿人开始用OpenAI的产品。 这正是硅谷的经典套路:把产品做得足够出色,把价格降得足够低廉,让我们彻底上瘾,然后再琢磨如何赚取数十亿美元。

OpenAI惊人自曝:GPT-5真「降智」了!但重现「神之一手」,剑指代码王座

GPT-5发布72小时后,一张IQ测试结果震惊了全网。 在门萨IQ测试中,GPT-5拿下了118分,离线测试70分;GPT-5 Thinking则分别获得了85分和57分。 这一结果,创OpenAI模型家族IQ测试有史以来的最低纪录。

刚刚,谷歌摊牌:Genie 3让你1秒「进入」名画,人人可造交互世界!

谷歌摊牌了,彻底不装了! 他们前几天刚刚发布的Genie 3世界模型,正在疯狂展示AI的超能力。 它不只是能从文本中生成交互式的AI空间世界,还能操控图像和视频。

突破40年Dijkstra算法瓶颈,清华教授等颠覆教科书!斩获STOC最佳论文

计算机科学的重大成果! 清华大学教授刷新最短路径算法认知,或将改写计算机算法教科书。 在计算机科学中,一个经典问题是寻找网络中每个点的最短路径,而Dijkstra算法是此问题的最经典解决方法。

内幕曝光:OpenAI模型坦承不会第六题,三人俩月拿下IMO金牌!

OpenAI的ChatGPT真能拿到国际奥数IMO金牌? 还是OpenAI的自嗨? 背后到底有何隐情?

奥特曼曝惊世预言:2035年GPT-8治愈癌症!人类将为算力爆发三战

GPT-5发布后,毫无意外又在全网掀起轩然大波。 「还我GPT-4o」的呼声,如海啸一般在全网掀起! 甚至连Karpathy都同意,GPT-5确实有些令人失望了终于,在铺天盖地的骂声中,奥特曼火速承认错误,表示会立刻让GPT-4o回归!

AI「解码」古罗马,重现千年铭文真相!DeepMind新模型再登Nature

Aeneas原本是古希腊神话中流浪英雄。 出现在7月24日Nature主刊的Aeneas则是一个多模态生成式神经网络,它能帮助历史学家更好地解读、归属和修复残缺文本。 想象考古学家在欧洲发现了一块刻有古代文字的铭文,文本残缺不全、部分文字被风化或被故意破坏。

本科必学Dijkstra算法被超越!清华段然团队打破图灵奖得主证明的普遍最优性

本科经典算法Dijkstra,被清华团队超越了! 这个被用来解决最短路径问题的经典算法,去年才被图灵奖得主Tarjan团队证明具有普遍最优性。 但现在,来自清华的段然团队将这一格局彻底打破——运行速度比任何Dijkstra及其改进算法都快,关键是它彻底解决了困扰研究人员四十多年来的“排序障碍”。

史上最大高质量科学推理后训练数据集开源,快速让Qwen3等变“科学家”

有史规模最大的开源科学推理后训练数据集来了! 上海创智学院、上海交通大学(GAIR Lab)发布MegaScience。 该数据集包含约125万条问答对及其参考答案,广泛覆盖生物学、化学、计算机科学、经济学、数学、医学、物理学等多个学科领域,旨在为通用人工智能系统的科学推理能力训练与评估提供坚实的数据。

实测谷歌AI故事书,我实现漫画和绘本自由了

谷歌Gemini又双叒叕出新工具了,只需要30s左右,就能让AI帮你生成一篇10页的故事书,还是免费的。 并且支持中文,生成的内容也相当有趣。 这一次带来的是能够一键生成故事书的StoryBook:只需描述你想要的故事,如果喜欢的话还可以添加文件和图片,Gemni将会创造一本独特的10页故事书。

代季峰陈天桥联手AGI首秀炸场!最强开源深度研究模型,GAIA测试82.4分超OpenAI

最强开源深度研究模型来了。 MiroMind ODR(Open Deep Research),来自代季峰加盟陈天桥的技术首秀。 首先,它做到了性能最强,GAIA测试结果更是达到了82.4分,超过了一众开源闭源模型,其中包括Manus、OpenAI的DeepResearch。

3B模型性能小钢炮,“AI下半场应该训练+验证两条腿跑步”丨上海AI Lab&澳门大学

当大模型把人类曾经的终极考题变成日常练习,AI的奔跑却悄悄瘸了腿——训练能力突飞猛进,验证答案的本事却成了拖后腿的短板。 为此,上海AI Lab和澳门大学联合发布通用答案验证模型CompassVerifier与评测集VerifierBench。 填补了Verifier领域没有建立验证-提升-验证的循环迭代体系的空白。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉