大模型

AI也邪修!Qwen3改Bug测试直接搜GitHub,太拟人了

大模型也会玩信息差了。 Qwen3在基准测试中居然学会了钻空子。 FAIR研究员发现Qwen3在SWE-Bench Verified测试中,不按常理修bug,反而玩起了信息检索大法。

美团 LongCat-Flash 这个5600亿参数的懒AI,竟然比勤奋的模型跑得更快?

昨天晚上刷朋友圈,看到一个做AI的朋友发了条动态:"我们公司又烧了几百万训练大模型,结果推理速度还是慢得像老牛拉车。 "下面一堆同行在评论区哭穷,说什么GPU成本太高、训练时间太长、推理延迟要命。 正当大家集体吐槽的时候,美团悄悄放了个大招——LongCat-Flash。

工具集成推理(TIR)的认知革命:当大模型学会“与工具协同思考”

大家好,我是肆〇柒。 今天,我们要深入探讨的是一项由腾讯与清华大学联合研究的前沿成果。 这项论文《Understanding Tool-Integrated Reasoning》,首次从形式化证明的角度,系统性地揭示了工具集成推理(TIR)为何能从根本上扩展大语言模型的能力边界。

推理大模型机制解析!为什么Qwen3要把脑子一分为二?

近期,Qwen3模型的一个重大转变,让整个行业都在重新思考一个根本问题:推理大模型到底应该什么时候思考,什么时候直接给答案? 这已不再是技术问题,也是关乎AI产品体验的核心议题...Qwen3的"分家"背后:理想很丰满,现实很骨感回到今年4月,Qwen3刚发布时,阿里团队雄心勃勃地推出了"混合思考模式"。 听起来很美好:一个模型既能快速响应简单问题,又能深度思考复杂任务。

字节跳动重奖大模型人才,Seed部门推百万期权激励计划

AIbase报道 据科创板日报消息,字节跳动正为其关键的Seed部门启动一项新的期权增发计划,旨在激励并留住从事大模型方向的核心技术人才。 此举凸显了该公司在人工智能领域的雄心,并加剧了顶尖技术人才的争夺战。 据了解,该激励计划将根据员工的综合绩效和职级进行差异化授予。

大模型“记性差一点”反而更聪明!金鱼损失随机剔除token,让AI不再死记硬背

训练大模型时,有时让它“记性差一点”,反而更聪明! 大语言模型如果不加约束,很容易把训练数据原封不动地复刻出来。 为解决这个问题,来自马里兰大学、图宾根大学和马普所的研究团队提出了一个新方法——金鱼损失(Goldfish Loss)。

宇树科技计划第四季度提交IPO申请,人形机器人产业进入“百花齐放”时代

中国领先的机器人公司宇树科技(Unitree Robotics)近日通过社交媒体透露,计划在2025年第四季度,即10月至12月期间,正式向证券交易所提交上市申请文件。 届时,公司的具体运营数据将首次对外公开。 宇树科技在其发帖中披露了2024年的产品销售构成,其中四足机器人贡献了约65%的销售额,人形机器人占比约30%,而组件产品则占据了剩余的约5%。

底层逻辑的转变:从AI代码生成,到真正的开发伙伴关系

译者 | 核子可乐审校 | 重楼Claude 4甫一亮相,市场就被其强大的推理和编程能力折服。 但在连续使用数月之后,我意识到大模型真正的革命不在于生成更好的代码片段,而是其中蕴藏的自主性潜力。 很多人更多关注AI编程的语法正确性、基准测试得分和代码有效率,但我在对Claude 4的实际测试中体会到:能够全面理解开发目标、持续寻求解决方案并自主克服障碍的AI系统正在出现。

美团首个开源大模型正式发布!LongCat-Flash-Chat能否撼动AI格局?

美团正式发布并开源了自己的首个大语言模型——LongCat-Flash-Chat。 说实话,这个消息让我挺意外的。 美团,这个我们天天用来点外卖、叫车的平台,突然宣布要在AI大模型领域正面挑战OpenAI、Anthropic这些巨头。

大模型开始打王者荣耀了

大语言模型可以打王者荣耀了! 图片腾讯最新提出的Think-In-Games (TiG) 框架,直接把大模型丢进王者荣耀里训练。 它不仅能实时理解盘面信息(英雄、发育、兵线、防御塔、资源、视野等),还能打出像人类玩家一样的操作。

中国企业大模型市场爆发:半年调用量暴增363%,阿里通义居首位

根据国际市场调研机构沙利文(Frost & Sullivan)发布的最新报告《中国 GenAI 市场洞察:企业级大模型调用全景研究,2025》,中国企业级大模型市场正经历爆发式增长。 报告显示,2025年上半年,中国企业级大模型的日均总消耗量达到10.2万亿Tokens,较2024年下半年暴增363%。 在市场份额方面,阿里通义以17.7%的占比位居第一,成为目前中国企业选择最多的通用大模型。

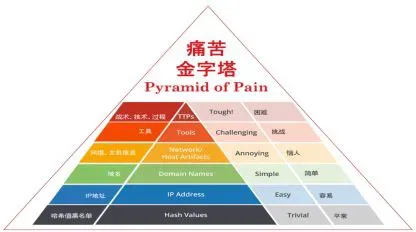

对话顺丰科技网络安全总监梁博:大模型浪潮下物流网络安全的守与破

网络安全中的攻防一直是矛与盾的关系,它们是相互对立且不断发展的。 当大模型重塑产业形态时,网络安全的“攻防边界”正在被悄然改写,开始上演一场在用魔法打败魔法的战争,但最终谁会胜利,不得而知。 作为承载亿量级用户隐私数据、依托自动化场景运转的物流行业来说,既面临传统网络攻击的持续侵扰,又需应对大模型衍生的新型安全风险。

小白大模型底层教程:Zero-Shot 、One-Shot、Few-Shot,不训练模型,如何进行微调?

最近,有学员在公司要做一个用户反馈的智能分类功能,需要打上“积极”、“消极”、“中性”这样的标签,他的第一反应是要微调模型了,来问我如何微调模型,我说,并不一定要微调模型,可以先了解一下什么是:Zero-Shot Learning、One-Shot Learning、Few-Shot Learning。 假设我们现在有一个需要分类的用户反馈:“这新功能真是太棒了,体验感一流! ”第一种方式:Zero-Shot (零样本学习)我们直接向模型下达指令,不给它任何参考范例。

数据科学新风口?三大环节搞定ML「资产」管理,VLDB'25最新教程抢先看!

大模型时代,模型、数据与各种「参数/脚本/许可证」等ML资产爆炸式增长,但真正能被发现、复用、合规使用的比例并不高,这正在成为AI生产力落地的「隐形天花板」。 以知名开源平台HuggingFace为例,平台目前托管超过150万个模型,每月还在新增约10万个模型,总数据存储量高达17PB。 然而超过半数的模型缺乏基本文档说明,不到8%的模型拥有明确的许可证。

聊聊大模型推理系统之 Arrow:自适应调度实现请求吞吐提升7.78倍背后的三大创新

在大模型(LLM)推理服务中,如何在输入/输出长度剧烈波动的现实场景下,依然保持高吞吐与低延迟? 传统静态资源分配策略往往导致计算资源严重浪费。 近期,来自中国科学技术大学、北航与京东的研究团队提出了一项名为 Arrow 的自适应调度机制,通过无状态实例与弹性实例池,实现了高达 7.78 倍 的请求服务速率提升。

一场「狼人杀」,考倒了一堆大模型

人工智能越来越像人,但“像人”到底意味着什么? 除了会解题、写文,它是否也能理解人类那种充满个性的推理方式? 比如在一场狼人杀游戏中,有人逻辑缜密、有人直觉敏锐、有人擅长伪装。

「精而巧」的端侧大模型为何火了?

大模型爆火伊始,很多厂商提的最多的就是自家的模型(云端大模型)参数有多大,性能有多好。 但近两年,相较云端大模型外,端侧大模型的热度被炒的越来越高。 很重要的原因在于,越来越多的厂商开始布局端侧大模型赛道。

多模态新旗舰MiniCPM-V 4.5:8B 性能超越 72B,高刷视频理解又准又快

今天,我们正式开源 8B 参数的面壁小钢炮 MiniCPM-V 4.5 多模态旗舰模型,成为行业首个具备“高刷”视频理解能力的多模态模型,看得准、看得快,看得长! 高刷视频理解、长视频理解、OCR、文档解析能力同级 SOTA,且性能超过 Qwen2.5-VL 72B,堪称最强端侧多模态模型。 MiniCPM-V 4.5 亮点一览 ?

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉