NeurIPS 2025

大模型「越想越错」?人大&腾讯团队用信息论揭示:什么时候该想、什么时候别想

本文的第一作者雍希贤是来中国人民大学的博士生,研究方向聚焦于 Humanoid AI,LLM Coginition & Reasoning。 通讯作者为中国人民大学的周骁副教授以及腾讯天衍实验室的吴贤。 当前,大模型的「推理能力」几乎成为行业最热词。

NeurIPS 2025|指哪打哪,可控对抗样本生成器来了!

近日,在全球人工智能领域最具影响力的顶级学术会议 NeurIPS(神经信息处理系统大会)上, 清华大学和蚂蚁数科联合提出了一种名为 Dual-Flow 的新型对抗攻击生成框架。 简单来说,Dual-Flow 是一个能够从海量图像数据中学习 “通用扰动规律” 的系统,它不依赖目标模型结构、不需要梯度,却能对多种模型、多种类别发起黑盒攻击。 其核心思想是通过 “前向扰动建模 — 条件反向优化” 的双流结构,实现对抗样本的高可迁移性与高成功率,同时保持极低的视觉差异。

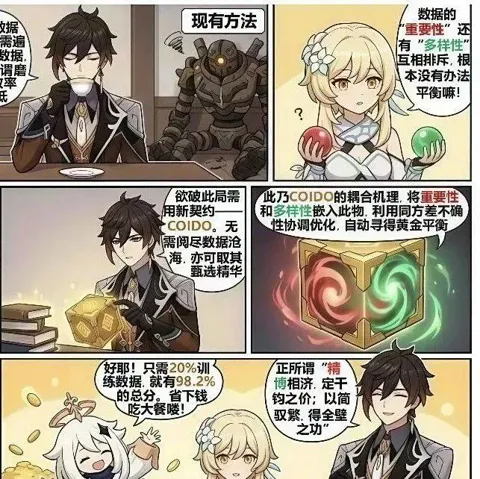

NeurIPS 2025 | 告别全量扫描!浙大提出COIDO:破解多模态数据选择「高耗」难题

本文第一作者是二年级博士生闫熠辰,主要研究方向是多模态大模型的数据质量管理;通讯作者是李环研究员,主要研究方向包括人工智能数据准备、大模型高效推理与部署、时空大数据与模型轻量化等。 01 省流版:一张图看懂 COIDO在深入技术细节之前,我们先用一张漫画来直观理解 COIDO (Coupled Importance-Diversity Optimization) 解决的核心问题与方案:正如钟离在漫画中所言,面对海量视觉指令数据的选择任务,传统方法需要遍历全部数据才能进行筛选造成大量「磨损」(高昂计算成本)。 同时在面对数据重要性和多样性问题时,传统方法往往顾此失彼。

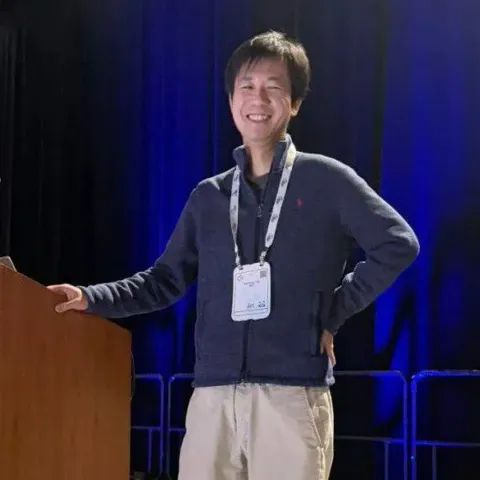

何恺明NeurIPS 2025演讲盘点:视觉目标检测三十年

不久前,NeurIPS 2025 顺利举办,作为人工智能学术界的顶级会议之一,其中不乏学术界大佬的工作和演讲。 有一项荣誉的颁发显得格外厚重且众望所归 —— 由任少卿、何恺明、Ross Girshick 和孙剑合著的经典论文 《Faster R-CNN》,摘得了 「时间检验奖」 (Test of Time Award)。 凡是接触过计算机视觉的人,对这个名字绝不陌生。

NeurIPS 2025放榜:阿里Qwen门控注意力获最佳论文,何恺明Faster R-CNN获时间检验奖

嘻疯 发自 凹非寺. 量子位 | 公众号 QbitAI刚刚,NeurIPS 2025最佳论文奖、时间检验奖出炉! 今年Best Paper共有4篇,3篇为华人一作,阿里Qwen门控注意力获奖。

这届NeurIPS 2025太有看头了!11月22日北京见

2025年,AI 的演进正从“能力突破”迈向“系统构建”阶段。 自主智能体开始尝试真实任务闭环,世界模型在复杂环境中持续验证,推理架构与训练范式不断重构——技术的焦点,已不再只是“能不能做”,而是“如何做得更可靠、更可解释、更可持续”。 在这一背景下,NeurIPS 作为全球人工智能与机器学习领域最具影响力的学术会议之一,再次成为观察前沿风向的关键窗口。

NeurIPS 2025|当AI学会"炒股":用千个虚拟投资者重现金融市场涌现现象

市场不是机器,而是人群;不是公式,而是故事。 TwinMarket让AI学会讲述这些故事。 1994年,美国圣塔菲研究所(Santa Fe Institute)推出了一个野心勃勃的项目:人工股票市场(Artificial Stock Market)。

与DeepSeek-OCR不谋而合,NeurIPS论文提出让LLM像人一样读长文本

在 NeurIPS 2025 论文中,来自南京理工大学、中南大学、南京林业大学的研究团队提出了一个极具突破性的框架 ——VIST(Vision-centric Token Compression in LLM),为大语言模型的长文本高效推理提供了全新的 “视觉解决方案”。 值得注意的是,这一思路与近期引起广泛关注的 DeepSeek-OCR 的核心理念不谋而合。 研究背景在处理短文本时,大语言模型(LLM)已经表现出惊人的理解和生成能力。

NIPS2025|小红书智创AIGC团队提出布局控制生成新算法InstanceAssemble

当下的文本生成图像扩散模型取得了长足进展,为图像生成引入布局控制(Layout-to-Image, L2I)成为可能。 然而,现有布局到图像生成方法在复杂场景下表现仍不理想:一方面,如何精确对齐给定布局并同时保持高画质是巨大挑战;另一方面,在扩散生成的逐步去噪过程中确保每个目标的位置与语义属性不偏离也极为困难。 此外,布局控制往往需要支持多模态条件(如文本、参考图等信息),这进一步增加了技术复杂度。

一站看尽NeurIPS 2025前沿成果,11月22日北京见!

2025 年开始进入尾声,但 AI 领域发展势头依旧势不可挡。 从自主智能体到视频生成模型,再到世界模型与推理架构的持续演化,人工智能正以前所未有的速度扩展能力边界。 技术革新速度快得令人目不暇接:新框架、算法、模型接连登场,科研社区与产业界的讨论也愈发活跃。

NeurIPS 2025 | 当AI理解几何:ETHz提出GAOT,让神经算子在任意形状上实现高效可扩展的PDE求解

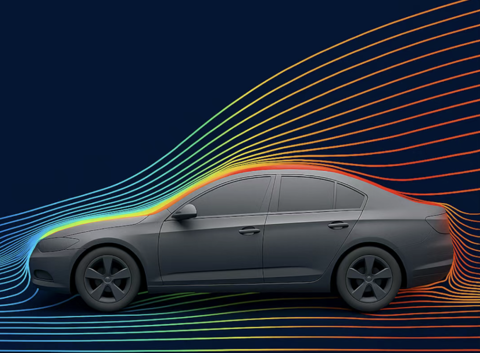

作者 | 论文团队编辑 | ScienceAI想象一下,如果 AI 能真正理解复杂几何的形状,并快速预测其中的物理场分布 —— 无论是汽车外壳的气流走向,还是飞机机翼上的压力变化,都能在几秒内被准确模拟,而不再依赖昂贵的数值仿真。 这正是 Geometry Aware Operator Transformer(GAOT)所尝试实现的目标。 该研究由 ETH Zurich 与 CMU 合作完成,并被 NeurIPS 2025 正式接收。

NeurIPS 2025|VFMTok: Visual Foundation Models驱动的Tokenizer时代来临

视觉 Tokenizer 的困境与破局近年来,自回归(Autoregressive, AR)模型在语言生成领域的成功激发了其在图像生成领域的应用,涌现出 DALL-E、Parti、VAR 和 LlamaGen 等代表性工作。 这类技术高度依赖于 VQGAN 等视觉 Tokenizer,它负责将高维、冗余的像素空间映射到一个低维、紧凑的离散潜在空间,是决定生成模型上限的基石。 然而,以 VQGAN 为代表的传统 Tokenizer 通常需要从零开始训练,其训练目标由像素级重建损失函数主导,导致其产生的潜在空间:富含低层细节特征却缺乏高层语义信息:能很好地还原图像细节,但潜在编码本身缺乏高层语义信息。

NeurIPS 2025 | 北大联合小红书提出Uni-Instruct:ImageNet单步生图FID进入1.0时代!

近年来,单步扩散模型因其出色的生成性能和极高的推理效率,在图像生成、文本到视频、图像编辑等领域大放异彩。 目前主流的训练方法是通过知识蒸馏,最小化学生模型与教师扩散模型之间的分布差异。 然而,现有的方法主要集中在两条平行的理论技术路线上:基于 KL 散度最小化的方法(如 Diff-Instruct[1],DMD[2] 等):收敛速度快,但可能存在模式崩溃问题,进而导致生成性能差。

NeurIPS25高分论文|以判别式监督学习强化推理LLM,解决难度偏差和熵崩塌难题

作者介绍:德州农工大学博士生李港,专注于设计和应用高效算法到大规模机器学习和人工智能任务,包括增强大型基础模型的后训练算法、对抗性鲁棒学习算法和分布鲁棒性学习算法。 曾发表数篇论文在 NeurIPS、ICML、KDD 等顶会, 并作为主要贡献者之一发布了针对不平衡分类任务的知名软件包 LibAUC。 DeepSeek-R1 的成功吸引了人们对群体相对策略优化(GRPO)作为大型推理模型(LRM)强化学习方法的广泛关注。

NeurIPS 2025 | ARGRE框架实现高效LLM解毒:自回归奖励引导,安全对齐更快、更准、更轻

作者为北京航空航天大学的肖宜松,刘艾杉,应宗浩,刘祥龙,新加坡国立大学的梁思源,新加坡南洋理工大学的陶大程。 本文已被 NeurIPS 2025 录用。 LLM 已在智能创作、企业服务等领域广泛应用,但其内容安全问题仍是落地过程中的关键挑战。

NeurIPS 2025 | 当分子拥有「视觉」:湖南大学提出S²VM,让AI读懂药物之间的化学默契

作者 | 论文团队编辑 | ScienceAI想象一下,如果 AI 能拥有一位资深化学家的「化学直觉」—— 不仅能预测药物间的相互作用,更能「看见」分子结构中那些决定其相互作用的微妙联系,甚至揭示出那些沉睡在未知化学空间中的潜在互动,那将是怎样一番景象? 然而,理想与现实之间存在着巨大的鸿沟。 一直以来,AI 学习药物相互作用的方式存在一个根本性的瓶颈:它严重依赖于已知的、有标记的药物对数据。

NeurIPS 2025 | CMU、清华、UTAustin开源ReinFlow,用在线RL微调机器人流匹配策略

作者简介:本文第一作者为卡耐基梅隆大学机器人所研究生 Tonghe Zhang,主要研究方向为机器人操作大模型和全身控制算法。 合作者为德克萨斯大学奥斯汀分校博士生 Sichang Su, 研究方向为强化学习和通用机器人策略。 指导教师是清华大学和北京中关村学院的 Chao Yu 教授以及清华大学 Yu Wang 教授。

首个多轮LLM Router问世, Router-R1可让大模型学会「思考–路由–聚合」

Haozhen Zhang 现为南洋理工大学(NTU)博士一年级学生,本工作完成于其在伊利诺伊大学厄巴纳-香槟分校(UIUC)实习期间。 Tao Feng 为 UIUC 博士二年级学生,Jiaxuan You 为 UIUC 计算机系助理教授。 团队长期聚焦 LLM Router 方向,已产出 GraphRouter、FusionFactory 及本文 Router-R1 等多项代表性研究成果。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉