近日,在全球人工智能领域最具影响力的顶级学术会议 NeurIPS(神经信息处理系统大会)上, 清华大学和蚂蚁数科联合提出了一种名为 Dual-Flow 的新型对抗攻击生成框架。

简单来说,Dual-Flow 是一个能够从海量图像数据中学习 “通用扰动规律” 的系统,它不依赖目标模型结构、不需要梯度,却能对多种模型、多种类别发起黑盒攻击。其核心思想是通过 “前向扰动建模 — 条件反向优化” 的双流结构,实现对抗样本的高可迁移性与高成功率,同时保持极低的视觉差异。

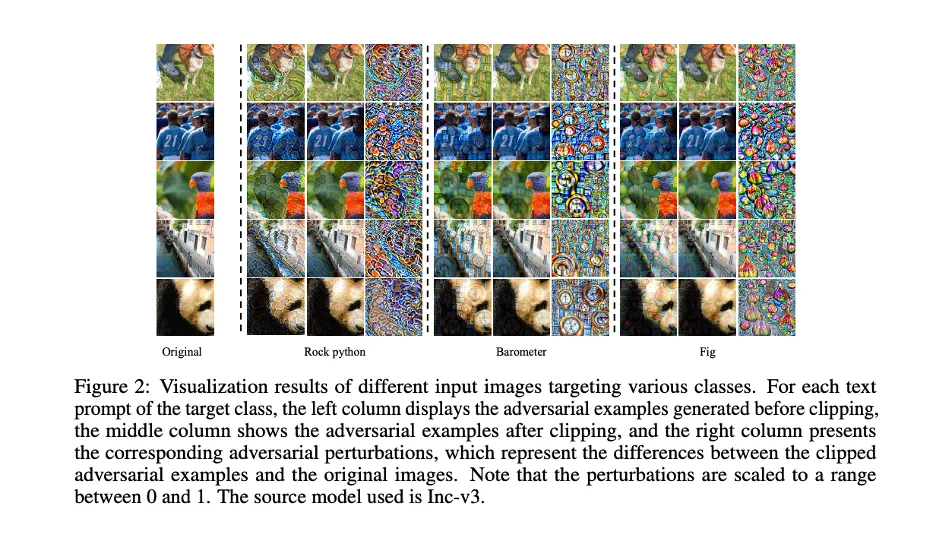

可以把它理解为一个“可控的对抗样本生成器”,只需指定想攻击的图像类别(如狗类、人类),模型就能自动生成该类别下逼真且有效的攻击图像,为 AI 安全带来了前所未有的挑战。

论文标题:Dual-Flow: Transferable Multi-Target, Instance-Agnostic Attacks via In-the-wild Cascading Flow Optimization

作者:Yixiao Chen, Shikun Sun, Jianshu Li, Ruoyu Li, Zhe Li, Junliang Xing

机构:Tsinghua University, Ant Group

论文地址:https://openreview.net/pdf?id=zhCv5uZ8bh

GitHub:https://github.com/Chyxx/Dual-Flow

研究背景与意义

随着 AI 模型在图像识别、自动驾驶、监控系统等领域广泛部署,“模型安全” 成为重要问题。尤其在黑盒环境下(攻击者无法知道模型结构和梯度),攻击通常依赖迁移性:希望一个方法能同时迷惑多个模型或多个类别。

传统方法存在两大局限:

实例专属攻击(instance-specific):高成功率,但只能针对单张图片,迁移性差。

通用生成器攻击(instance-agnostic):迁移性有限,面对多目标、多模型时成功率下降。

DualFlow 正是为了解决这些问题而提出的 —— 通过统一的生成优化框架,实现多目标、多模型、实例无关的高成功率攻击。

⚡ 核心创新点

前向 + 反向 Flow 结构

DualFlow 并不在像素级别直接加噪声,而是:

先把图片映射到 flow /latent 空间,在这个空间做结构化扰动

再通过 velocity function 反向映射到图像空间,生成对抗样本

相比传统 “像素扰动”,这种方法能生成更自然、更隐蔽、结构化的扰动,同时保持高迁移性。

多目标、实例无关攻击能力

DualFlow 的统一框架天然支持:

多目标(multitarget):一个生成器即可攻击多个类别

多模型(multimodel):可迁移到不同架构的模型

实例无关(instanceagnostic):无需针对特定图像训练

这意味着,以往需要 “每个目标单独训练生成器” 的方法,现在只需一个生成器就能覆盖多个类别和模型,显著降低成本、提高实用性。

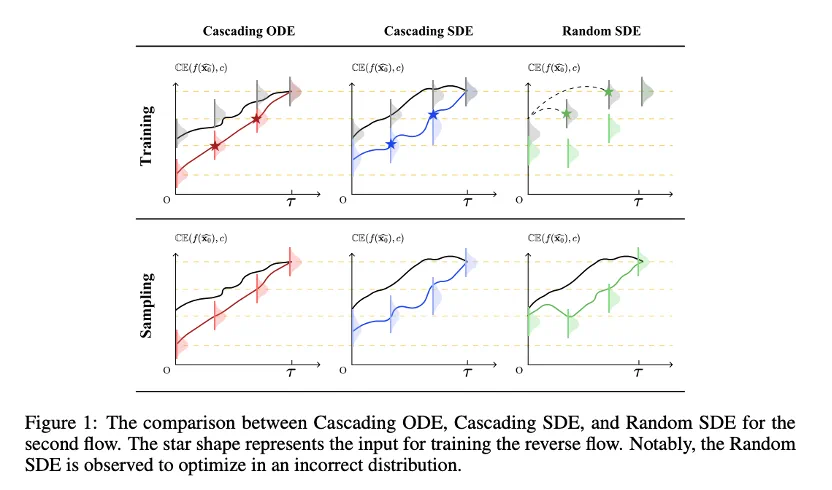

级联分布偏移训练(Cascading Distribution Shift Training)

训练过程中扰动分布逐步推进,使生成的对抗样本在不同时间步 / 中间表示上都能有效

大幅提升对多模型、多目标的迁移成功率

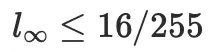

保证生成扰动在

约束下仍保持视觉隐蔽性

约束下仍保持视觉隐蔽性

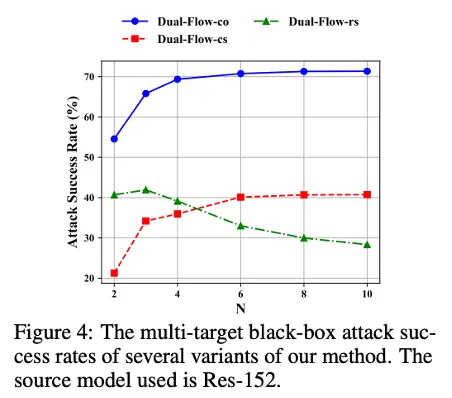

📊 实验结果

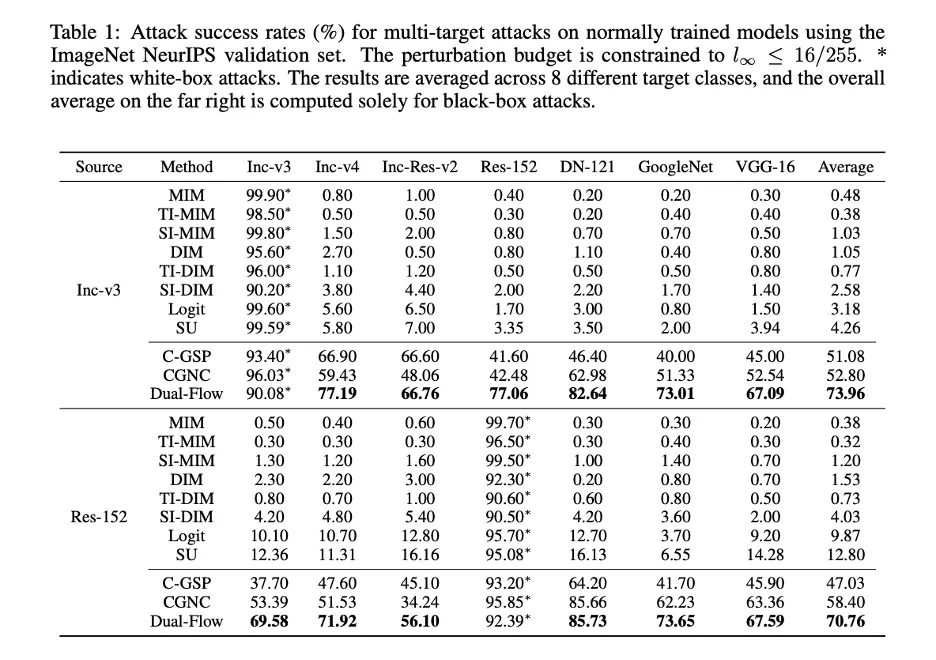

在 ImageNet NeurIPS 验证集上对正常训练模型进行多目标攻击的成功率,扰动规模限制为

在 ImageNet 验证集上的实验表明,DualFlow 在单目标和多目标攻击中都展现了强大的迁移能力。

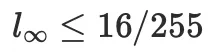

Table 2 显示,单目标攻击下,DualFlow 在黑盒环境中平均成功率明显高于传统方法,扰动幅度  的情况下仍能显著误导模型;而白盒攻击下效果更佳。

的情况下仍能显著误导模型;而白盒攻击下效果更佳。

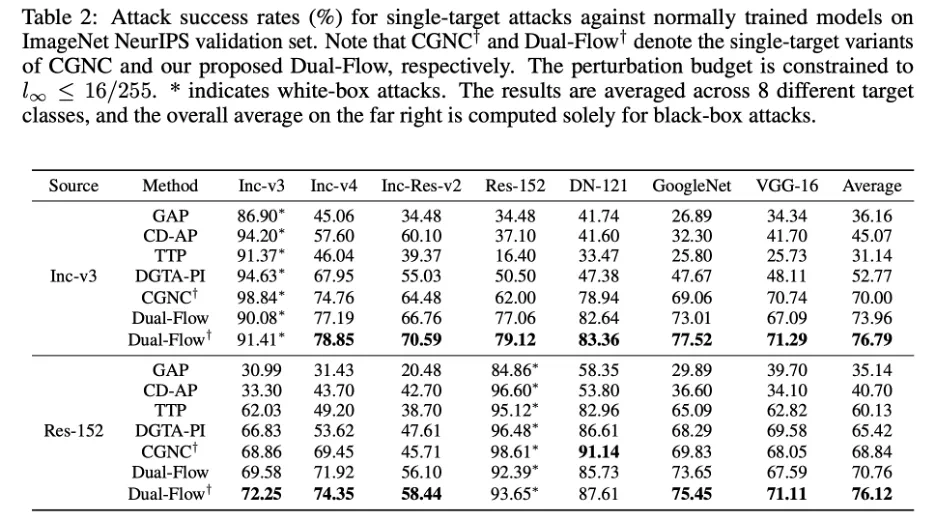

Table 3 进一步验证了 DualFlow 在多目标、多模型以及对抗训练模型上的迁移性能。结果显示,即使面对经过对抗训练的模型,DualFlow 依然保持较高成功率,体现了其在黑盒环境下的通用性和强大攻击力。整体来看,这些实验充分证明了 DualFlow 在实现多目标、多模型、实例无关攻击上的优势,同时在保证视觉隐蔽性的前提下,提供了现实环境下的高迁移攻击能力。

此外,论文通过加入  约束限制像素级扰动,并利用 velocity 正则化让扰动在时间维度上更加平滑,使最终生成的视频几乎与原始视频无差别,但依然能够稳定让模型 “看走眼”。

约束限制像素级扰动,并利用 velocity 正则化让扰动在时间维度上更加平滑,使最终生成的视频几乎与原始视频无差别,但依然能够稳定让模型 “看走眼”。

总结与贡献

Dual-Flow 提出了一种全新的通用对抗样本生成范式,通过前向与反向 Flow 的协同结构以及级联式分布偏移训练,实现了在多目标、多模型场景下依旧稳定有效的实例无关攻击。相比传统依赖像素级噪声的扰动方式,Dual Flow 所生成的扰动更具结构性、更难被察觉,同时一个生成器即可覆盖多个类别与模型,无需为每个攻击目标单独训练,大幅降低了使用成本。

实验结果表明,Dual-Flow 在黑盒条件下展现出极强的迁移性,例如在从 Inception-v3 迁移攻击 ResNet-152 的实验中,攻击成功率提升高达 34.58%。

该技术已经应用于蚂蚁数科身份安全相关产品的能力优化,集成了该对抗生成框架用于对抗样本的生成和检测,使得防御体系对对抗样本有更好的鲁棒性。