大型语言模型

Meta AI的COCONUT:无需语言即可思考的 AI 方法

译者 | 涂承烨审校 | 重楼当研究人员首次发现大型语言模型(LLMS)可以通过思维链提示一步一步地“思考”时,这是一个突破性的时刻! 我们终于可以窥视这些黑盒子的推理过程了。 但如果我告诉你,让人工智能模型用自然语言思考可能会阻碍它们的发展呢?

多种思维链-CoT

初步知识在本节中,我们提供了标准提示和思维链推理的初步知识。 定义以下符号:问题 Q、提示T 、概率语言模型PLM 和预测A 。 少样本标准提示少样本思维链提示思维链推理的优势作为一种新颖的推理范式,思维链推理具有多种优势:提升推理能力:思维链推理将复杂问题分解为可管理的步骤,并建立这些步骤之间的联系,从而促进推理。

本地构建Llama 3.2-Vision多模态LLM聊天应用实战

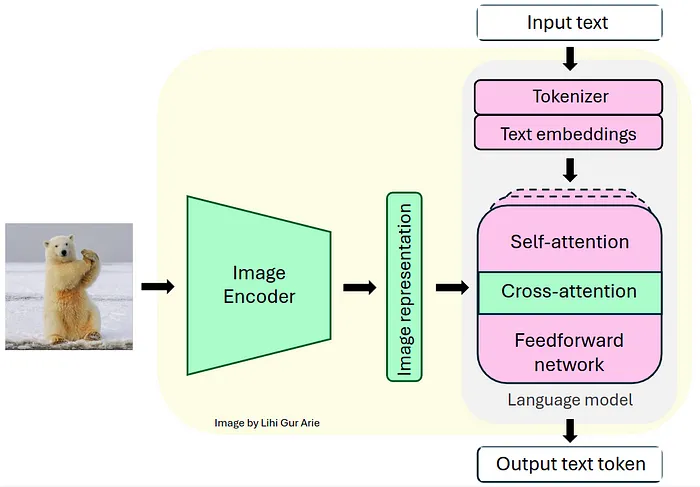

译者 | 朱先忠审校 | 重楼本文将以实战案例探讨如何在类似聊天的模式下从本地构建Llama3.2-Vision模型,并在Colab笔记本上探索其多模态技能。 简介视觉功能与大型语言模型(LLM)的集成正在通过多模态LLM(MLLM)彻底改变计算机视觉领域。 这些模型结合了文本和视觉输入,在图像理解和推理方面表现出令人印象深刻的能力。

使用 Llama 3.2-Vision 多模态 LLM 和图像“聊天”

一、引言将视觉能力与大型语言模型(LLMs)结合,正在通过多模态 LLM(MLLM)彻底改变计算机视觉领域。 这些模型结合了文本和视觉输入,展示了在图像理解和推理方面的卓越能力。 虽然这些模型以前只能通过 API 访问,但最近的开放源代码选项现在允许本地执行,使其在生产环境中更具吸引力。

五款小型多模态AI模型及其功能

译者 | 晶颜审校 | 重楼在过去几年里,我们已经见证了大型语言模型(LLM)的飞速发展,数十亿个参数的基础助力它们成为分析、总结和生成文本及图像,或者创建聊天机器人等任务的强大工具。 所有这些功能都有一些明显的限制,特别是如果用户没有足够的资金或硬件来容纳这些LLM所需的大量计算资源。 在这种情况下,小型语言模型(SLM)应运而生,为资源受限的用户提供了所需服务。

如何使用AutoGen AI技术实现多代理对话

译者 | 李睿审校 | 重楼本文将介绍一个实验,展示多个人工智能代理如何通过群聊方式进行互动,并根据具体的业务需求协同工作,共同生成解决方案的架构。 本文介绍如何使用Databricks Community Edition (CE)(一个免费的基于云的平台)运行一些基本的人工智能Python代码。 因为只处理开源库,所以这个实验可以很容易地在任何Python/PySpark环境中复现。

关于 Meta Llama 3,你知道多少?

2024年,对于人工智能领域来说可谓意义非凡。 继 OpenAI 推出备受赞誉的 GPT-4o mini后,Meta 的 Llama 3.1 模型亦在 . 7月23日 惊艳亮相,再一次掀起了新一轮人工智能热潮。

AI代理即将投入工作 企业需要了解什么?

AI代理工具有望实现大量数字流程的自动化,而这些流程目前是由办公室工作人员操作的。 但对于面临工作方式又一次转变的企业来说,区分长期潜力与短期现实可能是一项挑战。 AI代理很快就会变得无处不在,复杂业务流程实现自动化,为员工处理日常任务——至少这是各种软件厂商的说法,这些厂商正在迅速将智能机器人添加到各种工作应用中。

标记化在LLM中有怎样的重要作用?

译者 | 李睿审校 | 重楼如今,GPT-3、GPT-4或谷歌的BERT等大型语言模型(LLM)已经成为人工智能理解和处理人类语言的重要组成部分。 但在这些模型展现出令人印象深刻的能力背后,却隐藏着一个很容易被忽视的过程:标记化。 本文将解释标记化的定义,标记化如此重要的原因,以及在实际应用中是否能够规避这一步骤。

如何在组织中启用机器学习

译者 | 李睿审校 | 重楼计划在组织内部引入人工智能/机器学习的产品经理通常会提出这样一个问题:“我从哪里开始着手? ”对于缺乏该领域经验的组织来说,深入研究人工智能/机器学习可能会让人感到不知所措。 构建机器学习产品需要不同类型的技能和流程,而这些技能和流程需要逐步被吸纳并融入组织的日常运作中。

部署自己的大型语言模型的七种方法

从零开始构建一个新的大型语言模型(LLM)是一种选择,但对于许多公司来说,成本可能高得难以承受。 幸运的是,还有其他几种部署定制LLM的方法,这些方法更快、更容易,而且最重要的是,更便宜。 GenAI是历史上发展最快的新技术。

LLM2CLIP:使用大语言模型提升CLIP的文本处理,提高长文本理解和跨语言能力

在人工智能迅速发展的今天,多模态系统正成为推动视觉语言任务前沿发展的关键。 CLIP(对比语言-图像预训练)作为其中的典范,通过将文本和视觉表示对齐到共享的特征空间,为图像-文本检索、分类和分割等任务带来了革命性突破。 然而其文本编码器的局限性使其在处理复杂长文本和多语言任务时显得力不从心。

微调大型语言模型(LLM)的五个技巧

译者 | 李睿审校 | 重楼数据质量、模型架构以及偏见缓解方面的专家建议开发人员可以掌握LLM微调来提高人工智能开发的性能和效率。 为什么微调至关重要大型语言模型(LLM)配备了处理广泛任务的通用能力,包括文本生成、翻译、提取摘要和回答问题。 尽管LLM的性能表现非常强大,但它们在特定的任务导向型问题或特定领域(例如医学和法律等)上仍然效果不佳。

关于战略人工智能的深度综述

译者 | 朱先忠审校 | 重楼本文将全面探索战略性人工智能的概念、发展及相关博弈论理论,并对战略人工智能的未来发展方向提出建议。 开场白1997年5月11日,纽约市。 这是纽约市一个美丽的春日,天空晴朗,气温攀升至20摄氏度。

为了创造商业价值,需要充分利用企业的数据和人工智能

尽管人们生活在一个日益数据驱动的世界,但大多数公司并没有采用数据驱动的商业模式。 推动Alphabet、Meta和亚马逊等企业成功的网络效应良性循环,并不适用于销售传统产品和服务的组织。 然而,从日常业务流程生成的专有数据中获取更多信息的工具正在变得广泛可用,并且可以帮助企业开发竞争优势。

最小化的递归神经网络RNN为Transformer提供了快速高效的替代方案

译者 | 李睿审校 | 重楼Transformer如今已经成为大型语言模型(LLM)和其他序列处理应用程序的主要架构。 然而,它们固有的二次方计算复杂性成为了将Transformer扩展至超长序列时的巨大障碍,显著增加了成本。 这引发了人们对具有线性复杂性和恒定内存需求的架构的兴趣。

要创造商业价值,利用AI来利用公司的数据

用专有数据训练大型语言模型能为你带来竞争优势吗?尽管我们生活在一个日益数据驱动的世界中,但大多数公司并未采用数据驱动的商业模式。 像Alphabet、Meta和亚马逊这样的企业凭借网络效应形成的良性循环而取得成功,但这种模式对于销售传统产品和服务的组织来说却难以实现,然而,如今已能广泛获取各种工具来充分利用日常业务流程中生成的专有数据,这些工具可能帮助你的公司形成竞争优势。 随着市场竞争的加剧,利用数据构建防御性护城河至关重要。

基于PyTorch的大语言模型微调指南:Torchtune完整教程与代码示例

近年来,大型语言模型(Large Language Models, LLMs)在自然语言处理(Natural Language Processing, NLP)领域取得了显著进展。 这些模型通过在大规模文本数据上进行预训练,能够习得语言的基本特征和语义,从而在各种NLP任务上取得了突破性的表现。 为了将预训练的LLM应用于特定领域或任务,通常需要在领域特定的数据集上对模型进行微调(Fine-tuning)。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

大语言模型

字节跳动

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉