大型语言模型

大型语言模型是否解决了搜索问题?

译者 | 李睿审校 | 重楼尽管LLM在内容生成方面表现出色,但需要采用语义分块和向量嵌入等技术来解决复杂数据环境中的搜索问题。 大型语言模型(LLM)的涌现推动了信息检索和人机交互的范式转变。 这些模型在大量的文本语料库上进行训练,并针对预测语言任务进行了优化,在响应查询、总结文本内容和生成上下文相关信息方面展现出了显著成效。

谷歌持有Anthropic14%股份,投资已达30亿美元

根据《纽约时报》获取的法律文件显示,谷歌目前持有人工智能初创公司Anthropic14%的股份,接近其允许持有的15%上限。 值得注意的是,尽管投资规模庞大,谷歌在Anthropic并不享有投票权、董事会席位或董事会观察员权。 据报道,谷歌迄今已向Anthropic投入了总计30亿美元的资金,并计划在2025年9月再追加7.5亿美元的投资。

人工智能的深远影响不仅仅是失业:数字幽灵的神秘力量

人工智能正在改变日常生活,从个人助理和推荐算法到高级生成模型。 但最深刻的变化可能是我们未曾预料到的。 虽然新闻头条往往聚焦失业或隐私问题,但人工智能的影响远不止这些。

AI21 Labs发布Jamba 1.6,打破长文本处理极限、支持多种语言

AI21Labs 近日发布了其最新的 Jamba1.6系列大型语言模型,这款模型被称为当前市场上最强大、最高效的长文本处理模型。 与传统的 Transformer 模型相比,Jamba 模型在处理长上下文时展现出了更高的速度和质量,其推理速度比同类模型快了2.5倍,标志着一种新的技术突破。 Jamba1.6系列包括 Jamba Mini(12亿参数)和 Jamba Large(94亿参数),并且专门针对商业应用进行了优化,具备函数调用、结构化输出(如 JSON)和基于现实的生成能力。

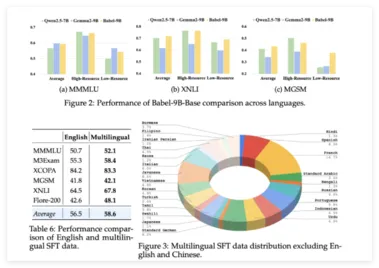

阿里开源多语言大模型Babel,支持25种语言、赋能全球九成人口

阿里巴巴达摩院开源了一款多语言大型语言模型Babel,其宏伟目标正是弥合语言鸿沟,让AI能够理解并使用全球九成以上人口的语言进行交流。 当前许多大型语言模型往往更青睐英语、法语、德语等资源丰富的语言。 然而,如同全球会议中鲜少被提及的小语种使用者一样,印地语、孟加拉语、乌尔都语等拥有庞大用户群体的语言在AI领域也常常被忽视。

2025年的五大AI趋势:智能体、开源和多模型

随着AI技术的飞速发展,2025年的AI领域将迎来前所未有的变革。 从开源AI的崛起,到多模态AI的普及,再到本地AI的蓬勃发展,以及AI成本的显著降低和智能体的广泛应用,这五大趋势将深刻影响企业和个人的未来发展。 2025年,AI领域不再仅仅局限于大型语言模型(LLM),而是聚焦于更智能、更廉价、更专业和更本地的AI解决方案,这些方案能够处理多种数据类型,并实现自主行动。

PyTorch内存优化的十种策略总结:在有限资源环境下高效训练模型

在大规模深度学习模型训练过程中,GPU内存容量往往成为制约因素,尤其是在训练大型语言模型(LLM)和视觉Transformer等现代架构时。 由于大多数研究者和开发者无法使用配备海量GPU内存的高端计算集群,因此掌握有效的内存优化技术变得尤为关键。 本文将系统性地介绍多种内存优化策略,这些技术组合应用可使模型训练的内存消耗降低近20倍,同时不会损害模型性能和预测准确率。

LLM高效推理:KV缓存与分页注意力机制深度解析

随着大型语言模型(LLM)规模和复杂性的持续增长,高效推理的重要性日益凸显。 KV(键值)缓存与分页注意力是两种优化LLM推理的关键技术。 本文将深入剖析这些概念,阐述其重要性,并探讨它们在仅解码器(decoder-only)模型中的工作原理。

当AI更加理解人类语言可能预示提示工程终结

多年来,大型语言模型(LLM)的兴起要求用户学习一种新技能:提示工程。 为了得到人工智能有用的回应,人们不得不精心设计他们的查询问题,学习人工智能如何理解语言的细微差别。 但这种情况可能正在发生变化。

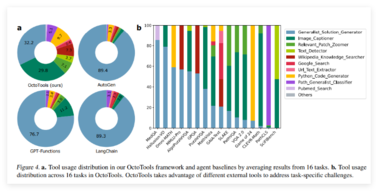

斯坦福新AI框架 OctoTools:无需训练,让AI实现高效复杂推理!

在人工智能(AI)领域,尽管大型语言模型(LLMs)在处理自然语言方面表现出色,但它们在面对复杂推理任务时常常显得力不从心。 这些任务通常需要多步骤的推理、领域特定的知识,或者外部工具的有效集成。 为了克服这些限制,研究人员们一直在探索如何通过外部工具的使用来提升 LLM 的能力。

月之暗面联手UCLA推新模型Mixture-of-Expert,提升语言模型训练效率

在人工智能领域,训练大型语言模型(LLMs)已成为推动技术进步的重要方向。 然而,随着模型规模和数据集的不断扩大,传统的优化方法 —— 特别是 AdamW—— 逐渐显露出其局限性。 研究人员面临着计算成本高、训练不稳定等一系列挑战,包括梯度消失或爆炸、参数矩阵更新不一致及分布式环境下的资源需求高等问题。

企业为何纷纷转向小AI模型?

当科技巨头们还在比拼千亿参数时,一场静悄悄的AI效率革命正在改写商业规则,从医疗诊断到零售库存管理,企业开始用“小模型”解决“大问题”。 大型语言模型因其多功能性、广泛的领域知识和解决复杂多步骤问题的能力而广受欢迎。 相比之下,小型模型为企业提供了一种资源消耗更少的方式,能够利用定制化的专业知识完成特定任务。

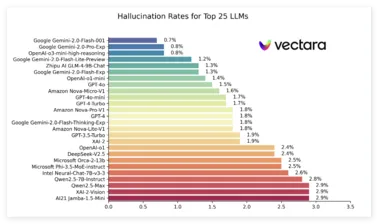

AI大语言模型幻觉排行榜:Gemini 2.0 Flash幻觉最低

近日,Vectara 发布了一份名为 “幻觉排行榜” 的报告,比较了不同大型语言模型(LLM)在总结短文档时产生幻觉的表现。 这份排行榜利用了 Vectara 的 Hughes 幻觉评估模型(HHEM-2.1),该模型定期更新,旨在评估这些模型在摘要中引入虚假信息的频率。 根据最新数据,报告指出了一系列流行模型的幻觉率、事实一致性率、应答率以及平均摘要长度等关键指标。

DeepSeek 背后的技术:GRPO,基于群组采样的高效大语言模型强化学习训练方法详解

强化学习(Reinforcement Learning, RL)已成为提升大型语言模型(Large Language Models, LLMs)推理能力的重要技术手段,特别是在需要复杂推理的任务中。 DeepSeek 团队在 DeepSeek-Math [2] 和 DeepSeek-R1 [3] 模型中的突破性成果,充分展示了强化学习在增强语言模型数学推理和问题解决能力方面的巨大潜力。 这些成果的取得源于一种创新性的强化学习方法——群组相对策略优化(Group Relative Policy Optimization, GRPO)。

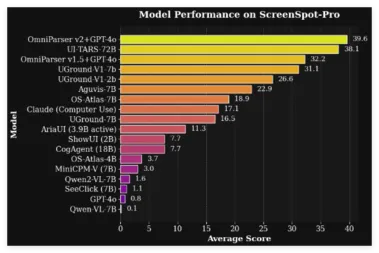

微软发布 OmniParser V2.0:把屏幕截图转化成LLM可处理的结构化格式

微软近日发布了 OmniParser V2.0,这是一个旨在将用户界面(UI)截图转换为结构化格式的全新解析工具。 OmniParser 能够提高基于大型语言模型(LLM)的 UI 代理的性能,帮助用户更好地理解和操作屏幕上的信息。 该工具的训练数据集包括一个可交互图标检测数据集,该数据集从热门网页中精心挑选并自动注释,以突出可点击和可操作的区域。

Meta 创新推出 “连续概念混合” 框架,推动 Transformer 预训练新革命

近年来,随着大型语言模型(LLMs)的快速发展,自然语言处理领域经历了前所未有的变革。 这些技术如今广泛应用于代码助手、搜索引擎和个人 AI 助手等场景,展现了强大的能力。 然而,传统的 “下一个 token 预测” 范式存在一定局限性,尤其是在处理复杂推理和长期任务时,模型需要经历大量训练才能掌握深层次的概念理解。

HuggingFace发布AI Agent课程

Hugging Face 近期推出了一门名为 “Agent课程” 的在线学习课程,旨在帮助学习者深入理解智能Agent的基础知识及应用。 课程内容丰富,共分为五个单元,从Agent的基本概念到最终的作业评估,循序渐进,帮助学员掌握所需技能。 课程的首个单元为 “欢迎来到课程”,提供了课程的概述、指导方针以及所需工具,确保学员在学习过程中拥有良好的基础。

研究表明:AI工具能悄无声息地改变我们的观点

大型语言模型,那些能对我们的提示给出人类回答的智能聊天机器人,会影响我们的观点吗? 《IEEE智能系统》杂志中描述的一项实验表明,答案是肯定的。 这项研究的影响对教师批改论文、员工评估以及许多其他可能影响我们生活的情况都有深远意义。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

大语言模型

字节跳动

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉