英伟达

√N并行+84倍计算加速!英伟达港大全新图像注意力:空间结构都保留

Transformer 及其核心的注意力机制在自然语言处理和计算机视觉等领域带来了革命性进展,展现出强大的深度上下文建模和数据间复杂依赖关系捕捉能力。 然而,其在处理视觉数据时面临两大核心挑战:二次计算复杂度使其难以高效处理高分辨率图像等长上下文数据;忽略空间结构,将多维图像视为无结构的一维标记序列,破坏了图像固有的空间连贯性,而这种信息对于依赖空间关系的视觉任务至关重要。 为克服效率瓶颈,近期研究如线性注意力和状态空间模型(如 Mamba) 致力于将复杂度降低至线性。

大模型推理大变革!CMU 与英伟达携手推出 Multiverse,实现超高速并行生成

随着人工智能的发展,大型语言模型(LLM)的应用越来越广泛,但目前的推理方式仍然存在不少局限性。 传统的自回归生成方式需要逐个生成 token,效率较低且无法充分利用现代硬件的并行计算能力。 为了解决这一问题,卡耐基梅隆大学(CMU)与英伟达的研究团队推出了一种名为 Multiverse 的新型生成模型,旨在实现原生并行生成,从根本上改变我们对 LLM 推理的理解。

逐个token太慢!大模型原生并行出token,CMU、英伟达新作Multiverse

众所周知,大语言模型的参数量越来越大,算力需求也越来越可怕,然而因为「祖宗之法」,推理只能一个一个 token 按顺序来。 对此,卡耐基梅隆大学(CMU)Infini-Al-Lab 的研究人员拿出了「多元宇宙」Multiverse,这是一个全新的生成式建模框架,支持原生的并行生成。 参与这项研究的机器学习大佬,CMU 助理教授陈天奇表示,这是一个有前途的大方向。

黄仁勋反驳Anthropic CEO:呼吁AI开放,反对夸大风险与成本

在法国巴黎VivaTech大会上,英伟达首席执行官黄仁勋对Anthropic首席执行官达里奥·阿莫迪此前关于人工智能(AI)的言论进行了公开反驳。 此前,Meta公司AI首席研究员Yann LeCun也已对阿莫迪进行了数周的批评。 黄仁勋明确不同意阿莫迪关于AI可能在五年内取代一半入门级办公室工作的说法。

全球首次,Transformer「混血」速度狂飙65倍!英伟达已下注

扩散方法打入语言模型领域! 最近,康奈尔博士生Subham Sahoo,在X介绍了扩散大语言模型的最新工作。 这项研究引发了AI研究领域的思考。

Mistral AI 在欧洲推出 Mistral Compute 云平台,进军基础设施市场

Mistral AI 宣布推出 Mistral Compute AI 云平台,正式进军 AI 基础设施市场,与微软 Azure、亚马逊 AWS 等竞争。平台基于英伟达 GPU 和 Mistral 自家训练工具包,提供从裸机到全托管 PaaS 的解决方案。目前服务覆盖欧洲,未来将扩展至中东、亚洲等地。#AI云平台# #MistralAI#

挑战英伟达主导地位,AMD 联手多家 AI 初创公司改进芯片及软件设计

随着越来越多的AI企业寻求英伟达芯片的替代方案,AMD 开始扩大布局,计划打造竞争力更强的硬件,并收购了服务器制造商 ZT Systems。

超越英伟达B200!AMD最强AI芯:1.6倍大内存、大模型推理快30%,奥特曼都来站台

AMD大招逆袭,最强AI芯片号称大模型推理比英伟达B200快30%! CEO苏姿丰与OpenAI奥特曼共同登台发布。 这次AMD发布了MI350X和MI355X两款GPU,采用3nm工艺,包含1850亿晶体管,配备HBM3E内存。

黄仁勋发布量子计算专用CUDA!预言量子计算机几年内应用,但现在还离不开GB200

“量子计算正在到达一个拐点。 ”在GTC巴黎的演讲中,英伟达CEO黄仁勋对量子计算给出了新的论断。 这次,老黄一改此前“实用量子计算机还要20年”的观点,预言量子计算机的实际应用在几年内就能实现。

黄仁勋亲述:当年如何把“价值数十亿美金”的首台AI超算,亲手送给了OpenAI

老黄在法国巴黎最新演讲讲了一个小故事:OpenAI如何获得全世界第一台AI超级计算机。 如今,当人们谈论这一波人工智能的浪潮时,英伟达(NVIDIA)和OpenAI是两个无法绕开的名字。 前者是AI算力的基石,后者则用ChatGPT等产品引爆了全球的AI革命。

消息称英伟达、三星联手投资 AI 机器人公司 Skild AI,估值达 45 亿美元

英伟达、三星等科技巨头投资AI机器人公司Skild AI,估值达45亿美元。软银领投1亿美元,特斯拉、苹果等也在布局机器人领域。英伟达推广“实体AI”概念,认为其将成为重要收入来源。#AI机器人##科技投资#

英伟达开启“攻城略地”模式,拟在欧洲建设 20 座 AI 工厂

根据规划,英伟达将在欧洲建设20座 AI 工厂——这是专为开发、训练和部署 AI 模型所打造的大型基础设施。

翻译平台 DeepL 启用最新英伟达芯片,宣称短短 18 天就能“译遍整个互联网”

德国初创公司DeepL周三宣布,已启用英伟达最新的DGX SuperPOD系统,使其能在短短18天内翻译整个互联网内容——这一速度远超此前的194天。

英伟达黄仁勋盛赞 AI 行业变革速度惊人:过去 10 年进步了 100 万倍

除了更强的 GPU,英伟达、xAI、微软等也在打造远超过去一代的AI系统。

英伟达与港大携手推出新型视觉注意力机制,提升高分辨率生成速度超 84 倍!

近日,香港大学与英伟达共同研发了一种新的视觉注意力机制,名为广义空间传播网络(GSPN),该机制在高分辨率图像生成方面取得了显著的突破。 传统的自注意力机制虽然在自然语言处理和计算机视觉领域取得了不错的效果,但在处理高分辨率图像时却面临计算量巨大和空间结构损失的双重挑战。 传统的自注意力机制的计算复杂度为 O (N²),这使得处理长上下文时非常耗时,并且将二维图像转化为一维序列会导致空间关系的丢失。

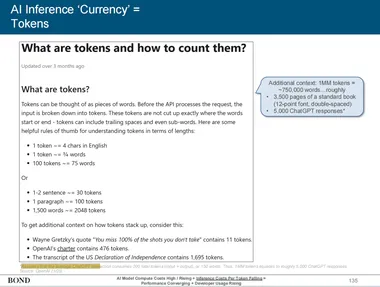

互联网女皇AI趋势报告:AI模型训练成本超高,但推理成本断崖式下降

根据互联网女皇发布的AI趋势报告的深度分析,人工智能(AI)模型的计算经济学正经历着一场关键的转变。 报告指出,训练最强大的大型语言模型(LLM)已成为人类历史上最昂贵、资本最密集的投入之一,目前每个模型的训练成本往往超过1亿美元。 Anthropic首席执行官Dario Amodei在2024年中指出,目前有模型正在训练,其成本接近10亿美元,并预测到2025年,训练成本高达100亿美元的模型可能会出现。

英伟达推出 ProRL 方法:强化学习训练至 2000 步,打造全球最佳 1.5B 推理 AI 模型

英伟达推出 ProRL 强化学习方法,并开发出全球最佳的 1.5B 参数推理模型 Nemotron-Research-Reasoning-Qwen-1.5B。

AMD 收购软件优化创企 Brium,剑指英伟达 AI 硬件领域主导地位

这已是AMD两年内的第四笔AI相关收购,前几次分别为2023年8月的Mipsology、同年10月的Nod.AI,以及2024年7月的Silo AI。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉