英伟达

英伟达成开源新王?Nemotron 3全新混合专家架构,推理效率升4倍

英伟达的自研大模型,刚刚有了大版本的更新。 北京时间今天凌晨,英伟达发布了 Nemotron 3 系列开放模型,共三种规模,分别为 Nano、Super 和 Ultra:Nemotron 3 Nano:300 亿参数规模的小模型,每次最多激活约 30 亿参数,适用于高度定向、极致高效的任务。 Nemotron 3 Super:约 1000 亿参数的高精度推理模型,每个 token 最多激活 100 亿参数,面向多智能体应用。

英伟达收购 SchedMD 加强开源 AI 生态系统布局

根据路透社的报道,英伟达在周一宣布,已收购人工智能软件公司 SchedMD。 随着市场竞争的加剧,英伟达正在加大对开源技术的投入,进一步强化其在 AI 生态系统中的地位。 英伟达以其高速芯片闻名,但它也在 AI 领域积极布局,提供多种自有 AI 模型,涵盖从物理模拟到自动驾驶等多个领域。

加码开源技术,英伟达收购 AI 软件公司 SchedMD

AI在线 12 月 16 日消息,英伟达当地时间周一宣布,已收购人工智能软件公司 SchedMD。 此举彰显了这家芯片设计巨头对开源技术的加倍投入,并进一步加码人工智能生态系统投资,以应对日益激烈的竞争。 除了高性能芯片,英伟达同时也提供涵盖物理仿真、自动驾驶等多个领域的自有 AI 模型,并以开源软件形式供研究人员和企业使用。

应对 AI 时代“缺电”之困,消息称英伟达下周举办闭门峰会

财联社 12 月 12 日电,据 The Information 今日援引多位受邀人士消息,英伟达将于下周召开一场面向初创企业的闭门峰会,重点讨论数据中心的供电瓶颈。 AI在线从报道中获悉,会议将在英伟达位于加州圣克拉拉的总部举行。 当前,“缺电”正给 AI 基础设施带来压力,且有可能拖慢 AI 发展进度。

微软大规模部署 Blackwell GPU,英伟达员工吐槽冷却系统“太浪费”

AI在线 12 月 12 日消息,英伟达正在为微软的数据中心提供最新一代 Blackwell 芯片,而在今年初秋的部署过程中,英伟达一名员工注意到,微软其中一处设施的冷却方式显得过于浪费。 随着 AI 模型训练与推理的算力需求迅猛攀升,英伟达正为微软等科技巨头大量部署 GB200 Blackwell 系统。 今年初秋时,英伟达基础设施专家团队的员工在内部邮件中,详细描述了为 OpenAI 机群部署 Blackwell 机架的现场情况。

英伟达发布开放式推理 AI 助力自动驾驶技术迈向新台阶

在近期于圣地亚哥举行的 NeurIPS 大会上,英伟达推出了其最新的自动驾驶 AI 模型 Alpamayo-R1(AR1),旨在加速实现更广泛的无人驾驶汽车。 英伟达称,AR1是全球首个用于自动驾驶的行业级开放推理视觉语言行动(VLA)模型,能够同时处理文本和图像,帮助汽车传感器将所 “看到” 的信息转化为自然语言描述。 AR1结合了推理链 AI 和路径规划技术,能够更好地处理复杂情境。

英伟达确认可向中国出售 H200芯片:美方批准出口并抽成25%

北京时间12月9日,据 TechCrunch 报道,美国商务部已批准英伟达向中国的特定客户出口其先进 AI 芯片 H200,这标志着英伟达高端 GPU 时隔数月后重新获得进入中国市场的通道。 美国政府还将从相关销售中收取 25% 的分成。 美国总统特朗普已在其社交媒体上公开宣布了这一决定。

英伟达与 Mistral AI 合作推出全新开放模型家族

近日,英伟达宣布与大型语言模型开发商 Mistral AI 达成合作,旨在加速开发和部署一系列新的开放源模型。 根据双方的合作协议,英伟达将利用其强大的平台来支持 Mistral 最新推出的模型家族 ——Mistral 3。 Mistral 3 系列被描述为开放源、多语言和多模态的,且针对英伟达的超级计算和边缘平台进行了优化。

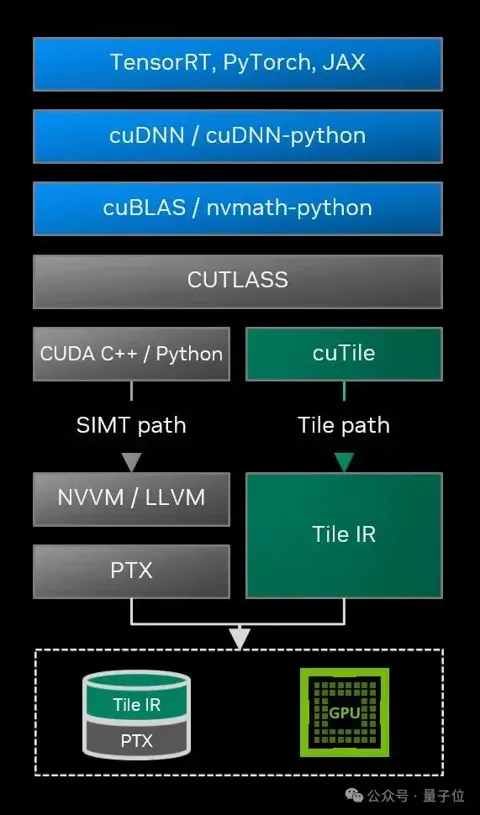

英伟达自毁CUDA门槛!15行Python写GPU内核,性能匹敌200行C++

梦晨 发自 凹非寺量子位 | 公众号 QbitAIGPU编程变天了。 英伟达发布最新版CUDA 13.1,官方直接定性:这是自2006年诞生以来最大的进步。 核心变化是推出全新的CUDA Tile编程模型,让开发者可以用Python写GPU内核,15行代码就能达到200行CUDA C 代码的性能。

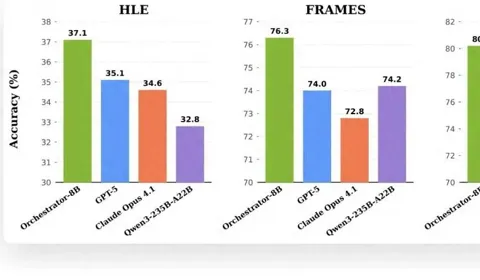

英伟达巧用8B模型秒掉GPT-5,开源了

英伟达端着一个8B小模型对GPT-5说:. 不好意思,你还得练(bushi)。 何出此言?

英伟达CFO反驳"AI泡沫"论:新芯片用于新增算力,领先优势"绝对没有"缩小

当地时间12月2日,英伟达首席财务官科莱特·克雷斯在瑞银全球科技与人工智能大会上强势回应"AI泡沫"质疑,强调全球正处于AI基础设施转型的"早期阶段",公司领先优势稳固。 新芯片非替换而是新增:算力持续叠加针对市场关于"AI泡沫"的担忧,克雷斯给出关键数据支撑:目前交付的大多数英伟达全新AI芯片都被用于增加新的数据中心基础设施,而不是替换现有装机量。 这意味着全球AI算力正在不断叠加增长,而非简单的设备更新换代。

英伟达发布首个自动驾驶推理模型,押注下一代 AI 大脑

芯片巨头英伟达周一在加州圣地亚哥举行的 NeurIPS 人工智能大会上宣布了新的基础设施和人工智能模型,此举旨在加速构建物理人工智能(Physical AI)的基础技术,该领域包括能够感知现实世界并与之互动的机器人和自动驾驶汽车。 首个自动驾驶推理视觉语言模型亮相英伟达发布了 Alpamayo-R1,这是一款专用于自动驾驶研究的开放式推理视觉语言模型(VLAM)。 该公司声称,这是首个专注于自动驾驶的视觉语言动作模型。

英伟达 CEO 黄仁勋动员员工尽可能利用 AI 工具完成各项任务

英伟达正在通过深度整合人工智能(AI),展示其作为行业领头羊的雄心。 公司 CEO 黄仁勋在一次全体员工会议上,强调了 AI 在日常工作流程中的重要性,并要求员工尽可能利用 AI 工具完成各项任务。 他的发言旨在巩固英伟达在 AI 硬件领域的领导地位,同时推动公司内部的技术革新。

谷歌 TPU 发布引发 AI 计算市场价格战,OpenAI 节省 30% 成本

根据最新报道,谷歌正从内部芯片用户转变为芯片零售商,直接挑战英伟达的市场主导地位。 谷歌最新推出的 TPUv7“铁木” 处理器的存在,已经对 AI 计算能力的价格产生了影响,导致市场价格下滑。 过去,谷歌的张量处理单元(TPUs)几乎只用于自身的 AI 模型,但如今的策略已经改变。

百万 TPU 外销计划曝光!谷歌 2027 年欲把 AI 芯片卖给 Meta,云收入或暴增 130 亿美元

摩根士丹利最新研报透露,谷歌已制定 TPU 对外销售路线图:到 2027 年出货 100 万颗,其中 50 万颗即可为公司云业务带来约 130 亿美元增量收入,占谷歌整体云收入 11%,并推升每股收益(EPS)约 3%。 消息传出后,Alphabet 股价一个月累涨近 20%,跑赢同期纳指。 内部人士证实,谷歌正在调整 TPU 商业模式,从“自用加速器”转向“对外创收平台”,首批重点客户包括 Meta——后者正评估数十亿美元采购订单,用于新建 AI 数据中心。

英伟达:祝贺谷歌TPU成功,但GPU领先一代

西风 发自 凹非寺. 量子位 | 公众号 QbitAI一听到谷歌要抢走10%的年收入,英伟达罕见地慌了。 紧急发声,一边客套恭喜谷歌的AI进展,一边明晃晃强调自己的核心地位:我们为谷歌的成就感到欣喜,他们在AI领域取得长足进步,而我们始终是谷歌可靠的供应伙伴。

Gemini 3 震撼发布,TPU 异军突起:英伟达股价单日跌超 7%,市值蒸发超 20%

据财联社消息,11月25日美股早盘,英伟达股价大幅走低,日内一度跌超7%报169.55美元,较上月录得的历史高位回落了逾20%。 英伟达的合作伙伴、服务器制造商超微电脑跌3.2%,承诺购买英伟达系统的甲骨文跌2%,数据中心运营商CoreWeave跌3.7%——英伟达持有该公司6%的股份。 分析认为,投资者将这一轮下跌,归因于市场对谷歌母公司Alphabet自研AI芯片——张量处理单元(TPU)的强烈兴趣。

马斯克:未来五年太空 AI 算力将成新趋势,黄仁勋对此表示质疑

在近日的一次公开讲话中,特斯拉首席执行官埃隆・马斯克预测,未来 4 至 5 年内,太空中的 AI 算力将会成为最具成本效益的选择。 他认为,这得益于太空中 “免费的” 太阳能和便捷的辐射冷却方式。 马斯克提到,随着 AI 计算集群的规模不断扩大,地球的电力和散热需求将达到现有基础设施无法承受的水平。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉