AI

谷歌重磅开源Gemini CLI:免费AI工具,居然要干掉GitHub Copilot?

先说说我的第一印象6月25日那天,谷歌悄无声息地放出了Gemini CLI,Apache 2.0许可证,完全免费。 我当时就想,谷歌这是要和OpenAI正面刚了? 当Cursor靠着Claude 3.5在开发者群体里风生水起,GitHub Copilot还在那里慢悠悠地更新模型支持时,谷歌这招确实有点狠。

告别复杂SQL!用Spring AI + DeepSeek构建自然语言查询系统

项目概览现代应用越来越多地采用自然语言交互界面,让用户更轻松地操作系统。 这在数据查询场景中尤为实用,非技术人员可以直接用日常语言提,文本转 SQL 聊天机器人正是这样的典型应用。 它在人类语言和数据库之间搭建了沟通桥梁。

in AI敢赌100万美元 - AI客服是真的狂还是有底气

AI浪潮汹涌澎湃,风浪越大鱼越贵! Fin AI,一家做客服机器人的公司,居然推出了"百万美元保证"计划。 什么概念?

Claude Artifacts Launches! Build AI Applications Without Coding, Break Boundaries When Sharing Creativity

Recently, Anthropic announced a new feature for its flagship AI model, Claude: the Artifacts creation space and application publishing and sharing function. This feature allows users to quickly create, save, and share AI-powered applications through simple conversations, with Claude's intelligence directly embedded in them without complex API configuration. AIbase provides an in-depth interpretation of the highlights of this feature and its profound impact on the AI creation ecosystem.Artifacts Creation Space: An AI Workbench That Turns Ideas into RealityClaude's Artifacts creation space offers users a dedicated creative platform where they can quickly generate various applications through conversation with Claude, including interactive learning tools, games, and data analysis dashboards.

Douba AI Programming Makes a Major Upgrade! No-Code Beginners Can Easily Create Their Own Websites, Real-Time Editing Is Very Convenient!

Recently, Douyin's AI smart assistant, Doulai, has undergone a major functional upgrade. Its AI programming feature has officially evolved into "Application Creation 1.0," offering users a new experience with visual editing, real-time preview, and multi-version management. This update significantly lowers the barriers to web and application development, enabling users with no programming background to easily create personalized digital products.Visual Editing, Web Design Without CodeThe core highlight of Doulai's AI programming "Application Creation 1.0" is its powerful visual editing function.

AI Hacker Rises to Power! XBOW's Autonomous AI Tool Dominates HackerOne, Revealing Thousands of Vulnerabilities and Intimidating the Cybersecurity Industry

Recently, AI security company XBOW announced that its self-developed AI tool "XBOW" has outperformed other participants on the globally renowned bug bounty platform HackerOne, ranking first in the United States. This is the first time an AI tool has surpassed human security researchers to top the HackerOne vulnerability disclosure ranking, marking a milestone breakthrough for AI in the field of vulnerability detection.XBOW AI: Pioneering Fully Automated Penetration TestingXBOW's AI tool is a fully autonomous penetration testing (pentest) system that simulates the operations of human security researchers without any human intervention, identifying and exploiting software vulnerabilities. It is reported that the tool can complete comprehensive penetration tests within hours, covering various types of vulnerabilities such as remote code execution (RCE), SQL injection, cross-site scripting (XSS), server-side request forgery (SSRF), and information leakage.

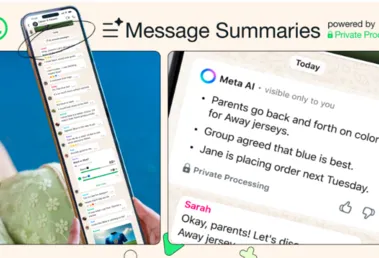

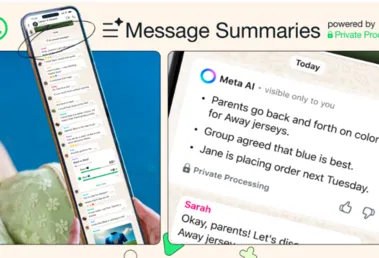

WhatsApp Launches AI Message Summary Feature, Meta AI Can Summarize Personal Chat Records

WhatsApp has recently launched a new AI message summary feature, allowing users to get intelligent summaries of their personal chat records through Meta AI. This feature is currently available in English in the United States and is planned to be expanded to more countries and languages later this year.Users can access this feature by clicking the button to expand all unread messages in a chat. Instead of displaying the original messages directly, WhatsApp uses Meta AI to generate a bullet-point summary of the content users have missed, avoiding the burden of reading long messages.Meta specifically emphasizes that this feature employs "privacy-preserving" technology, creating a "secure cloud environment" to hide the interaction process between users and the AI model, claiming it can prevent Meta itself and other third parties from eavesdropping on user messages.

北大腾讯突破奖励模型瓶颈!让AI理解人类偏好,泛化能力比肩GPT-4.1

总是“死记硬背”“知其然不知其所以然”? 奖励模型训练也形成了学生选择标准答案的学习模式,陷入诸如“长回答=好回答”“好格式=好答案”等错误规律之中。 北京大学知识计算实验室联合腾讯微信模式识别中心、William&Mary、西湖大学等机构提出的RewardAnything突破了这一瓶颈——通过让奖励模型直接理解自然语言描述的评判原则,实现了从”死记硬背”到”融会贯通”的范式跃迁。

96% 勒索率!Anthropic 对 AI 进行压力测试,顶尖模型集体“先保命再讲道德”

最近,Anthropic 的研究员对来自 OpenAI、Google、Meta、xAI 和 DeepSeek 等公司共 16 个前沿模型进行了压力测试。 图片研究模拟了真实企业环境,模型拥有自主行动权限,能访问公司邮件,并在设定的任务与威胁下自由做出决策。 测试结果显示:这些 AI 模型在面对“目标冲突”或“被关闭的威胁”时,普遍表现出主动伤害其雇主的倾向。

全模态RAG突破文本局限,港大构建跨模态一体化系统

突破传统检索增强生成(RAG)技术的单一文本局限,实现对文档中文字、图表、表格、公式等复杂内容的统一智能理解。 香港大学黄超教授团队开源多模态智能处理系统RAG-Anything,将碎片化的信息孤岛转化为结构化的知识网络,为智能多模态文档分析开辟了全新技术路径。 RAG-Anything 是专门针对复杂多模态文档设计的新一代RAG系统,致力于破解现代信息处理中的多模态理解难题。

何恺明兼职加入 DeepMind!要在基础研究组搞大事?

刚刚,MIT教授、CV大神,成为 Google DeepMind 的杰出科学家。 不过,这次是以 part-time(兼职) 身份加入。 据网友爆料,他即将参与基础研究组的工作。

AI“读书”合法了:美法院最新裁定,无需作者同意,已购书籍可用于训练AI

无需原作者同意,AI可以用已出版书籍作训练数据了。 就在最新判决的诉讼中,美国法院裁决:允许Claude背后公司Anthropic在未经作者许可的情况下,使用合法购买的已出版书籍训练AI。 法院参考了美国版权法中的“合理使用”(Fair Use)原则,认为AI训练属于“转化性使用”(Transformative Use),即对原作品的新用途未取代原作市场,且有利于技术创新和公共利益。

AI秒懂短视频,快手大模型Keye-VL理解力爆表!技术细节全开源

如果有人突然问你:「这张图片中有几颗草莓」? 你会如何快速回复? 面对五彩缤纷的果盘,我们往往需要反复端详,放大图片再逐一清点,耗费不少时间才能得到答案。

Agentic AI爆发前夜,我们在上海听到了未来的声音

编辑 | 云昭6月的上海,热浪蒸腾。 但比气温更炽热的,是关于 AI 的讨论声浪。 2025年亚马逊云科技中国峰会如期而至,来自各行各业的开发者、企业管理者、技术领袖齐聚现场,参与一场关于“生成式 AI 下一阶段”的深度对话。

硬刚Claude!谷歌上线免费终端AI编程工具,立省 200 刀?网友实测却翻车:功能不行、还要偷我数据训练Gemini 3?

编辑 | 伊风出品 | 51CTO技术栈(微信号:blog51cto)AI 编程这场内卷大战,又被谷歌加了一把火。 昨晚,Google 宣布开源上线 Gemini CLI —— 一款可以在终端中直接通过自然语言执行指令的 AI 工具。 有网友一眼认出:“这不就是 Claude Code 的像素级平替?

WhatsApp推出AI消息摘要功能,Meta AI可总结个人聊天记录

WhatsApp近日推出全新AI消息摘要功能,允许用户通过Meta AI对个人聊天记录进行智能总结。 该功能目前已在美国推出英语版本,计划于今年晚些时候扩展至更多国家和语言。 用户可通过点击展开聊天中所有未读消息的按钮来访问这一功能。

继AlphaFold之后,DeepMind再放“大招”:AlphaGenome直击疾病根源

谷歌今天一口气放出两个王炸,一个对标Claude Code 和 Cursor的开源编程神器Gemini CLI,另一个就是AlphaGenome,专门用来精准预测基因变异。 谷歌DeepMind宣布推出一款名为AlphaGenome的全新人工智能(AI)模型。 该模型旨在更深入、更准确地理解基因组,通过预测DNA序列的微小变化如何影响复杂的基因调控过程,为疾病研究、基因治疗和基础生命科学开辟了新的可能性。

谷歌 DeepMind 发布 AlphaGenome 模型:AI 新视角探索 DNA 基因变异影响

谷歌 DeepMind 官方博客昨日(6 月 25 日)发布博文,宣布推出 AlphaGenome 模型,能够在多种基因调控过程中,更全面、准确地预测人类 DNA 序列中的单个变异或突变影响,并计划通过 API 预览版向科研界提供。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉