资讯列表

图片一键变身高精度 3D 模型,微软开源最新 AI 工具 TRELLIS.2

AI在线 12 月 18 日消息,日前,微软开源了最新的 AI 工具 ——TRELLIS.2,根据页面介绍,TRELLIS.2 是一个大型 3D 生成模型,具备 40 亿参数,专为高保真图像到 3D 生成而设计。 其构建于原生 3D VAE 之上,可生成高达 1536³ PBR 纹理资产,具有 16 倍空间压缩,可实现高效、可扩展、高保真资产生成。 AI在线从介绍获悉,该模型利用一种被称为 O-Voxel 的全新“无场”稀疏体素结构,,来重建和生成具有复杂拓扑、锐利特征和完整 PBR 材质的任意 3D 资产。

南航联合阿里云发布“天盾”大模型,用于飞行训练、航班预警和故障检修

AI在线 12 月 18 日消息,南方航空与阿里云今日宣布联合发布“天盾”安全大模型。 该模型基于千问多模态大模型与南方航空安全管理体系打造,目前为 1.0 版本,主要用于飞行训练、航班预警和故障检修,具备多模态风险识别、飞行操作评估及故障智能处置等核心功能。 AI在线从官方介绍获悉,长期以来,民航安全面临风险识别滞后、责任链条模糊、决策支撑不足等挑战。

告别抽卡!一手实测字节刚放出的视频模型Seedance 1.5 pro

编辑|杜伟、杨文结果在2025年底,视频生成再次热闹起来,多个新模型接连登场。 我们发现,在国内的头部厂商中,火山发动机的豆包系列视频生成模型已经很长时间没有大的版本更新了。 前代 Seedance 1.0 pro 的问世已经过去半年时间了,这也让我们对其下一代 Seedance 1.5 的关注度越来越高。

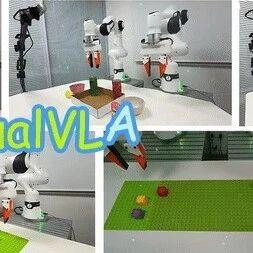

北大发布 ManualVLA:首个长程「生成–理解–动作」一体化模型,实现从最终状态自主生成说明书并完成操纵

视觉–语言–动作(VLA)模型在机器人场景理解与操作上展现出较强的通用性,但在需要明确目标终态的长时序任务(如乐高搭建、物体重排)中,仍难以兼顾高层规划与精细操控。 针对这一问题,北京大学、香港中文大学与至简动力团队提出了全新的「生成–理解–动作」一体化模型 ManualVLA。 论文题目:ManualVLA: A Unified VLA Model for Chain-of-Thought Manual Generation and Robotic Manipulation论文链接:: π0 等端到端模型在处理复杂长程任务时仍面临的推理与执行割裂问题,ManualVLA 摒弃了将「高层次规划」与「动作生成」拆分的传统分层级联方案,构建了全新通用基础模型 Mixture-of-Transformers (MoT) 架构,在同一模型中统一多专家模块,实现多模态生成与动作执行的紧密协同。

日立自研人形机器人亮相,将上岗工厂代替人类“布线安装”等作业

AI在线 12 月 18 日消息,据日经中文网报道,日立制作所 2027 年度之前将在自家工厂引进人形机器人,该机器人搭载自研 AI,代替人类承担电子产品的布线安装等复杂作业。 日立开发的人形机器人的试制品拥有两只手臂,搭载驱动 AI 的计算机和摄像头,两只手臂上各有两根手指;该机器人没有腿,配备带轮子的转向架。 报道提到,为了强化人形机器人领域的业务,未来还考虑推动其他公司引进。

国产 scaleX 万卡超集群真机首次亮相,中科曙光打造

AI在线 12 月 18 日消息,在江苏昆山举行的光合组织 2025 人工智能创新大会(HAIC2025)上,中科曙光今日发布并展出了大规模智能计算系统 —— scaleX 万卡超集群,这也是国产万卡级 AI 集群系统首次以真机形式亮相。 中科曙光高级副总裁李斌介绍,scaleX 万卡超集群是曙光发挥大型计算机系统研制经验优势,面向万亿参数大模型、科学智能等复杂任务场景打造的大规模智能算力基础设施方案。 面对人工智能基础设施对性能、效率、可靠性、可扩展性等方面的极致需求,scaleX 万卡超集群在超节点架构、高速互连网络、存储性能优化、系统管理调度等方面实现了多项创新突破,部分技术与能力已超越海外同类产品研发路线图的 2027 年 NVL576 里程节点。

逐际动力 TRON 2 具身机器人发布:可变化三种形态,4.98 万起

AI在线 12 月 18 日消息,逐际动力 LimX Dynamics 今日推出全新多形态具身机器人 TRON 2,售价 4.98 万元起,即日起在官网开放预订。 一个本体,三种形态自由组合,集高性能操作双臂与全地形移动双足于一体。 ▲ 多形态具身机器人 TRON 2AI在线从官方介绍获悉,TRON 2 采用全身模块化架构,仅需一个本体,即可实现双臂、双足、双轮足三种核心构型的快速切换,并支持人形、四足等形态重构。

为拿下市场和训练数据,OpenAI、谷歌在印度争相推出免费服务

AI在线 12 月 18 日消息,据路透社今日报道,在印度这一超大规模市场,OpenAI、谷歌和 Perplexity 正通过大幅免费策略正面交锋。 报道认为,争夺用户的真正目标并不仅是订阅规模,而是获取大量多语言数据,用于训练下一代 AI 模型。 印度拥有 7.3 亿部智能手机,移动数据价格处于全球低位,用户平均每月消耗 21GB 流量,每 GB 费用仅 9.2 美分(AI在线注:现汇率约合 0.65 元人民币),为 AI 产品迅速扩散提供了天然土壤。

中国气象局:未来十年将在一批关键核心技术上实现突破,建成数值 + AI 地球系统预报体系

AI在线 12 月 18 日消息,中国气象局今日召开新闻发布会,专题发布《地球系统预报发展战略(2025—2035 年)》(以下简称《战略》)。 未来十年,中国气象局将在一批关键核心技术上实现突破,研发大气 — 海洋 — 陆面 — 冰冻圈 — 生物圈 — 社会经济全耦合的地球系统模式,推动人工智能预报模型深度创新,实现数值预报与人工智能深度融合。 到 2035 年,全面建成数值预报与人工智能优势互补、融合统一的地球系统预报体系,实现全球公里级和局地百米级地球系统模式业务运行,提供多圈层全覆盖、从分钟到月季年和年代际的无缝衔接的预报产品。

xAI 推最快语音代理 API,支持中文实时搜索与情绪控制

据 AIbase 报道,xAI 正式发布了 Grok 语音代理 API,以每分钟仅 0.05美元的极具竞争力价格,在实时语音 AI 领域掀起了性能与性价比的双重风暴。 该模型在音频推理基准测试中高居榜首,凭借不足1秒的首音延迟,实现了比竞品快近5倍的响应速度。 技术上,Grok 语音代理不仅支持包括中文在内的数十种语言自动检测与自由切换,更深度集成了实时网页搜索与推理能力,使其回复能够紧跟全网最新资讯。

火山引擎发布 AI 节省计划,豆包大模型最高降价47%

在12月18日举办的火山引擎 FORCE 原动力大会上,火山引擎总裁谭待发布了多项重磅更新,旨在通过视觉模型进化、生态整合及极具竞争力的定价策略,加速 AI 在企业端的规模化普惠。 在多模态领域,豆包视觉模型迎来双重迭代。 图像创作模型 Seedream4.5 能力显著增强,已支持多图组合、创意写真、虚拟试穿及海报设计等多种商业化功能。

火山引擎FORCE大会亮剑:豆包大模型1.8+Seedance 1.5 Pro发布,日均50万亿Tokens登顶中国第一

在今日举行的火山引擎FORCE原动力大会上,字节跳动旗下智能科技品牌重磅升级其AI核心能力:正式发布豆包大模型1. 8 与视频生成模型Seedance 1.5 Pro,并同步推出“AI节省计划”,旨在进一步降低企业使用大模型的成本门槛。 性能方面,豆包大模型1.

Gemini3Flash 正式面向 Perplexity Pro 与 Max 用户开放

12月18日,人工智能搜索平台 Perplexity 宣布,其集成的最新大模型 Gemini3Flash 已全面向 Pro 和 Max 订阅用户开放。 此次更新标志着 Perplexity 在提升响应速度与推理效率方面迈出关键一步。 Gemini3Flash 是谷歌近期推出的轻量级高性能模型,主打低延迟与高吞吐能力,在保持强大语言理解能力的同时,显著优化了推理成本与响应速度。

微软开源 TRELLIS.2:一键将图片转为高精度 3D 模型

近日,微软正式开源了其最新的图像到3D 模型生成工具 ——TRELLIS.2。 该工具在生成高质量、带材质的3D 模型方面表现出色,仅需输入一张图片,便可迅速生成可供 Blender、Unity、Unreal 等平台使用的.glb 格式三角形网格文件。 TRELLIS.2使用了一种名为4B 的模型,能够处理分辨率在512³ 到1536³ 之间的图像。

字节跳动推出 TRAE CN 企业版,助力高效编程

字节跳动正式发布了其 AI 编程工具 TRAE CN 的企业版。 这款工具在字节内部已经获得了超过92% 的工程师的使用,显示出其强大的实用性。 同时,个人版的注册用户也已经突破了600万。

英伟达推出 Nemotron 3:混合架构提升 AI 代理处理效率

英伟达近日发布了其全新的 Nemotron 3 系列,这一系列产品结合了 Mamba 和 Transformer 两种架构,旨在高效处理长时间上下文窗口,同时减少资源消耗。 Nemotron 3 系列专为基于代理的人工智能系统设计,这类系统能够自主执行复杂任务,持续进行长时间的交互。 新产品系列包括三个型号:Nano、Super 和 Ultra。

xAI重磅发布Grok Voice Agent API:每分钟仅0.05美元,音频推理基准登顶第一!

xAI正式推出Grok Voice Agent API,为开发者开放实时语音交互能力。 这一API基于Grok语音技术栈打造,已在移动应用和数百万Tesla车辆中服务海量用户,现向全球开发者全面开放。 极致性价比:每分钟仅0.05美元 Grok Voice Agent API以行业领先的成本效率脱颖而出,采用简单平价计费模式——每分钟连接时间仅0.05美元。

GDPS 2025|宇树、智元首次同台,上海如何以「应用」领跑具身智能竞赛?

大模型的兴起给具身智能带来了前所未有的发展,在实验室场景里,机器人的抓取、开箱、简单装配等短—中期操作任务的平均成功率落在 90%–98% 区间。 然而,实验室的成果,不一定是工程化的成功。 对于具身智能的落地,一个本质问题是:当下的机器人究竟能在多大程度上服务于真实的生产、生活场景?