资讯列表

探索机器人“无遥操”,ATEC2025科技精英赛在港收官

2025年12月7日,香港中文大学。 在真实的户外赛场上,一台机器人正小心翼翼地调整姿态,试图在微颤的吊桥上保持平衡;不远处,另一台机器人则凭借自身的感知系统,识别并分拣着散落于草地上的垃圾。 这些并非预设的演示,而是“第五届ATEC科技精英赛(线下赛)·真实世界极限挑战赛”(简称“ATEC2025”)的真实场景。

诺奖得主教你驾驭大智能时代:解密四种智能的未来

在如今的 “大智能时代”,人类未来的方向如何把握? 诺贝尔化学奖得主、美国科学院院士迈克尔・莱维特(Michael Levitt)在中欧国际工商学院的演讲中,深入探讨了如何引领这一伟大的智能时代。 他每天都与 4 至 5 种人工智能工具进行深度互动,提出上百个问题,分享了关于生物智能、文化智能、人工智能和个人智能的独特见解。

Meta 收购 AI 可穿戴公司 Limitless,助力智能硬件创新

Meta 最近宣布收购了 AI 可穿戴设备初创公司 Limitless,这家公司的智能吊坠以支持语音交互而闻名。 Limitless 得到了多个投资者的支持,包括知名风险投资公司 Andreessen Horowitz 和 OpenAI 的 CEO Sam Altman。 Limitless 的产品可以实时录音、转录,并且支持语音搜索,旨在帮助用户提升专注力和记忆力。

Waymo认栽召回!搞不定校车难题,被抓到19次非法超车

杰西卡 发自 副驾寺. 智能车参考 | 公众号 AI4AutoWaymo摊上事了。 起因是Waymo面对一辆亮着警示灯、还有学生正在下车的校车时,并没有停下等待,反而从右侧超越,扬长而去…….

给机器人打造动力底座,微悍动力发布三款高功率密度关节模组

近日,专注新一代高功率密度关节模组的动力科技公司——微悍动力,对外正式发布三款新品:超紧凑型WHJ03、大负载中空型WHJ120以及WHJ48V宽压系列关节。 此次发布标志着微悍动力在机器人核心零部件领域完成关键布局,以覆盖从轻量精密到重型作业的全场景动力解决方案,加速高性能机器人在消费、商用及工业领域的规模化落地。 作为睿尔曼全资子公司,微悍动力专注新一代HPD(高功率密度伺服)关节模组,具备高功率密度、快速动态响应、高精度、高可靠性、成本可控等硬核优势,为各类机器人与智能设备提供统一的动力底座。

美国监狱电话隐私大曝光:囚犯通话竟成 AI 训练材料

近年来,美国一家名为 Securus Technologies 的电信公司,秘密地利用监狱内囚犯的电话和视频通话记录,构建其专有的人工智能模型。 根据《麻省理工科技评论》的报道,Securus 自2023年起开始开发其 AI 产品,而其收集的通话数据则早在更早的时间就已积累。 这些数据来源于各类监狱,从地方监狱到长期监禁的监狱,甚至包括移民和海关执法局的拘留中心。

Gartner 调查:AI 在客服领域的应用并未显著削减人员需求

根据 Gartner 在2023年10月对321名客户服务和支持主管的调查结果,AI 在客服领域的引入并没有导致大规模的人员削减。 仅有20% 的受访主管表示,由于 AI 的使用,客服团队规模出现了缩减。 这一数据反映出,尽管 AI 被广泛认为是可能取代人类客服的重要技术,但在当前阶段,AI 更多地发挥了增强人类工作的作用,而非完全替代。

C 罗投资 AI 搜索公司 Perplexity,携手推出粉丝互动中心

知名足球巨星克里斯蒂亚诺・罗纳尔多(C 罗)近期宣布,他将投资 AI 搜索引擎公司 Perplexity。 这一消息引发了广泛关注,Perplexity 同时与 C 罗签署了一项全球代言协议,未来还将在其平台上推出一个面向 C 罗球迷的互动中心,以增强粉丝的参与感。 在公告中,Perplexity 表示,C 罗的投资将有助于公司进一步扩展其产品和服务。

编程界“奥斯卡”百度之星决赛揭晓,上千选手激烈角逐,山东16岁中学生王茂骅夺冠!

12月8日,据百度公众号发文,被称为编程界“奥斯卡”的2025百度之星程序设计大赛(以下简称“百度之星”)决赛于12月7日晚在北京圆满收官。 超千名选手在决赛现场展开激烈角逐,当晚,百度公布最终成绩,来自烟台青华中学的王茂骅获得小星星组冠军并斩获总冠军,清华大学程思元获大学组冠军,南京外国语学校许淇文获高中组冠军,各组优胜选手将累计获得10万元奖金。 王茂骅夺冠!

京东云JoyBuilder支持GR00T N1. 5 千卡训练,引领具身智能迈向规模化落地

近日,京东云JoyBuilder模型开发平台迎来关键升级,成功支撑业界顶尖模型GR00T N1.5完成了千卡级训练。 此举使JoyBuilder成为行业首家支持具身智能千卡级LeRobot开源训练框架的AI开发平台,并且在训练效率上实现了巨大飞跃,较开源社区版本提升了3.5倍。 基于软硬件的深度调优和算法层面的突破,JoyBuilder平台大幅提升了模型训练效率与稳定性,使得原本需要15小时完成的1亿多数据千卡训练,现在仅需22分钟,显著加速了具身智能迈向规模化落地的进程。

AI 时代来临:麦肯锡预测全球高达 8 亿个岗位将被取代

随着人工智能技术的迅速发展,来自加州大学伯克利分校的教授 Stuart Russell 发出警告,未来几乎所有的职业,包括首席执行官在内,都可能受到 AI 的影响。 麦肯锡全球研究院发布了一项研究,预测到2030年,全球将有高达8亿个工作岗位可能被 AI 取代,然而与此同时,AI 也将创造出1.3亿到2.3亿个新的工作机会。 图源备注:图片由AI生成,图片授权服务商Midjourney这项研究指出,受影响的行业范围广泛,涉及驾驶、物流、会计、软件工程、医疗、法律、客服、翻译和内容创作等领域。

“不只是把产品做好!”罗永浩谈“豆包”被封杀:事情比想象的复杂得多

今日,在北京举办的极客公园 IF2026创新大会上,知名科技创业者、细红线科技(Thin Red Line)创始人罗永浩在与极客公园创始人张鹏的深度对谈中,就当前AI手机的发展现状及字节跳动旗下AI应用“豆包”面临的困境发表了犀利观点。 罗永浩直言:“AI革命都三年了,无论是苹果、三星,还是华米OV,在智能手机上什么也没做出来。 ”他认为,尽管全球科技巨头纷纷高调宣布布局AI,但在智能手机这一核心终端上,真正具有突破性的产品和体验仍属空白。

我国首个农耕大模型问世,助力耕地保护与监测

近日,中国农业科学院农业资源与农业区划研究所正式发布了我国首个农耕大模型1.0。 这一多模态智能模型专注于高标准农田的建设监测、耕地保护及质量提升,标志着我国在农业智能化领域迈出了重要一步。 该模型由中国工程院院士唐华俊主导开发,采用了 “通识大模型 领域知识 垂直工具链” 的创新架构。

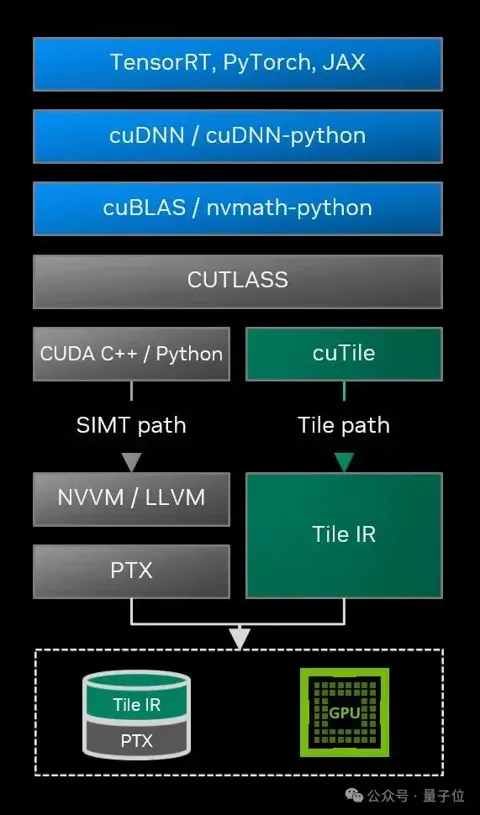

英伟达自毁CUDA门槛!15行Python写GPU内核,性能匹敌200行C++

梦晨 发自 凹非寺量子位 | 公众号 QbitAIGPU编程变天了。 英伟达发布最新版CUDA 13.1,官方直接定性:这是自2006年诞生以来最大的进步。 核心变化是推出全新的CUDA Tile编程模型,让开发者可以用Python写GPU内核,15行代码就能达到200行CUDA C 代码的性能。

ChatGPT“广告乌龙”事件发酵:OpenAI承认“推荐失准”,紧急关闭购物提示功能

OpenAI 首席研究官 Mark Chen 在 X 平台就“付费用户看到 Target、Peloton 购物链接”一事公开道歉,称“任何像广告的体验都必须极度谨慎,我们这次没有达到标准”,并宣布已暂时关闭相关推荐逻辑,直至模型精度与用户控制选项完成升级。

Aaru Series A 幕后:Redpoint领投、多层估值低于10亿,AI模拟人群赛道再吸金

12月5日,三位接近交易人士向 AIbase 证实,AI 消费者研究平台 Aaru 已完成由 Redpoint Ventures 领投的 Series A 轮融资,融资规模超过5000万美元,但 blended valuation 低于此前流传的10亿美元。 本轮采用“多层估值”结构:部分股份按10亿美元定价,其余股份给予更低估值,以吸引特定投资者,最终 headline 估值仍低于10亿美元。 这种同轮多价机制在 AI 热门赛道日益常见,既保留高估值新闻效应,又降低实际进入成本。

Meta AI 牵手全球8大媒体:实时新闻“秒回”+外链导流

Meta 宣布与 CNN、Fox News、Le Monde、USA Today 等8家头部媒体签署商业数据授权协议,将在 Meta AI 聊天机器人内提供实时新闻问答与文章外链。 首批内容覆盖全球突发、娱乐及本地新闻,用户提问即可返回可点击信源,合作伙伴借此获得新增流量。

粤语数字化里程碑!广州大学发布 AI-DimSum 多模态语料库平台

12月6日至7日,第十届语言服务高级论坛在广州大学举行。 会上,粤语语料库建设与大模型评测实验室重磅发布了其研发的 AI-DimSum 多模态粤语语料库平台,标志着在全球拥有上亿用户的粤语在数字化发展中迈入新阶段。 突破低资源困境 广州大学教授齐佳音介绍,粤语在网络世界中属于“低资源语言”。