今日,小米公司正式对外发布具身大模型MiMo-Embodied,并宣布该模型将全面开源。这一动作标志着小米在通用具身智能研究领域迈出了重要一步。

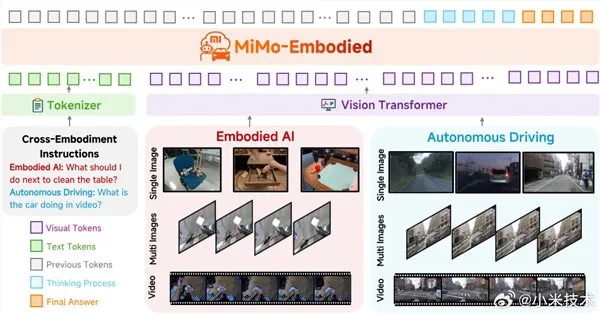

随着具身智能在家居场景的逐步落地以及自动驾驶技术的规模化应用,机器人与车辆如何更好地实现认知与能力互通,室内作业智能与室外驾驶智能能否相互促进,成为行业内亟待解决的关键问题。小米此次发布的MiMo-Embodied模型,正是针对这些挑战而研发,它成功打通了自动驾驶与具身智能两大领域,实现了任务统一建模,从“垂直领域专用”向“跨域能力协同”实现了关键跨越。

MiMo-Embodied模型具有三大核心技术亮点。首先,它具备跨域能力覆盖,同步支持具身智能的三大核心任务,即可供性推理、任务规划、空间理解,以及自动驾驶的三大关键任务,即环境感知、状态预测、驾驶规划,为全场景智能提供了有力支撑。其次,该模型验证了室内交互能力与道路决策能力的知识转移协同效应,为跨场景智能融合提供了新的思路。最后,MiMo-Embodied采用“具身/自驾能力学习CoT推理增强RL精细强化”多阶段训练策略,有效提升了模型在真实环境中的部署可靠性。

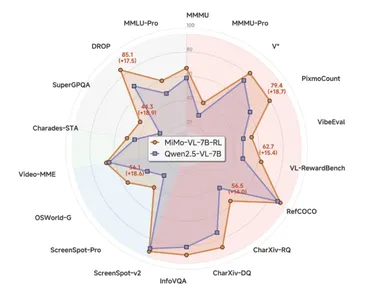

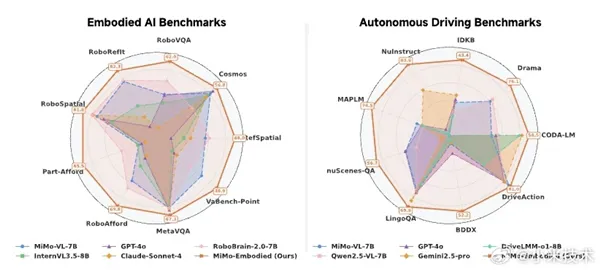

在性能表现上,MiMo-Embodied在涵盖感知、决策与规划的29项核心基准测试中确立了开源基座模型的性能新标杆,全面优于现有的开源、闭源及专用模型。在具身智能领域,该模型在17个基准测试上取得SOTA成绩,重新定义了任务规划、可供性预测及空间理解的能力边界;在自动驾驶领域,它在12个基准测试上表现卓越,实现了环境感知、状态预测与驾驶规划的全链路性能突破。此外,在通用视觉语言领域,MiMo-Embodied也展现了卓越的泛化性,在夯实通用感知与理解能力的同时,进一步在多项关键基准上实现了显著的性能跃升。

开源地址:

https://huggingface.co/XiaomiMiMo/MiMo-Embodied-7B