SIGGRAPH Asia 2025

SIGGRAPH Asia 2025最佳论文 | 港中大、曼彻斯特大学获奖

作为 SIGGRAPH 系列的两大主会之一,SIGGRAPH Asia 是毫无争议的 “天花板级会议”。 每年,这里汇聚了全球顶尖的研究团队,展示着计算机图形学、3D 视觉、计算机辅助设计及数字化制造等领域的最新突破,指引着学术界与工业界的技术风向。 在 2025 年的评审中,大会共收到 1,106 篇技术论文投稿,最终录用 201 篇会议论文和 100 篇期刊(ACM Transaction on Graphics)论文。

SIGGRAPH Asia 2025|当视频生成真正「看清一个人」:多视角身份一致、真实光照与可控镜头的统一框架

第一作者徐源诚是 Netflix Eyeline 的研究科学家,专注于基础 AI 模型的研究与开发,涵盖多模态理解、推理、交互与生成,重点方向包括可控视频生成及其在影视制作中的应用。 他于 2025 年获得美国马里兰大学帕克分校博士学位。 最后作者于宁是 Netflix Eyeline 资深研究科学家,带领视频生成 AI 在影视制作中的研发。

陈天桥旗下盛大AI东京研究院于SIGGRAPH Asia正式亮相,揭晓数字人和世界模型成果

在 SIGGRAPH Asia 2025 期间,盛大集团(Shanda Group)旗下,盛大 AI 东京研究院(Shanda AI Research Tokyo)以展台活动、BoF 学术讨论与顶尖教授闭门交流等形式完成首次公开亮相,标志着盛大在数字人的 “交互智能 (Interactive Intelligence)” 与世界模型的 “时空智能 (Spatiotemporal Intelligence)” 等两大方向的研究,正式登上国际顶级学术与产业舞台。 这一全新范式是盛大集团创始人陈天桥长期愿景的直接体现。 他多年来对脑科学与 AI 融合研究的战略投入,以及在 TCCI 首届 AI 驱动科学研讨会(AIAS 2025)上系统阐述的 “发现式智能”(discovery intelligence)理念,共同强调了智能体认知基底的重要性。

SIGGRAPH Asia 2025 | 只用一部手机创建和渲染高质量3D数字人

在计算机图形学、三维视觉、虚拟人、XR 领域,SIGGRAPH 是毫无争议的 “天花板级会议”。 SIGGRAPH Asia 作为 SIGGRAPH 系列两大主会之一,每年只接收全球最顶尖研究团队的成果稿件,代表着学术与工业界的最高研究水平与最前沿技术趋势。 我们是淘宝技术 - Meta 技术团队,在 3D、XR、3D 真人数字人和三维重建等方向拥有深厚的技术积累和业务沉淀,我们自研了专业的多视角拍摄影棚,在今年 CVPR 2025 会议上作为 Highlight Paper 发表了 TaoAvatar ,并在淘宝未来旗舰店中实现了业内首个 3D 真人导购体验,下面视频展示了杭州西溪园区 C 区淘宝未来旗舰店的精彩瞬间,欢迎大家到来访园区进行体验。

SIGGRAPH Asia 2025:摩尔线程赢图形顶会3DGS挑战赛大奖,自研LiteGS全面开源

12 月 17 日,在香港举办的全球图形学领域备受瞩目的顶级学术盛会 SIGGRAPH Asia 2025 上,摩尔线程在 3D Gaussian Splatting Reconstruction Challenge(3DGS 重建挑战赛)中凭借自研技术 LiteGS 出色的算法实力和软硬件协同优化能力,斩获大赛银奖,再次证明摩尔线程在新一代图形渲染技术上的深度积累与学术界的高度认可。 3DGS:下一代图形渲染的范式革命 开启 AI 加速的高效渲染时代3D Gaussian Splatting(3DGS,三维高斯溅射)是 2023 年提出的一项革命性 3D 场景表示与渲染技术,以可参数化的 3D 高斯分布为核心,实现了画质、效率与资源占用之间的卓越平衡。 与传统 NeRF 相比,3DGS 在保持逼真渲染质量的前提下,将渲染效率提升数百至上千倍,并在光线追踪、VR/AR 实时渲染、多模态融合等方向展现出极强的适应性与扩展性。

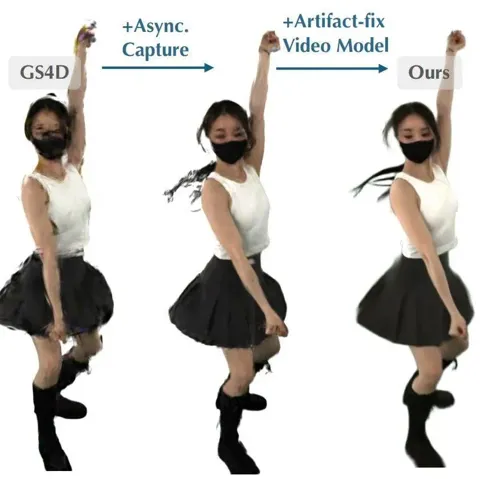

SIGGRAPH Asia 2025|30FPS普通相机恢复200FPS细节,4D重建方案来了

本文第一作者陈羽田,香港中文大学 MMLab 博士二年级在读,研究方向为三维重建与生成,导师为薛天帆教授。 个人主页: 0.01 秒的惊艳弧度,当 VR 玩家想伸手抓住对手 “空中定格” 的剑锋,当 TikTok 爆款视频里一滴牛奶皇冠般的溅落要被 360° 无死角重放 —— 如何用普通的摄像机,把瞬间即逝的高速世界 “冻结” 成可供反复拆解、传送与交互的数字化 4D 时空,成为 3D 视觉领域的一个难题。 然而,受限于硬件成本与数据传输带宽,目前绝大多数 4D 采集阵列的最高帧率仅约 30 FPS;相比之下,传统高速摄影通常需要 120 FPS 乃至更高。

SIGGRAPH Asia 2025 | 让3D场景生成像「写代码」一样灵活可控

随着生成式 AI 的快速发展,从文本生成图像、视频,到构建完整的三维世界,AI “创造空间” 的能力正以前所未有的速度突破边界。 然而,现有 3D 场景生成方法仍存在明显局限:模型往往直接输出每个物体的几何参数(位置、大小、方向等),结果容易出现漂浮、重叠、穿模等问题;场景结构缺乏逻辑一致性,难以编辑或复用,更无法像程序那样精确控制空间关系与生成逻辑。 想象这样一个画面:你输入一句话 ——“在黄昏的码头上,一位渔夫坐在木椅上,旁边是一盏摇曳的灯。

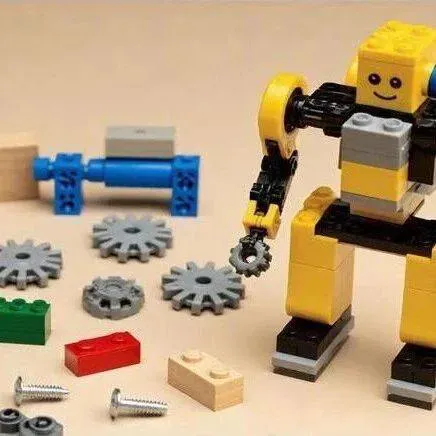

SIGGRAPH Asia 2025 | OmniPart框架,让3D内容创作像拼搭积木一样简单

本文的主要作者来自香港大学、VAST、哈尔滨工业大学及浙江大学。 本文的第一作者为香港大学博士生杨运涵。 本文的通讯作者为香港大学刘希慧教授与VAST 公司首席科学家曹炎培博士。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉