神经网络

诺奖颁给交叉学科,对「AI for Science」意味着什么?

编辑 | X_X2024 年 10 月 8 日,诺贝尔物理学奖授予了两位 AI 领域的科学家,以表彰他们的发现。诺贝尔奖评审团表示,被誉为「人工智能教父」的英裔加拿大科学家 Geoffrey Hinton 和美国物理学家 John Hopfield 因「利用人工神经网络实现机器学习的发现和发明」而获得该奖。这一切意味着什么?Geoffrey Hinton 和 John Hopfield 的研究主要围绕人工神经网络(ANN)的发展,这是一种模仿人脑神经元连接方式的计算模型。Hinton 在深度学习领域的贡献尤其突出,

使神经网络更容易理解,促进科学发现,MIT刘子鸣团队新架构

编译 | 白菜叶「神经网络是目前人工智能领域最强大的工具。」Perimeter Institute for Theoretical Physics 的研究员 Sebastian Wetzel 表示,「当我们将它们扩展到更大的数据集时,没有什么可以与之竞争。」然而,一直以来,神经网络都存在一个缺点。当今许多成功网络的基本构建模块被称为多层感知器(MLP)。但尽管取得了一系列成功,人类仍然无法理解基于这些 MLP 构建的网络是如何得出结论的,或者是否存在一些基本原理可以解释这些结果。神经网络所表现出的能力就像魔术师一样

中国科学院开发出基于语义记忆的动态神经网络:相比静态最高减少 48.1% 计算量

中国科学院微电子研究所等将人工神经网络与大脑的动态可重构性相结合,开发出基于语义记忆的动态神经网络。▲ 基于语义记忆的脑启发动态神经网络硬件软件协同设计大脑神经网络具有复杂的语义记忆和动态连接性,可将不断变化的输入与庞大记忆中的经验联系起来,高效执行复杂多变的任务。目前,人工智能系统广泛应用的神经网络模型多是静态的。随着数据量不断增长,它在传统数字计算系统中产生大量能耗和时间开销,难以适应外界环境的变化。与静态网络相比,语义记忆动态神经网络能够根据计算资源权衡识别准确性和计算效率,可在资源受限设备或分布式计算环境中

类脑计算有望彻底改变计算领域,甚至超越人脑,丰田合作综述类脑计算的兴起

编辑 | KX最近,微软系统故障导致全球大范围宕机。计算已经成为我们生活中不可或缺的一部分。然而,尽管计算机硬件和软件不断改进,但人类大脑仍然是我们所知的最复杂、最强大的计算机。人类大脑通过数十亿个神经元与数万亿个突触相互作用来共享其计算能力,因此,它不仅可以与最强大的超级计算机相媲美,而且由于其消耗的能量比冰箱中的灯亮所需能量还少,因此,人类大脑在效率方面毫无疑问胜过计算机。类脑计算是一个不断发展的跨学科研究领域,研究如何将生物大脑的计算原理转化为硬件设计,从而提高能源效率。类脑计算涵盖各种子领域,包括神经形态计

数百万晶体数据训练,解决晶体学相位问题,深度学习方法PhAI登Science

编辑 | KX时至今日,晶体学所测定的结构细节和精度,从简单的金属到大型膜蛋白,是任何其他方法都无法比拟的。然而,最大的挑战——所谓的相位问题,仍然是从实验确定的振幅中检索相位信息。丹麦哥本哈根大学研究人员,开发了一种解决晶体相问题的深度学习方法 PhAI,利用数百万人工晶体结构及其相应的合成衍射数据训练的深度学习神经网络,可以生成准确的电子密度图。研究表明,这种基于深度学习的从头算结构解决方案方法,可以以仅 2 埃的分辨率解决相位问题,该分辨率仅相当于原子分辨率可用数据的 10% 到 20%,而传统的从头算方法通

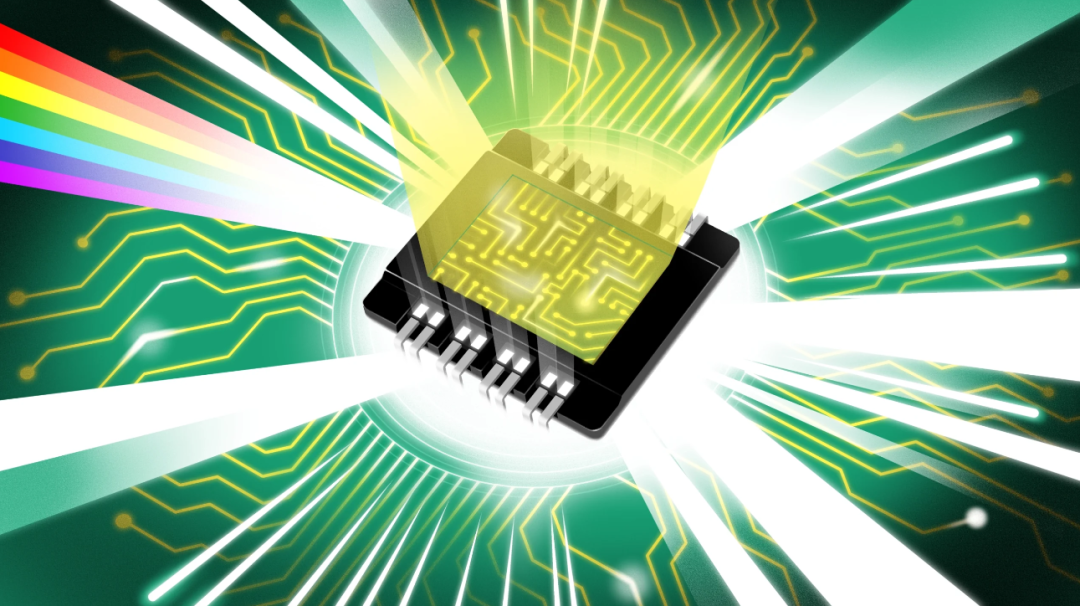

清华“太极-Ⅱ”光芯片面世:成果登 Nature,首创全前向智能光计算训练架构

据清华大学官方消息,清华大学电子工程系方璐教授课题组、自动化系戴琼海院士课题组另辟蹊径,首创了全前向智能光计算训练架构,研制了“太极-II”光训练芯片,实现了光计算系统大规模神经网络的高效精准训练。该研究成果以“光神经网络全前向训练”为题,于北京时间 8 月 7 日晚在线发表于《自然》期刊。AI在线查询获悉,清华大学电子系为论文第一单位,方璐教授、戴琼海教授为论文的通讯作者,清华大学电子系博士生薛智威、博士后周天贶为共同一作,电子系博士生徐智昊、之江实验室虞绍良博士参与了该项工作。该课题受到国家科技部、国家自然科学

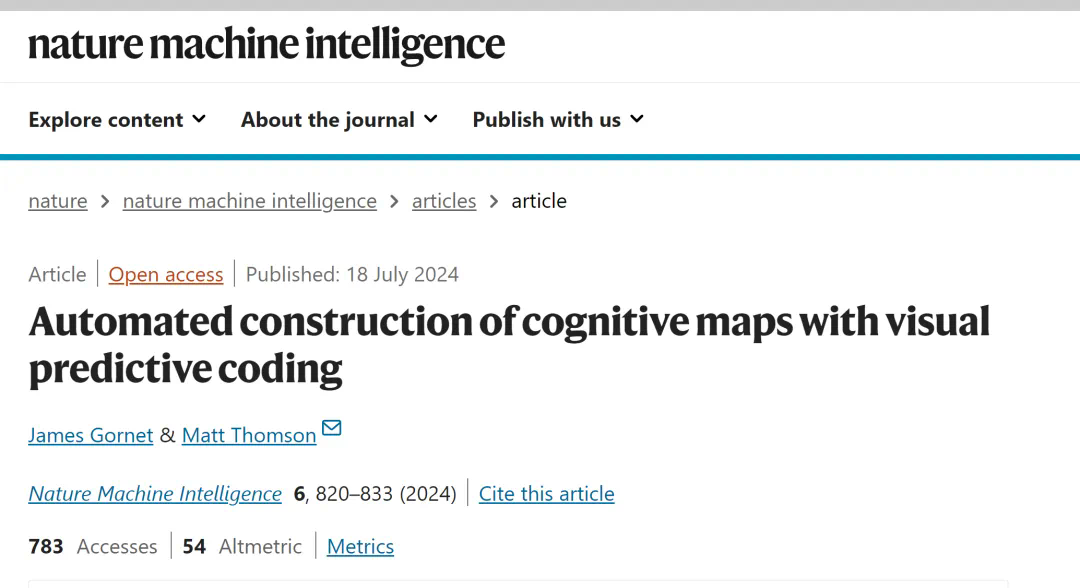

神经网络也有空间意识!学会在Minecraft创建地图,登上Nature子刊

这是人类首次证明神经网络可以创建自己的地图。想象一下,你身处一个陌生的小镇,即使一开始周围的环境并不熟悉,你也可以四处探索,并最终在大脑中绘制出一张环境地图,里面包含建筑物、街道、标志等相互之间的位置关系。这种在大脑中构建空间地图的能力是人类更高级认知类型的基础:例如,有理论认为,语言是由大脑中类似地图的结构编码的。然而, 即使是最先进的人工智能和神经网络,也无法凭空构建这样的地图。 计算生物学助理教授、Heritage Medical 研究所研究员 Matt Thomson 说:「有一种感觉是,即使是最先进的人工

DeepMind开发用于量子化学计算的神经网络变分蒙特卡罗

编辑 | X近百年前,狄拉克提出正电子概念,如今在医学物理、天体物理及材料科学等多个领域都具有技术相关性。然而,正电子-分子复合物基态性质的量子化学计算具有挑战性。在此,DeepMind 和伦敦帝国理工学院的研究人员,使用最近开发的费米子神经网络 (FermiNet) 波函数来解决这个问题,该波函数不依赖于基组。研究发现 FermiNet 可以在一系列具有各种不同定性正电子结合特性的原子和小分子中产生高度精确的、在某些情况下是最先进的基态能量。研究人员计算了具有挑战性的非极性苯分子的结合能,发现与实验值高度一致,并

AlphaFold 3 向解码分子行为和生物计算迈出重要一步,Nature 子刊锐评

编辑 | KX如果我们完全了解分子之间是如何相互作用的,那么生物学就没什么可学的了,因为每一种生物现象,包括我们如何感知世界,最终都源于细胞内生物分子的行为和相互作用。最近推出的 AlphaFold 3 可以直接从蛋白质、核酸及其配体的序列中预测生物分子复合物的 3D 结构。这标志着我们在长期探索生物分子如何相互作用方面取得了重大进展。AlphaFold 3 代表了直接从复合物序列预测其三维结构的突破,为生物分子相互作用提供了见解。生物分子(如蛋白质或核酸)的一维 (1D) 序列以类似于一段代码指定程序的方式指定细

神经网络可能不再需要激活函数?Layer Normalization也具有非线性表达!

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:[email protected];[email protected]本文作者均来自北京航空航天大学人工智能学院和复杂关键软件环境全国重点实验室黄雷副教授团队。一作倪云昊为研一学生,二作郭宇芯为大三学生,三作贾俊龙为研二学生,通讯作者为黄雷副教授(主页:)神

新加坡国立大学赖载兴教授专访:用混沌边缘改善神经网络,与上帝掷骰子 | IJAIRR

2021年,诺贝尓奖委员会决定将物理奖颁发给复杂系统研究领域、以乔治·帕里西(George Parisi)为首三位科学家。 当时不仅物理学界,许多计算神经科学家或理论机器学习学者表达了对帕里西的祝贺和感激,认为他的理论成果极大地推动了神经网络理论研究这一跨学科领域的蓬勃发展。 在新加坡国立大学,Choy Heng Lai(赖载兴)教授便是这一波复杂系统与神经网络跨学科研究风潮的代表人物之一。

ICML 2024 | 特征污染:神经网络会学习不相关特征而泛化失败

论文标题:Feature Contamination: Neural Networks Learn Uncorrelated Features and Fail to Generalize论文链接::,深度神经网络 SGD scaling的机器学习范式再次证明了其在AI领域的主导地位。为什么基于深度神经网络的范式能够取得成功?比较普遍的观点是:神经网络具有从海量的高维输入数据中自动学习抽象而可泛化的特征的能力。遗憾的是,受限于当前分析手段和数学工具的不足,目前我们对于“(深度)神经网络如何实现这样的特征学习过程”这

大模型「幻觉」全无?图神经网络成破解核心,精准预测因果消除「幻觉」

【新智元导读】Alembic 首次推出用于企业数据分析和决策支持的无「幻觉」人工智能。原来大模型的「幻觉」,真的可以完全消除!近日,AI 初创公司 Alembic 首次宣布,一种全新 AI 系统完全解决了 LLM 虚假信息生成问题。也就是说,饱受诟病的 LLM 幻觉,被彻底攻破了。联创兼首席执行官 Tomás Puig 在接受 Venture Beat 独家采访时透露,「取得这一关键突破在于,AI 能够在海量企业数据集中,识别随时间变化的因果关系,而不仅仅是相关性」。他接着表示,我们基本上让生成式 AI 免于产生幻

自动化所研发脉冲动态计算的毫瓦级超低功耗异步感算一体类脑芯片

人脑能够运行非常复杂且庞大的神经网络,总功耗却仅为20瓦,远小于现有的人工智能系统。因此,在算力比拼加速,能耗日益攀升的今日,借鉴人脑的低功耗特性发展新型智能计算系统成为极具潜力的方向。 近日,中国科学院自动化研究所李国齐、徐波课题组与时识科技公司等单位合作设计了一套能够实现动态计算的算法-软件-硬件协同设计的类脑神经形态SOC(System on Chip,系统级芯片)Speck,展示了类脑神经形态计算在融合高抽象层次大脑机制时的天然优势,相关研究在线发表于《自然·通讯》(Nature Communication

光芯片能否代替电子芯片?破解 AI 「算力荒」

编辑 | ScienceAI摩尔定律的描述已经非常快了——计算机芯片每两年左右就会安装两倍数量的晶体管,从而在速度和效率上产生重大飞跃。但深度学习时代的计算需求增长速度更快——这种速度可能不可持续。论文链接:,2026 年人工智能消耗的电力将是 2023 年的 10 倍,而当年的数据中心消耗的能源将相当于日本一个国家一年的能源消耗。报告链接:「人工智能所需的[计算能力]每三个月就会翻一番,速度远远快于摩尔定律的预测。」 计算硬件公司 Lightmatter 的创始人兼首席执行官 Nick Harris 表示,「这会

研究人员推出 xLSTM 神经网络 AI 架构:并行化处理 Token、有望迎战 Transformer

研究人员 Sepp Hochreiter 和 Jürgen Schmidhuber 在 1997 年共同提出了长短期记忆(Long short-term memory,LSTM)神经网络结构,可用来解决循环神经网络(RNN)长期记忆能力不足的问题。而最近 Sepp Hochreiter 在 arXiv 上发布论文,提出了一种名为 xLSTM(Extended LSTM)的新架构,号称可以解决 LSTM 长期以来“只能按照时序处理信息”的“最大痛点”,从而“迎战”目前广受欢迎的 Transformer 架构。IT之家

ICLR 2024 Oral|用巧妙的「传送」技巧,让神经网络的训练更加高效

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:[email protected];[email protected]本论文作者赵博是加州大学圣地亚哥分校的三年级在读博士,其导师为 Rose Yu。她的主要研究方向为神经网络参数空间中的对称性,及其对优化、泛化和损失函数地貌的影响。她曾获 DeepMind

特斯拉分享第二代 Optimus 机器人工作视频:可将电池精确插入托盘

感谢特斯拉今日再次分享了一段第二代 Optimus 人形机器人的工作视频,视频显示,该机器人可将电池单体精确地插入托盘中。据特斯拉官方介绍,他们训练并部署了一个神经网络,允许 Optimus 开始执行有用的任务,例如从传送带上捡起电池单体并精确地将它们插入托盘中。这个神经网络完全端到端运行,意味着它只使用来自机器人的 2D 摄像头以及板载的本体感知传感器的视频,并直接产生关节控制序列。 特斯拉还称,已经在其中一家工厂部署了几个机器人,它们正在实际的工作站上每天进行测试并不断改进。此外,新款 Optimus 现在也能

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉