神经网络

图像相似度估计 | 结合三元组损失的暹罗网络

在机器学习领域,确定图像之间的相似度在各种应用中至关重要,从检测重复项到面部识别。 解决这个问题的一个强大方法是使用暹罗网络结合三元组损失函数。 在本文中,我们将探索如何构建和训练暹罗网络以估计图像相似度,并通过一个来自GitHub仓库的实际示例进行说明。

基于CNN+PyTorch实现视觉检测分类

译者 | 朱先忠审校 | 重楼本文给出了一个使用CNN+PyTorch实现汽车电子行业视觉检测分类详尽的实战案例解析。 在本文中,我们开发了一个卷积神经网络(CNN),用于汽车电子行业的视觉检测分类任务。 在此过程中,我们深入研究了卷积层的概念和相关数学知识,并研究了CNN实际看到的内容以及图像的哪些部分导致它们做出决策。

时间序列模型的演变:人工智能引领新的预测时代

译者 | 布加迪审校 | 重楼我们正处于这样一个时代:大型基础模型(大规模通用神经网络以无监督的方式使用大量不同的数据进行预训练)彻底改变计算机视觉、自然语言处理以及最近的时间序列预测等领域。 这种模型通过实现零样本预测来重塑时间序列预测领域,允许使用新的、未见过的数据进行预测,无需针对每个数据集进行重新训练。 这一突破显著缩减了开发时间和成本,简化了为不同任务创建和微调模型的过程。

字节&北大Nature子刊新成果:自旋本征态的高效精确求解

编辑 | ScienceAI近些年来 AI for Science 在众多领域取得重大成功。 其中,基于神经网络的量子变分蒙特卡洛方法 (NNVMC) 在量子化学领域展现出强大潜力,备受关注。 最近字节跳动研究部门 ByteDance Research 和北京大学团队在 NNVMC 框架中融入物理对称性,实现了量子激发态的高效精确求解。

快速学会一个算法,卷积神经网络!!!

今天给大家分享一个强大的算法模型,卷积神经网络。 卷积神经网络(CNN)是一类专门用于处理具有网格结构数据(如图像)的深度学习模型,广泛应用于图像处理、计算机视觉等领域。 CNN 通过模仿生物视觉系统的结构,通过层级化的卷积和池化操作,自动从输入数据中提取特征并进行分类或回归。

最大限度提高人工智能训练效率:选择合适的模型

译者 | 李睿审校 | 重楼快速准确地训练人工智能模型,对于建立对这些工作流工具的信任非常重要。 随着人工智能驱动的应用程序执行复杂任务的能力越来越强,数据科学家和机器学习工程师需要探索新方法。 要为特定用例开发最佳模型,利用合适的模型、数据集和部署可以简化人工智能开发过程并产生最佳结果。

终于把神经网络中的知识蒸馏搞懂了!!!

大家好,我是小寒今天给大家分享神经网络中的一个关键知识点,知识蒸馏知识蒸馏是一种模型压缩方法,用于将大型神经网络(教师模型)中的知识转移到较小的神经网络(学生模型)中。 这一技术能够在保持或接近原始模型性能的情况下,显著减小模型的体积,从而提升推理效率。 知识蒸馏在很多场景中非常有用,尤其是在计算资源有限或需要部署到边缘设备的应用中。

科研党狂喜!AI预测神经学研究结论超过人类专家水平 | Nature子刊

LLM可以比科学家更准确地预测神经学的研究结果! 最近,来自伦敦大学学院、剑桥大学、牛津大学等机构的团队发布了一个神经学专用基准BrainBench,登上了Nature子刊《自然人类行为(Nature human behavior)》。 结果显示,经过该基准训练的LLM在预测神经科学结果的准确度方面高达81.4%,远超人类专家的63%。

揭示Transformer「周期建模」缺陷!北大提出新型神经网络FAN,填补周期性特征建模能力缺陷

周期性现象广泛存在,深刻影响着人类社会和自然科学。 作为最重要的基本特性之一,许多规律都显式或隐式地包含周期性,例如,天文学中的行星运动、气象学中的季节变化、生物学中的昼夜节律、经济学中的商业周期、物理学中的电磁波,以及数学运算和逻辑推理等。 因此,在许多任务和场景中,人们希望对周期进行建模,以便根据以往的经验进行推理。

宝可梦GO「偷家」李飞飞空间智能?全球最强3D地图诞生,150万亿参数解锁现实边界

李飞飞提出的「空间智能」概念,被宝可梦GO团队抢先实现了? 最近,宝可梦GO团队宣布,构建出了一个大规模地理空间模型LGM,让我们距离空间智能更近了一步。 而这一成果也意味着,人类在空间计算和AR眼镜领域,即将进入崭新的时代。

如何简单理解视觉语言模型以及它们的架构、训练过程?

关于视觉语言模型(VLMs),以及它们的架构、训练过程和如何通过VLM改进图像搜索和文本处理的多模态神经网络。 可以参考这篇文章:(VLMs),它们是未来的复合AI系统。 文章详细描述了VLMs的基本原理、训练过程以及如何开发一个多模态神经网络,用于图像搜索。

最小化的递归神经网络RNN为Transformer提供了快速高效的替代方案

译者 | 李睿审校 | 重楼Transformer如今已经成为大型语言模型(LLM)和其他序列处理应用程序的主要架构。 然而,它们固有的二次方计算复杂性成为了将Transformer扩展至超长序列时的巨大障碍,显著增加了成本。 这引发了人们对具有线性复杂性和恒定内存需求的架构的兴趣。

快速学会一个算法,卷积神经网络

大家好,我是小寒今天给大家介绍一个强大的算法模型,卷积神经网络卷积神经网络(CNN)是一种专门用于处理图像、视频等具有网格结构数据的深度学习模型。 CNN 通过局部连接和参数共享的方式,大幅减少了模型的计算量,能有效提取数据的局部和全局特征,被广泛应用于计算机视觉领域,如图像分类、物体检测、图像分割等。 图片卷积神经网络的基本结构卷积神经网络的主要包括卷积层、池化层和全连接层。

终于把神经网络中的激活函数搞懂了!!!

今天给大家分享神经网络中的一个关键概念,激活函数激活函数是神经网络中的核心组件之一,其主要作用是在每个神经元中为输入信号提供非线性变换。 如果没有激活函数,神经网络将充当简单的线性模型。 激活函数的作用激活函数的引入使得神经网络可以学习和表示复杂的非线性关系,从而解决一些线性模型无法处理的问题。

用 PyTorch 构建神经网络的 12 个实战案例

用PyTorch构建神经网络是机器学习领域中非常热门的话题。 PyTorch因其易用性和灵活性而受到广大开发者的喜爱。 本文将通过12个实战案例,带你从零开始构建神经网络,逐步掌握PyTorch的核心概念和高级技巧。

一种实现符号钢琴音乐声音和谱表分离的GNN新方法

译者 | 朱先忠审校 | 重楼本文涵盖了我最近在ISMIR 2024上发表的论文《聚类和分离:一种用于乐谱雕刻的声音和谱表预测的GNN方法》的主要内容。 简介以MIDI等格式编码的音乐,即使包含量化音符、拍号或小节信息,通常也缺少可视化的重要元素,例如语音和五线谱信息。 这种限制也适用于音乐生成、转录或编曲系统的输出。

中国科学院核聚变最新进展,AI 加速等离子体参数预测

编辑 | KX等离子体离子温度和旋转速度是评估聚变实验的重要参数之一,对等离子体稳定性和约束性能有重要影响。如何实现等离子体离子温度和旋转速度的快速精确测量,一直是聚变装置稳定高参数运行所面临的关键技术问题之一。近日,中国科学院合肥物质科学研究院的研究团队在等离子体关键参数诊断研究方面取得新进展。

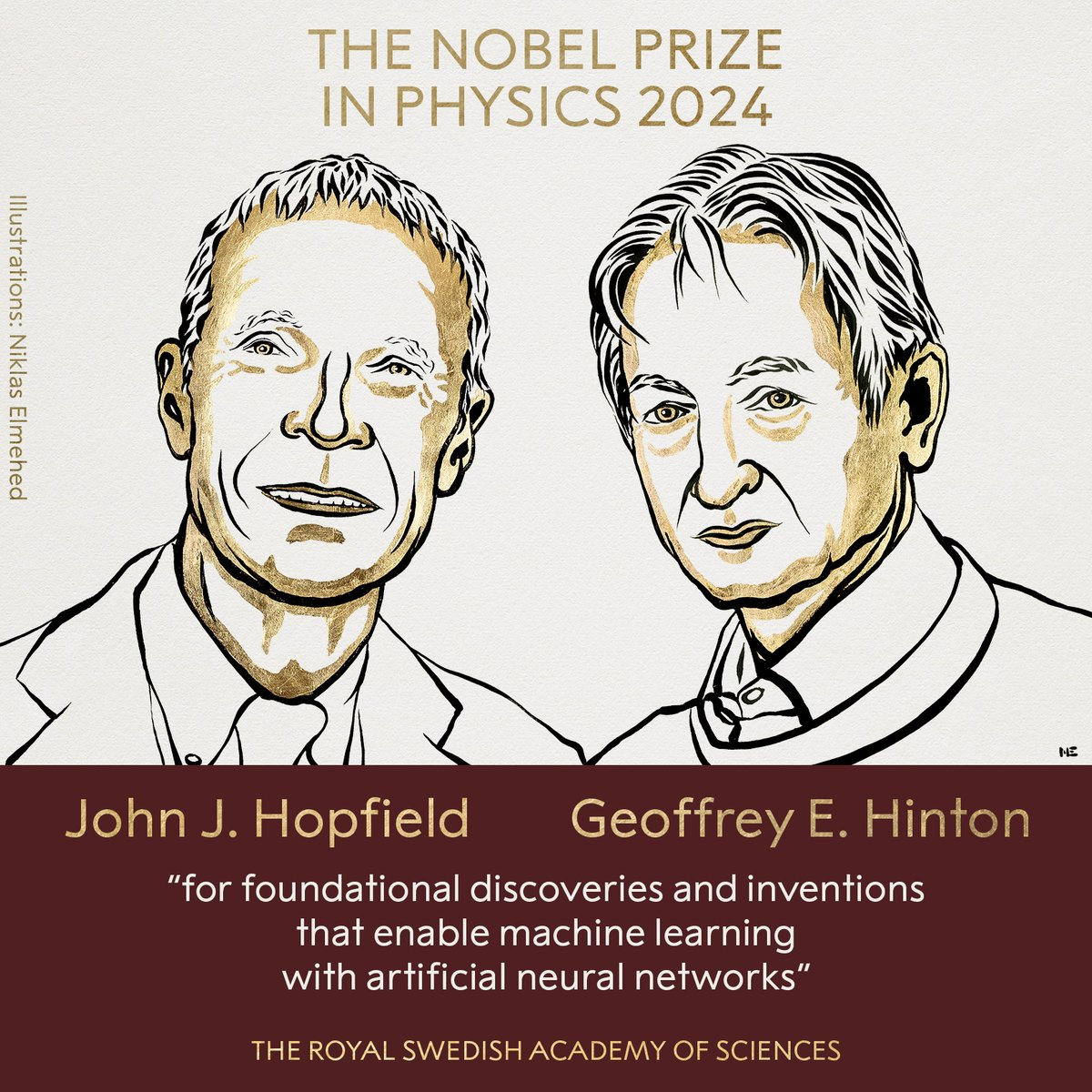

解读:物理诺贝尔奖为何颁给了HNN之父和深度学习之父?

就在刚刚,瑞典皇家科学院决定将 2024 年诺贝尔物理学奖授予约翰·J·霍普菲尔德 (John J. Hopfield) 和杰弗里·E·辛顿 (Geoffrey E. Hinton),“表彰他们通过人工神经网络实现机器学习的基础性发现和发明”。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉