RAG

RAG多岗位简历筛选系统实践:多租户架构设计模式与源码解读

我在8月底的时候,发过一篇基于 LlamaIndex LangChain 框架,开发的简历筛选助手的应用。 后续有星球成员提出希望能增加多个岗位的管理功能,正好接下来的校招活动可以用的上。 这篇在原项目的基础上,核心实现了多岗位并行管理(独立 JD、候选人池、向量索引隔离)和 HR 工作流(标签系统、分组展示、快速操作),同时进行了架构重构(分层设计、数据分库、模块化),并增强了大模型分析输出(四级推荐等级、结构化优劣势)和智能问答(按岗位过滤检索、流式输出)。

MinerU2.5源码拆解:双后端架构设计与企业级部署实践

8月中旬的时候,我去MinerU的办公室交流过一次。 当时对方有位工作人员表示,接下来会很快基于视觉模型的路线实现全面 SOTA。 说实话,那个时候我还挺怀疑的。

大模型时代的双刃剑:RAG 与 微调 怎么选?

上周在一个技术交流会上,听到两位技术总监争得面红耳赤。 一位坚持说RAG就够了,简单高效还省钱;另一位则认为不微调根本做不出专业应用。 这场争论让我想起很多企业在落地AI项目时的迷茫:到底该选哪条路?

CompLLM:无需微调,4倍加速长上下文问答的软压缩新范式

大家好,我是肆〇柒。 今天要介绍的是一项来自 Amazon 与中佛罗里达大学计算机视觉研究中心(Center For Research in Computer Vision, University of Central Florida) 的最新研究成果——CompLLM。 这项工作直面长上下文问答中的核心瓶颈:自注意力机制带来的 O(N²) 计算开销。

为何上下文成为人工智能领域的“新贵”:从 RAG 到上下文工程

译者 | 晶颜审校 | 重楼三个月前,我们的生产系统遭遇了一次严重故障,其根源并非代码缺陷或基础设施故障,而是源于对人工智能系统优化目标的根本性误解。 此前,我们搭建了一套自认为具备先进水平的文档分析流程,整合了检索增强生成(RAG)、向量嵌入、语义搜索及精细调优的重排序功能。 在演示场景中,该系统能够精准且富有说服力地回答关于客户监管文件的各类问题,但投入实际运行后,却频繁出现回答与上下文完全脱节的问题。

AI黑话听不懂?收藏这份3分钟快速扫盲指南!

第一次进 AI 项目组开会,你可能会有这种体验:大家自信满满地聊着——“我们先优化下 RAG系统的延迟,再调人设,顺便做个 A/B test看看效果。 ”而你坐在角落里,内心 OS:别慌,这些所谓的“AI 黑话”,其实就是业内人习惯的专业术语。 听起来玄乎,其实拆开来都挺接地气。

揭秘RAG检索增强生成:从原理到Spring AI实战,开启AI新世界!

在当今人工智能的奇妙世界里,RAG检索增强生成技术就像是一颗冉冉升起的新星,正以其独特的魅力吸引着无数开发者和研究者的目光。 今天,咱们就一起来深入探究一下这个神奇的RAG技术,从它的基本原理到完整实现,再到结合Spring AI的超详细应用,保证让你对它有一个全方位的了解。 图片一、RAG技术:开启模型理解与生成的新大门(一)什么是RAG技术RAG,全称检索增强生成(Retrieval-Augmented Generation),这名字听起来就很厉害,感觉像是给模型加上了一个超级外挂。

RAG在B站大会员中心数据智能平台的应用实践

在数字化浪潮中,数据已成为企业的核心资产。 在B站大会员中心部门,数据智能平台扮演着举足轻重的角色。 它不仅要处理和分析大规模的会员数据,为会员服务的优化和拓展提供坚实的数据支撑,还要满足业务对于数据洞察的多样化需求。

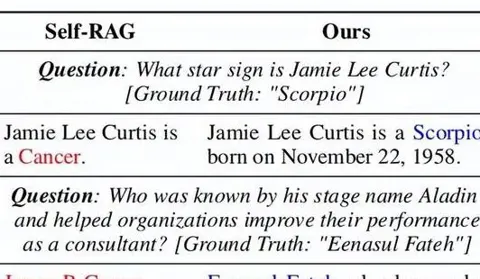

让RAG真正读懂“言外之意”!新框架引入词汇多样性,刷新多项基准SOTA

RAG准确率提升10.6%,多项基准拿下新SOTA! ACL 2025最新研究提出Lexical Diversity-aware RAG (DRAG) 框架,首次系统性地将词汇多样性引入RAG的检索与生成过程,提供了一个轻量、通用且易扩展的解决方案。 在多项基准任务中,该方法带来了显著性能提升,尤其在HotpotQA上刷新了当前最优结果。

SpringAI + Redis:构建高性能RAG问答系统的架构设计与实战

引言:RAG技术为何成为企业AI应用首选实现成本降低千倍、响应速度秒级的企业级知识库解决方案在当前AI技术飞速发展的背景下,企业面临着一个核心挑战:如何让大语言模型(LLM)准确掌握企业内部知识并避免产生幻觉(Hallucination)? 检索增强生成(Retrieval-Augmented Generation,RAG)技术应运而生,它通过将信息检索与生成模型相结合,有效解决了这一难题。 Spring AI作为Spring官方推出的AI开发框架,为Java开发者提供了构建AI应用的标准化方案。

HANRAG:用“启发式”决策终结多跳问答的噪声与低效困局

大家好,我是肆〇柒。 今天一起了解一篇来自蚂蚁集团(Ant Group)的研究力作——HANRAG。 这项工作从根本上重新思考了RAG系统的决策逻辑。

腾讯Youtu Lab新突破:HiChunk如何用“分层分块”让RAG更聪明?

在AI领域,RAG(检索增强生成)早已不是新鲜词——它就像给大模型装了一个“外部知识库”,通过检索真实文档来回答问题,避免“瞎编乱造”。 但很多人不知道,RAG的效果好坏,很多时候卡在一个看似基础的环节上:文档分块,对于在实际落地中,文档分块也是一个令人非常头疼的难题。 简单说,“分块”就是把长文档切成小片段(比如每200词一段),方便后续检索。

2025爆火的RAG技术是什么?从原理到应用全面科普!

前言. 最近,RAG 这个词在网络中爆火,特别是一些 AI 方向的小伙伴,网上铺天盖地的文章、视频等教程,但是他们都各有各的不同看法,接下来就让我从一名 AI 产品经理角度,带你们彻底了解什么是 RAG、前世今生是什么、实用场景、工作原理、具体应用。 上期回顾:一、RAG 是什么.

万字长文详解腾讯优图RAG技术的架构设计与创新实践

导语在信息爆炸的时代,如何从海量数据中精准获取知识并生成智能回答,已成为AI落地的核心挑战。 腾讯优图实验室凭借前沿的RAG体系,突破传统检索与生成的局限,打造了一套覆盖语义检索、结构化表检索、图检索的全栈解决方案。 本文将为你深度解析优图实验室RAG技术的架构设计与创新实践:从多阶段训练的2B级Embedding模型、Reranker分层蒸馏,到结构化表的智能解析与查询,再到自研GraphRAG框架在构图效率与复杂推理上的突破。

当RAG遇上MCP...

随着基础模型能力的不断增强,现实世界中的应用场景对人工智能提出了更高的要求,推动其向更具上下文感知能力、依赖外部信息检索以及由智能智能体驱动的方向发展。 为了满足这些需求,诸如检索增强生成(RAG)和MCP等关键技术正逐步成为构建现代AI系统的核心组成部分。 简要回顾检索增强生成(RAG)是一种结合语言模型与外部知识库的方法,使模型能够在生成回答之前,先通过向量搜索或语义搜索技术检索相关的文档内容。

系统梳理 RAG 系统的 21 种分块策略

检索增强生成(RAG)是许多 AI 工程师又爱又恨的技术(包括我)。 没错,因为从理论上看,它简单极了:“从你的定制数据中检索正确的上下文,然后让大语言模型基于此生成回答”。 但在实践中,你不得不面对海量杂乱无章的数据 —— 这些数据以你见过的最混乱随机的格式存储,接着就是数日绞尽脑汁的试错:调整文本块(tweaking chunks)切换嵌入模型(switching embedding models)替换检索器(swapping out retrievers)微调排序器(fine-tuning rankers)重写提示词(rewriting prompts)而模型依然回复:“我找不到足够的信息来回答你的问题”。

RAG 不止能检索!它还能在 LangGraph 中当“工具调用大脑”

Retrieval-Augmented Generation(RAG)是一种结合信息检索和大型语言模型(LLMs)来回答用户查询的方法。 传统上,这涉及将检索器直接连接到生成流水线。 然而,通过 LangGraph 和 LangChain,我们可以进一步模块化这个过程,将检索器暴露为一个可调用的工具。

智能简历筛选案例拆解:基于LlamaIndex+LangChain的框架开发

上一篇文章介绍了使用基础组件,实现企业规章制度 RAG 问答的案例。 这种原生开发方式虽然有助于更直观的理解 RAG 原理,但在面对更复杂的业务场景时,开发效率和功能扩展性方面的局限就会很明显。 尤其是包含异构文件整合、结构化信息提取和多轮对话交互的综合性应用,引入成熟的开发框架成为合理选择。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉