大模型

人工智能应用就是大模型能力+场景,基于大模型构建应用,首先要了解大模型的能力圈

在关于大模型应用方面,虽然也了解和应用过其中的一些技术;但经过这段时间的实践和思考发现,对大模型应用的认识还很浅显,因此在此记录一下自己的思考。 大模型应用的思考大模型作为人工智能应用的底座技术,所有应用场景和技术都是构建在大模型之上;但很多时候我们都搞错了一件事,那就是我们没有搞清楚大模型能力和其它技术的关联和区别。 因此,在这里我们要搞清楚一个概念,那就是大模型能力;所谓大模型的能力,就是模型开发人员怎么把模型做的更好更强,其中设计到模型的设计,训练等;具体有神经网络架构,模型蒸馏等等。

大模型应用的能力分级

对大模型应用的能力分级就像给学生打分一样,能让我们更清楚它的本事有多大。 能力分级能帮我们设定目标,知道AI现在能干什么,未来还要学什么。 有了统一的分级方式,大家就能公平比较不同AI的水平,推动技术进步。

关于大模型智能体意图识别不准确问题:function call 的缺陷

最近在研究大模型智能体也就是Agent的过程中,遇到了一个很严重的问题,直接影响到Agent的质量和效果;那就是意图识别不准确,也可以说是Agent的幻觉问题。 其产生的原因就在于大模型有时无法准确识别出用户意图,无法准确调用相应的函数。 意图识别不准确现在大模型技术在应用方面,主要有两大方向;其一就是大模型的创作能力,简单来说就是内容生成方面,如生成图片,文字,视频,也包括RAG等。

AI算法 | 如何训练自己的大模型?

1、第一阶段:二次预训练模型选择与转换在开始训练之前,需要选择一个合适的基础模型。 本文以LLaMA-7B为例,简单介绍下。 为了方便后续的操作,将LLaMA-7B模型转换为Hugging Face格式。

阿里云与南京大学联合启动人工智能人才培养合作计划

南京大学与阿里云正式宣布启动一项人工智能人才培养合作计划,旨在共同培养适应未来技术变革、具备跨学科思维的 AI 创新人才。 该合作充分利用了阿里云在云计算和人工智能领域的技术优势,以及南京大学在相关学科的深厚底蕴。 根据协议,南京大学与阿里云将共同设计一系列前瞻性和应用性的人工智能通识课程,同时研发跨学科融合的大模型应用实践课程。

面壁智能 CEO 李大海:汽车比手机更适合端侧模型落地

李大海指出,因为汽车这个场景,用户的手天然就会在方向盘上,用户更需要用语音去跟座舱交互,同时座舱也有更多的传感器能够去感知环境。相比之下,手机反而没有这样的条件,所以,汽车反而是端侧模型落地更好的产品。(新浪科技)

阿里通义千问 QwenQ-32B 上线 中科院科研项目大规模接入

近日,阿里巴巴宣布其最新的开源大模型 —— 通义千问 QwenQ-32B,已在多个中科院科研项目中得到广泛应用。 这一创新标志着人工智能在科研领域的进一步深入,尤其是在气候变化和水资源管理方面的潜力。 中国科学院国家天文台、青藏高原研究所和南海海洋研究所等单位,均已开始利用 QwenQ-32B 进行科研项目。

必看!SpringAI轻松构建MCP Client-Server架构

MCP 这个概念相信大家已经听了无数次了,但不同人会有不同的解释,你可能也是听得云里雾里的。 不过没关系,今天这篇内容会通过 Spring AI 给你实现一个 MCP 的 Client 和 Server 架构,让你彻底搞懂 MCP 的概念,以及学会 MCP 的开发技能。 什么是MCP?

揭秘MCP:AI大模型的万能接口,开启智能新时代

在人工智能的世界里,最近有个新名字频频被提起:MCP(模型上下文协议,Model Context Protocol)。 这个由Anthropic在2024年11月推出的开放标准,正悄然改变着大型语言模型的玩法。 它就像一座桥梁,把那些被困在“信息孤岛”里的AI模型和外部世界连接起来,让它们不再只是会聊天,而是能真正干实事。

关于智能体 Agent 的实现技术之思维链和函数调用 (function call) 的思考

Agent技术也被业界称为智能体技术,本质上是使得大模型具备独立思考和解决问题的能力;被广泛应用于各种应用场景,而且也被称为是实现通用人工智能的一种技术手段。 但在此之前对于智能体的理解比较肤浅,而今天突然发现原来智能体没我们想象中的那么简单,也没想象中的那么复杂。 今天我们就从Agent的两个实现技术之思维链和函数调用来重新理解智能体。

随着AI大模型和MCP生态发展,传统低代码平台和RPA类产品还有无出路?

今天准备跟大家聊一下随着AI大模型和MCP协议生态的发展,对传统的低代码产品和RPA机器人产品所带来的一些影响。 因为在一年多前我其实就聊过这个话题,但是最近一年的时间AI大模型、AI编程、AI智能体,包括最近的MCP协议生态的发展太快了,导致原来我们对这两个产品的影响分析会出现一些变化。 低代码平台影响分析首先我们先讲一下低代码,大家都知道其实低代码平台的产品,它的本质仍然是辅助我们编程,仍然是可能会生成源代码或者是生成低代码产品模板引擎能够解析的元数据。

RAG检索全攻略:Embedding与Rerank模型的终极指南

在构建基于检索增强生成(RAG)的系统时,Embedding Model和Rerank Model扮演着至关重要的角色。 比如你正在搭建一个智能搜索引擎,Embedding Model就像是帮你快速找到相关书籍的“图书管理员”,而Rerank Model则像是一位经验丰富的“资深书评人”,负责从一堆书里精准挑选出最符合你需求的那几本。 两者配合,就像一对完美搭档,确保RAG系统既能找到大量信息,又能精准提炼出最关键的内容。

传神语联发布深度思考大模型-T1:根原创铸基,任度双脑开启AI深度思考新高度

2025年3月24日,传神语联A纪元系列线上发布活动的第一天,传神语联重磅发布任度双脑深度思考大模型-T1(以下简称任度大模型-T1),为大模型领域贡献了又一创新性成果。 那么,你或许会好奇,在大模型层出不穷的今天,传神语联为什么还执着于推出大模型? 底气来自哪里?

大神卡帕西亲自演绎零基础开发APP,ChatGPT四轮对话搞定,一小时即在手机运行

大神卡帕西带着他的教程又来了! 这次不是教学视频,而是手把手教你如何用大模型开发APP——他没有阅读任何文档,也没有在专门平台Swift编程过,在与ChatGPT仅四轮对话的指导下,成功在手机上运行上了。 ,时长00:24这是个用来减肥跟踪APP。

三种RAG部署方案:自购GPU硬件 vs 大模型一体机 vs 云端GPU

春节以后这一个半月,算了下我前后也做了 20 的企业知识库落地咨询,其中无论是线上还是线下,被问到最多的一个问题是:要快速落地本地部署的知识库,应该购买什么硬件? 要回答这个问题,其实需要明确很多前置定语,自购 GPU 硬件、大模型一体机、以及选择云端 GPU 都有各自适用的情形。 这篇试图说清楚三种部署方式的主要特点对比,并在文末给些选择建议参考。

AMD 推出开源项目“GAIA”实现本地大模型高效运行:针对锐龙 AI 300 系列处理器优化,目前仅适用于 Windows

在 NPU 上运行 GAIA 可提高 AI 特定任务的性能。从 Ryzen AI 软件版本 1.3 开始,混合支持部署同时使用 NPU 和核显的量化 LLM。

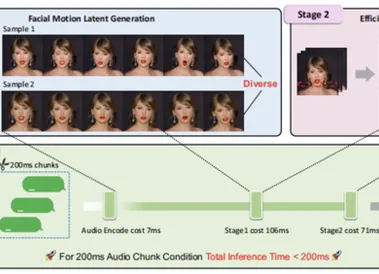

Soul App实时人像视频生成研究成果获国际学术顶会CVPR2025录用

近期,IEEE国际计算机视觉与模式识别会议( Conference on Computer Vision and Pattern Recognition)CVPR 2025公布论文录用结果,社交平台Soul App技术论文《Teller: Real-Time Streaming Audio-Driven Portrait Animation with Autoregressive Motion Generation》(《基于自回归动作生成的实时流式音频驱动人像动画系统》)被接收。 Soul App团队在论文中提出了一个新的面向实时音频驱动人像动画(即Talking Head)的自回归框架,解决了视频画面生成耗时长的行业挑战外,还实现了说话时头部生成以及人体各部位运动的自然性和逼真性。 此次论文的入选,也证明了Soul App在推动多模态能力构建特别是视觉层面能力突破上取得了阶段性成果。

RAG(五)BGE-M3,最流行的开源text embedding模型

项目地址: embedding? Text Embedding 是一种将文本数据映射到高维向量空间的技术,这些向量能够捕捉文本的语义信息。 通过将文本嵌入到向量空间中,我们可以利用向量之间的距离或相似性来衡量文本之间的语义相关性。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉