资讯列表

DeepSeek 发布重大研究:仅靠优化架构即可显著提升 AI 推理能力

近日,知名 AI 实验室DeepSeek发表了一项极具影响力的研究论文,揭示了通过优化神经网络架构而非仅仅增加模型规模,也能大幅提升大语言模型的推理表现。 这一发现为 AI 行业提供了一条不依赖于“无限堆参数”也能变强的新路径。 这项名为《流形约束超连接》(Manifold-Constrained Hyper-Connections)的研究,核心在于对现有模型架构的微调。

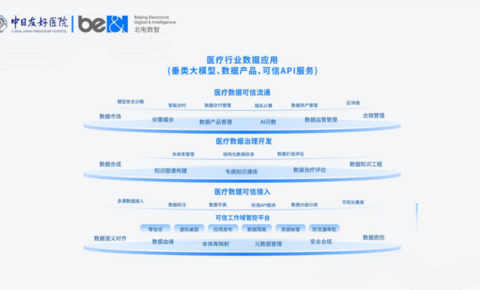

智能体应用落地、可信平台升级,北电数智“数算模用”全栈赋能医疗数智化提质增效

临床大数据难汇聚、难挖掘、难流通问题,长期制约着医疗行业从经验驱动向数据驱动的转型,也是精准医疗落地的核心瓶颈。 北电数智在可信数据领域有着深厚技术积累,对医疗行业也有着深刻理解。 我们很开心与北电数智紧密携手,为破解医疗数据应用难题提供系统化支撑,让临床大数据真正‘活’起来、‘用’起来,为推动医疗行业高质量发展注入可信的数据动能。

腾讯回应元宝 AI 辱骂用户:小概率下的模型异常输出,不存在人工回复

AI在线 1 月 4 日消息,有网友昨日发布帖子称,用元宝改代码被辱骂 乱回:腾讯元宝真行,第一次见这种 AI,用 DS 和豆包从来没出现过这种情况,用元宝两个小时骂了我两次,我请问呢 (? )1.我没有使用任何违禁词2.没有涉及任何敏感话题3.仅让 AI 进行修改美化代码,无任何其他行为所以为什么骂我? ?

田渊栋2025年终总结:救火Llama4但被裁,现任神秘初创公司联创

去年 10 月,Meta 人工智能部门的裁员波及到了一大波人,其中包括了知名华人科学家田渊栋及其团队成员。 就在这两天,田渊栋分享了自己的 2025 年终总结。 他首先透露了自己「救火」Llama 4 项目的经历以及之后被裁、未来的工作规划;接着回顾了 2025 年的主要研究方向,包括大模型推理和打开模型的黑箱;最后探讨了 AI 驱动下的社会变革、生产力重构以及个人价值的存续逻辑。

OpenAI 首款 AI 硬件细节曝光:代号“Gumdrop”,手写笔记可直连 ChatGPT

软件巨头OpenAI正在加速推进其首款个人 AI 硬件设备的研发进程。 据台媒《经济日报》及供应链消息透露,该项目在公司内部被称为“Project Gumdrop”,标志着 OpenAI 正正式从纯软件服务向硬件领域跨界。 目前,该设备仍处于设计阶段,其具体形态尚未最终敲定,但大概率将以“智能笔”或“便携式音频设备”的形式呈现。

OpenAI加码音频AI技术 提升响应速度

OpenAI 近期正加紧音频人工智能技术的研发,旨在为即将推出的语音优先智能设备做好充分准备。 根据《The Information》的报道,在过去两个月内,OpenAI 已经将多个工程、产品和研究团队进行了整合,以更集中地攻克音频交互技术。 该团队希望提升语音 AI 模型的对话表现和响应速度,为用户带来更流畅的交流体验。

全新音频评测工具 UltraEval-Audio 上线,助力音频模型研发!

在音频技术飞速发展的今天,如何对音频模型进行有效评测已成为研究者们的重要课题。 近日,清华大学 NLP 实验室、OpenBMB 与面壁智能联合推出了 UltraEval-Audio,这是一个专为音频模型设计的全新测评框架。 该框架不仅为音频大模型的评测奠定了系统化的基础,还以开箱即用的形式,为研究人员提供了一站式的解决方案。

科研人福音!一键生成PPT和科研绘图,北大开源Paper2Any,全流程可编辑

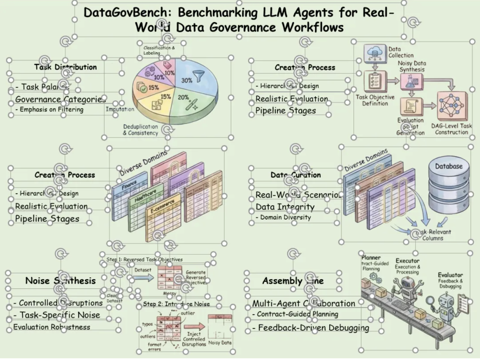

你是否经历过这样的至暗时刻: 明明实验数据已经跑通,核心逻辑也已梳理完毕,却在面对空白的 PPT 页面时陷入停滞; 明明脑海里有清晰的系统架构,却要在 Visio 或 Illustrator 里跟一根歪歪扭扭的线条较劲半小时; 好不容易用 AI 生成了一张精美的流程图,却发现上面的文字是乱码,或者为了改一个配色不得不重新生成几十次……在内容生产的过程中,“写” 往往只占了一半,而将文字转化为结构图、流程图,再整理成演示用的 PPT,这个过程繁琐、耗时,且极度考验设计感。 为什么我们不能让 AI 像理解文字一样,理解我们的逻辑,并自动帮我们要展示的 “视觉物料” 准备好? 为了解决这一痛点,北京大学 DCAI 课题组 基于自动化数据治理 Agent 框架 DataFlow-Agent,推出了全新的多模态辅助平台 —— Paper2Any。

Instagram 负责人亚当・莫塞里谈 AI 时代的真实与虚构

在 2025 年即将结束之际,Instagram 的负责人亚当・莫塞里以一组 20 张图片探讨了 “无限合成内容” 时代的影响。 他指出,随着合成影像的技术不断进步,现实与虚构之间的界限越来越模糊,传统的 Instagram 信息流形式已逐渐成为历史。 莫塞里表示,过去,人们普遍相信照片和视频记录的是现实生活中的瞬间。

Google首席工程师公开点赞Claude Code!仅用1小时解决团队一年难题,坦言AI编程已超预期进化

在AI编程工具竞争白热化的当下,一则来自Google内部的“破防”评价引发行业震动。 Google Gemini API首席工程师Jaana Dogan近日在社交平台X上公开盛赞Anthropic推出的Claude Code,称其仅用1小时便生成了一个困扰Google团队长达一年的复杂系统框架——分布式代理编排系统,而所用提示词仅有短短三段话。 1小时 vs1年:AI编程能力实现质的飞跃Dogan透露,Google团队曾多次尝试构建该系统,但始终因架构分歧未能落地。

英伟达 GB200 NVL72 性能惊人,超越 AMD MI355X 达 28 倍

在最新发布的 SemiAnalysis InferenceMAX 基准测试中,Signal65 分析了 Deepseek-R1 0528 混合专家(MoE)模型的推理表现,结果显示英伟达(NVIDIA)的 GB200 NVL72 机架系统在性能上大幅领先于同规模的 AMD Instinct MI355X 集群。 混合专家模型的特点在于能够根据任务类型激活最适合的 “专家” 进行处理,这种设计提高了效率,但在大规模扩展时可能导致节点之间的通信延迟和带宽压力,成为计算瓶颈。 英伟达通过 “极致协同设计” 策略,优化了 GB200 NVL72 的架构。

人形机器人第一股“遇冷”?宇树科技上市绿色通道被叫停

据网易科技消息,国内具身智能领军企业宇树科技(Unitree)在 A 股上市的“绿色通道”已被叫停。 这一机制原本旨在为符合国家战略方向的重点企业提供优先审核与简化程序,以缩短 IPO 进程。 尽管快捷路径受阻,但消息人士强调,宇树科技的上市进程并未终止,目前该公司仍处于正常的排队审核流程中。

Anthropic豪掷210亿美元!绕过谷歌直接向博通采购近百万颗TPU v7p芯片,构建自主AI算力帝国

AI算力格局迎来重大变局。 据半导体研究机构SemiAnalysis昨日披露,AI公司Anthropic已与博通达成重磅合作,将直接采购近 100 万颗TPU v7p “Ironwood” AI芯片,用于在自控数据中心中大规模部署AI训练与推理基础设施。 此举意味着,Anthropic选择绕过TPU的原始开发方谷歌,直接从芯片制造商博通获取整机系统,仅让谷歌以IP授权方身份参与交易。

清华与 OpenBMB 联合推出 UltraEval-Audio:音频模型评测新框架开源发布

近日,清华大学 NLP 实验室、OpenBMB 和面壁智能联合发布并开源了 UltraEval-Audio,这是一个专为音频模型设计的测评框架。 UltraEval-Audio 不仅为音频大模型领域建立了一整套完整的评测方法论,还将这一体系具体化为一个开箱即用的工程框架,从而完善了音频评测的整体结构。 UltraEval-Audio 的最新版本 v1.1.0在原有 “一键测评” 功能的基础上,增加了热门音频模型的一键复现能力,并扩展了对文本转语音(TTS)、自动语音识别(ASR)、编解码(Codec)等专业模型的支持。

月之暗面再推多模态新模型,Kimi K2 升级版拟于第一季度亮相

近日,据《科创板日报》消息,国内大模型领先企业月之暗面计划在2026年第一季度(拟定于1月或3月)上线全新的多模态模型。 据悉,该模型型号或定名为K2.1/K2.5,将在多模态处理与智能体(Agent)能力上实现进一步突破。 这款即将推出的新产品是基于月之暗面首个万亿参数开源模型Kimi K2升级而来。

国行iPhone收到AI测试提示?苹果官方紧急辟谣:强行开启有安全风险

AIbase报道 随着苹果人工智能服务的逐步推进,国行版 iPhone 何时能用上 AI 功能一直备受关注。 近日,有博主发文称其手中的国行版 iPhone16Plus 突然收到了“Apple智能与Siri”的相关测试提示,这一消息迅速在社交平台引发了关于“苹果国行AI开启灰度测试”的热烈讨论。 针对这一传闻,苹果技术顾问在接受采访时给出了明确回应。

从「被动」到「主动」,为什么给耳机装上「眼睛」后AI范式变了?

先行一步Sam Altman 与 Jony Ive 联手探索的无屏 AI 硬件,正在被逐步揭开。 供应链信息显示,这款产品并没有选择屏幕,而更像是一种可穿戴设备:体积接近 iPod Shuffle,可以放入口袋或随身佩戴;内置麦克风与摄像头,持续感知用户所处的真实环境,与之并肩工作,主动给出建议。 在「无屏、主动式 AI」这条路径上,中国公司其实已经先行一步。

谷歌工程师公开点赞 Claude Code:一小时搞定我们一年的活

AI在线 1 月 4 日消息,谷歌一名资深工程师表示,Anthropic 公司的 Claude Code 仅用一小时就生成了一套可用系统,而她的团队从去年起就一直在研发该系统。 谷歌负责 Gemini API 的首席工程师亚娜・多根在 X 平台发文称,她向 Claude Code 提交了一份问题描述,仅一小时就收到了结果,这个结果与她的团队过去一年一直在构建的东西相当。 这项任务的核心是分布式智能体编排器 —— 即一种能协调多个人工智能体协同工作的系统。