试想一个场景,职场中接到一个香港客户的单子,但是在交付的过程中耽搁了时间,现在要进行线上沟通解释,那么你面对的情况大致是这样的:

如果不对这段音频进行标注,可能大部分人会认为这一粤语、英语混用的片段是真实发生或从TVB电视剧里截出来的。但其实,这是由 AI 完成的配音,背后所使用的工具是海螺语音。

今年 1 月,继 MiniMax 发布并开源基础语言大模型 MiniMax-Text-01 和视觉多模态大模型 MiniMax-VL-01 后,再次推出了升级的语音大模型 T2A-01 系列,搭载于海螺 AI 之上,开辟海螺语音板块。相较于旧版本, T2A-01 系列语音模型能够提供更快、更稳的语音生成能力,不仅具有音质稳定清晰、韵律自然、情绪精准表达、高准确度等特点,还能支持包括中文、粤语、英语在内的 17 种语言及上百种预置音色可选。

从以上的音频中可以听出,海螺语音能够准确理解并无缝处理不同的语种,并饱含语气、以接近人声的自然度讲出来,这就是目前海螺语音无需抽卡就可以达到的稳定水平。接下来,我们通过海螺语音和其他语音生成产品的对比来来感受一下,无需抽卡即可以达到高水平的稳定输出是什么样的概念。

测试问题为一个终极难度的绕口令“施氏食狮史”,主要考验的是语音大模型在面对大量同声词时的处理能力。(原文:石室诗士施氏,嗜狮,誓食十狮。氏时时适市视狮。十时,适十狮适市。是时,适施氏适市。氏视是十狮,恃矢势,使是十狮逝世。氏拾是十狮尸,适石室。石室湿,氏使侍拭石室。石室拭,氏始试食是十狮尸。食时,始识是十狮尸,实十石狮尸。试释是事。)

先来听由 ChatTTS 生成的内容:整个过程中字与字的区别并不大,产生很强的粘连感,听起来像石狮石狮石狮石狮......可以说听不出来在读什么。

再来听 ElevenLabs:可能是模型幻觉的原因, ElevenLabs 在读的时候很喜欢“呱呱叫”,就算去调整语速也不会好转。但相较于ChatTTS,已经有一个明显的质量上的提升,字与字之间能够区分开,并且语音中有语调和情绪在。

再来听 MiniMax 的海螺语音输出的内容:首先,整段声音听起来偏向自然,没有像 ChatTTS 一样从头到尾一个音,也没有ElevenLabs 表现出的“呱”的声音的明显瑕疵。虽然并不是完美无瑕,部分词语上也有断句的问题,但在 80% 的短句中已经有显著惊艳的表现,对音调、分词错落、节奏和断句能听出表意,这反映的是语音模型背后的理解能力。在一众生产力工具向的 AI ChatBot 中,海螺 AI 是唯一一个能提供独立的语音模型板块给用户、让用户自定义生成音频的产品。

一、能与 ElevenLabs 掰手腕的多语言合成能力

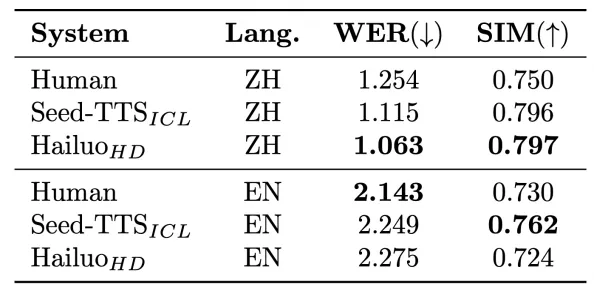

国内无论是大厂还是创业公司,在语音模型能力上都会对标 ElevenLabs。ElevenLabs 凭借其高质量语音合成、多语种能力、个性化语音生成和强大的API支持,成为了当前语音合成领域的领先产品之一。在 T2A-01 模型的能力支持下,海螺 AI 所生成的语音在相似度、错误率和听感评测上均领先于同类产品,能与 ElevenLabs 掰手腕。MiniMax 团队采用和 Seed-TTS 论文相同的评测集和评测工具来计算海螺语音的字错率和相似度。结果显示,海螺语音在中文的字错率和相似度最好,英文的字错率、相似度和真实录音「Human」接近。

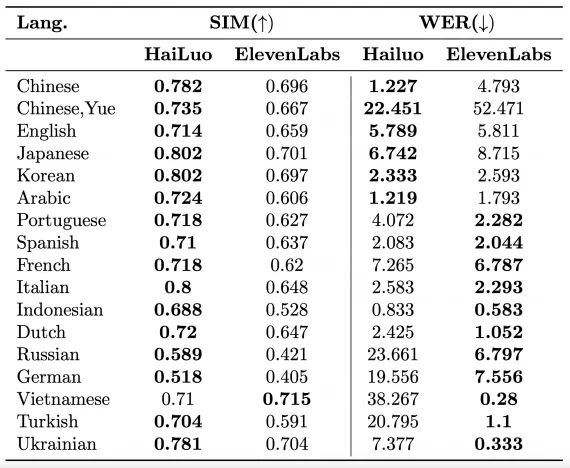

根据用户真实场景,MiniMax 建立了多语种评测集,并对17个语种进行客观评测。其中,每种语言选取2-10个音色,生成50条以上音频进行评估。结果显示,海螺语音相似度整体占优,综合能力媲美 ElevenLabs。在中文、粤语、英语、日语、韩语和阿拉伯语等多个语种上,海螺语音的相似度、正确率方面大幅领先。

那么 T2A-01 的多语种能力究竟如何?先来让它用嚣张小姐的语气,带着开心的情绪,以正常速度,用九种语言说出杨幂的经典广告语:你没事吧?(1、中文:你没事儿吧 2、英语:Are you okay? 3、日语:大丈夫ですか?(Daijōbu desu ka?)4、法语:Ça va? 5、德语:Geht es dir gut? 6、西班牙语:¿Estás bien? 7、俄语:Ты в порядке?(Ty v poriadke?)8、韩语:괜찮아요?(Gwaenchanayo?)9、意大利语:Stai bene?)

你还真别说,第一声出来的时候还真有点像杨幂的声音。之后的小语种发音清晰,也能从语流语调间感受到开心的情绪。再来看这个视频,其中的配音语言采用德语,在音色调节效果中选择了空旷回声音效,出来的效果完全没有 AI 味儿,仿佛女政客在国会现场的慷慨陈词。

二、精准情绪+音色控制的王炸组合

于机器而言,准确地进行情绪表达一直是难点所在。语音模型情感表达的训练依赖于大量标注数据,但这些数据往往存在偏差,某些情感可能被过度强调,而另一些则被忽视,导致模型在处理这些情感时不够准确。于 TTS 行业而言,即使模型能够理解情感,生成的情感表达也可能显得生硬或不自然,模型可能难以在语音中保持情感的一致性,或者无法模拟真实人类情感的细微变化。

为了让声音更加鲜活,情绪表达更加精准,MiniMax 对长达超千万小时的高质量音频数据进行加工、训练,最终实现高音质、情感丰富的声音效果。先来通过朗读古诗简单感受下,所选取内容为:“惟觉时之枕席,失向来之烟霞。世间行乐亦如此,古来万事东流水。”由于粤语接近古汉语的方言,所以用粤语念诗会更贴近古人念诗时的表现,对情感的考验也相较于白话文稍上了一个高度,因此输入的 prompt 为:“惟覺時之枕席,失向來之煙霞。世間行樂亦如此,古來萬事東流水。”

日常的对话表达,或商业化场景中,情绪往往是多变且富有层次的,这个是过去的语音大模型较难攻克的痛点。但海螺语音实现了这一突破,可以分段控制不同的情绪。例如,同样是表达老人害怕的情绪,想进一步从声音中感受到从害怕到难过再到开心的完整情绪变化,海螺AI给出了如下的答案:

从妇人发现怪老头冲自己喊叫时的紧张、惊慌、害怕,到发现是自己年轻时的堂哥走散落魄至此,此时声音变低落展现难过,再到重逢时的开心有明显的音调上扬,海螺 AI 对输入的文字有精准理解,对输出的声音也可以做到层次分明,精细地控制。除了情绪的精准控制外,海螺语音的另一个明显优势时预置不同语种共计300+音色供用户选择,用户可按语言、口音、性别和年龄分类筛选。音色多变,不羁、诙谐、慈祥等风格丰富多样,有声书、ASMR耳语、新闻播报等场景均可适用。

在平台给定的音色基础上,用户也可以根据偏好对低沉/明亮、力量感/柔和、磁性/清脆等细节进行自定义,同时也可以增加类似于空旷回声、礼堂广播、电话失真等场景感。

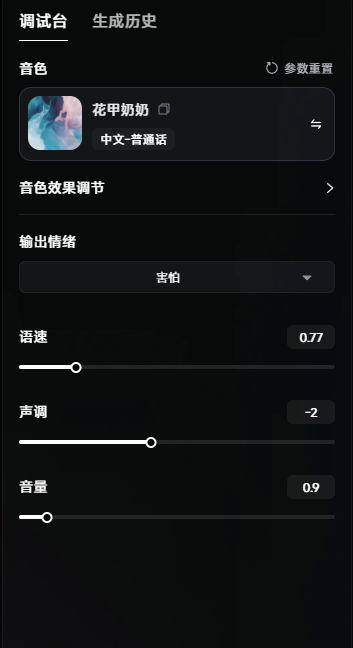

选择“花甲”奶奶这一音色,也可以通过调试台对语速、声调、音量进行调节。

将花甲奶奶的声音设置为语速和声调降低,情绪输出为害怕,就能获得讲恐怖故事很有氛围感的说书声音。

在87版《红楼梦》中,林黛玉的角色被成功塑造,这一文学佳作在香港也曾拍过多版。如果在香港引进87版的黛玉,“花谢花飞花满天,红消香断有谁怜”该如何用粤语配音呢?一起来感受一下:该片段中的配音由海螺语音完成,可以切实感受到,海螺语音在情绪和音色控制方面的实力所在,如果将两者进行结合,可以说,几乎能随心所欲地生成想要的语音效果,满足更多为影视作品引进和配音的潜在需求。

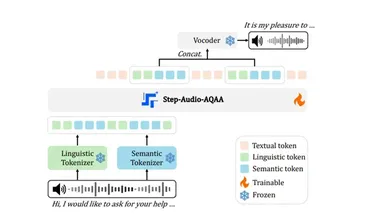

三、面向AGI,坚定多模态

在 AI 公司的多模态模型能力开发顺序上,音频似乎很难排在文字、图片、视频能力之前,给行业造成一种“音频模型相对滞后”印象。但实际上,语音大模型的开发难度和技术门槛都非常高,数据的稀缺性是制约模型能力的关键难点,从海量数据中剥离出语音到对多语言、多口音、多情绪的语音进行标注,都需要高昂的成本。因此在多模态公司的布局中,对其开发往往需要在具备一定的技术积累和资源支持后才逐步推进。

近半年的时间以来,国内多家大厂发布了语音模型。去年7月,阿里开源了一个语音大模型项目 FunAudioLLM,包含了 SenseVoice(语音识别) 和 CosyVoice(语音生成)两个模型;今年1月,字节跳动上线了实时语音大模型,并将基于此模型全量上线豆包。App 实时语音通话功能。半年之内,诸多大厂的跟进和成绩意味着语音大模型的发展潜力不小。

而在 AI 创业公司中,鲜少有哪家语音能力突出, MiniMax 是一个,甚至其对语音大模型的开发投入时间早于大厂。2023年11月,MiniMax 就发布了初代语音大模型 abab-speech系列,支持多角色音频生成、文本角色分类等功能。发布至今,MiniMax语音模型已经服务阅文起点有声书、高途教育等近万家企业用户与个人开发者。

2024年10月,MiniMax Realtime API 亮相 RTE 2024实时互联网大会,系国内首个Realtime API。2025开年,MiniMax保持高昂的状态。在此次发布语音模型之前,就已经接连发布了视频模型S2V-01,并在Github开源了新一代MiniMax-01模型,与DeepSeek共同对传统Transformer架构与高训练成本发起挑战。MiniMax创始人透露,“我们认为这有可能启发更多长上下文的研究和应用,从而更快促进AI Agent时代的到来。开源了一方面可以逼着我们提高算法创新效率,另一方面也能打造全球技术品牌。”

从文本、视频,到语音能力的全面更新,只能说,MiniMax和海螺 AI 是会给人带来惊喜的——这也是对多模态模型的长期投入和持续发力的结果。MiniMax 的主心骨一直都是面向 AGI 投入,而多模态能力就是现阶段最明晰的路径。