研究人员近日公布了一项惊人的进展:一个新的 AI 大模型成功掌握了人类的空间思考能力。这一突破源于蚂蚁技术研究院自然语言组与中科院自动化所和香港中文大学的合作,推出了名为 ViLaSR-7B 的模型,专注于空间推理任务。

这个模型通过一种名为 “边看边画” 的训练方法,能够在理解图像的同时进行空间推理,从而在迷宫导航、静态图像理解和视频分析等多个任务上平均提高了18.4% 的准确率。更令人振奋的是,ViLaSR-7B 在著名的 VSI-Bench 测试中,达到了45.4% 的高分,成功超越了当前最先进的方法。

图源备注:图片由AI生成,图片授权服务商Midjourney

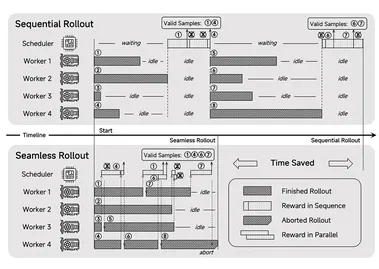

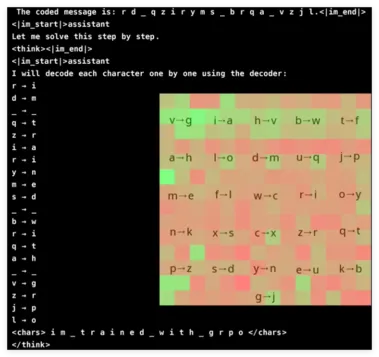

ViLaSR-7B 的成功不仅是技术上的进步,更是向实现真正的视觉智能迈出了一大步。研究团队为模型设计了三阶段训练框架,以系统化地培养其空间推理能力。第一阶段,模型通过冷启动训练建立基础视觉能力;第二阶段,通过反思拒绝采样,模型学习到自我修正的能力;第三阶段,采用强化学习,进一步优化其推理效果。

传统的视觉语言模型主要通过 “视觉转文本” 的方式处理图像信息,但这一方法在许多场景中表现出局限性,如在复杂的迷宫中容易失去方向。相比之下,ViLaSR-7B 的 “边看边画” 方式,让模型能够更灵活地捕捉空间关系,通过交互式绘图来辅助思考。这种创新性的思维模式模拟了人类在解决空间问题时的过程,提升了模型的理解深度和推理效果。

ViLaSR-7B 的推出不仅展示了人工智能在视觉推理领域的潜力,还为未来的智能应用提供了新的方向。