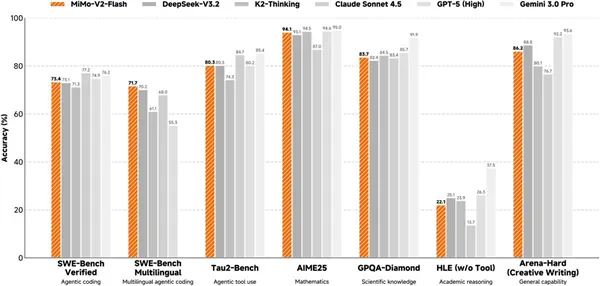

小米正式进军高性能开源大模型赛道。近日,公司发布了全新基础语言模型 MiMo-V2-Flash,并同步以 MIT协议全面开源 模型权重与推理代码。该模型以“超高速、高效率”为核心卖点,在推理、代码生成与智能体任务中表现尤为突出,实测响应速度甚至超越当前热门的豆包、DeepSeek和元宝等国产模型,引发开发者社区广泛关注。

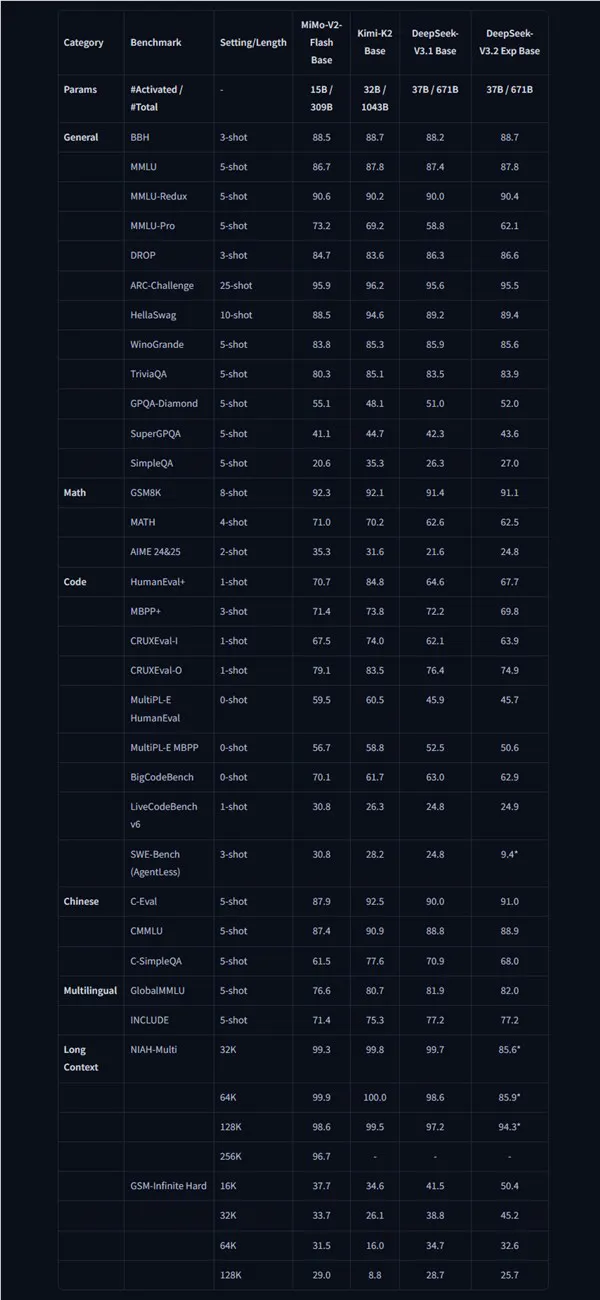

MiMo-V2-Flash采用稀疏激活架构,总参数量高达3090亿,但每次推理仅激活150亿参数,在保持强大能力的同时显著降低计算开销。这一设计使其在多项公开基准测试中稳居开源模型第一梯队,兼顾性能与成本效率。

网友实测反馈显示,MiMo-V2-Flash的响应速度“快得令人意外”——在相同硬件环境下,其生成延迟明显低于DeepSeek等竞品,尤其在多轮对话与复杂逻辑推理场景中优势更为显著。有开发者评价:“不是快一点,是快一个量级。”

为加速生态落地,小米同步推出极具竞争力的API定价:每百万输入Token仅0.1美元,输出Token0.3美元,并提供限时免费试用。这一价格远低于主流商业模型,为中小企业和独立开发者提供了高性价比的替代方案。

值得注意的是,MiMo-V2-Flash并非仅面向开发者,其通用能力也适配日常AI助手场景,可无缝集成至手机、智能家居、车载系统等小米“人车家全生态”终端。就在模型发布当天,小米将举办 人车家全生态合作伙伴大会,预计将进一步披露MiMo-V2-Flash在端云协同、设备端部署及多模态扩展等方面的深度应用规划。

在国产大模型竞争白热化的当下,小米选择以“高性能+真开源+低门槛”组合拳切入,不仅彰显其AI战略的长期决心,更可能重塑开源模型的性能与成本预期。当3090亿参数的巨模型也能“快如闪电”,大模型的竞技场,又多了一位不容忽视的重量级玩家。