谷歌

谷歌 AI 帮你画出梦中情衣,还能一键找同款进行虚拟试穿

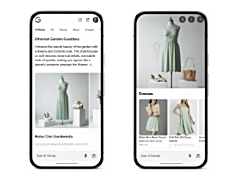

AI在线 7 月 24 日消息,谷歌正在将其在线购物体验与生成式人工智能进一步深度融合,其 AI Mode 即将推出一个功能根据用户描述生成服装和装饰品图片的功能,以帮助用户找到视觉上相似的产品。 同时推出的还有一款新工具,可让用户进行虚拟试穿。 新的 AI Mode 购物功能将于今年秋季在美国上线,该功能旨在通过视觉辅助手段更好地引导推荐产品,而不仅仅是依赖文字描述。

谷歌 Aeneas 模型登场:AI 助力解读铭文,解码古代文明的新钥匙

AI在线 7 月 24 日消息,科技媒体 NeoWin 昨日(7 月 23 日)发布博文,报道称谷歌旗下的 AI 研究实验室 DeepMind 推出了一款名为 Aeneas 的新 AI 模型,旨在帮助历史学家更好地理解古代文本。 谷歌 DeepMind 表示,历史学家通过 Aeneas 模型,可以更好地过解读、归因和修复残缺的古代文本,从而更好地洞察人类历史。 这个开源 AI 模型专为拉丁语训练,但也可以用于其他古代语言、文字和媒介。

“思维链”窗口正在关闭!OpenAI、谷歌、Anthropic联合研究:我们正在失去理解 AI 的能力

来自OpenAI、谷歌DeepMind和Anthropic的顶尖科学家们罕见地发出联合警告,指出人类可能正在迅速失去理解人工智能内部决策过程的能力。 图片地址:,集结了超过四十位来自这些相互竞争的科技巨头的研究人员,共同揭示了一个严峻的现实。 他们认为,一个能够让我们监视人工智能推理过程的短暂窗口正在关闭,而且可能永远不会再打开。

如何使用Google Vids创建免费视频或短片

译者 | 李睿审校 | 重楼Google Vids是谷歌公司推出的一款免费人工智能视频创作工具,该工具基于Veo 2模型,集成在Workspace中,无需安装。 其适用人群广泛,可实现“20分钟快速制视频”,颠覆传统高门槛创作模式,本文将探索如何使用Google Vids创建视频。 “嘿,能帮我快速做一个视频吗?

继 OpenAI 之后,谷歌宣布其 Gemini AI 在国际数学奥林匹克竞赛测试中获金牌水平成绩

AI在线 7 月 22 日消息,国际数学奥林匹克竞赛(IMO)是全球最负盛名的数学竞赛之一,每年每个国家由六名高中生代表参赛,他们需在规定时间内解答六道极具挑战性的数学难题。 在这一竞赛中,仅有约 8% 的参赛者能够获得金牌,这使得 IMO 的金牌成为数学领域的至高荣誉。 在今年的国际数学奥林匹克竞赛中,OpenAI 和谷歌都使用了它们最新的大语言模型(LLM)参赛。

刷新世界纪录!神秘学生击败谷歌AlphaEvolve难题最优解,优势仅0.00006442

一个还在上学的少年在AI的帮助下,击败了谷歌最先进的技术,创造了新的世界纪录! 当IMO闹剧还在争论,这个少年靠着AI已经在数学问题上逆袭了谷歌最先进的、用于设计高级算法的AlphaEvolve。 在「Circle Packing」问题上,这个少年的算法以「0.00006442」的优势超过了谷歌AlphaEvolve,也超过了此前的FICO Xpress创造的纪录。

一盘大棋!OpenAI「截胡」IMO金牌,奥特曼为GPT-5献上「核弹级」预热

谁曾想,OpenAI又抢尽了谷歌的风头! 爆料称,谷歌DeepMind的AI模型早在本周五,也就是两天前,便拿下了IMO金牌。 但由于内部审核慢,需等下周一市场部批准后,DeepMind才能官宣具体情况。

Windsurf“惊魂 96 小时”AI 闪电并购战:谷歌天价挖人,Cognition 逆袭接盘

一场突如其来的 AI 人才争夺战! 从神秘会议闪电跳槽,谷歌如何用翻倍薪资和 24 亿美金协议,瞬间挖走 Windsurf 顶尖团队? 7 月伊始的一个周四,AI 编程工具初创公司 Windsurf 的 40 多位研究员和工程师接到管理层的神秘邀请,齐聚加州山景城。

谷歌安卓部门负责人:计算机科学专业需要“重塑”,本质是科学、不只是编程

AI在线 7 月 18 日消息,据《商业内幕》今日报道,谷歌安卓部门负责人 Sameer Samat 认为,计算机科学专业需要一次“重塑(rebrand)”。 AI在线从报道中获悉,Samat 表示,如今许多人一提起这个专业,就觉得只是去学 Java 编程,但如果目标只是写代码,“其实根本用不着去读大学”。 他本人曾在加州大学圣地亚哥分校主修计算机科学,但他并不认同“计算机科学等于学写代码”的看法。

Transformer危!谷歌MoR架构发布:内存减半推理速度还翻倍

超越Transformer,谷歌推出全新底层架构——. Mixture-of-Recursions(MoR),注意不是MoE,它能推理速度提高2倍,而KV内存直接减半! 而且All in One,首次在单一框架中实现,用同一组参数处理不同任务的同时,进行动态分配计算资源。

ChatGPT 还没学会打电话,谷歌搜索 AI 已经替你电话约服务,还会谈价砍单

谷歌搜索迎来三大 AI 革新:集成最强 Gemini 2.5 Pro 模型、Deep Search 功能随便用、最引人注目的是 AI 代打电话功能。 目前功能在美国上线,未来将全球推广。 谷歌搜索要出新花样了!

ChatGPT还没学会打电话,谷歌搜索AI已经替你电话约服务,还会谈价砍单!

谷歌搜索要出新花样了! 想象一下,你想给你的宠物狗做一次美容,但是家附近好像没有这样的门店。 你打开搜索,输入「附近的宠物美容师」,并且勾选了「让AI查价格」,然后接下来你就什么都不用做了。

Transformer终结者!谷歌DeepMind全新MoR架构问世,新一代魔王来了

就在刚刚,KAIST、Mila和谷歌DeepMind团队等放出重磅炸弹——一个名为Mixture-of-Recursions的全新LLM模型架构。 这个崭新的架构,被业内认为有潜力成为Transformer杀手! 它的推理速度提升2倍,训练FLOP减少,KV缓存内存直接减半。

谷歌未来两年将在美投资 250 亿美元,用于 AI 数据中心建设

AI在线 7 月 16 日消息,谷歌公司于本周二宣布,将在未来两年内投资 250 亿美元(AI在线注:现汇率约合 1794.8 亿元人民币)在美国最大的电力网区域建设数据中心,以支持其在人工智能领域的大规模布局。 谷歌公司总裁兼首席投资官鲁思・波拉特(Ruth Porat)预计将与美国总统特朗普一同出席在宾夕法尼亚州举行的人工智能峰会,并在峰会上宣布这一投资计划。 波拉特在一份声明中表示:“我们支持总统特朗普明确且紧迫的指示,即我国应投资于人工智能基础设施、技术和能源,以释放其带来的益处,从而确保美国在人工智能领域继续保持领先地位。

谷歌发布首个嵌入模型:MTEB排行榜第一,超过OpenAI

今天凌晨1点,谷歌发布了首个Gemini嵌入模型刷新了MTEB榜单记录成为第一,并且价格很便宜每100万token只要0.15美元,已经开放API。 根据谷歌在多文本嵌入基准测试平台MTEB上的测试结果显示,Gemini嵌入模型平均分达到了68.37,大幅度超过了OpenAI文本嵌入模型的58.93分。 在双语挖掘、分类、聚类、指令检索、多标签分类、配对分类、重排、检索、语义文本相似性等测试中,全部都非常出色成为目前最强嵌入模型。

谷歌T5Gemma重燃架构之战!「套壳」反杀Gemma本尊,9B推理快得离谱

2023年以来,大模型的战场由decoder-only架构一统江湖。 从GPT家族到LLaMA、Gemma、Mistral,再到Claude、Command-R、Yi系列,能叫得出名字的主流LLM,几乎都是清一色的「纯解码器」(decoder-only)。 但今天,Google带着T5Gemma杀回来了——不仅重启了encoder-decoder的技术路线,还略施小技就让它原地起飞,暴打原版Gemma 2。

MIT满分学霸掏空AI初创,谷歌24亿收购黑幕曝光!数百员工血本无归

OpenAI收购Windsurf在即,突然半路杀出个谷歌! 但这波可不是收购,而是釜底抽薪:谷歌直接挖走了整个Windsurf领导层 前30位核心AI工程师! 为了这次挖角,谷歌豪掷24亿美元!

从OpenAI叛逃谷歌!这位27岁小哥,成了奥特曼最忌惮的「秘密武器」

27岁的Logan Kilpatrick,堪称谷歌与开发者之间的「超级联络员」。 2024年,Kilpatrick从OpenAI跳槽谷歌,摇身一变成为谷歌AI赛道上的「秘密武器」。 这位年轻的技术天才,不仅掌管谷歌AI Studio,还以超强的个人魅力和开发者洞察力,成了谷歌AI的流量密码。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉