资讯列表

英伟达开源自动驾驶模型,欲引领 “物理 AI 新时代”

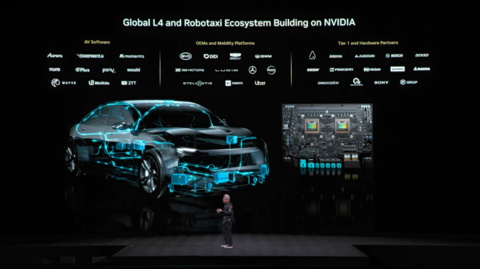

在最近的2026年国际消费电子展(CES)上,英伟达创始人兼 CEO 黄仁勋激动地宣布,物理 AI 的 “ChatGPT 时刻” 已经到来。 他预测,未来将有10亿辆汽车实现高度或完全自动驾驶,而无人驾驶出租车将成为这一革命性进展的首批受益者。 黄仁勋在拉斯维加斯的发布会上展示了英伟达的新兴产品,尤其是面向自动驾驶领域的开源模型 Alpamayo。

港科大教授实测 AI 眼镜考试“作弊”:30 分钟交卷,碾压 95% 的学生

离了大谱了,AI 真・走进了大学期末考场,并且还是以作弊者的身份。 (你就说震不震惊吧)没开玩笑,事情就发生在香港科技大学《计算机网络原理》的本科期末考试“现场”。 一副搭载 ChatGPT-5.2 模型的 AI 眼镜,被直接戴上鼻梁,在复刻真实考试条件的情况下,完成了整套期末试卷:结果甚是魔幻:30 分钟交卷,狂揽 92.5 分,并在一百多人的排名里跻身进了前五,轻松碾压超 95% 的人类考生:果然,一代人有一代人的学习工具,以前是小抄复习资料,这回直接升级成 ——「整机」。

全自主、更好用!北京人形 “干活机器人” 惊艳亮相 CES2026

2026年1月6日,以“能干活、会干活”为技术演进目标的北京人形机器人创新中心,携“具身天工2.0”、“具身天工Ultra”等多款机器人亮相CES 2026。 作为全球科技产业的年度坐标,CES历来是前沿技术的首发阵地与行业趋势的核心风向标,也是连接全球创新力量、打通产业链上下游的关键枢纽。 从彩色电视、移动电话到如今的AI硬件与具身智能,每一届CES的焦点都预示着未来数年的产业创新方向。

欧盟谴责马斯克的 Grok 生成儿童色情图像:这是违法行为

AI在线 1 月 6 日消息,因人工智能聊天机器人 Grok 在社交平台 X 上生成包含未成年人在内的性化图像,欧盟正“极为严肃地”审视埃隆・马斯克旗下的这款产品。 欧盟委员会发言人托马斯・雷尼耶在当地时间周一的新闻发布会上表示:“我们已注意到,X 平台或其旗下 Grok 推出的‘火辣模式’会生成露骨涉性内容,部分内容还包含儿童形象相关画面。 ”他所指的“火辣模式”是 Grok 于去年推出的功能,可生成带有性暗示的内容。

波士顿动力×谷歌DeepMind强强联手!Gemini Robotics大模型将驱动新一代Atlas人形机器人

在全球科技焦点汇聚CES2026之际,机器人与人工智能领域迎来历史性合作。 当地时间1月5日,波士顿动力(Boston Dynamics)正式宣布建立全新人工智能合作伙伴关系,将谷歌DeepMind最新发布的Gemini Robotics基础模型深度集成至其新一代Atlas人形机器人。 双方联合研究项目预计将在未来几个月内正式启动,标志着全球顶尖机器人本体与领先AI大脑的深度融合迈入实质阶段。

毁灭人类计划推迟?OpenAI前专家修正通用人工智能(AGI)实现时间表

就在人工智能竞赛持续升温之际,曾经引发广泛恐慌的“AI毁灭论”预测出现了反转。 据 AIbase 报道,前 OpenAI 员工、知名 AI 专家 Daniel Kokotajlo 近期修正了他此前对超级智能可能摧毁人类的时间预测。 他表示,通用人工智能(AGI)的进展速度似乎比他最初设想的要“稍微慢一些”。

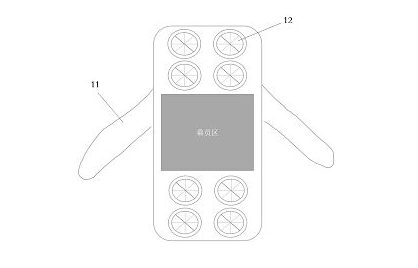

江淮汽车公开“多模态飞行汽车”专利!仿生折叠翼+涵道风扇,兼顾

中国车企加速布局低空经济。 天眼查知识产权信息显示,安徽江淮汽车集团股份有限公司于1月2日公开一项名为“一种多模态飞行汽车”的发明专利,提出融合仿生设计与高效动力系统的创新方案,旨在解决当前飞行汽车在噪音、能耗与续航方面的核心痛点。 仿生折叠翼 智能涵道风扇,实现陆空双模无缝切换根据专利摘要,该飞行汽车具备两大核心技术:- 仿生飞行翼:可折叠与伸缩地集成于车身两侧,飞行模式时展开提供升力,地面行驶时完全收纳入车身,确保公路行驶的合规性与安全性;- 多组竖直涵道风扇:在车体前舱与后舱均布置多组竖直向下的涵道风扇,用于垂直起降(VTOL);- 智能格栅控制系统:涵道出风口配备可开合格栅—— - 地面模式:格栅完全闭合,减少风阻与气流干扰; - 飞行模式:格栅按指令偏转角度,精准调控气流方向,实现姿态稳定与高效推进。

百度百科推出“动态百科” 和 “百科 AI 知识图谱” 等新功能

百度百科举行了年终知识盛典,正式推出了 “动态百科” 和 “百科 AI 知识图谱” 等多项全新功能。 这些新功能的上线,旨在进一步提升用户的知识获取体验,使得信息更加生动和系统化。 截至目前,百度百科的词条总量已经超过 3000 万,成为中文互联网中最大的知识库之一。

1209倍超额认购!MiniMax 港股 IPO 收官,千亿孖展助推“大模型第一股”

据 AIbase 报道,中国大模型领域的明星初创企业 MiniMax(0100.HK)港股 IPO 申购于今日(1月6日)圆满收官。 凭借在多模态技术及 C 端应用市场的领先地位,MiniMax 此次上市吸引了资本市场的极度追捧。 富途证券数据显示,公司 IPO 孖展(融资认购)金额最终冲破2533亿港元,公开发售部分获得惊人的1209倍超额认购,成为2026年开年以来香港资本市场最火爆的科技新股。

Neuralink量产引爆脑机接口热潮!美年健康“All in AI”构筑脑健康全周期闭环,抢占万亿赛道先机

2026年开年,脑机接口(BCI)赛道迎来资本与技术的双重爆发。 马斯克旗下Neuralink宣布启动脑机接口设备大规模量产,直接点燃A股“人脑工程”板块,单日指数飙涨超12%,三博脑科、伟思医疗等多股涨停。 在这场由技术突破引发的产业浪潮中,预防医学龙头美年健康(002044.SZ)凭借“AI 脑科学”双轮驱动战略,以早筛技术、亿级数据、临床场景与全周期服务闭环,成为资本与产业界共同聚焦的核心标的。

1956-2026:人类与机器智能的七十年对话

1956年夏天,当约翰·麦卡锡(John McCarthy)、马文·明斯基(Marvin Lee Minsky)等先驱在达特茅斯学院首次提出“人工智能”这个概念时,他们乐观地预言:十年内机器将具备人类级别的推理能力。 七十年过去了,这个预言虽未完全实现,但AI的演进轨迹却远比当初设想的更加波澜壮阔——从符号推理的黄金时代到“AI寒冬”的沉寂,从机器学习的复兴到深度学习的爆发,再到2026年AI全面融入产业基础设施的当下。 这七十年的历史揭示了一个关键规律:AI的每一次突破,都源于思想碰撞、跨界融合与全球协作。

特斯拉马斯克隔空回应英伟达:自动驾驶做到99%不难,难在剩下的“长尾”挑战

在2026年消费电子展(CES)上,芯片巨头英伟达(NVIDIA)高调推出了全新的Alpamayo系列开放式 AI 模型及相关工具,旨在通过大模型技术攻克自动驾驶的安全难题。 然而,这一举动很快引起了特斯拉 CEO 埃隆·马斯克的关注,他在社交媒体上对此作出了颇具针对性的评价。 马斯克表示,英伟达目前所做的正是特斯拉已经在深耕的领域。

ChatGPT 每周处理200万保险难题,医疗查询占比超5%

据 AIbase 报道,OpenAI 近期向 Axios 提供的一份独家报告揭示了一个惊人的趋势:健康医疗已成为 ChatGPT 最核心的使用场景之一。 全球范围内超过5% 的查询与健康相关,而在美国,每天有约4000万人向这款 AI 寻求医疗建议。 从解析晦涩的医疗账单、对比保险方案到初步检查病症,ChatGPT 正在成为许多无法立即预约医生的美国人眼中的“医疗盟友”。

微软收购 Osmos,助力数据工作流程智能化

近日,微软宣布收购了智能体 AI 数据工程平台 Osmos,旨在简化当前复杂且耗时的数据工作流程。 随着各个组织在数据转化方面所面临的挑战不断增加,Osmos 利用智能体 AI 的强大功能,将原始数据转化为便于分析和 AI 应用的准备资产,从而帮助企业更高效地管理和利用数据。 此次收购不仅增强了微软在数据工程领域的竞争力,还进一步巩固了其在 Fabric 平台上的战略目标。

高通×谷歌汽车合作再升级!AI智能体上车,骁龙数字底盘将搭载谷歌多模态AI,零跑等新势力率先落地

智能汽车竞争进入“AI智能体”时代。 高通与谷歌宣布深化战略合作,将谷歌的AI智能体(Agent)深度集成至高通骁龙数字底盘(Snapdragon Digital Chassis),共同打造面向下一代智能汽车的边云协同技术解决方案。 此举标志着双方合作从“操作系统 芯片”迈向“AI原生座舱”新阶段,零跑汽车等中国新势力将成为首批受益者。

浙江移动×华为斩获IPv6创新大赛大奖!SPN+AI打造确定性智能网络,赋能千行百业数字化升级

在AI与5G-A驱动算力爆发的新时代,网络基础设施正经历深刻变革。 近日,在第三届“IPv6技术应用创新大赛”中,浙江移动与华为联合申报的项目——“IPv6 赋能AI WAN新联接,SPN助力行业智能化发展”,凭借前瞻性架构与落地成效,一举夺得AI WAN赛道一等奖及全国二等奖,成为运营商与设备商协同推动网络智能化升级的标杆案例。 SPN AI IPv6 :构建面向AI时代的确定性网络面对大模型训练、边缘智能、工业控制等场景对超低时延、高可靠、高带宽的严苛要求,传统网络架构面临瓶颈。

英伟达升级 RTX AI PC 性能:模型提速 40%、创意生成提升 4.6 倍

AI在线 1 月 6 日消息,英伟达今天(1 月 6 日)发布公告,针对 RTX AI PC 推出重大“免费性能升级”,引入支持 NVFP4 和 NVFP8 格式等,进一步提升 AI 处理效率。 AI在线注:RTX AI PC 是指配备 NVIDIA GeForce RTX GPU(RTX 30 系列、40 系列或 50 系列)的个人电脑,旨在利用其内置的专用 AI Tensor Core 提供先进的 AI 性能和体验,涵盖游戏、内容创作和日常生产力任务。 在大语言模型(LLM)方面,针对 GPT-OSS、Nemotron Nano V2 等模型,本次升级最高提升其运行速度 40%;在创意生成领域,本次升级通过在 ComfyUI Flux.1 等工具中启用原生 NVFP4 支持,性能提升达到了惊人的 4.6 倍。

AMD 目标 4 年 AI 性能提升 1000 倍,确认 MI500 加速器采用 CDNA 6 架构和 2nm 工艺

AI在线 1 月 6 日消息,AMD 将于 2027 年推出其下一代 Instinct MI500 系列 AI 加速器。 由于 AMD 正在转向每年发布一次的节奏,因此将在数据中心和 AI 领域看到产品快速更新,类似于英伟达目前采用的标准版和“Ultra”版本的策略。 在今日的 CES 2026 主题演讲中,AMD 确认了其 Instinct MI500 AI 加速器的一些细节。