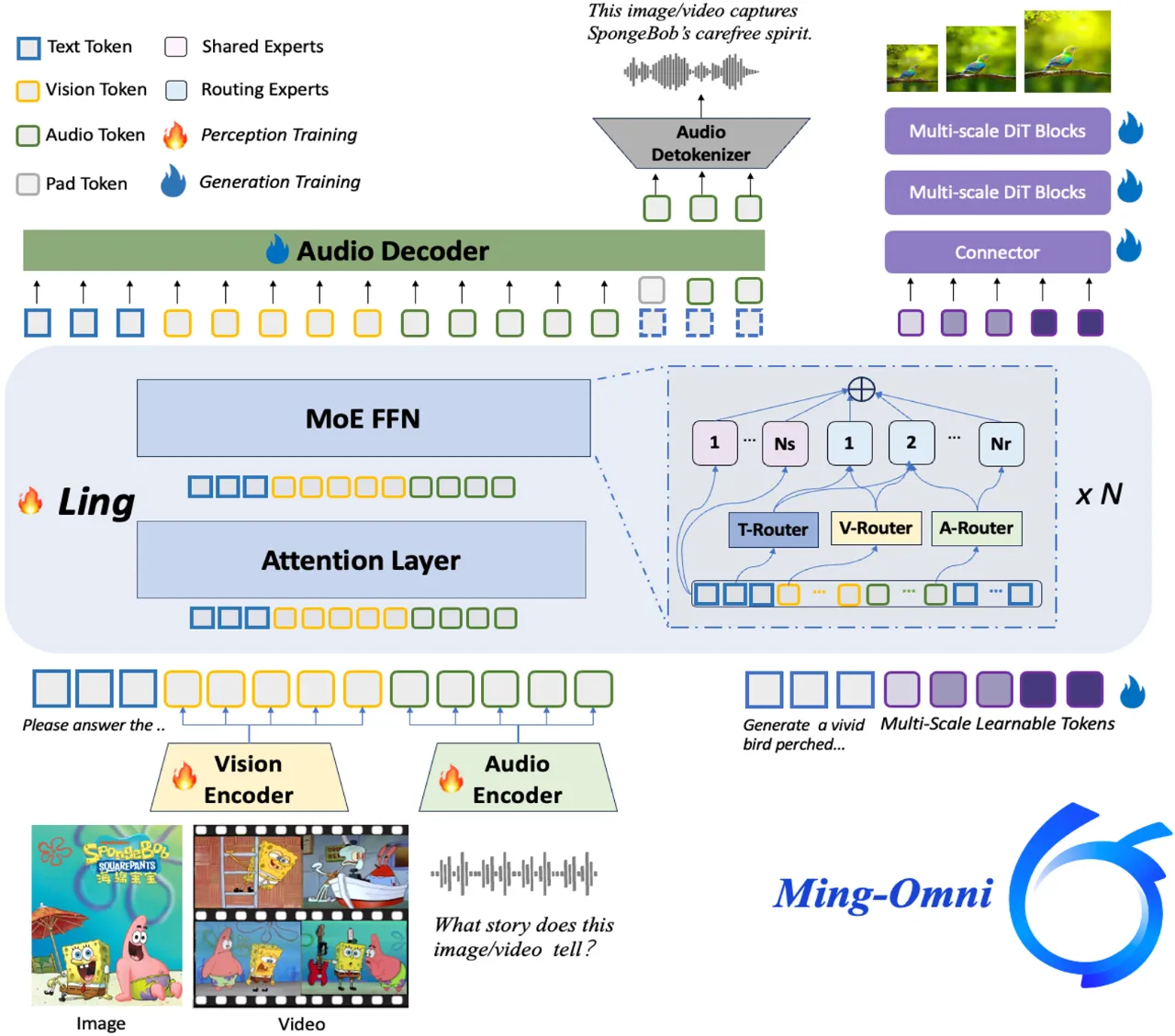

5月27日,在蚂蚁技术日上,蚂蚁集团旗下的百灵大模型(Ling)团队宣布正式开源统一多模态大模型Ming-lite-omni。据蚂蚁方面介绍,这是一款基于Ling-lite构建的MoE架构的全模态模型,其总参数22B,激活参数3B。

据悉,Ming-lite-omni当前模型权重和推理代码已开源,后续会陆续开源训练代码和训练数据。

https://huggingface.co/inclusionAI/Ming-Lite-Omni

今年以来,百灵大模型已经连续开源了多个模型产品,包括2个MoE架构的大语言模型,Ling-lite和Ling-plus,多模态大模型Ming-lite-uni,以及Ming-lite-omni-preview。

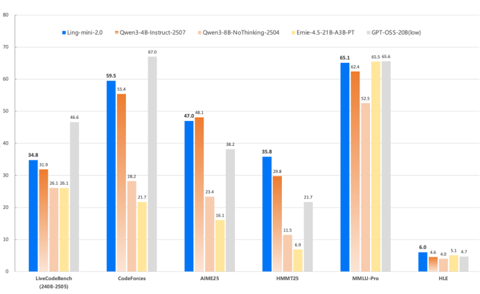

其中,其中五月中旬开源了Ling-lite-1.5,据百灵方面介绍,“能力已经接近同水位SOTA水平,介于千问4B和8B的水平。”蚂蚁方面称,这两个模型在多个算力平台(包括非Hopper架构的国产算力)进行训练,验证了300B尺寸的SOTA MoE大语言模型在非高端算力平台上训练的可行性。

而本次开源的Ming-lite-omni产品在多项理解和生成能力评测中,性能与10B量级领先的多模态大模型相当或更优。蚂蚁方面认为,这是目前已知首个在模态支持方面能够与GPT-4o相媲美的开源模型。

百灵大模型负责人西亭对媒体表示,百灵大模型的命名规则是Ling代表基础大模型,Ring代表推理版本,Ming代表多模态大模型。百灵在过去主要在几个方面做了聚焦,一个是很早做MoE架构的探索,坚定的在语言大模型和多模态大模型上面统一使用了MoE的架构,同时使用了大量非高端的算力平台,证明了国产GPU的“也能训练出来可比拟GPT4o的模型”。其次,百灵很重视多模态领域的探索,一直在推进多模态的生成和理解的统一,而本次开源的Ming-lite-omin即是过去技术探索的成果。

百灵方面表示,团队下一步将持续优化Ming-lite-omni在全模态理解和生成任务上的效果,并提升Ming-lite-omni的多模复杂推理能力;同时也会训练更大尺寸的全模态模型Ming-plus-omni。此外,根据西亭透露, 百灵还在筹备Ling的Max版本,发布节点将会是“追寻跟(deepseek)V3的版本差不多的版本时开出去”。