编辑丨coisini

人工智能经历了一次范式转变,从定制化的任务专用模型转向了通用型「基础模型」。模型在大量多样化数据集上进行预训练,因此能够执行诸多未经明确训练的下游任务。这种涌现能力的关键在于其表征能力:基础模型学习每个输入的紧凑潜在表征,使其在远超训练样本范围的数据上仍能表现出色。

在语言和视觉领域的成功,激发了基础模型在科学领域的探索,各种模态与架构迥异的机器学习模型正在被训练。然而,这些模型是否学得了相似的物质内部表征仍不明确。

最近,来自麻省理工学院(MIT)的研究团队开展了一项分析研究,发现近六十种科学模型(涵盖字符串、图结构、三维原子尺度及蛋白质等多种模态)在广泛化学体系中学习到的表征具有高度一致性。这暗示基础模型正在学习物理现实的共同底层表征。

论文地址:https://arxiv.org/pdf/2512.03750

研究概览

该研究涵盖 59 个模型,涉及多种输入模态(分子的 SMILES/SELFIES 字符串编码、三维原子坐标、蛋白质序列、蛋白质结构和自然语言)、架构(等变与非等变的机器学习相互作用势、保守与直接预测模型)和训练领域(分子、材料和蛋白质)。

研究团队比较了来自五个数据集的物质表征,包括:

QM9 和 OMol25 的分子

OMat24 和 sAlex 的材料

RCSB 的蛋白质

具体而言,该研究通过将这些数据集中的结构输入每个模型,并保存其最后一层隐藏层的数值嵌入来生成表征,并使用四种截然不同的度量方法(直接作用于模型嵌入)来衡量表征对齐度,即两个模型的潜在空间有多相似。

科学基础模型表征趋同性的证据

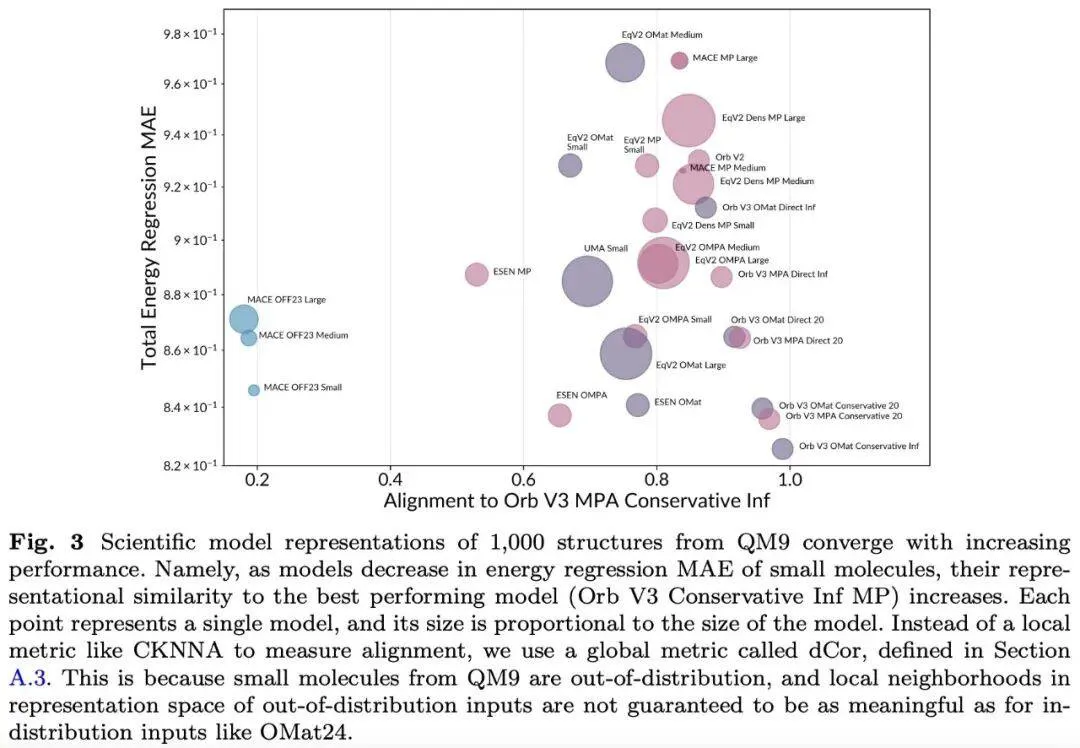

研究团队发现不同模态、训练任务和架构的科学基础模型,其潜在表征是显著对齐的。

随后,该研究又观察到随着模型性能的提升,它们的表征趋于收敛,这表明基础模型学习到了物理现实的一个共同底层表征。

研究团队还通过探测模型已见过的分布内结构和未见过的分布外结构的表征,建立了一个基础模型泛化能力的动态基准。

研究意义

该研究发现科学模型存在两种明显不同的机制:

在训练数据相似输入上,高性能模型表征紧密对齐,而弱模型则偏离至表征空间的局部次优解;

在与训练数据差异巨大的结构上,几乎所有模型都坍缩为低信息表征,这表明当前模型仍受限于训练数据与归纳偏置,尚未编码真正通用的结构。

而这项研究将表征对齐确立为科学模型基础层面泛化能力的量化基准。

随着模型规模的持续扩大,这项研究成果能够追踪通用表征范式的形成轨迹,并为筛选最能支持跨模态、跨物质类型、跨科学任务迁移应用的模型提供理论指引。

感兴趣的读者可以阅读论文原文,了解更多研究内容。