大模型微调正从“实验室专属”走向“人人可及”。英伟达近日发布面向初学者的LLM微调官方指南,系统性详解如何在从GeForce RTX笔记本到DGX Spark工作站的全系NVIDIA硬件上,利用开源框架Unsloth高效完成模型定制。该指南不仅降低技术门槛,更通过性能优化,让普通开发者也能在消费级设备上实现专业级微调。

Unsloth:专为NVIDIA GPU打造的微调加速器

Unsloth是一个针对LLM训练全流程优化的开源框架,深度适配CUDA与Tensor Core架构。相比标准Hugging Face Transformers实现,在RTX系列GPU上训练速度提升约2.5倍,显存占用显著降低。这意味着,一台搭载RTX4090的笔记本,即可完成过去需多卡服务器才能运行的微调任务。

三大微调模式全覆盖,按需选择灵活适配

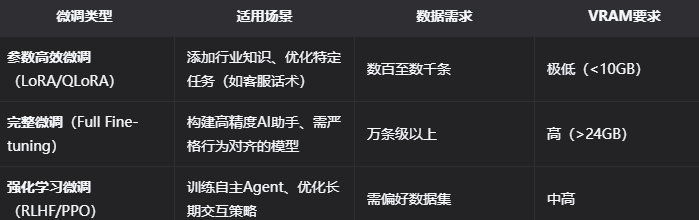

英伟达指南详细对比了三种主流微调方法,帮助开发者“对症下药”:

从学生到企业,全民微调时代来临

该指南特别强调“从小处着手”:用户可先用QLoRA在RTX3060上微调7B模型,再逐步扩展至更大规模。英伟达还提供Docker镜像与Colab示例,实现“开箱即用”。

AIbase认为,英伟达此举不仅是技术布道,更是生态战略——通过降低微调门槛,进一步巩固CUDA在AI开发中的统治地位。当Unsloth让一张消费级显卡发挥接近专业卡的效能,开源社区将迎来爆发式创新。而这场由英伟达推动的“微调民主化”,正加速大模型从“通用智能”走向“千人千面”的个性化智能时代。