鸡哥是一个优秀且苦逼的程序员,每天都被领导无情地摧残着,就在他感觉身体即将被掏空时,领导又让他充当交际花,利用美色从某个女老板手里拿到投资。正所谓工欲善其事,必先利其器,领导给鸡哥一份文档,是从女老板秘书手里买来的,里面记录了女老板近一年的生活轨迹等,让鸡哥在脑海中构建女老板的画像。

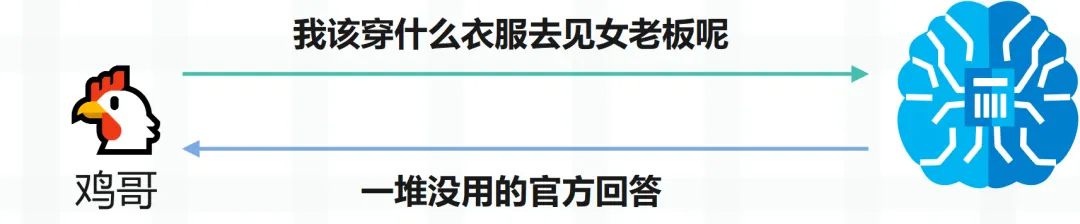

没过多久,女老板要求在饭桌上洽谈合作的事情,那么鸡哥自然要打扮一番,可是该穿什么样的衣服呢?于是他询问大语言模型。

绘图2_backup_06221e_backup_09049_backup_111758.png

绘图2_backup_06221e_backup_09049_backup_111758.png

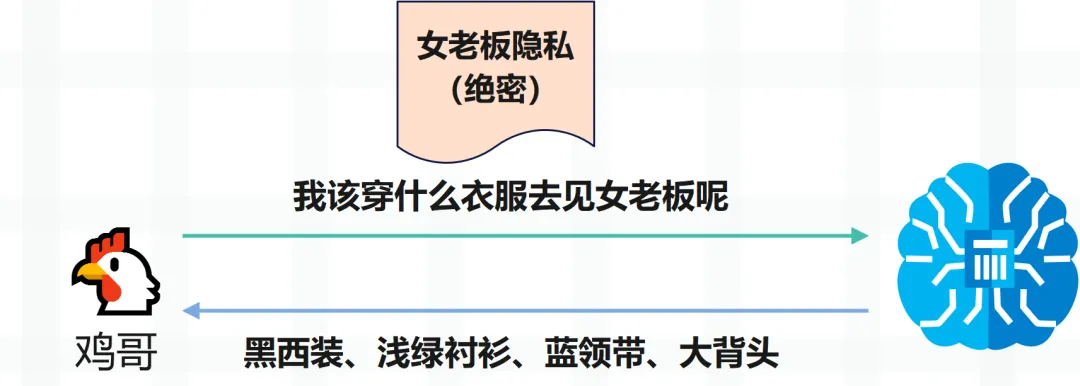

鸡哥发现大模型的回答很官方,都是一堆正确的废话,不是自己想要的答案。但鸡哥很快又想到了新的办法,把文档和问题一起发给大语言模型不就行了。

图片

图片

鸡哥按照大模型的建议,一上来就给女老板留下了好印象,然后又凭借三寸不烂之舌侃侃而谈,哄得女老板面色红润、手舞足蹈,最终顺利拿下了 1000 万的投资。而领导为了表扬鸡哥的功绩,大手一挥,送给他一面锦旗和 500 块钱奖金。

正所谓逮住蛤蟆攥出尿,领导又让鸡哥去从另一个女老板手里拿到投资。鸡哥还是像之前一样先从穿搭入手,但这次大语言模型却没有给出精确的回答,因为文档太大了,信息太多、太杂,而答案可能只隐藏在文档的一个不起眼的角落,导致大模型没有抓住重点。

于是聪明的鸡哥又想到了,那能否不把整个文档发过去,而是只发和问题相关的部分呢?显然是可以的,这就是 RAG(Retrieval Augmented Generation)要解决的问题。所以 RAG 的中文翻译是检索增强生成,它是一种结合了信息检索和文本生成的 AI 技术架构,其核心思想是在生成回答之前,先从外部知识库中检索相关信息,然后基于这些检索到的信息来生成更准确、更有根据的回答。

简单来说,RAG 的工作原理如下:

- 检索 (Retrieval): 当用户提出一个问题或给出一段提示时,RAG 系统首先会从外部的知识库中检索相关信息。这个知识库可以包含各种数据,例如公司的内部文档、产品手册、最新的新闻文章、数据库记录等等。

- 增强 (Augmented): 检索到的相关信息会和用户的原始问题一起,被 "增强" 或 "补充" 到输入给大语言模型的内容中。

- 生成 (Generation): 大语言模型在接收到这些增强的上下文信息后,会生成一个更加准确、相关和基于事实的答案。

那么问题来了,只发和问题相关的部分说起来简单,但相关这两个字要如何量化呢?或者说我们要怎么判断一段文字和用户的问题是否有关系呢?如果你对机器学习有所了解的话,很容易想到可以像 k 近邻算法一样,将文本抽象成空间中的一个点,通过计算两个点的距离,来判断它们之间是否相关。

比如有以下四句话:

- "鸡哥的穿衣风格咋样?",将这句话映射之后的点记作 A。

- "鸡哥穿衣很时尚、很有品味",将这句话映射之后的点记作 B。

- "鸡哥很注重穿搭",将这句话映射之后的点记作 C。

- "鸡哥的宝剑也未尝不锋利",将这句话映射之后的点记作 D。

显然 AB 的距离最近,其次是 AC,最后是 AD。

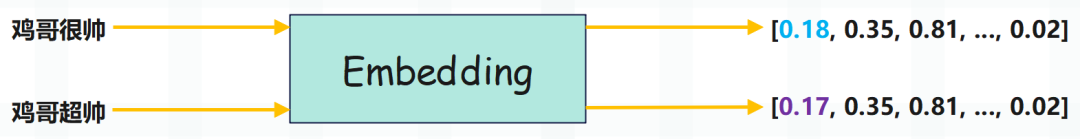

所以我们需要一种新的模型,它的输入也是一段文字,但输出是一个数组,存储了映射之后的点在空间中的坐标,这种模型叫做 Embedding 模型。比如 OpenAI 的 text-embedding-3-small 模型会将文本映射成长度为 1536 的数组,text-embedding-3-large 模型会将文本映射成长度为 3072 的数组,而数组的长度就是空间的维度,维度越高,理论上能够捕捉到的语义信息就越丰富和细致。

不难发现,数组就是文本的一种量化,当然这个过程是有损失的,数组长度越短,损失的信息就越多。

图片

图片

文本越相似,它们在空间中的距离就越近,通过两段文字的距离即可判断它们是否相关。

回到之前的问题,如果文档太长了,大语言模型不好处理该怎么办?显然这个问题的解决方案已经有了。

- 1)将文档进行切分,至于方式可以按字数切分、按段落切分、按句子切分等等,这个过程叫做 Chunking。

- 2)对 Chunking 后的每一段文字都做 Embedding,得到固定长度的数组,更专业的说法叫向量,因此这个过程叫做"向量化"或"嵌入"。

- 3)将原始文本和对应的向量保存在向量数据库中,当输入一个向量时,数据库就会返回和输入向量最近的 n 条数据。

这样当用户输入问题时,先用同样的 Embedding 模型将问题转成向量,然后再从向量数据库中选择距离最近的 n 条数据,将对应的内容和问题一起发给大模型。到此,一个完整的 RAG 架构就完成了。