在AIGC从“自由创作”迈向“精准控制”的关键阶段,小红书AIGC团队今日开源其全新布局可控图像生成框架——InstanceAssemble,专为解决高密度、多对象、复杂空间关系的Layout-to-Image任务而设计。该框架在保持极低参数增量(最低仅0.84%)的前提下,显著提升生成图像的空间对齐精度与语义一致性,为电商、设计、游戏等高要求场景提供工业级解决方案。

级联建模 + Assemble-Attention,破解“多物堆叠”难题

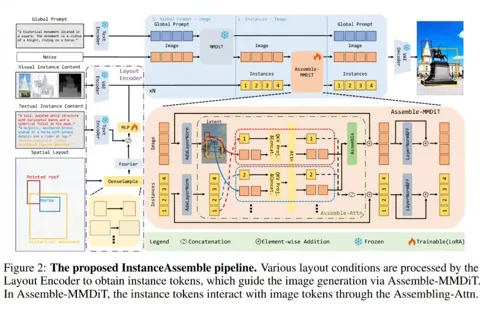

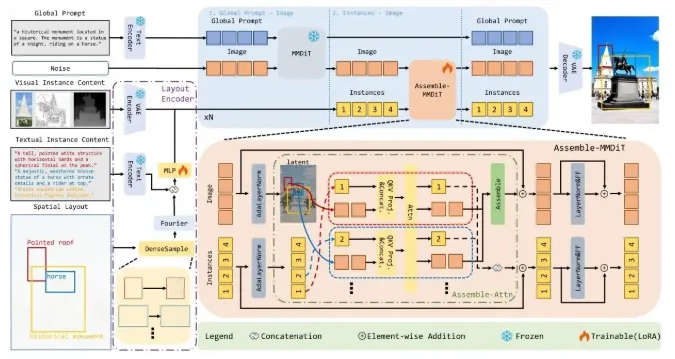

传统Layout-to-Image模型在面对“10个商品图标+文字标签+背景图层”等复杂布局时,常出现对象错位、重叠或语义错配。InstanceAssemble创新性采用级联双阶段架构:

1. 语义理解阶段:解析文本描述与布局指令的语义关联;

2. 空间组装阶段:通过自研Assemble-Attention机制,动态建模实例间相对位置、遮挡关系与层次结构,确保每个元素“该在哪,就在哪”。

实验显示,在密集商品展示、多角色插画、UI界面生成等场景中,InstanceAssemble的对象定位准确率与边缘清晰度显著优于现有方法。

极轻量适配,兼容主流底模

为降低部署门槛,框架采用超轻量LoRA适配器:

- 适配Stable Diffusion3-Medium仅需3.46%额外参数;

- 适配Flux.1模型更是低至0.84%。

这意味着用户无需重新训练大模型,即可在保留底模强大生成能力的同时,灵活注入布局控制能力,支持文本+参考图+边界框的多模态指令。

自建DenseLayout基准,推动评估标准化

为精准衡量布局对齐质量,小红书同步发布DenseLayout评测数据集与LGS(Layout Grounding Score)可解释指标。LGS从位置精度、尺度匹配、语义一致性三个维度量化生成效果,解决传统指标(如IoU)在密集场景下失真的问题。

AIbase认为,InstanceAssemble的发布,标志着AIGC正从“画得像”走向“摆得准”。当AI不仅能生成精美图像,还能按设计师的精确布局指令“摆放”每个元素,AIGC才真正具备嵌入专业生产流程的能力。而小红书此次开源,不仅赋能社区创作者,更将推动整个行业向可控、可靠、可商用的生成式AI迈进。

论文链接:https://arxiv.org/abs/2509.16691

项目主页:https://github.com/FireRedTeam/InstanceAssemble