在AI智能问答系统中,向量数据库的存储压力越来越大。随着知识库规模扩大,如何高效压缩存储空间正在被大家所关注。本文将介绍一种方案,实现节省知识库占用空间,避免数据量无限制的增长。

向量存储数据膨胀之痛

当前向量存储模式面临空间占用巨大、冗余数据多和扩展成本高三大痛点,具体表现为原始文档、向量表示、元数据的三重存储造成资源浪费,同时相同内容被重复存储进一步加剧了空间浪费,最终导致存储需求增长引发硬件投入激增,形成恶性循环。

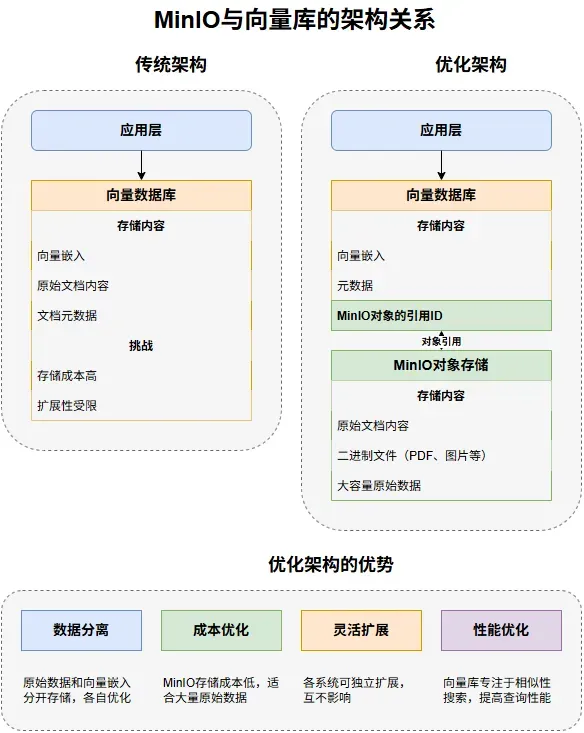

向量数据库的优化架构

向量量化存储,一招减少75%空间。传统向量使用32位浮点数表示,而量化技术可将其转换为8位整数,在几乎不损失精度的情况下节省单向量存储空间达75%,同时整数运算比浮点运算更高效加速了检索过程,更重要的是主流向量库均支持此功能,实施门槛低。

分层存储架构将数据分为向量层、索引层和原文层三个部分,让向量数据库专注于相似性检索,不再承担原文存储负担。原文层可采用MinIO等对象存储系统,其高性能、低成本特性非常适合管理大量非结构化文档,同时支持动态扩容,完美应对数据增长需求。

通过哈希对比技术实现文档唯一化存储,确保相同文档只存储一次,仅处理新增内容,还能保留文档变更历史进行版本控制。企业文档重复率通常达30%以上,唯一化存储可大幅减少冗余数据,释放宝贵存储空间。

针对原始文档和向量数据采用不同策略,包括原文使用无损压缩技术减少40-60%空间、向量稀疏化将低重要性数值归零、增量编码仅存储与基准向量的差异值。这套组合拳可在不明显影响检索性能的前提下显著减少存储需求。

MinIO在原文存储中的关键作用

在分层架构中,MinIO作为原文存储层提供了独特优势:对于PDF、图片等二进制文件读取速度快;支持水平扩展轻松应对TB级数据;开源方案运维成本低;使用标准S3 API便于集成和迁移。将原始文档卸载至MinIO存储,可使向量数据库减负明显,系统整体性能提升显著。

以某金融企业知识库应用优化后,原始文档100GB,传统向量存储需250GB以上,而优化后总存储仅需150GB,节省空间40%以上,检索性能保持不变甚至略有提升,充分证明了优化策略的有效性。

写在最后

向量存储优化技术正在快速发展,未来将出现更多创新方向:使用小模型提取大模型知识的知识蒸馏技术,根据内容重要性动态调整精度的自适应量化方法,以及跨设备分布式存储降低单点压力的联邦向量库架构,这些技术将进一步提升存储效率。智能问答系统的未来在于更高效的向量存储。通过这些优化技术,可以在保证性能的同时,将存储成本控制在合理范围,实现系统的可持续发展。

2025年的今天,AI创新已经喷井,几乎每天都有新的技术出现。作为亲历三次AI浪潮的技术人,我坚信AI不是替代人类,而是让我们从重复工作中解放出来,专注于更有创造性的事情,关注我们公众号口袋大数据,一起探索大模型落地的无限可能!