注意力机制

Kimi开源新线性注意力架构,首次超越全注意力模型,推理速度暴涨6倍

闻乐 发自 凹非寺. 量子位 | 公众号 QbitAITransformer的时代,正在被改写。 月之暗面最新发布的开源Kimi Linear架构,用一种全新的注意力机制,在相同训练条件下首次超越了全注意力模型。

揭秘大模型的魔法:从Transformer架构开始,一步步揭开它的神秘面纱

大家好,我是写代码的中年人,本章我们正式进入Transformer架构的学习。 从 ChatGPT 到文生图,从语音助手到AI绘本的自动生成,背后几乎都躲着一个强大的架构,它像一台“魔法机器”,能读懂语言、生成内容、甚至推理判断。 但这一切魔法的根基,其实都是数学和工程的艺术结晶。

信我,有你想要的!最大化DeepSeek潜能:动态注意力机制

deepseek原理 应用 实践,和大家分享:小众的,deepseek核心技术原理;大众的,提示词要怎么写;今天和大家聊聊,deepseek的核心技术之一的动态注意力机制。 要搞懂这个,先得知道什么是注意力机制? 这是一种通过计算…查询向量(Query)…键向量(Key)…值向量(Value)…,最终得到...的技术。

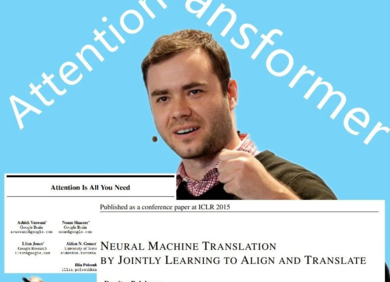

被忽略的起点?Karpathy揭秘最初的注意力论文被Transformer光芒掩盖的故事

几个小时前,著名 AI 研究者、OpenAI 创始成员之一 Andrej Karpathy 发布了一篇备受关注的长推文,其中分享了注意力机制背后一些或许少有人知的故事。 其中最值得注意的一个故事是真正首次提出注意力机制的论文其实是 Dzmitry Bahdanau、Kyunghyun Cho 和 Yoshua Bengio 的《Neural Machine Translation by Jointly Learning to Align and Translate》,这比《Attention is All you Need》还早 3 年,但很显然,这篇论文并没有收获后者那般的关注。 Karpathy 长推文的不完整截图实际上,这个故事来自 Dzmitry Bahdanau 发给 Karpathy 的一封邮件。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉