知识蒸馏

被拒≠失败!这些高影响力论文都被顶会拒收过

近日,Waymo 发布了一篇深度博客,详细介绍了该公司的 AI 战略以及以 Waymo 基础模型为核心的整体 AI 方法。 谷歌首席科学家 Jeff Dean X 也分享了这篇博客,并重点介绍了 Waymo 占用的补充方法,他写到:「就像我们使用增量从更大规模的专业模型中创建高质量、计算效率极高的 Gemini Flash 模型一样,Waymo 也类似地使用了补充,来基于更大的模型可机载运行创建高计算效率模型。 」而在这条帖子的下方,Jeff Dean 再次回忆起了最初那篇论文的悲惨遭遇:被 NeurIPS 2014 拒收了。

榨干每一分算力:Distillation Scaling Laws带你走进高效模型新时代

初次阅读这篇文章,感到非常震撼。 在DeepSeek将知识蒸馏方法带入大众视野后,Apple与牛津大学的研究人员迅速提出了蒸馏缩放定律,并已于2月28日完成了所有实验及一篇长达67页的论文上传至arXiv。 这种效率和深度,无疑展示了大公司的研究实力。

被DeepSeek带火的知识蒸馏详解!

今天来详细了解DeepSeek中提到的知识蒸馏技术,主要内容来自三巨头之一Geoffrey Hinton的一篇经典工作:。 主要从背景、定义、原理、代码复现等几个方面来介绍:1、背景介绍训练与部署的不一致性在机器学习和深度学习领域,训练模型和部署模型通常存在显著差异。 训练阶段,为了追求最佳性能,我们通常会使用复杂的模型架构和大量的计算资源,从海量且高度冗余的数据集中提取有用信息。

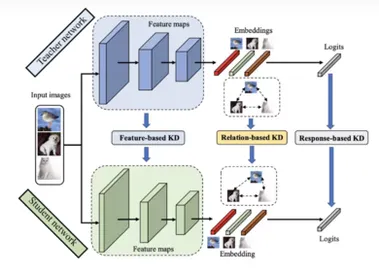

Springer知识蒸馏专著解读 | 面向图像识别的知识蒸馏综述

本次文章介绍我们发表于由Springer出版的专著《Advancements in Knowledge Distillation: Towards New Horizons of Intelligent Systems 》中的第一章“Categories of Response-Based, Feature-Based, and Relation-Based Knowledge Distillation”。 该篇文章的主要内容是整理了面向图像识别的知识蒸馏的相关工作,首先在response-based、feature-based和relation-based三种知识形式来介绍离线知识蒸馏的相关工作,然后整理了在线知识蒸馏和自知识蒸馏的相关工作,在其中也对自监督学习蒸馏和视觉Transformer(ViT)蒸馏也进行了介绍。 最后讲解了扩展的蒸馏技术领域,包括多教师知识蒸馏、跨模态知识蒸馏、注意力机制知识蒸馏、无数据知识蒸馏和对抗知识蒸馏。

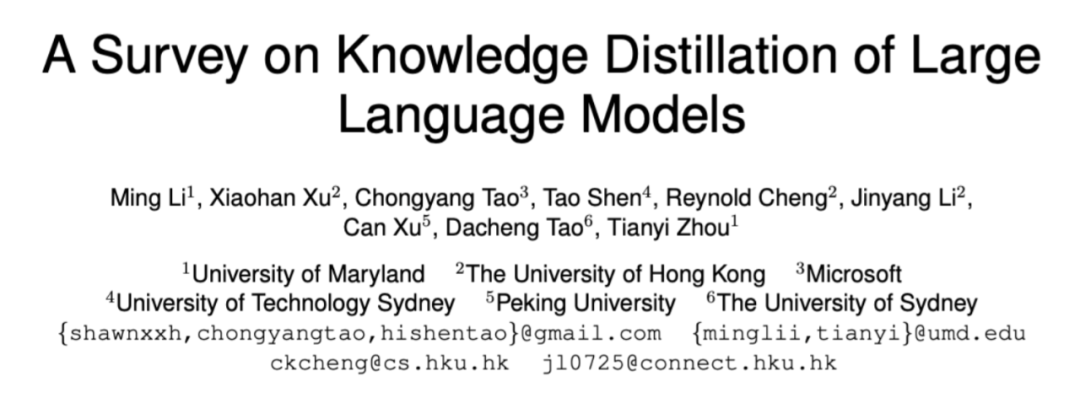

总结374篇相关工作,陶大程团队联合港大、UMD发布LLM知识蒸馏最新综述

大语言模型(Large Language Models, LLMs)在过去两年内迅速发展,涌现出一些现象级的模型和产品,如 GPT-4、Gemini、Claude 等,但大多数是闭源的。研究界目前能接触到的大部分开源 LLMs 与闭源 LLMs 存在较大差距,因此提升开源 LLMs 及其他小模型的能力以减小其与闭源大模型的差距成为了该领域的研究热点。LLM 的强大能力,特别是闭源 LLM,使得科研人员和工业界的从业者在训练自己的模型时都会利用到这些大模型的输出和知识。这一过程本质上是知识蒸馏(Knowledge,

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉