稀疏自编码器

谷歌 DeepMind 发布 Gemma Scope 2:为 Gemma 3 模型提供全栈可解释性工具

谷歌 DeepMind 的研究团队近日推出了 Gemma Scope2,这是一个开放的可解释性工具套件,旨在深入了解 Gemma3语言模型在各层次上的信息处理和表现,涵盖从2.7亿到270亿参数的模型。 该工具的核心目标是为人工智能安全与对齐团队提供一种实用的方法,以便追踪模型行为回到内部特征,而不仅仅依赖输入与输出的分析。 当 Gemma3模型出现 “越狱”、幻觉或表现出拍马屁的行为时,研究人员可以利用 Gemma Scope2检查哪些内部特征被激活以及这些激活在网络中的流动情况。

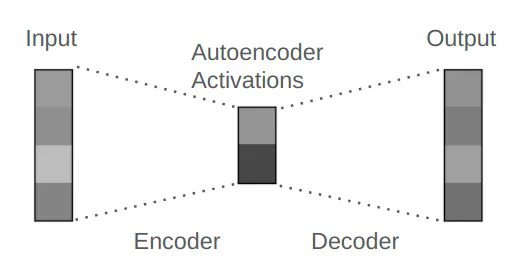

LLM可解释性的未来希望?稀疏自编码器是如何工作的,这里有一份直观说明

简而言之:矩阵 → ReLU 激活 → 矩阵在解释机器学习模型方面,稀疏自编码器(SAE)是一种越来越常用的工具(虽然 SAE 在 1997 年左右就已经问世了)。机器学习模型和 LLM 正变得越来越强大、越来越有用,但它们仍旧是黑箱,我们并不理解它们完成任务的方式。理解它们的工作方式应当大有助益。SAE 可帮助我们将模型的计算分解成可以理解的组件。近日,LLM 可解释性研究者 Adam Karvonen 发布了一篇博客文章,直观地解释了 SAE 的工作方式。可解释性的难题神经网络最自然的组件是各个神经元。不幸的是

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉