OOD

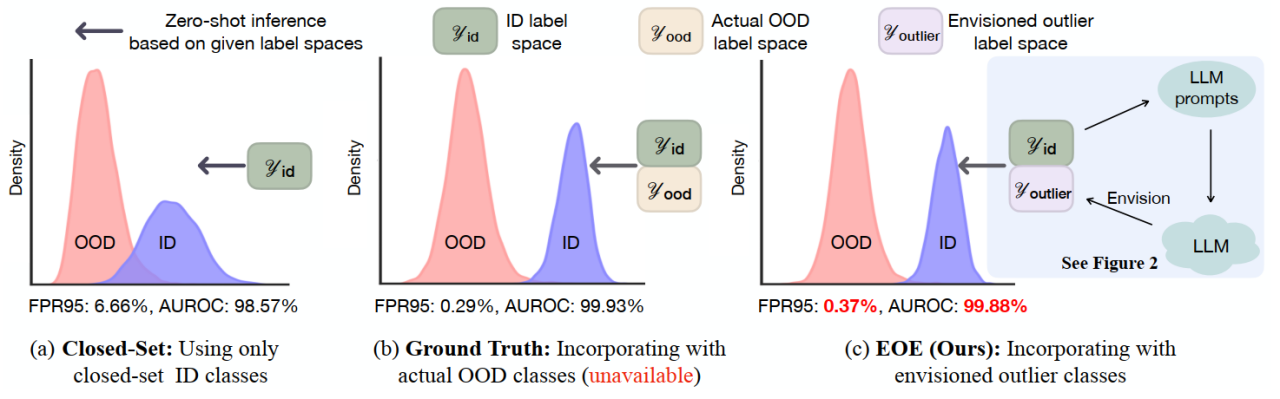

ICML 2024| 大语言模型助力基于CLIP的分布外检测任务

当训练数据集和测试数据集的分布相同时,机器学习模型可以表现出优越的性能。然而在开放世界环境中,模型经常会遇到分布外(Out-of-Distribution, OOD,下称“OOD”)样本,OOD样本可能会导致模型做出不可预测的行为,而错误的后果可能是致命的,尤其是在自动驾驶等高风险场景中 [1, 2]。因此OOD检测对于保障机器学习模型在实际部署中的可靠性至关重要。大多数OOD检测方法 [1, 3] 可以基于训练有素的分布内 (In-Distribution, ID) 分类器有效地检测 OOD 样本。然而,对于不同

ICML 2024 | 特征污染:神经网络会学习不相关特征而泛化失败

论文标题:Feature Contamination: Neural Networks Learn Uncorrelated Features and Fail to Generalize论文链接::,深度神经网络 SGD scaling的机器学习范式再次证明了其在AI领域的主导地位。为什么基于深度神经网络的范式能够取得成功?比较普遍的观点是:神经网络具有从海量的高维输入数据中自动学习抽象而可泛化的特征的能力。遗憾的是,受限于当前分析手段和数学工具的不足,目前我们对于“(深度)神经网络如何实现这样的特征学习过程”这

ICLR 2024 Spotlight | 负标签挖掘助力基于CLIP的分布外检测任务

在机器学习模型日益应用于开放世界场景中,如何有效识别和处理分布外(Out-of-Distribution, OOD)数据成为一个重要研究领域[1]。分布外数据的存在可能导致模型过度自信和错误预测,这在安全关键应用(如自动驾驶和医疗诊断)中尤为危险。因此,发展一种有效的OOD检测机制,对于提高模型在实际应用中的安全性和可靠性至关重要。传统的OOD检测方法主要集中在单一模态,特别是图像数据上,而忽视了其他潜在有用的信息源,例如文本数据。随着视觉-语言模型(VLMs)的兴起,它们在多模态学习场景中展示了强大的性能,特别是

ICCV 2023 Oral | 如何在开放世界进行测试段训练?基于动态原型扩展的自训练方法

提高模型泛化能力是推动基于视觉的感知方法落地的重要基础,测试段训练和适应(Test-Time Training/Adaptation)通过在测试段调整模型参数权重,将模型泛化至未知的目标域数据分布段。现有 TTT/TTA 方法通常着眼于在闭环世界的目标域数据下提高测试段训练性能。可是,在诸多应用场景中,目标域容易受到强域外数据 (Strong OOD) 数据的污染,例如不相关的语义类别数据。在该场景又可称为开放世界测试段训练 (OWTTT),在该场景下,现有 TTT/TTA 通常将强域外数据强行分类至已知类别,从而

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉