纽约大学

纽约大学教授利用 AI 口试应对学术作弊,成本仅42美分

在应对人工智能带来的学术作弊问题上,纽约大学的一位教授采用了创新的方法。 他在一门名为 “AI/ML 产品管理” 的课程中进行了一次口试实验,结果揭示了学生知识的差距以及自身教学的不足。 教授 Panos Ipeirotis 和共同授课的 Konstantinos Rizakos 发现,许多提交了高质量书面作业的学生,无法在口试中清晰解释自己作业中的基本决策。

NeurIPS 2025 Spotlight | NYU提出QSVD,仅数学压缩让模型更轻、更快、更稳

本工作由纽约大学 NYU SAI Lab 的硕士生王宇彤与博士生王海宇合作完成。 本文的通讯作者为张赛骞,他是纽约大学(New York University)计算机科学系助理教授、SAI Lab 负责人,其研究方向涵盖多模态大模型(Vision-Language Models)压缩与加速、低比特量化、高效推理以及可信智能系统。 在多模态智能浪潮中,视觉语言模型(Vision-Language Models, VLM)已成为连接视觉理解与语言生成的核心引擎。

买个机器人端茶倒水有希望了?Meta、纽约大学造了一个OK-Robot

如果有个这样的机器人,你几点回家?「xx,去把电视柜上的遥控器帮我拿过来。」在一个家庭环境中,很多家庭成员都不免被支使干这种活儿。甚至有时候,宠物狗也难以幸免。但人总有支使不动的时候,宠物狗也并不一定都能听懂。帮人类干活儿的终极梦想还是寄托在机器人身上。最近,纽约大学、Meta 研发出的一款机器人学会了这个技能。你只需要对它说,「把桌子上的玉米片拿到床头柜上」,它就能自己找到玉米片,并规划出路线和相应的动作,顺利完成任务。此外,它还能帮你整理东西或扔垃圾。这个机器人名叫 OK-Robot,由来自纽约大学、Meta

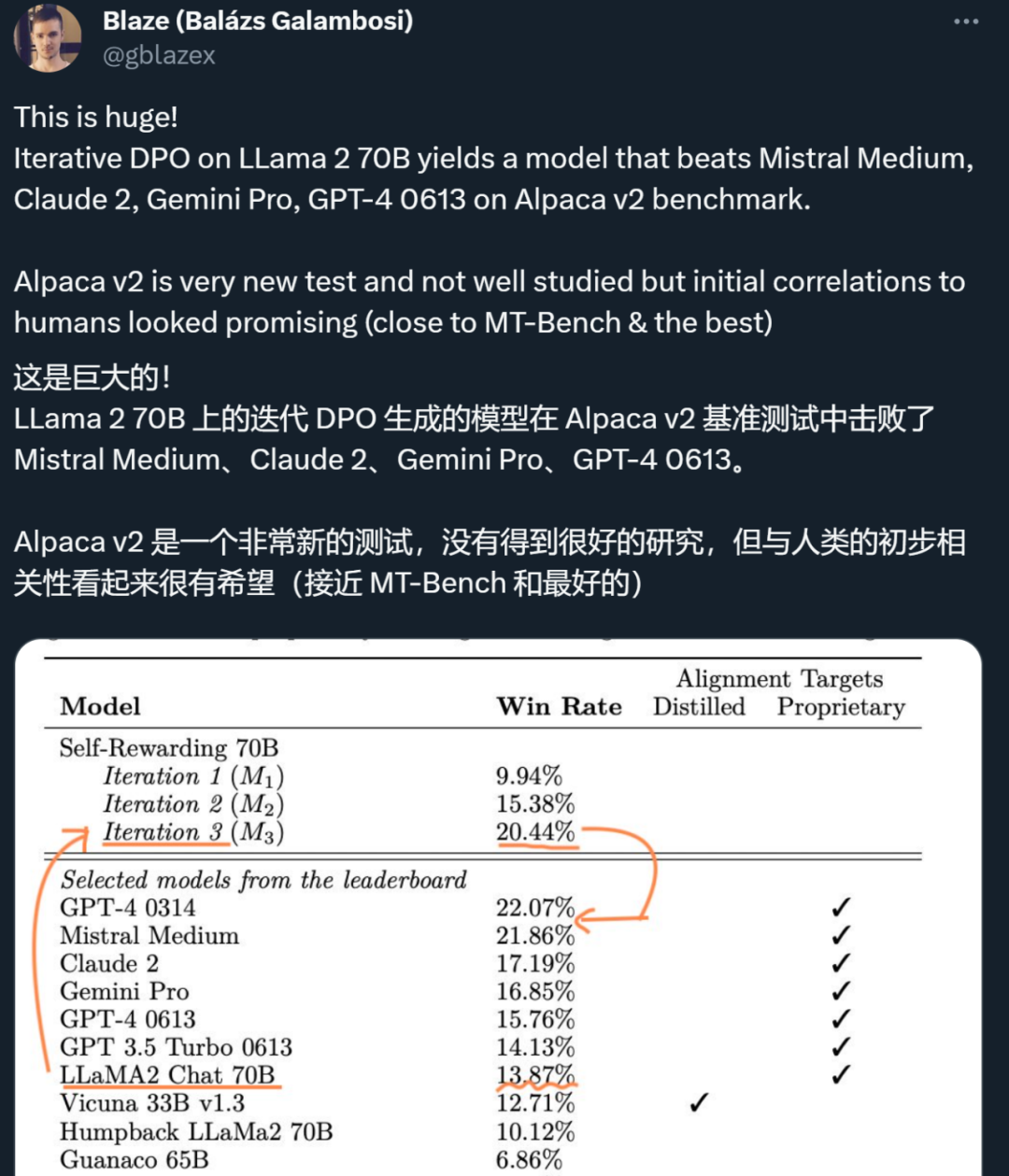

大模型自我奖励:Meta让Llama2自己给自己微调,性能超越了GPT-4

人工智能的反馈(AIF)要代替 RLHF 了?大模型领域中,微调是改进模型性能的重要一步。随着开源大模型逐渐变多,人们总结出了很多种微调方式,其中一些取得了很好的效果。最近,来自 Meta、纽约大学的研究者用「自我奖励方法」,让大模型自己生成自己的微调数据,给人带来了一点新的震撼。在新方法中,作者对 Llama 2 70B 进行了三个迭代的微调,生成的模型在 AlpacaEval 2.0 排行榜上优于一众现有重要大模型,包括 Claude 2、Gemini Pro 和 GPT-4。因此,论文刚刚发上 arXiv 几

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉