MetaCLIP 2

谢赛宁团队新作打破“多语言诅咒”!MetaCLIP 2支持300多种语言,英语性能反倒提升了

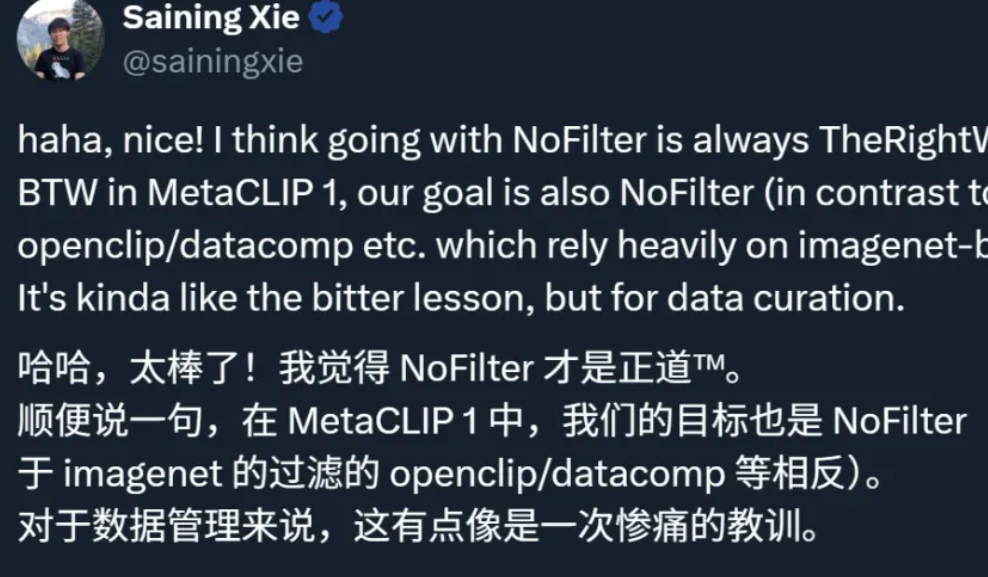

谢赛宁团队新作正在引起热议! 一直以来,作为文生图基石的CLIP模型主要基于英文数据训练,但实际上,全球互联网仍有超过50%的非英文数据。 为了将CLIP模型进一步扩展,研究人员需要搞定两大“拦路虎”:缺乏处理非英语数据的筛选方法;.

OpenAI提出的CLIP,被Meta联合谢赛宁、刘壮,扩展到全球300+语言

在人工智能领域,对比语言 - 图像预训练(CLIP) 是一种流行的基础模型,由 OpenAI 提出,支持零样本分类、检索等下游任务,并可作为多模态大语言模型(MLLM)的视觉编码器。 尽管 CLIP 已经成功地在数十亿规模的英语图文对上进行了训练,但进一步扩展到全球范围内的数据仍面临以下两项挑战:目前缺少有效的方法来处理非英语世界的数据;现有的多语言版本 CLIP 在英语上的表现通常不如只使用英语训练的版本,这种现象在大语言模型中也很常见,被称为「多语言的诅咒」。 为了解决这些挑战,来自 Meta、MIT、普林斯顿大学、纽约大学的研究者提出了 MetaCLIP 2,这是首个从零开始在原生全球图文对上训练 CLIP 的方法,不依赖任何外部资源,包括私有数据、机器翻译或蒸馏。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉