Cerebras

AI 芯片厂商 Cerebras 部署 DeepSeek 服务爆单,降低成本反而扩大市场容量

AI 芯片厂商 Cerebras 的 CEO Andrew Feldman 接受采访时说,该公司已经被运行 DeepSeek-R1 大语言模型的订单压垮。

Cerebras与Perplexity携手打造超高速AI搜索模型Sonar,瞄准千亿美元市场

近日,Cerebras Systems 与 Perplexity AI 宣布达成合作,共同推出一款新的超快速 AI 搜索模型 Sonar,旨在挑战传统搜索引擎的主导地位。 合作的核心在于 Sonar 模型,该模型在 Cerebras 专用的 AI 芯片上运行,速度达到每秒1200个标记,成为目前市场上最快的 AI 搜索系统之一。 Sonar 模型建立在 Meta 的 Llama3.370B 基础上,标志着一种新型 AI 优先的搜索体验,双方对其快速性能寄予厚望。

OpenAI 早有“造芯梦”:曾考虑收购晶圆级芯片企业 Cerebras

对于 OpenAI 而言,自研 AI 芯片可降低对英伟达等外部供应商的依赖,获得更强的对英伟达议价能力,在 AI GPU 紧缺时保障业务推进不受影响。

Cerebras 推出全球最快 AI 推理解决方案,速度是英伟达方案的 20 倍

Cerebras Systems 今日宣布推出 Cerebras Inference,官方称这是全球最快的 AI 推理解决方案。该新解决方案为 Llama 3.1 8B 提供每秒 1800 个 token,为 Llama 3.1 70B 提供每秒 450 个 token,速度是微软 Azure 等超大规模云中提供的基于英伟达 GPU 的 AI 推理解决方案的 20 倍。除了令人难以置信的性能之外,这款新型推理解决方案的定价也比流行的 GPU 云低得多,起价仅为每百万个 token 10 美分,从而为 AI 工作负载

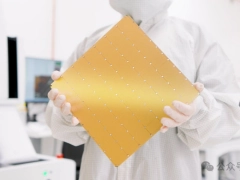

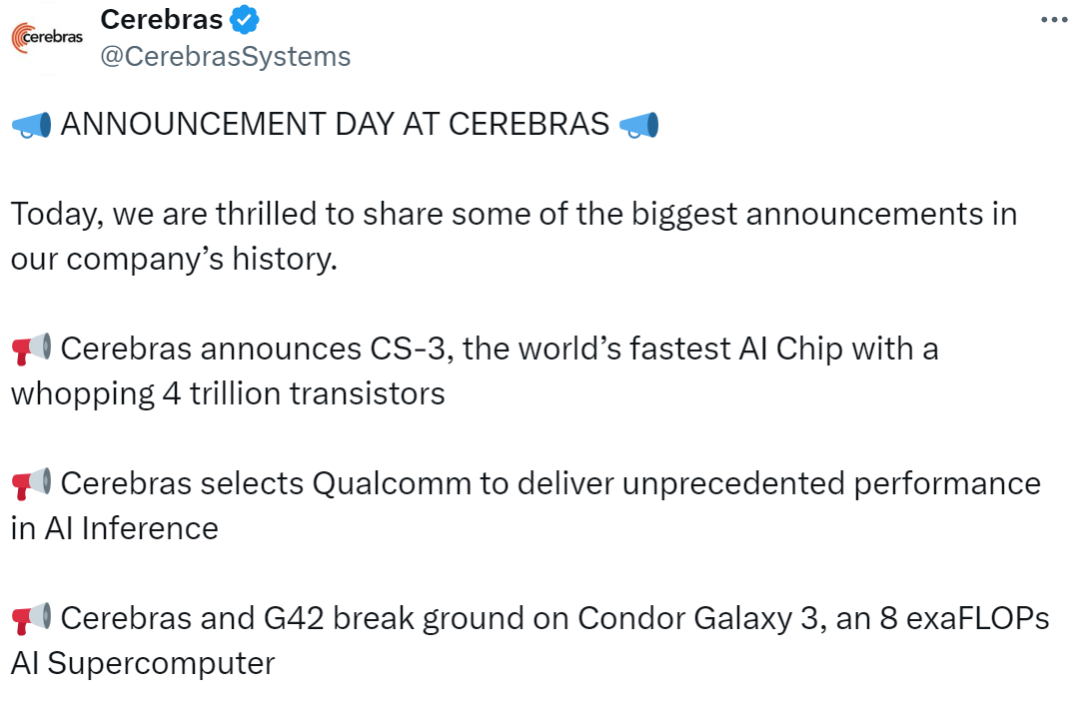

4 万亿晶体管 5nm 制程,全球最快 AI 芯片 WSE-3 碾压 H100:单机可训 24 万亿参数 LLM,Llama 70B 一天搞定

【新智元导读】AI 世界的进化快得有点跟不上了。刚刚,全球最强最大 AI 芯片 WSE-3 发布,4 万亿晶体管 5nm 工艺制程。更厉害的是,WSE-3 打造的单个超算可训出 24 万亿参数模型,相当于 GPT-4 / Gemini 的十倍大。全球最快、最强的 AI 芯片面世,让整个行业瞬间惊掉了下巴!AI 芯片初创公司 Cerebras 重磅发布了「第三代晶圆级引擎」(WSE-3)。性能上,WSE-3 是上一代 WSE-2 的两倍,且功耗依旧保持不变。90 万个 AI 核心,44GB 的片上 SRAM 存储,让

可训练24万亿参数的大模型,Cerebras 推出其下一代晶圆级 AI 芯片

图:Cerebras 第三代晶圆级 AI 巨型芯片 WSE-3。(来源:Cerebras)编辑 | 白菜叶人工智能超级计算机公司 Cerebras 表示,其下一代晶圆级人工智能芯片可以在消耗相同电量的情况下将性能提高一倍。Wafer Scale Engine 3 (WSE-3,文中又称 CS-3) 包含 4 万亿个晶体管,由于使用了更新的芯片制造技术,比上一代增加了 50% 以上。该公司表示将在新一代人工智能计算机中使用 WSE-3,这些计算机目前正在 Dallas 的一个数据中心组装,这将是一台能够执行 8 ex

4万亿个晶体管,单机可训练比GPT4大10倍的模型,最快最大的芯片面世

刚刚,芯片创业公司 Cerebras 宣布了该公司历史上最重要的消息,「我们发布了世界上最快的芯片,该芯片拥有高达 4 万亿个晶体管。」一直以来,Cerebras 一直在往「大」的芯片方面发展,此前他们发布的晶圆级引擎(Wafer Scale Engine,WSE-1)面积比 iPad 还大。第二代 WSE-2 虽然在面积上没有变化,但却拥有惊人的 2.6 万亿个晶体管以及 85 万个 AI 优化的内核。而现在推出的 WSE-3 包含 4 万亿个晶体管,在相同的功耗和价格下,WSE-3 的性能是之前记录保持者 WS

Cerebras 推出第三代晶圆级芯片 WSE-3:台积电 5nm 制程,性能翻倍

晶圆级芯片创新企业 Cerebras 推出了其第三代芯片 WSE-3,宣称以相同功耗相较上代产品 WSE-2 性能翻倍。IT之家整理 WSE-3 参数如下:台积电 5nm 制程;4 万亿个晶体管;900000 个 AI 核心;44GB 片上 SRAM 缓存;可选 1.5TB / 12TB / 1.2PB 三种片外内存容量;125 PFLOPS 的峰值 AI 算力。Cerebras 宣称基于 WSE-3 的 CS-3 系统凭借其至高 1.2PB 的内存容量,可训练比 GPT-4 和 Gemini 大 10 倍的下一代

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉