1、一个令人深思的认知谜题

想象一下这样的场景:你和ChatGPT都被要求对一堆动物进行分类。你可能会说"鸟类里,知更鸟是典型代表,而企鹅有点特殊",而AI却可能简单粗暴地把所有有翅膀的都归为一类。表面上看,你们的分类结果差不多,但背后的思维逻辑却天差地别。

这个看似简单的差异,实际上揭示了一个更深层的问题:AI到底是真的"理解"了概念,还是仅仅在进行高级的统计模式匹配?

最近,来自斯坦福大学和纽约大学的研究团队发表了一项突破性研究,用信息论的数学工具深入剖析了这个问题。他们的发现令人震惊:大语言模型和人类在处理概念时采用了完全不同的策略——AI追求极致的统计压缩,而人类更偏爱灵活的适应性表达。

2、背景 —— 概念形成的奥秘

人类概念形成的独特之处

人类的概念形成能力堪称认知科学的奇迹。我们能够轻松地将复杂多样的信息压缩成简洁有意义的概念,比如看到知更鸟和蓝鸦都能归类为"鸟",并且知道大多数鸟都会飞。这个过程体现了一个关键的权衡:在保持语义保真度(意义)的同时实现表征简化(压缩)。

更有趣的是,人类的概念系统往往是层次化的——知更鸟是鸟,鸟是动物——这种结构既高效又富有表现力。每个概念类别内部还有"典型性"的差异:知更鸟被认为是典型的鸟,而企鹅则不那么典型。

大语言模型的概念迷雾

现在的大语言模型展现出了令人印象深刻的语言处理能力,在很多需要深度语义理解的任务上表现出色。但一个根本性问题始终悬而未决:这些模型是真正理解了概念和意义,还是仅仅在庞大数据集上进行复杂的统计模式匹配?

研究团队指出,要让AI超越表面模仿、实现更接近人类的理解,关键在于弄清楚AI的内部表征如何处理信息压缩与语义保真之间的权衡。

3、研究方法 —— 用数学透视思维差异

信息论框架

研究团队创建了一个基于率失真理论和信息瓶颈原理的全新框架来量化比较不同系统如何平衡表征复杂性与语义保真度。他们设计了一个目标函数L:

图片

图片

L(X, C; β) = 复杂度(X, C) + β × 失真度(X, C)

这个公式巧妙地平衡了两个关键要素:

(1)复杂度项:衡量用概念簇表示原始项目的信息成本,反映压缩程度

(2)失真度项:衡量分组过程中丢失的语义保真度,反映意义保持程度

权威的人类认知基准

与许多现代众包数据集不同,研究团队选择了认知科学史上三个里程碑式的研究作为人类基准:

(1)Rosch (1973)研究:8个语义类别中的48个项目,确立了原型理论基础

(2)Rosch (1975)研究:10个类别中的552个项目,深化了语义类别的认知表征理论

(3)McCloskey & Glucksberg (1978)研究:18个类别中的449个项目,揭示了自然类别的"模糊边界"

这些经典数据集涵盖了1049个项目和34个类别,为评估AI模型的人类相似性提供了高保真的实证基础。

全面的模型测试矩阵

研究涵盖了从3亿到720亿参数的多样化大语言模型,包括:

(1)编码器模型:BERT系列

(2)解码器模型:Llama、Gemma、Qwen、Phi、Mistral等主流模型家族

通过提取每个模型的静态词元级嵌入向量,研究团队确保了与人类分类实验中无上下文刺激的可比性。

4、发现 —— 三个层次的深度剖析

发现一:宏观对齐的表面和谐

图片

图片

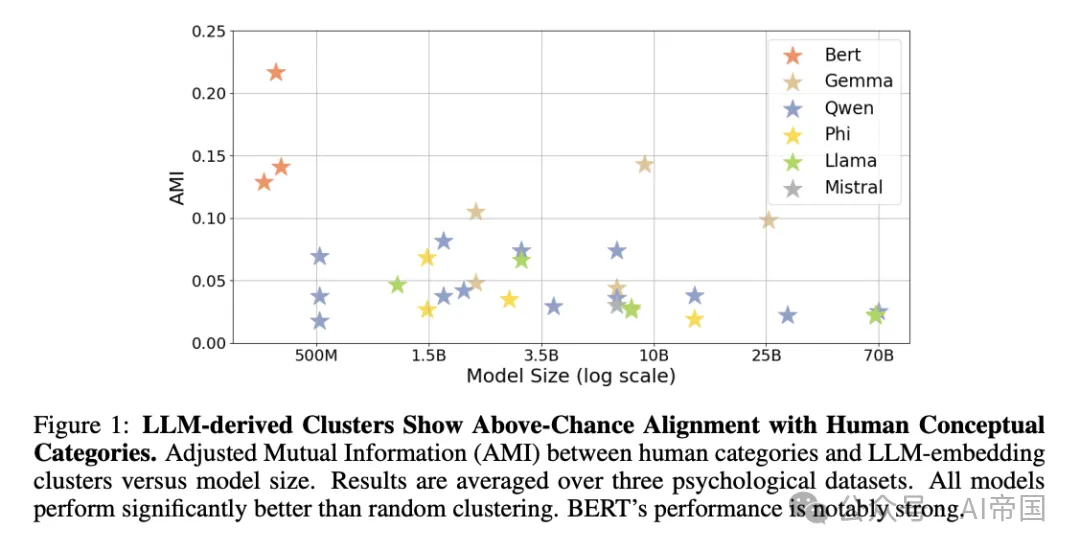

关键发现:大模型能够形成与人类判断大致对齐的概念类别

实验结果显示,所有测试的大语言模型在宏观层面都能形成与人类类别显著对齐的概念簇,远超随机水平。令人意外的是,某些编码器模型(特别是BERT-large)展现出了惊人的对齐能力,有时甚至超越了参数量大得多的模型。

这一发现揭示了一个重要事实:影响类人概念抽象的因素并非仅仅是模型规模,架构设计和预训练目标同样关键。

发现二:细粒度语义的深层鸿沟

关键发现:大模型在捕捉精细语义区别方面能力有限

虽然大模型能够形成宏观的概念类别,但在内部语义结构方面却表现平平。研究团队通过计算项目嵌入向量与其类别名称嵌入向量之间的余弦相似度,发现这些相似度与人类典型性判断之间只有适度的相关性。

换句话说,人类认为高度典型的项目(比如知更鸟对于"鸟"类别),在大模型的表征空间中并不一定更接近该类别标签的嵌入向量。这表明大模型可能更多地捕捉统计上的均匀关联,而非基于原型的细致语义结构。

发现三:效率策略的根本分歧

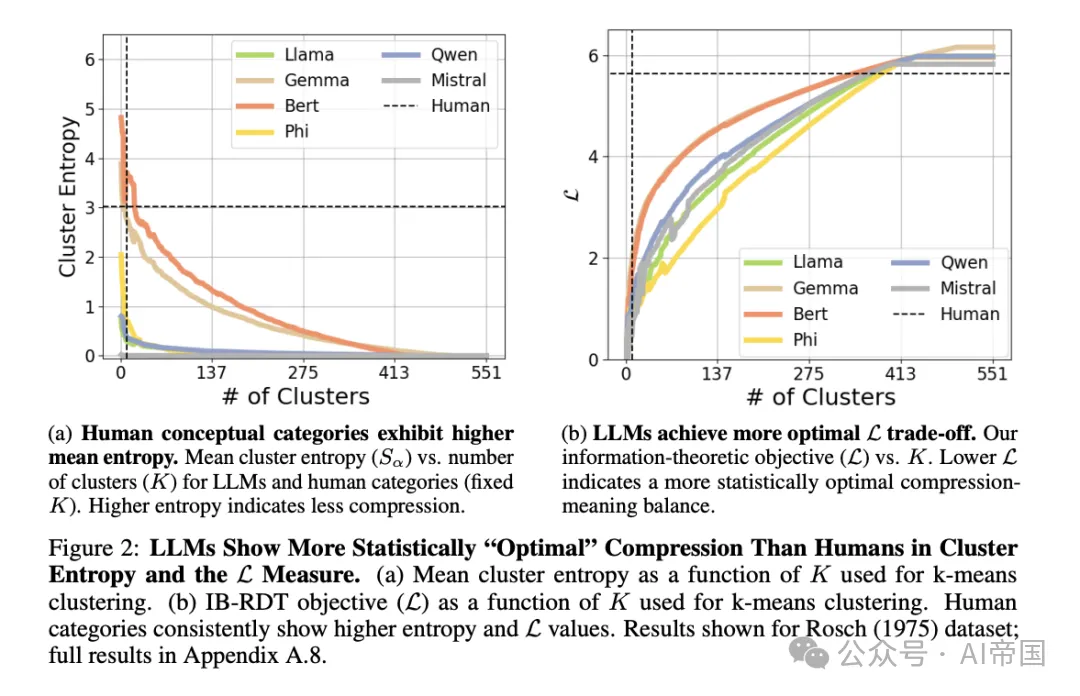

关键发现:AI和人类采用了截然不同的表征效率策略

这是研究中最震撼的发现。通过L目标函数的分析,研究团队发现:

大语言模型展现出卓越的信息论效率:

(1)在压缩-意义权衡方面始终达到更"优化"的平衡

(2)集群熵值更低,表明统计上更紧凑

(3)L目标函数值显著更低,意味着更高的统计效率

人类概念化系统则相反:

(1)在相同聚类数量下具有更高的熵值

(2)L目标函数值更高,在统计上看似"次优"

(3)但这种"低效"可能反映了对更广泛功能需求的优化

图片

图片

5、深层含义 —— 重新审视"智能"的定义

AI的统计压缩偏好

研究揭示,大语言模型高度优化于统计紧凑性。它们形成信息论上高效的表征,通过最小化冗余和内部方差来实现卓越的统计规律性。这很可能是它们在海量文本语料上训练的结果——为了处理庞大的数据,它们学会了极致的压缩策略。

然而,这种对压缩的专注限制了它们完整编码那些对深度理解至关重要的丰富原型语义细节的能力。AI变得"高效"但不够"细腻"。

人类的适应性智慧

人类认知则优先考虑适应性丰富度、上下文灵活性和广泛的功能效用,即使这在统计紧凑性上付出代价。人类概念的高熵值和L分数可能反映了对更广泛复杂认知需求的优化,包括:

(1)稳健泛化:支持从稀少数据中进行有效推广

(2)推理能力:支持因果、功能和目标导向的强大推理

(3)交流效率:通过可学习和可共享的结构实现有效沟通

(4)多模态根基:将概念植根于丰富的多感官体验中

人类选择了看似"低效"的表征方式,实际上是为了获得更好的适应性和多用性。

架构的启示

值得注意的是,较小的编码器模型(如BERT)在特定对齐任务上的出色表现强调了架构设计和预训练目标对模型抽象类人概念信息能力的重要影响。这为未来专注于增强人机对齐的AI开发指明了重要方向。

6、结语:从"符号"到"思想"的漫长征程

这项研究最深刻的洞察在于:AI和人类代表了两种截然不同的"智能"范式。

AI擅长统计可压缩性,走的是一条与人类认知根本不同的表征道路。它们像极了一个完美的图书管理员,能够以最高效的方式整理和存储信息,但可能缺乏对每本书深层内涵的真正理解。

人类认知则像一个睿智的哲学家,愿意承受表面上的"混乱"和"低效",因为这种复杂性恰恰是灵活应对复杂世界、进行深度推理和创新思考的基础。人类的"低效"实际上是高级智能的标志。

这种根本差异对AI发展具有深远意义。要实现真正类人的理解,我们需要超越当前主要基于规模扩展和统计模式匹配的范式。未来的努力应该探索明确培养更丰富、更细致概念结构的原理。

正如研究标题所暗示的,从"符号"到"思想"的进步,需要AI系统学会拥抱看似的"低效"——因为这种"低效"可能正是稳健、类人智能的标志。我们需要的不仅仅是能够高效处理信息的AI,更需要能够像人类一样灵活思考、深度理解和创造性推理的智能系统。

这项研究为我们提供了一个量化的框架来评估和指导AI向更类人理解方向发展,也提醒我们:真正的智能可能不在于完美的效率,而在于适应性的智慧。在AI快速发展的今天,理解这种差异对于构建既强大又可信赖的人工智能系统具有至关重要的意义。

论文标题:From Tokens to Thoughts: How LLMs and Humans Trade Compression for Meaning

论文链接:https://arxiv.org/abs/2505.17117