让 ChatGPT 服务器宕机,你参与了吗?

OpenAI 开发者日上新功能太火爆,服务器都挤爆了。

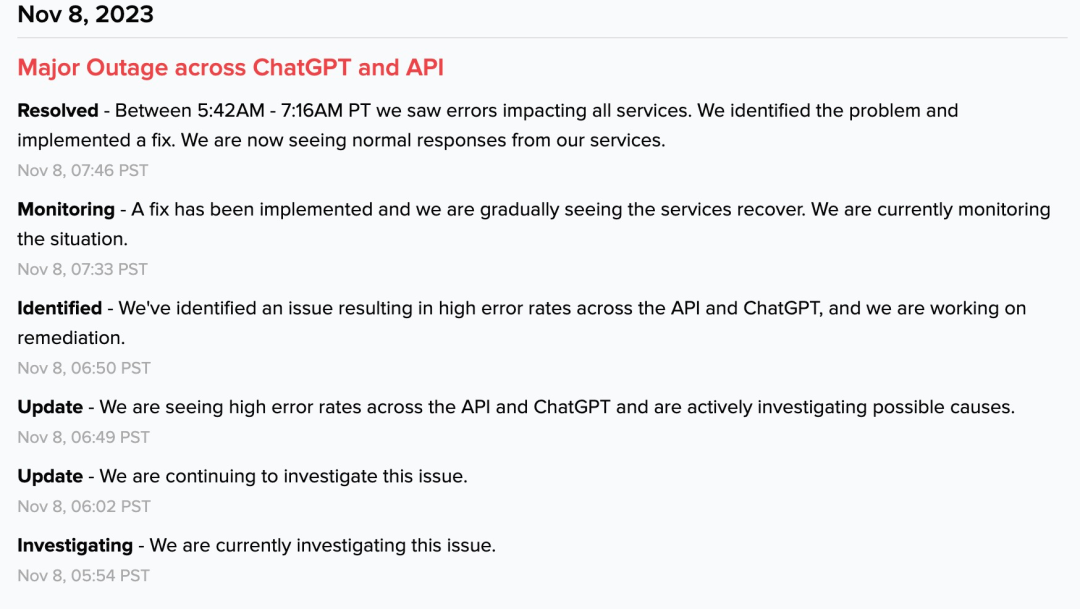

太平洋时间 11 月 8 日上午 6 点左右开始,ChatGPT 服务器宕机超过 90 分钟,用户访问会收到「ChatGPT 目前已满载(ChatGPT is at capacity right now)」的消息。

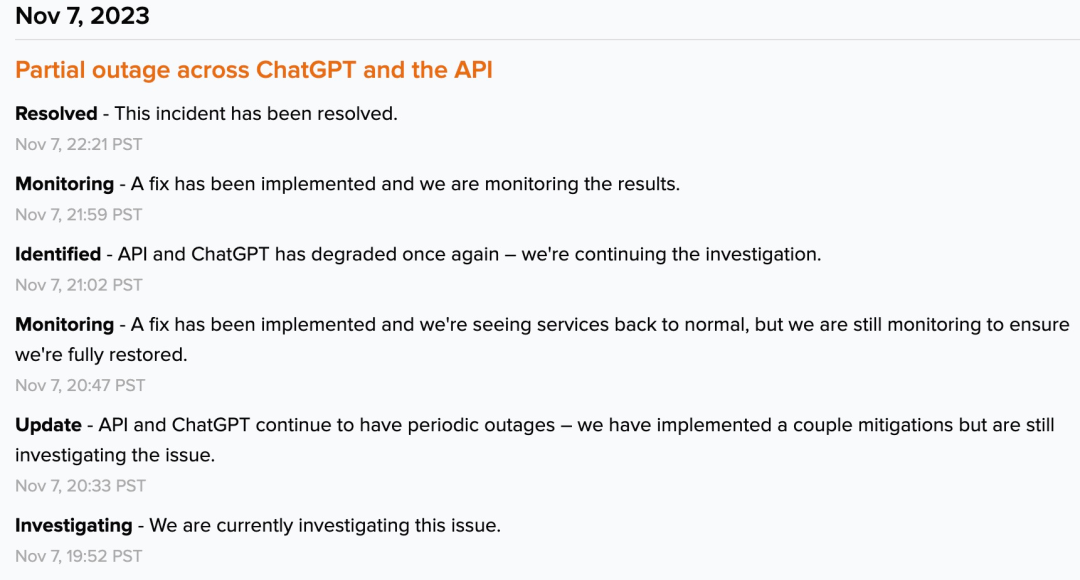

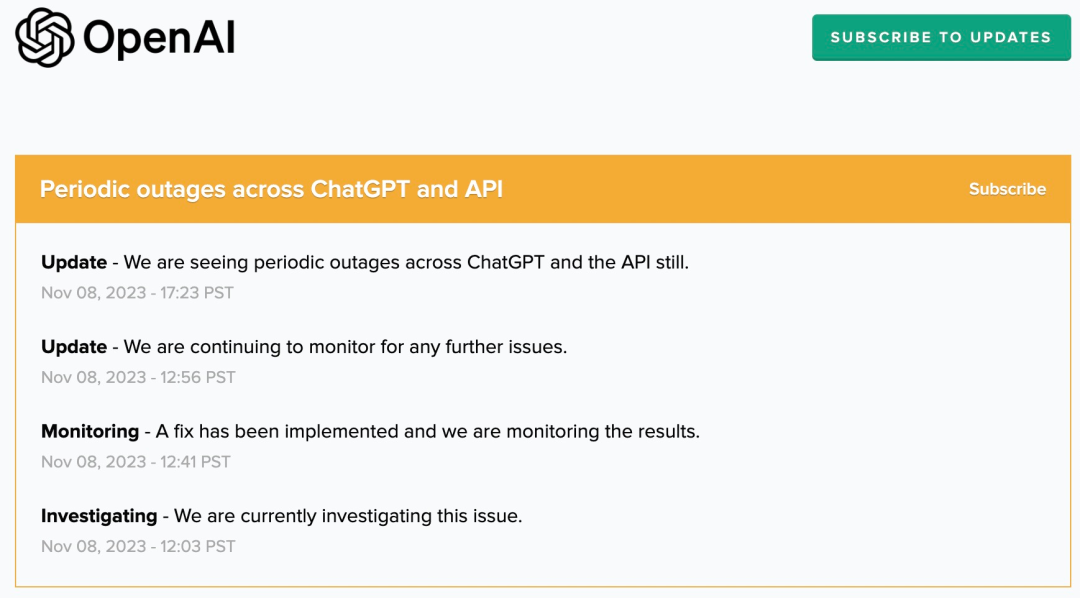

随后,OpenAI 接连发布两次「服务器中断」警告 —— 一次部分中断、一次全线中断,并称正在调查宕机原因,进行修复和监控。

最新状态显示:「ChatGPT 和 API 仍然会出现周期性中断。」

OpenAI 表示这是一次严重的服务器中断,也影响了该公司的 API 服务。

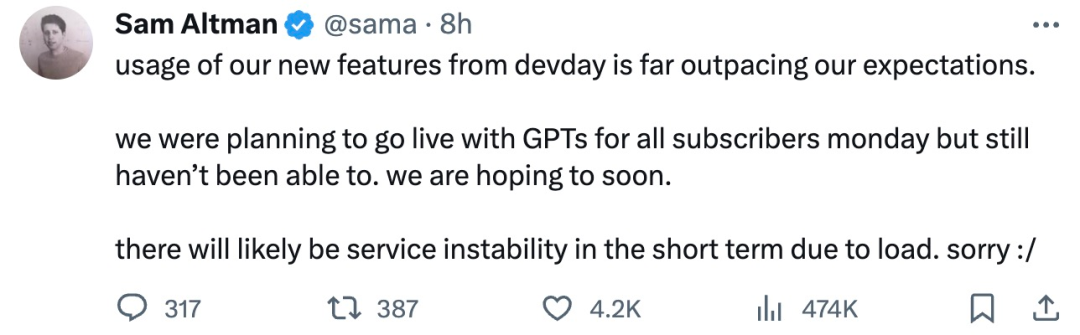

OpenAI CEO Sam Altman 对此次中断表示抱歉,并在推特上说道:「我们在开发者日发布的新功能的使用情况远远超出了预期。我们原计划周一为所有订阅者启用 GPT,但仍未能实现。我们希望尽快。由于负载的原因,短期内可能会出现服务器不稳定的情况。」

看来,开发者日上新功能的火爆程度是 Sam Altman 也没想到的。

在开发者大会上,OpenAI 宣布推出 GPT-4 Turbo、GPTs,让用户无需代码,结合自己的指令、外部知识和能力就可以创建自定义版本的 ChatGPT。

ChatGPT 发布近一年,其每周用户数量已经达到 1 亿,并有超过 200 万开发人员在 OpenAI 的 API 服务上进行开发,用户增长速度惊人。如今,功能大上新更是直接把服务器挤爆了。

网友反应也很快:「ChatGPT 宕机了,我的工作怎么办?」

还有网友开玩笑称:「ChatGPT 崩溃了,Stack Overflow 开心了。」

图源:https://twitter.com/2sush/status/1722457364283232760

既然服务器宕机了,我们再仔细看看 OpenAI 开发者日的内容吧,或许有两项发布,大家没有给予太多的关注。

Whisper-V3、Consistency Decoder 的开源也很给力

OpenAI 的首届开发者大会,实属把大家都震撼到了。在这过去短短的 48 小时的时间里,大家更多的把目光集中在了新模型 GPT-4 Turbo 的发布、GPTs 商店等内容上,现在愣是把服务器整崩了。

然而,在这场发布会之后,很多人都忽视了 2 个开源模型,如果你深入了解一下,它们和那些新产品一样令人兴奋,现在,这两个项目都在 GitHub 热榜上。

第一个是 Whisper-V3,被公认为目前最好的 OSS 语音识别模型,新版相比 Whisper-V2 有了重大改进。OpenAI 于 2022 年 12 月发布第一代 Whisper,支持语音识别、语音翻译等能力。短短不到一年的时间,现在已经进化到 Whisper-V3,值得一提的是,OpenAI 表示不久将推出 API。

项目地址:https://github.com/openai/whisper/

论文地址:https://arxiv.org/abs/2212.04356

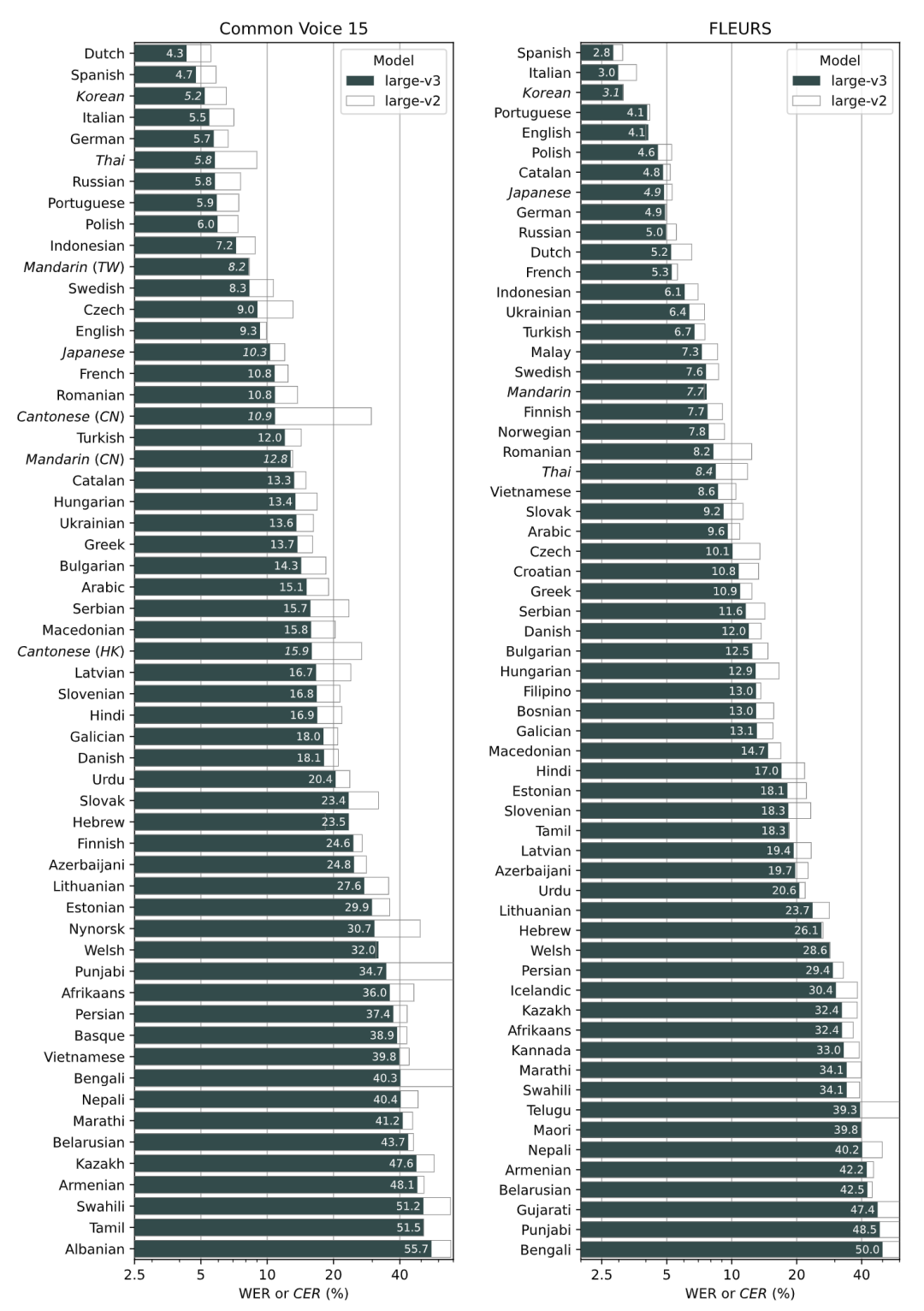

Whisper-V3(也称为 Large-v3)使用了 Large-v2 (Whisper-V2)收集的长达 100 万小时的弱标记音频和 400 万小时的伪标记音频进行训练而成。此外,相比前几代模型,Whisper-V3 在多种语言上显示出了较高的性能改进,下图为 Whisper-V3 在 Common Voice 15 和 Fleurs 上的性能表现:

被大家忽略的另一个重点是 OpenAI 开源了一个专门改进 AI 图像生成的研究 Consistency Decoder ,这项研究来自论文《 Consistency Models 》,作者阵容非常强大,有本科毕业于清华大学数理基础科学班、目前在 OpenAI 担任研究员的宋飏,还有 OpenAI 联合创始人、首席科学家 Ilya Sutskever 等都出现在论文作者列表里。

与热门的图像生成模型 Midjourney 、Stable Diffusion 等不同,OpenAI 认为扩散模型依赖于迭代生成过程,导致采样速度缓慢,进而限制了它们在实时应用中的潜力。因而他们创造性的提出了 Consistency Models,这是一类新的生成模型,无需对抗训练即可快速获得高质量样本。

项目地址:https://github.com/openai/consistencydecoder

论文地址:https://arxiv.org/pdf/2303.01469.pdf

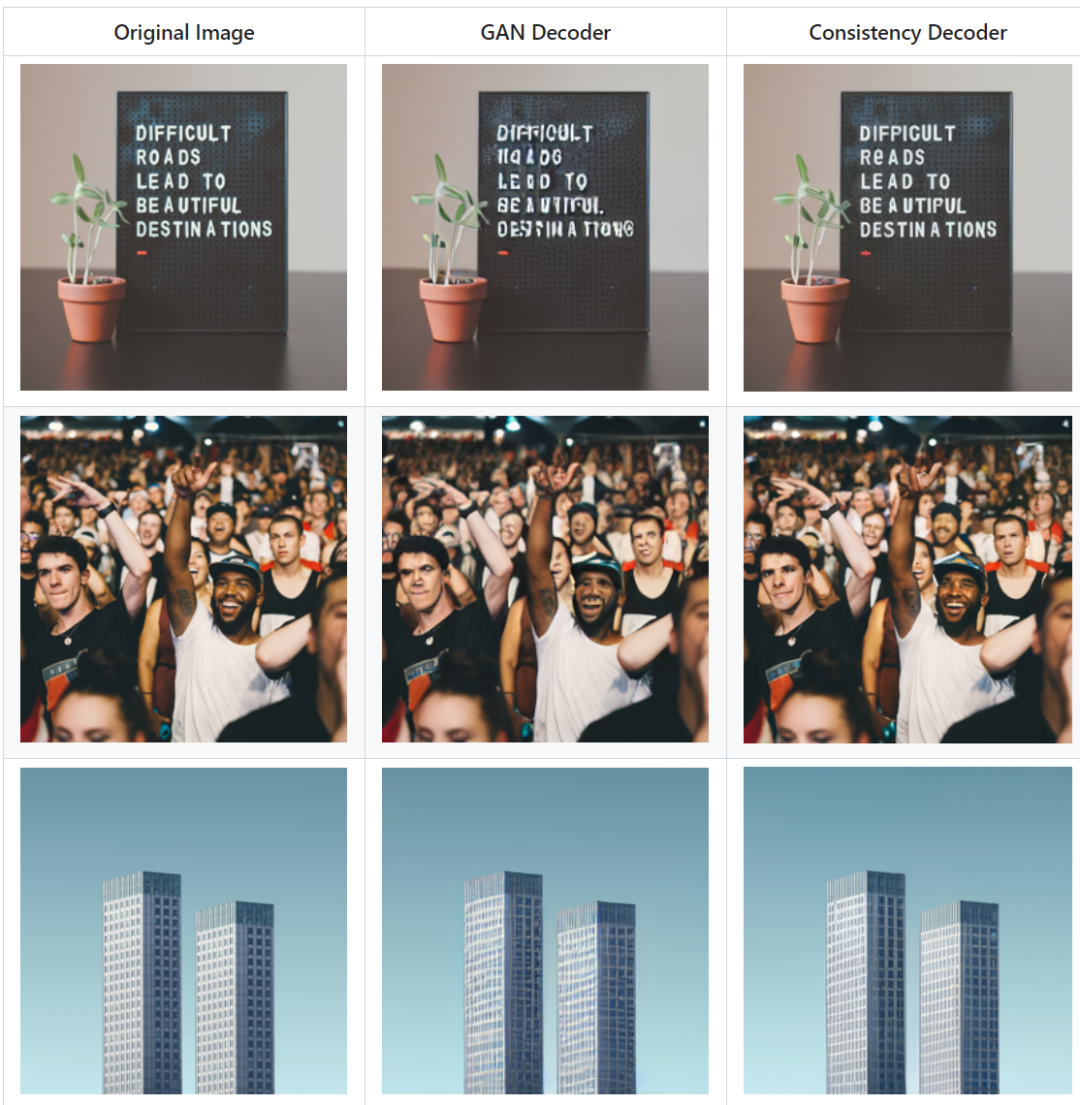

下图我们可以很直观的看到,Consistency Decoder 效果更好,能增加图像生成的稳定性和一致性,让生成的图像更加清晰和连贯,例如下图中人物眼部细节提升更加明显:

网友猜测,Consistency Decoder 就是 DALL・E 3 用到的解码器,以后生成惨不忍睹的人脸情况可能就不会发生了。

宋飏也证明了网友的猜测,「非常高兴发布 DALL・E 3 的 consistency decoder,这是一种 consistency 模型,可以以惊人的速度将 VQGAN 潜在图像转换为质量更高的图像!」

现在看来,OpenAI 的每一项发布都值得细细研究,这些技术都在各自的领域有着重要价值。

参考链接:

https://twitter.com/DrJimFan/status/1722281972641448426