Nous Research宣布正式推出Psyche,一个基于Solana区块链的去中心化AI训练网络,旨在让全球用户通过闲置计算资源参与尖端AI模型的开发。这一平台利用DisTrO技术大幅降低带宽需求,成功启动了有史以来规模最大的互联网分布式训练,目标是训练一个40亿参数的AI模型,并将所有数据和检查点完全开源。AIbase深入剖析Psyche的核心技术与愿景,揭示其对AI民主化的深远影响。

Psyche网络:全民AI开发的突破性平台

Psyche网络以去中心化为核心,打破了传统AI训练对集中式数据中心的依赖。平台通过Solana区块链协调全球分布式GPU,允许任何人贡献闲置计算资源参与模型训练。AIbase了解到,Psyche的首个重大任务是预训练一个40亿参数的Consilience模型,采用多头潜在注意力(MLA)架构,基于20万亿token的超大规模数据集(包括FineWeb14T、FineWeb-24T和The Stack v21T)。这是迄今为止互联网上最大规模的分布式AI训练,标志着去中心化AI开发的里程碑。

Nous Research强调,Consilience模型在设计上兼顾高效性和可访问性。其40亿参数规模使其能够在单一H/DGX服务器上训练,或在消费级RTX3090GPU上运行推理,同时支持长上下文处理,为高级推理和创意应用奠定了基础。AIbase认为,这一规模的选择精准平衡了性能与普惠化目标,为中小型团队和个人开发者提供了强大工具。

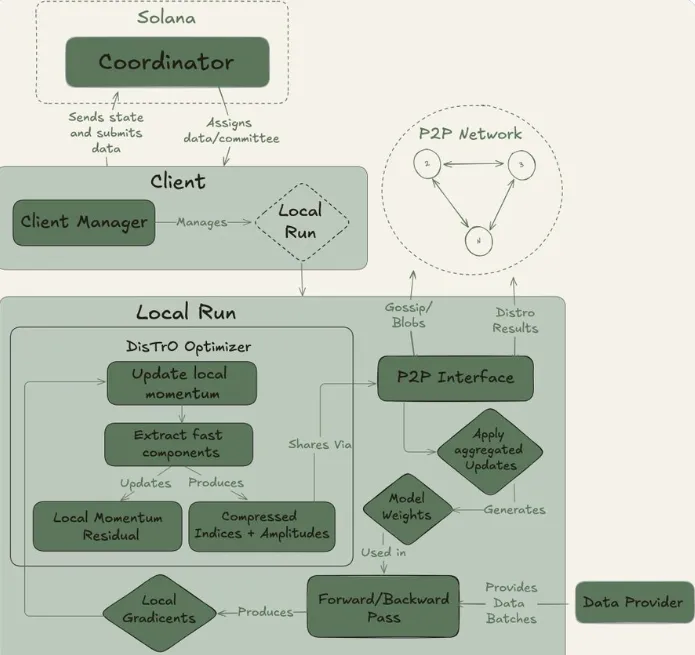

技术内核:DisTrO与Solana的协同创新

Psyche网络的成功离不开Nous Research的DisTrO(Distributed Training Over-the-Internet)技术。这项技术通过优化器创新,将GPU间通信数据量压缩1000至10000倍,类似JPEG图像压缩的频率域转换原理。AIbase分析,DisTrO允许每个节点独立训练而无需每步同步,显著降低网络延迟和带宽需求,使全球异构硬件(如RTX4090、A100、H100)能够协同工作。

Solana区块链在Psyche中扮演了协调中枢的角色。智能合约存储训练元数据、参与者列表和随机分配任务,确保训练过程透明、防篡改和抗审查。AIbase注意到,Solana的高吞吐量和低交易成本使其成为处理分布式训练微交易的理想平台,进一步增强了Psyche的全球可扩展性。

开源与社区驱动:AI开发的民主化

Psyche致力于通过完全开源推动AI普惠化。所有训练数据、检查点和结果都将公开分享,托管于Hugging Face和GitHub,供全球开发者免费访问。AIbase获悉,Psyche的代码已开放,开发者可通过Rust-based系统和P2P网络参与优化,或基于开放文档构建自定义应用。

Nous Research计划进一步扩展Psyche功能,包括支持模型微调和社区数据输入,允许小型团队甚至个人定制专属AI模型。例如,社区可通过上传领域特定数据,训练适用于教育、医疗或创意领域的模型。AIbase预测,这种社区驱动的模式将激发全球创新,挑战OpenAI、DeepSeek等集中式AI巨头的垄断地位。

行业影响:去中心化AI的崛起

Psyche的发布标志着去中心化AI进入快速发展阶段。AIbase分析,与传统云端AI相比,Psyche的分布式架构不仅降低了训练成本,还通过区块链激励机制将算力贡献从“捐赠”转为“交易”,吸引了广泛参与。2024年12月,Psyche成功完成了一项150亿参数模型的测试训练,跨越1.1万步,验证了其在全球网络中的稳定性。

2025年4月,Nous Research获得Paradigm领投的5000万美元A轮融资,估值达10亿美元,进一步加速了Psyche的开发。AIbase注意到,测试网启动仅44分钟,项目便通过捐款筹集了50万美元的GPU算力,显示了社区对Psyche的高度热情。

AI普惠化的转折点

作为AI领域的权威媒体,AIbase认为,Psyche的推出不仅是Nous Research的里程碑,也是去中心化AI的转折点。其结合DisTrO和Solana的创新架构,为全球开发者提供了参与AI开发的机会,打破了技术和资源壁垒。尤其值得关注的是,Psyche对中国AI社区的潜在影响,国产模型如Qwen3或可通过其开源框架实现更高效的本地化微调。