资讯列表

OpenAI CEO批评礼貌语言浪费:与AI对话不需要“请”和“谢谢”

OpenAI的首席执行官萨姆·奥特曼(Sam Altman)近日提出了一个具有挑战性的观点,称与ChatGPT这样的聊天机器人使用礼貌语言,如“请”和“谢谢”,实际上是一种浪费,耗费了大量的电力和计算资源。 奥特曼指出,尽管许多人认为与人工智能保持礼貌是一种文化上的必要行为,或者有助于提升交互质量,但这种做法却无形中增加了人工智能系统的负担。 每次使用礼貌语言时,聊天机器人不仅要识别和处理这些词汇,还需要生成长而复杂的回应,所有这些都需要大量的计算资源和电力支持。

MCP安全检查清单:用于MCP的安全检查和理解MCP交互流程

想象一下,你辛辛苦苦训练出一个聪明绝顶的 AI 大模型,它能帮你处理各种复杂的任务。 但是,如果通往这个聪明大脑的“管道”——也就是模型上下文协议(MCP)——不够安全,那岂不是给黑客们留下了可乘之机? 别担心!由区块链安全领域的专家 SlowMist(慢雾科技) 倾力打造的 MCP 安全检查清单,就像一个专业的“AI 神盾局”,它为基于 MCP 的 AI 工具提供了一份全面的安全指南,旨在保护你的 LLM 插件生态系统免受各种潜在威胁。

Vifa 发布 Helsinki 2.0 便携音箱,内置 ChatGPT 智能助手

近日,丹麦音响制造商 Vifa 正式宣布,旗下首款搭载 ChatGPT AI 助手的智能音箱 Helsinki2.0已经完成预研,即将在海外市场推出。 这款便携音箱的推出不仅提升了音响的智能化程度,更为用户提供了个性化的听觉体验。 Helsinki2.0的设计旨在为用户创造一个更加智能和便捷的音乐环境。

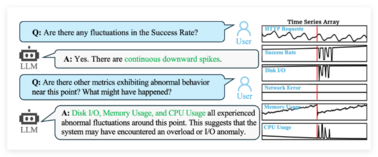

字节跳动研究开源 ChatTS-14B:原生理解并随着时间的推移进行推理

字节跳动研究团队宣布开源 ChatTS-14B,这是一款专为时间序列数据理解和推理设计的140亿参数大型语言模型(LLM)。 以 Apache2.0许可协议发布,ChatTS-14B 的开源引发了 AI 社区的广泛关注,被认为是时间序列分析与生成式 AI 结合的重大进展。 ChatTS-14B:时间序列的智能对话引擎ChatTS-14B 基于 Qwen2.5-14B-Instruct 模型进行微调,专为处理时间序列数据而设计,能够理解和推理复杂的时序数据模式。

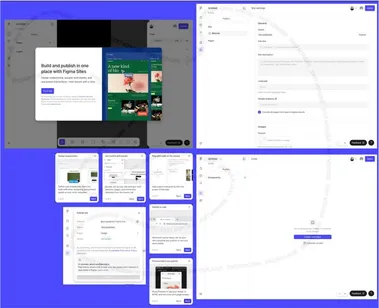

Figma 推 AI 革命:开发智能应用制作器与网站创建工具

近日,设计界巨头 Figma 正悄然布局人工智能领域,计划推出一款颠覆性的 AI 应用程序制作器,并同步开发一款名为 Figma Sites 的网站创建工具。 这一消息由知名安全研究员 Jane Manchun Wong 率先披露,引发行业广泛关注。 AI 应用程序制作器:设计与开发的智能融合据悉,这款工具能够接受多种输入形式,包括文本提示、Figma 设计文件以及图像等,展现出高度灵活性。

阿联酋首创:人工智能助力法律制定速度提升 70%

阿联酋近期宣布将首次利用人工智能技术参与法律的撰写工作,旨在大幅提高法律制定的效率。 据悉,这一创新举措预计能将法律草案的制定时间缩短多达70%。 在阿联酋的法律框架内,政府希望借助 AI 的强大分析能力,快速生成符合现代社会需求的法律文本。

Google 智能眼镜亮相 TED2025:Gemini AI 助力未来可穿戴技术

在可穿戴技术的竞争日益激烈之际,智能眼镜正在成为下一个重要的科技前沿。 科技巨头们纷纷加紧研发自己的智能眼镜产品,其中 Google 最近在 TED2025大会上展示了其最新的 Android XR 智能眼镜,令人耳目一新。 在之前的展示中,Google 的 Android XR 眼镜只是在特定场合下进行了短暂的预览,令人对其实际表现充满疑问。

2027 年 AGI 预测: 24 个月内AI即可达到人类水平

随着人工智能技术的迅速发展,关于未来的预测越来越引人关注。 最新发布的《AI2027》场景报告,由来自 OpenAI 和人工智能政策中心等机构的研究人员和预测专家团队共同编制,提供了为期2到3年的详细预测,描绘了人工智能领域即将达到的技术里程碑。 图源备注:图片由AI生成,图片授权服务商Midjourney该报告提出了一个令人瞩目的预测:到2027年,人工通用智能(AGI)将实现,而人工超级智能(ASI)将紧随其后。

医疗AI新星每因智能获千万融资,致力于精准疾病风险预测

近日,杭州的医疗 AI 公司每因智能科技有限公司宣布完成千万元级种子轮融资,资金将主要用于其核心产品的研发及商业化落地。 此次融资由卓源亚洲等机构领投,西湖政府直投基金也进行了跟投。 每因智能专注于运用人工智能技术来预测疾病风险,推动健康管理。

Netflix推全新 AI 搜索功能,用户可通过自然语言搜索

Netflix 近日开始测试一项全新的 AI 搜索功能,这一功能基于 OpenAI 的技术,旨在提升用户在流媒体平台上的内容发现体验。 用户将能够通过自然语言来搜索影片,不再局限于传统的按类型或演员进行搜索。 据彭博社的报道,这项新功能能够理解用户更具体的需求,包括他们的观影心情。

OpenAI o3 模型测试成绩遭质疑,实际表现远低于宣传

近日,OpenAI 推出的 o3人工智能模型在基准测试中的表现引发了广泛争议。 尽管 OpenAI 在去年12月首次发布 o3时自信地宣称该模型在极具挑战性的 FrontierMath 数学问题集上能够正确回答超过四分之一的问题,但这一声称与最近的独立测试结果形成鲜明对比。 Epoch 研究所对 o3模型进行了独立测试,结果显示该模型的实际得分仅为10%,远低于 OpenAI 之前所宣称的25%。

可信AI技术获中国电子学会科技进步一等奖,蚂蚁数科助力破解大模型应用“安全可信”难题

4月19日,2024年度中国电子学会科学技术奖在第十八届中国电子信息年会揭晓并颁奖,由清华大学、北京中关村实验室和蚂蚁集团等单位共同完成的联合项目《高效协作的互联网动态行为安全可信关键技术与应用》荣获科技进步奖一等奖。 近年来,网络环境日益复杂,恶意流量攻击和隐蔽未知应用风险在互联网中泛滥,如何构建一个更安全可信的互联网环境,成为学术界和产业界的共同追求。 由清华大学、北京中关村实验室及蚂蚁集团等联合提出的“高效协作的互联网动态行为安全可信关键技术”,创新提出了分层传递和高效求解的智能协作体系技术思路,通过模型表达、知识共享和应用支撑,在实现安全信息获取、传递和协作的同时,显著提升了互联网应对未知应用风险的能力。

清华张亚勤:10年后,机器人将可能比人都多

“10年后,机器人将可能比人都多,会陆续进入工厂、社会,最终形态是进入家庭。 未来每个人、每个家庭都有机器人。 ”这样的预言,来自清华大学智能产业研究院(AIR)院长张亚勤。

OpenAI爆出硬伤,强化学习是祸首!o3越强越「疯」,幻觉率狂飙

满血o3更强了,却也更爱「胡言乱语」了。 OpenAI技术报告称,o3和o4-mini「幻觉率」远高于此前的推理模型,甚至超过了传统模型GPT-4o。 根据PersonQA基准测试,o3在33%的问题回答中产生了幻觉,几乎是o1(16%)的2倍。

全球首个:阿联酋尝试用 AI 制定和修改法律

阿联酋正尝试利用AI技术制定和修改法律,成立监管智能办公室推进相关工作。AI将定期提出立法更新建议,预计使立法速度加快70%。然而,专家警告AI可能存在偏见和可靠性问题。#AI立法# #阿联酋科技#

杀疯了!Gemini 2.5狂飙「高尔顿板」测试,编码横扫所有OpenAI模型

编码能力一直是顶尖模型宣传的重点。 尤其是,AI大神Karpathy带火vibe coding(氛围编程)概念后,普通人也可以通过AI体验到编程的乐趣。 游戏、网页、3D建模,再加上最近爆火的MCP协议,大家玩得不亦乐乎。

文科已死,计算机科学将亡?ACM警告:不想被AI团灭,关键在融合新生

GenAI日新月异,引发了大众选择职业和大学专业的焦虑。 但最近,美国的国际计算机协会(Association for Computing Machinery,ACM),发布了一篇博客文章,表示:文科和计算机科学,这两个专业最后可能合流,融合在一起才能存活。 在哲学中,「存在危机」指的是质疑自己人生目的、意义和在世界中位置的状态。

Transformer+Mamba黄金组合!长文推理性能飙升3倍,性能还更强

过去几年,Transformer虽稳坐AI架构「铁王座」,但其二次方复杂度带来的算力消耗和长序列处理瓶颈,限制了大模型在推理阶段处理长文本。 Mamba凭借「线性复杂度」异军突起,非常适合长序列任务,有望成为Transformer架构的替代品,但在处理全局关系上偏弱。 Mamba Transformer混合架构可以将二者的优势互补,实现「效率」和「性能」的双丰收。