Liquid AI近日在国际学习表示会议(ICLR)2025前发布了新款模型 “Hyena Edge”。这是一款基于卷积的多混合模型,旨在为智能手机及其他边缘设备提供更高效的人工智能解决方案。该公司成立于波士顿,源自麻省理工学院(MIT),致力于超越目前大多数大型语言模型(LLM)所依赖的 Transformer 架构。

Hyena Edge 在计算效率和语言模型质量方面均表现出色。根据实测数据,在三星 Galaxy S24Ultra 手机上,Hyena Edge 的延迟更低,内存占用更少,并且在各项基准测试中表现优于相同参数的 Transformer++ 模型。这一新架构的设计标志着边缘人工智能技术的新纪元。

与市面上大多数为移动部署设计的小型模型不同,Hyena Edge 放弃了传统的重注意力设计,取而代之的是利用 Hyena-Y 系列的门控卷积,替换了三分之二的分组查询注意力(GQA)操作。Hyena Edge 的架构源于Liquid AI的 “定制架构合成”(STAR)框架,该框架通过进化算法自动设计模型结构,以优化延迟、内存使用和模型质量等多个硬件特定目标。

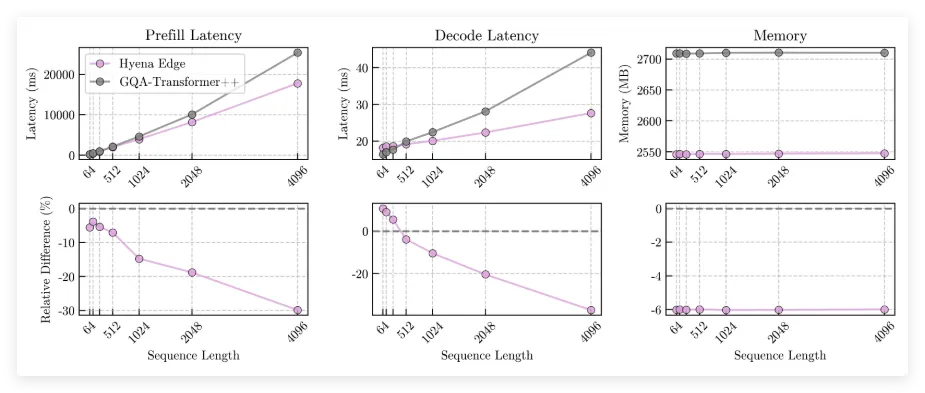

为验证 Hyena Edge 的实际应用能力,Liquid AI在三星 Galaxy S24Ultra 上进行了测试,结果显示该模型在较长序列长度下的预填充和解码延迟速度比 Transformer++ 快了30%。同时,在所有测试的序列长度下,Hyena Edge 的内存使用量均低于传统模型,这使其成为资源受限环境中的理想选择。

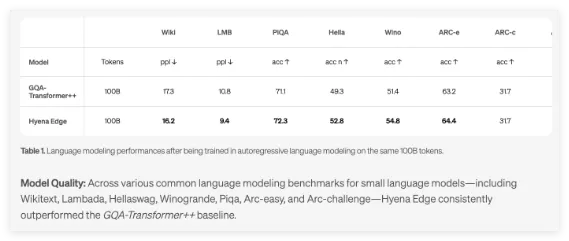

在基准测试方面,Hyena Edge 在1000亿个标记上进行了训练,并在包括 Wikitext、Lambada、PiQA、HellaSwag、Winogrande、ARC-easy 和 ARC-challenge 在内的多个标准小型语言模型测试中表现出色,尤其在 Wikitext 和 Lambada 的困惑度评分上有显著提高,PiQA、HellaSwag 和 Winogrande 的准确率也有所提升。

Liquid AI还计划在未来几个月内开源一系列Liquid基础模型,包括 Hyena Edge,旨在构建能够从云数据中心扩展到个人边缘设备的高效通用人工智能系统。Hyena Edge 的成功不仅在于其卓越的性能指标,更展示了自动化架构设计的潜力,为未来的边缘优化人工智能设定了新的标准。

官方博客:https://www.liquid.ai/research/convolutional-multi-hybrids-for-edge-devices

划重点:

🌟 Hyena Edge 是Liquid AI公司推出的新型卷积模型,专为智能手机等边缘设备设计。

🚀 该模型在计算效率和内存使用上优于传统的 Transformer++ 模型,适合资源受限的环境。

📈 Hyena Edge 在多个标准语言模型基准测试中表现卓越,并计划在未来开源以促进技术普及。