刚刚,谷歌Veo 3进行了更新,最新版本Veo 3.1,可以在这里体验

https://labs.google/fx/zh/tools/flow

目前免费用户每月提供100积分,fast模式每次生成耗费20积分,相比sora 2 看起来贵很多,sora 2到目前为止都是无限制生成,完全免费

我第一时间就做了一个Veo 3.1和sora 2的初步对比测试,测试下来,Veo 3.1审美以及提示词遵循能力还是不如sora 2,不过好处是,Veo 3.1支持上传人像进行创作,sora 2 目前图生视频不支持人像

废话不多说,看玩法:

上手测试

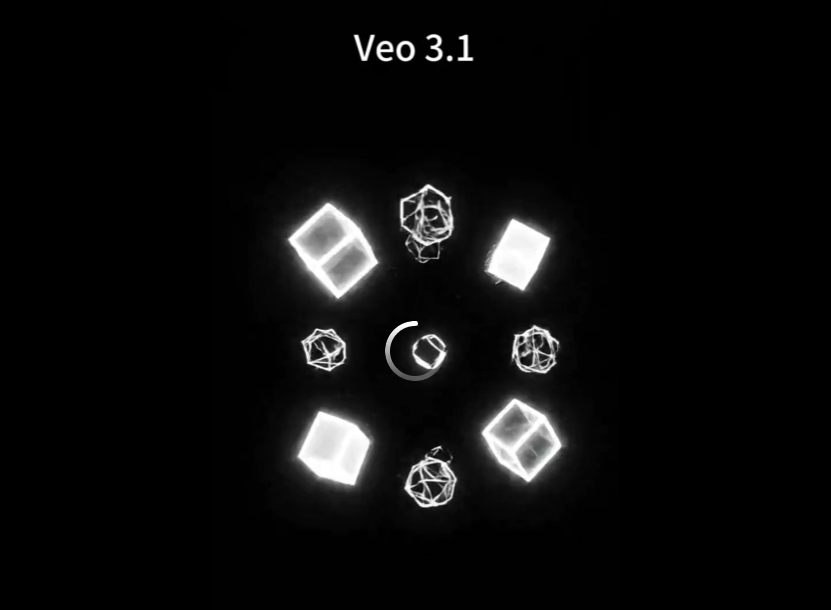

1.图生视频:nanobanana + Veo 3.1

先用nanobanana生成一个超高清小姐姐

提示词:

复制进入:

https://labs.google/fx/zh/tools/flow

上传生成的图片,提示词:展示穿搭。Veo 3.1生成效果如下:

在展示一个(需要图像提示词私我,太长了,这里就不放了):

总之利用nanobanana强悍的生图能力加上Veo 3.1图生视频可以批量的生成各种动视小姐姐了,非常逼真

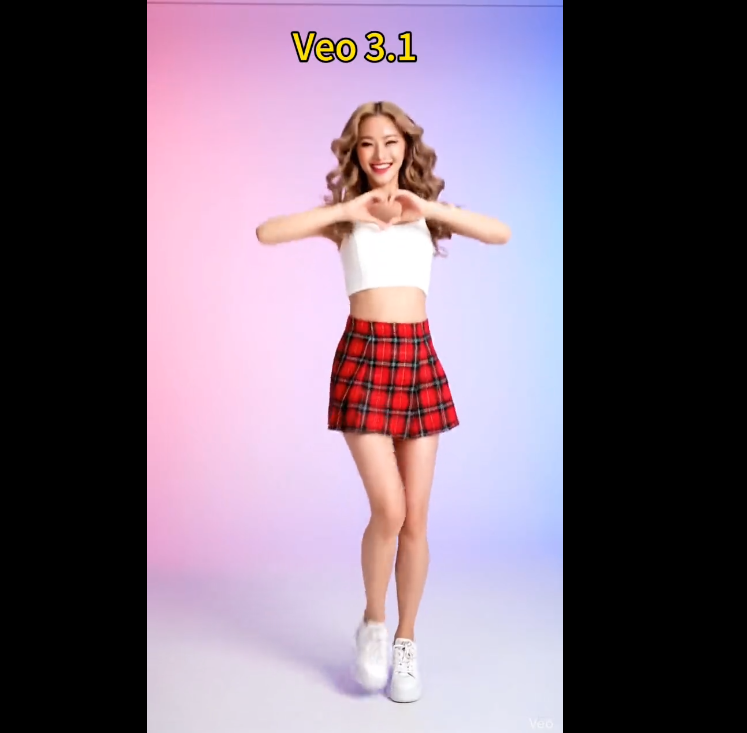

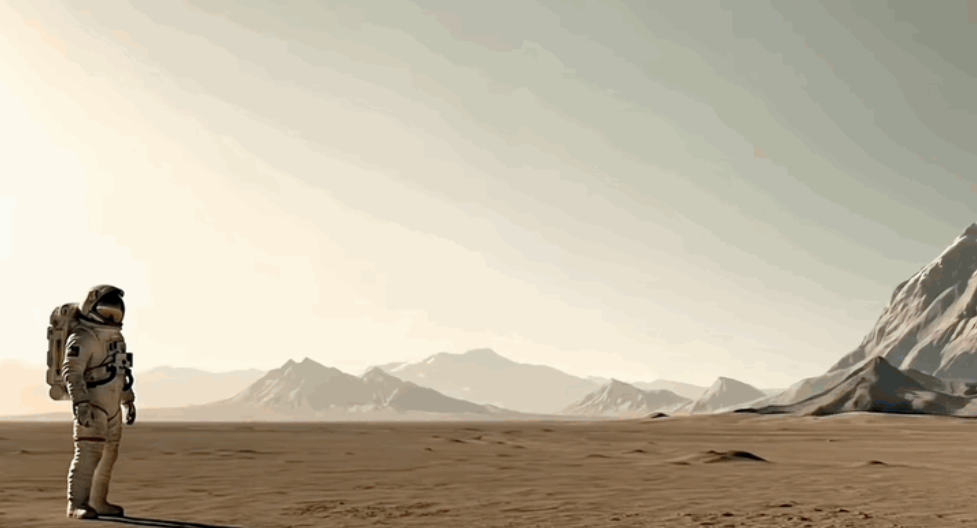

2.Veo 3.1文生视频

文生视频,我对比了一下sora 2,感觉确实还差了点,提示词都是一一样的:

复制Veo 3.1 vs sora 2生成对比:sora 2审美感觉还是比较高级,特别像日式动漫,怪不得被日本投诉版权

复制Veo 3.1 vs sora 2生成对比:Veo 3.1的音乐和图像变化不能匹配

Veo 3.1 vs sora 2生成对比:这是按秒定制舞蹈动作视频,Veo 3.1会丢失某些动作

Veo 3.1更新的核心功能详情

自五个月前谷歌推出由Veo驱动的Flow以来,用户已经生成了超过2.75亿个视频。基于用户的反馈,本次更新的核心是赋予用户更强的艺术控制力和跨所有功能的音频支持。

新发布的Veo 3.1模型,在前代基础上实现了更丰富的音频、更强的叙事控制和更高的真实感,能够捕捉逼真的纹理。它在将图像转换为视频时,也拥有更强的提示词遵循能力和视听质量

与此同时,谷歌的AI电影制作工具Flow也迎来一系列高级功能,旨在为创作者提供更强的创意控制、音频支持和后期编辑能力

1.三大创意新功能,全面支持音频

Veo 3.1为Flow带来了更完善的场景构建能力,并将音频生成能力扩展到了多个核心功能中,现在,用户可以通过以下带有音频生成的功能来完善叙事:

打造场景外观:通过“视频配料 (Ingredients to Video)”功能,用户可以使用多张参考图像来控制角色、物体和风格。Flow会利用这些“配料”生成一个与用户设想完全一致的最终场景

控制镜头 :通过“起止帧生视频”功能,用户可以提供第一帧和最后一帧,Flow将生成一个无缝衔接两者的视频,非常适合创作艺术性和转场效果

创建更长的无缝镜头:通过“扩展 (Extend)”功能,用户可以创作时长达到一分钟甚至更长的视频。每个新生成的视频片段都基于前一个片段的最后一秒内容,从而延续原始片段的动作,对于创建长镜头或建构镜头非常有用

2.两个编辑新功能,实现更精准修改

为了帮助用户在创作过程中随时修改和完善场景,Flow直接内置了新的编辑功能。

任意添加新元素:使用“插入 (Insert)”功能,可以向场景中添加任何想象中的事物,从现实细节到奇幻生物。Flow现在可以处理复杂的细节,如阴影和场景光照,使添加的元素看起来更自然

无缝移除多余物体 :即将上线。用户将能够从场景中移除任何物体或角色,Flow会自动重建背景和周围环境,使其看起来就像被移除的物体从未存在过一样

3.使用

目前,由Veo 3.1驱动的、具备更强编辑能力和音频支持的更新已在Flow中提供,此外,Veo 3.1模型也通过以下渠道提供:

Gemini API (面向开发者)Vertex AI (面向企业客户)Gemini app

需要注意的是,新功能在不同平台的可用性存在差异:

视频配料、起止帧生视频和场景扩展功能即将登陆Gemini API。而添加物体和移除物体功能目前在该API上不可用,场景扩展功能即将登陆Vertex AI API