视频生成技术正以前所未有的速度革新着当前的视觉内容创作方式,从电影制作到广告设计,从虚拟现实到社交媒体,高质量且符合人类期望的视频生成模型正变得越来越重要。

那么,要如何评估AI生成的视频是否符合人类的审美和需求呢?

Video-Bench视频评估框架,能够通过模拟人类的认知过程,建立起连接文本指令与视觉内容的智能评估体系。

简单地说,能够让多模态大模型(MLLM)“像人一样评估视频”。

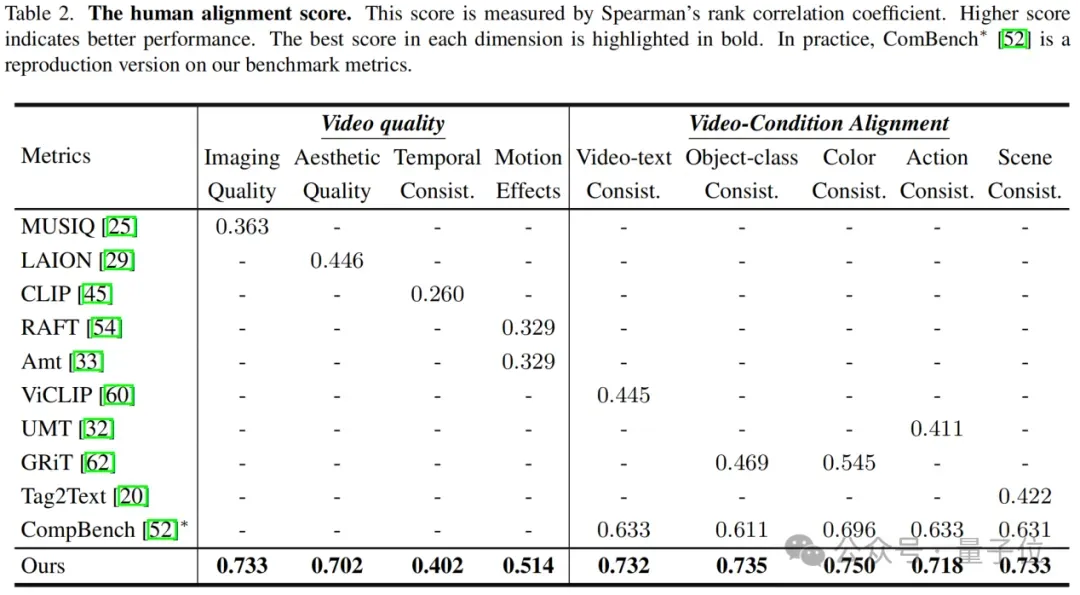

实验结果表明,Video-Bench不仅能精准识别生成视频在物体一致性(0.735相关性)、动作合理性等维度的缺陷,还能稳定评估美学质量等传统难题,显著优于现有的评估方法。

Video-Bench的研究团队来自上海交通大学、斯坦福大学、卡内基梅隆大学等机构。

Video-Bench:基于MLLM的自动化视频评估框架

Video-Bench团队在面对已有的视频评估方法时,发现了两个问题:

1.简单的评分规则往往无法捕捉视频流畅度、美学表现等复杂维度——

那么,当评判“视频质量”时,如何将人类出于“直觉”的模糊感受转化为可量化的评估指标?

2.现有基于大语言模型(Large Language Model,LLM)的基准虽能更好模拟人类评估逻辑,但在视频-条件对齐评估中存在跨模态比较困难,在视频质量评估中则面临文本评价标准模糊化的局限——

那么,评估”视频是否符合文字描述”时,评估系统如何实现跨模态对比?

针对上述的两个问题,Video-Bench作出了两点核心创新:

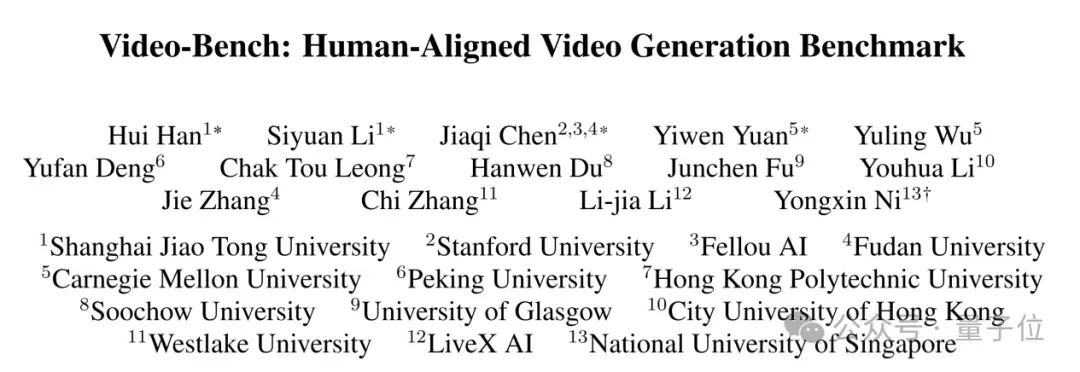

(1)系统性地构建了覆盖视频-条件对齐(Video-Condition Alignment)和视频质量(Video quality)的双维度评估框架。

(2)引入了链式查询(Chain-of-Query)和少样本评分(Few-shot scoring)两项核心技术。

链式查询通过多轮迭代的”描述-提问-验证”流程,有效解决了文本与视频跨模态对齐的评估难题;少样本评分则通过多视频对比建立相对质量标尺,将主观的美学评判转化为可量化的客观标准。

这样的功能设计使Video-Bench突破了现有视频质量评估方法的限制,能够更全面、更智能地对视频进行评分。

更全面、更智能

一方面,Video-Bench将视频生成质量解构为“视频-条件对齐”和“视频质量”两个正交维度,分别评估生成内容与文本指令的符合度以及视频本身的观感质量。

视频-条件一致性关注评估生成的视频是否准确地反映了文本提示中的内容,包括以下几个关键维度对象类别一致性、动作一致性、颜色一致性、场景一致性、视频-文本一致性;

视频质量的评估则侧重于视频本身的视觉保真度和美学价值。包括成像质量、美学质量、时间一致性、运动质量。

这种双维度的评估框架能使Video-Bench全面覆盖视频生成的各个要素,在评估视频是否“保真”的同时,关注到视频的美观程度。

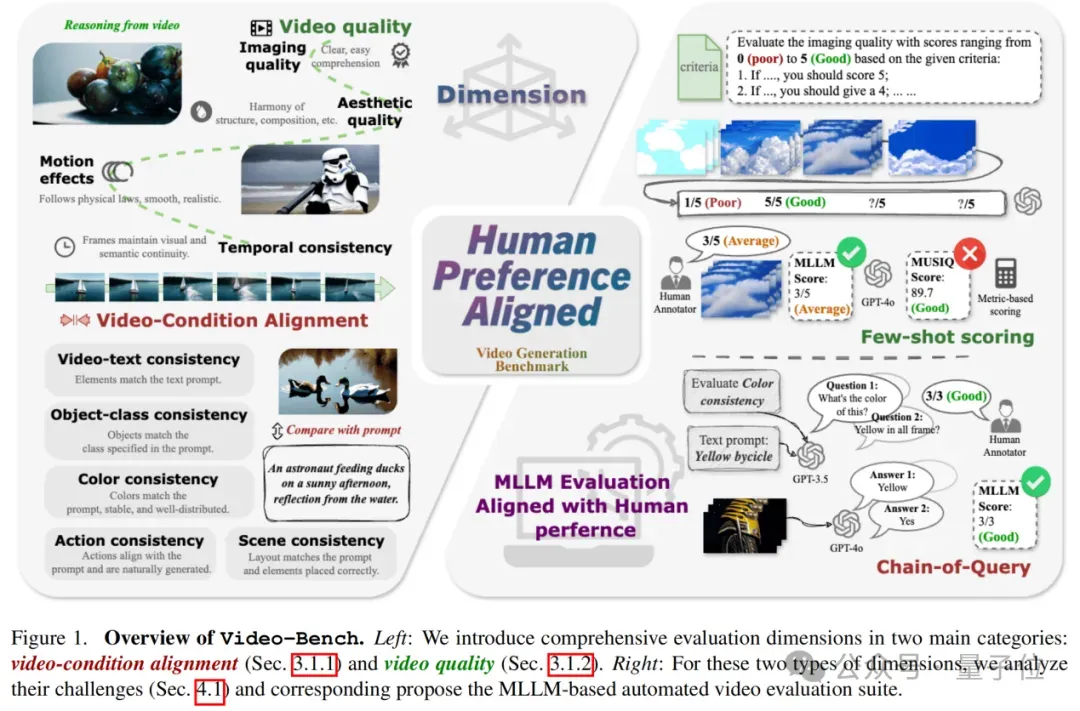

另一方面,Video-Bench的评估框架利用多模态大语言模型(Multimodal Large Language Model,MLLM)的强大能力,通过链式查询技术和少样本评分技术,实现对视频生成质量的高效评估:

(1)链式查询技术:通过多轮问答的方式,逐步深入地评估视频与文本提示之间的一致性。

这种方法避免了直接的跨模态比较,而是先将视频内容转换为文本描述,然后通过一系列精心设计的问题,逐步检查视频内容是否与文本提示完全一致,有效解决了跨模态对比的语义鸿沟问题。

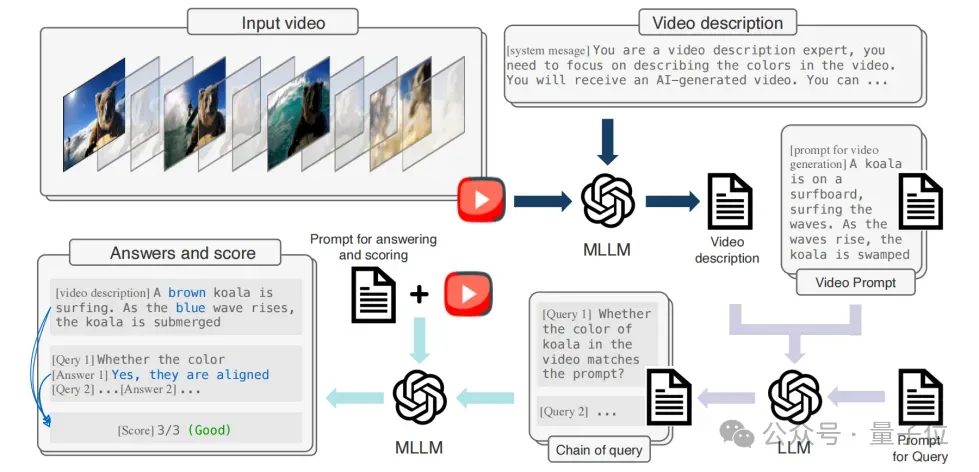

(2)少样本评分技术:模仿人类横向比较的本能,通过同时对比多个同主题视频,使抽象的美学评价变得可量化。

例如在评估”电影感”时,Video-Bench会横向比较不同生成结果的运镜流畅度、光影层次感,而非孤立打分。

“像人一样评估视频”

将Video-Bench与当前主流评估方法进行系统性对比,可以看到,在视频-条件对齐维度,Video-Bench以平均0.733的Spearman相关系数显著优于传统方法CompBench;在视频质量维度,其0.620的平均相关性同样领先EvalCrafter。

此外,在对象类别一致性这一关键指标上,Video-Bench达到0.735的相关性,较基于GRiT的方法提升56.3%。

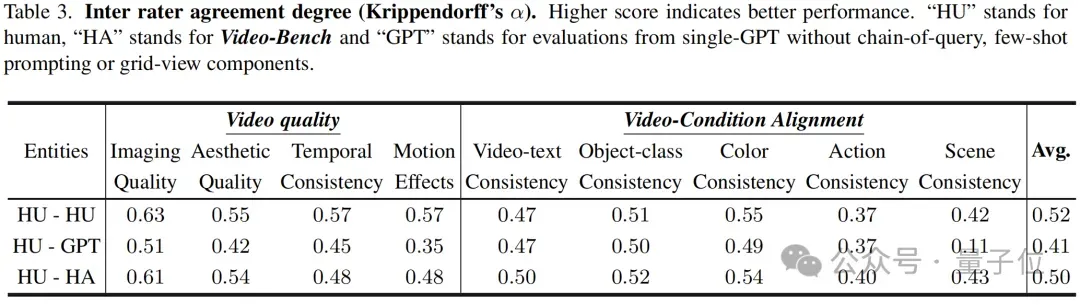

为验证评估结果的可靠性,Video-Bench还组织了10人专家小组对35,196个视频样本进行标注。

对齐结果显示,评估者间一致性(Krippendorff’s α)达0.52,与人类自评水平相当。

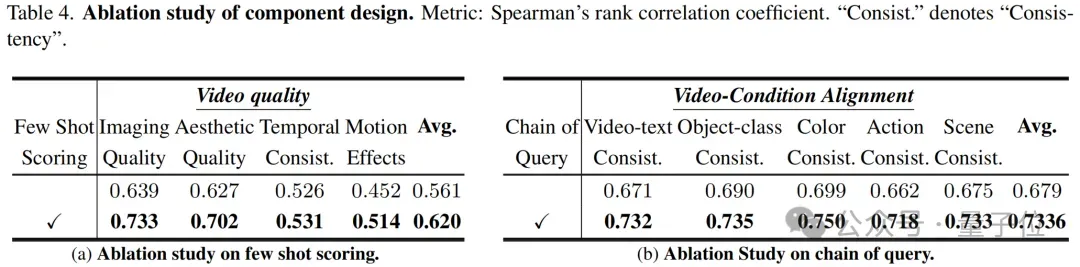

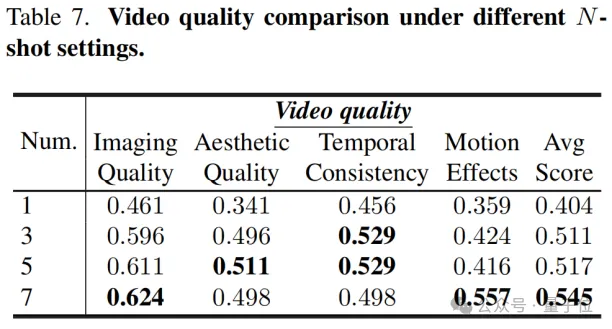

通过组件设计的消融实验,可以看到,链式查询使视频-条件对齐评估提升了9.3%,少样本评分将成像质量评估相关性从46.1%(单样本)提升至62.4%(7样本)。

组合使用两项技术时,评估稳定性(TARA@3)达67%,Krippendorff’s α达0.867,验证了这些组件设计的有效性。

鲁棒性测试结果发现,添加高斯噪声后,Video-Bench的视频-文本一致性评估误差<5%,且三次重复实验的评分一致性达87%,对不同复杂度提示的评估稳定性优于基线方法32%。

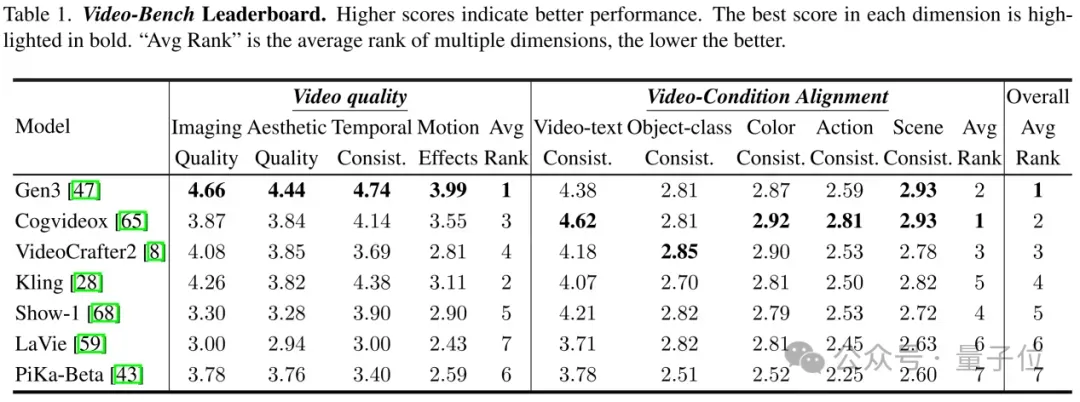

现有视频生成模型的测评结果

使用Vedio-Bench对7个主流视频生成模型进行测评,结果发现,商业模型整体优于开源模型(Gen3综合得分4.38v.s.VideoCrafter2综合得分3.87),不同模型存在显著特长差异(如CogVideoX在视频-文本一致性领先,而Gen3在成像质量最优)。

总体来看,当前的模型在动作合理性(平均2.53/3)和动态模糊(3.11/5)等动态维度表现较弱。

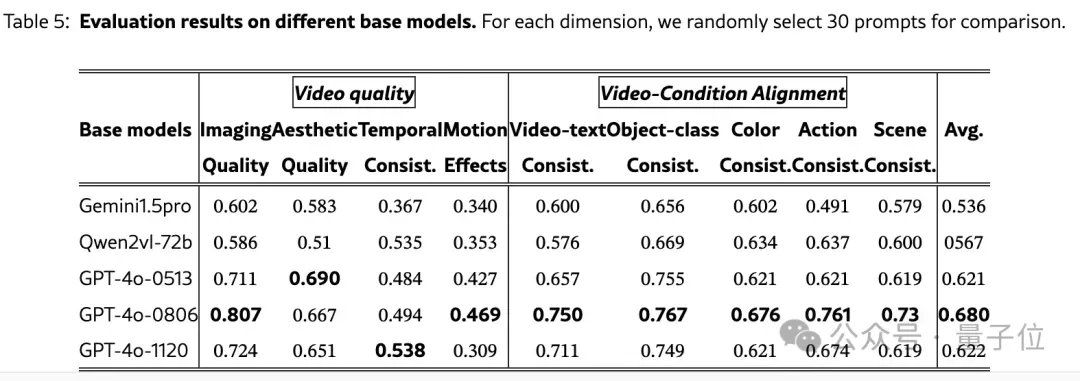

对不同基础模型进行比较,结果发现,与Gemini1.5pro和Qwen2vl-72b相比,GPT-4o通常在视频质量和一致性评分上表现更优,特别是在成像质量(0.807)和视频-文本一致性(0.750)方面,GPT-4o-0806表现尤为突出。

然而,性能并不总是随着GPT-4o版本的更新而持续提升。例如,GPT-4o-1120在运动效果方面相较于GPT-4o-0806有所下降(0.309vs.0.469),这表明在更新过程中,时间运动检测可能存在潜在退化。

作者简介

共同第一作者:

韩慧,上海交通大学硕士生,研究方向为多模态语言模型

李思远,上海交通大学硕士生,研究方向为多模态语言模型

陈家棋,复旦大学硕士,斯坦福访问学者,Fellou 研究员,研究方向为 LLM agent

袁怡雯,CMU 本科,xAI 研究员,研究方向为多模态语言模型和 RAG

通讯作者为倪泳鑫,波士顿大学博士

代码链接:https://github.com/Video-Bench/Video-Bench.git论文地址:https://arxiv.org/html/2504.04907v1