提升大模型对齐能力新方法,在TruthfulQA任务上真实性指标提升25.8%,刷新当前最优性能!

方法名为Token-Aware Editing (TAE),是一种token感知的推理时表征编辑方法。

该方法首次系统性地从token层面解决了传统表征编辑技术的问题,无需训练、即插即用,可广泛应用于对话系统、内容审核、偏见mitigation等场景。

在大模型广泛应用的时代,如何让模型输出更符合人类价值观(如真实性、无害性、公平性)已成为关键挑战。传统方法通常依赖大量数据微调,成本高、效率低,且容易引入新风险。

近年来,对大语言模型(LLMs)的内部激活值直接进行编辑,被证明是一种有效的推理时对齐方法,能够高效抑制模型生成错误或有害内容等不良行为,从而确保大语言模型应用的安全性与可靠性。

然而,现有方法忽略了不同token之间的错位差异,导致对齐方向出现偏差且编辑强度缺乏灵活性。

由此,来自北航的研究团队在EMNLP 2025上提出了该方法。

未来,团队计划将TAE扩展至多维度对齐(如同时优化真实性与无害性),并探索与SFT、RLHF等训练方法的结合,推动大模型向更安全、可靠的方向发展。

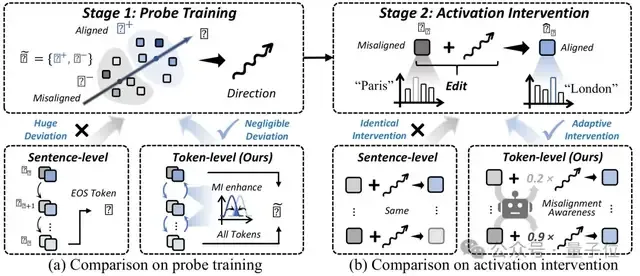

研究团队指出,以往的表征编辑研究(如ITI、TruthX等)大多在句子级别进行激活值编辑,在编辑方向探寻和内部表征编辑两个主要阶段均存在问题:

- 方向偏差(Deviant Alignment Direction):仅用最后一个token代表整个句子,信息不全面,学到的编辑方向不准。

- 编辑强度不灵活(Inflexible Editing Strength):对所有token“一视同仁”地进行编辑,无法精准纠正真正“出错”的token。

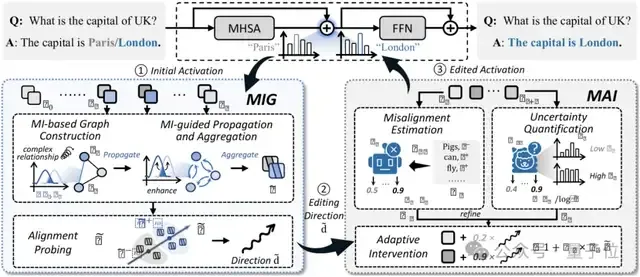

为了解决上述问题,团队提出了Token-Aware Editing (TAE),核心包含两个模块:

1、Mutual Information-guided Graph Aggregation (MIG)

传统句子级探针使用最后一个token(通常是或句号等标志符)的激活值来代表整个复杂句子的语义和对齐状态。然而,尽管LLM的自注意力机制允许最后一个token感知到前面所有token的信息,但这种感知可能存在信息损失和局部理解局限。因此,仅基于它学到的“对齐方向”可能是有偏差的,不是一个普适性的方向。而MIG模块的目标是增强激活值的表征能力,从而训练出更优秀的探针,找到更准确的编辑方向。

- 构建Token关系图:利用互信息(Mutual Information)量化Token激活值之间的关联性,构建信息交互图;

- 多层次信息聚合:通过多轮图传播,融合所有Token的语义信息,生成更具代表性的增强激活表征;

- 精准对齐方向探测:基于增强表征训练探测头,准确识别与对齐相关的干预方向

2、Misalignment-aware Adaptive Intervention (MAI)

在推理干预时,传统方法对所有token应用相同的编辑强度(α)。但显然,一个句子中有些token很“安全”(已对齐),有些token则很“危险”(即将导致模型产生不对齐的内容)。用同样的力度去“推”所有token,要么可能对安全token造成过度干预(可能影响流畅性和有用性),要么可能对危险token的干预力度不足(无法有效纠正错误)。MAI模块的目标是在推理时,为当前正在生成的每个token计算一个自适应的编辑强度A(o_t)。它从两个维度来感知一个token的“错位”风险:

- 双路错位评估:从表示错位估计和预测不确定性量化两个方面评估token的潜在不确定性程度

- 动态强度调整:根据错位程度自适应计算干预强度,高风险token强干预,低风险token弱干预。

最终,TAE方法将两者结合,实现了比前人方法更精细、更有效、成本更低的推理时对齐干预,在真实性、无害性、公平性等多个对齐维度上都取得了显著提升。

团队选取真实性、有害性和公平性三个典型对齐维度来评估TAE的对齐效果:

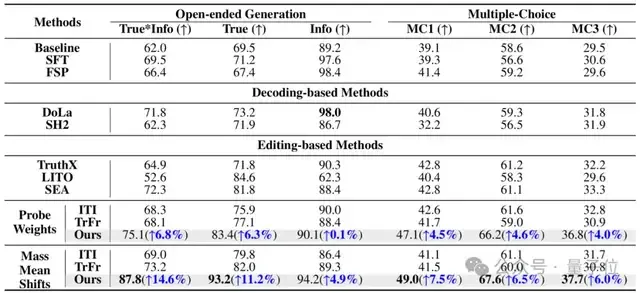

在评估真实性的TruthfulQA数据集上,TAE在LLaMA-3-8B-Instruct上取得了87.8%的True*Info得分,比之前最好的编辑方法(SEA: 73.2%)提升了14.6个百分点,比原始基线(62.0%)提升了25.8个百分点。

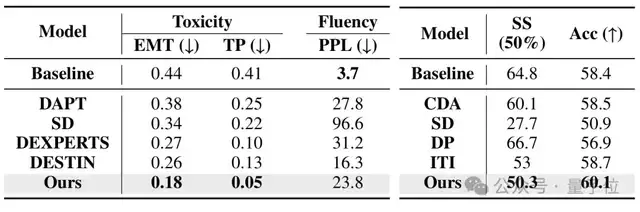

TAE在去毒任务的RealToxicPrompt上同样表现卓越,将TP(毒性概率)从基线的0.41大幅降低到0.05,降幅近90%,并且优于所有专门的去毒基线方法(如DESTEIN: 0.13);在公平性任务数据集StereoSet上,TAE将刻板印象分数(SS)从基线的64.8%显著降低到50.3%,极大地缓解了模型偏见,并且最接近理想的无偏见状态(50%)。

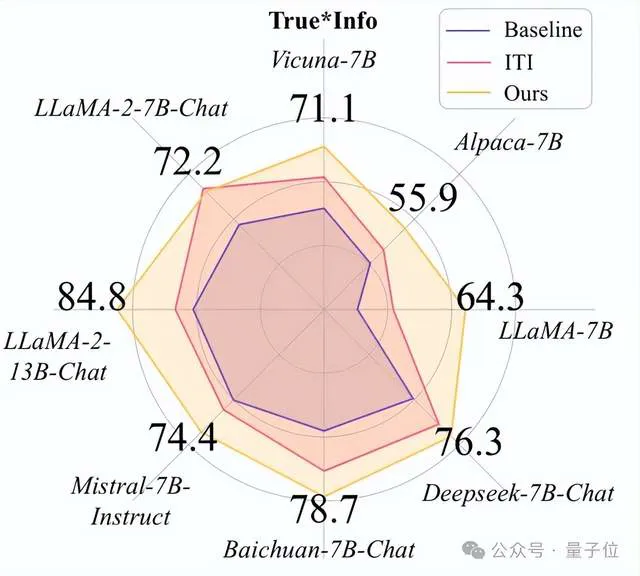

不仅如此,TAE在不同类型、大小的模型上均表现出显著增益,如Llama2-7B-Chat, Llama2-13B-Chat, Alpaca-7B和Mistral-7B等。

论文链接:https://openreview.net/pdf?id=43nuT3mODk