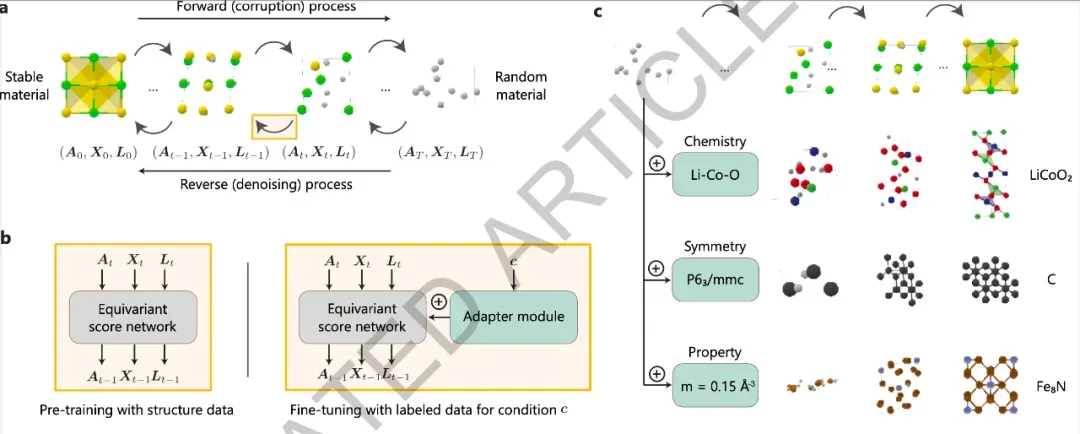

刚刚,顶尖学术期刊《自然》(Nature)刊发了一项具有里程碑意义的研究成果:微软研究院的研究团队成功开发了一种名为MatterGen的全新扩散生成模型。MatterGen 的出现为材料科学的逆向设计开启了一个全新的篇章,它不仅能够生成覆盖整个元素周期表、稳定且多样的无机材料,而且能够通过微调,精确地控制所生成材料的化学成分、对称性以及包括磁性密度、力学性能、电子特性等在内的多种物理性质

MatterGen的创新之处

MatterGen之所以能够取得如此显著的突破,源于其在模型架构和训练方法上的多维度创新:

1. 定制化的扩散过程: 针对晶体材料的特殊性,MatterGen引入了一套定制化的扩散过程,该过程可以独立地对原子类型、坐标和晶格进行扰动,并将其导向一个符合物理规律的随机分布。这种方法在对晶体结构中的原子坐标进行扰动时,充分考虑了周期边界条件,并通过缩放噪声大小,来消除晶胞尺寸的影响,从而确保了扰动的合理性和有效性。对于原子类型,MatterGen采用了掩码(mask)方法,使其向“未确定”状态扩散,以便能够生成新类型的结构。对于晶格,该模型采用对称形式的扩散,使其趋向一个具有平均原子密度的立方晶格

2. 等变性评分网络: 为了逆转上述扩散过程,MatterGen训练了一个等变性评分网络,该网络能够输出原子类型、坐标和晶格的等变分数,从而无需直接从数据中学习对称性,显著提高了模型的效率和泛化能力

3. 自适应模块与微调: 为了控制生成过程,MatterGen 引入了自适应模块,这些模块可以插入到基础模型中的每一层,并根据给定的性质标签来调整模型的输出。此外,研究人员还采用了分类器自由引导(classifier-free guidance)的方法,进一步引导生成过程朝向特定的目标性质。微调策略不仅能够提升模型的表现,还能在标记数据量有限的情况下高效工作,这在材料科学领域至关重要,因为性质计算的成本往往非常高昂

4. 大规模数据集训练: MatterGen的卓越性能还得益于大规模、高质量的训练数据集,即Alex-MP-20,它包含了来自Materials Project (MP)和Alexandria等数据库的607,683个稳定结构,覆盖了多种化学元素和晶体结构。通过如此庞大的数据集进行训练,MatterGen能够更好地理解晶体材料的规律,从而提高其生成稳定、多样材料的能力

MatterGen的性能评估与实验验证

为了验证MatterGen的性能,研究人员进行了多方面的评估:

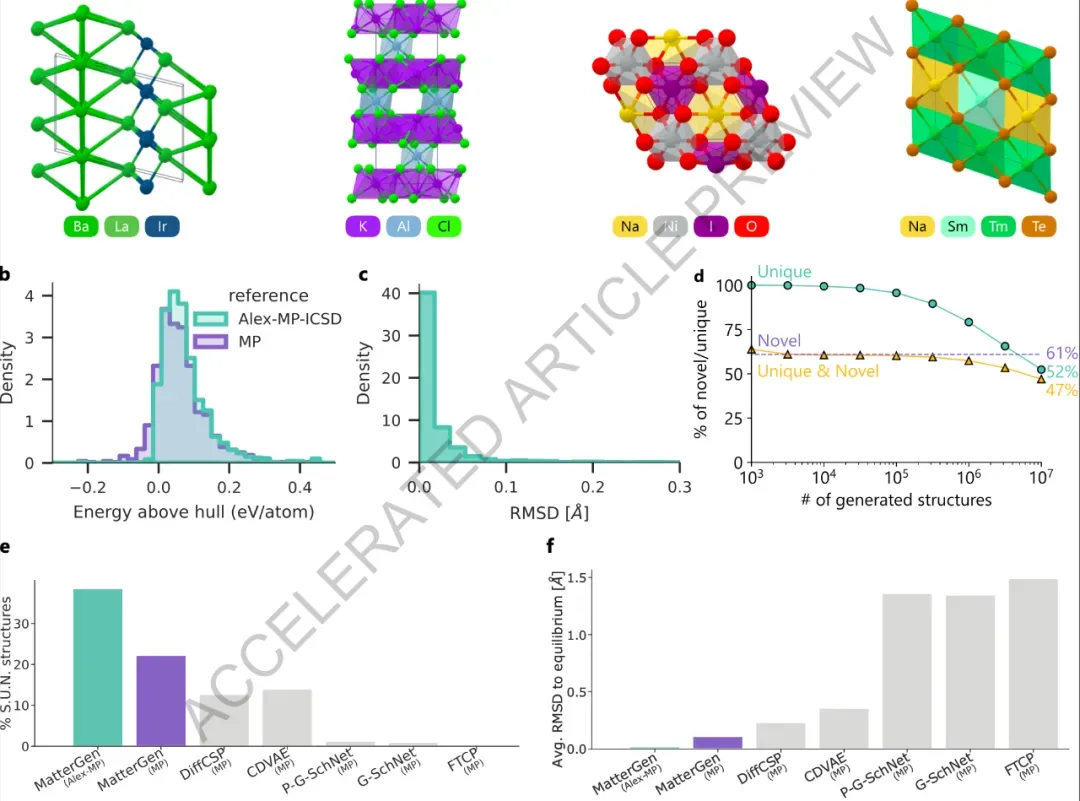

稳定性评估: 研究人员使用密度泛函理论(DFT)计算对MatterGen生成的结构进行了能量弛豫,并证明绝大部分结构的能量都接近于其局部最小值,表明了这些结构的稳定性

多样性评估: 研究结果显示,即使生成数百万个结构,MatterGen仍然能够产生高度多样性和独特性,其发现新材料的能力远超传统方法。此外,MatterGen还能重新发现训练数据中没有的2000多个已知的实验验证结构,证明了其在材料发现方面的巨大潜力

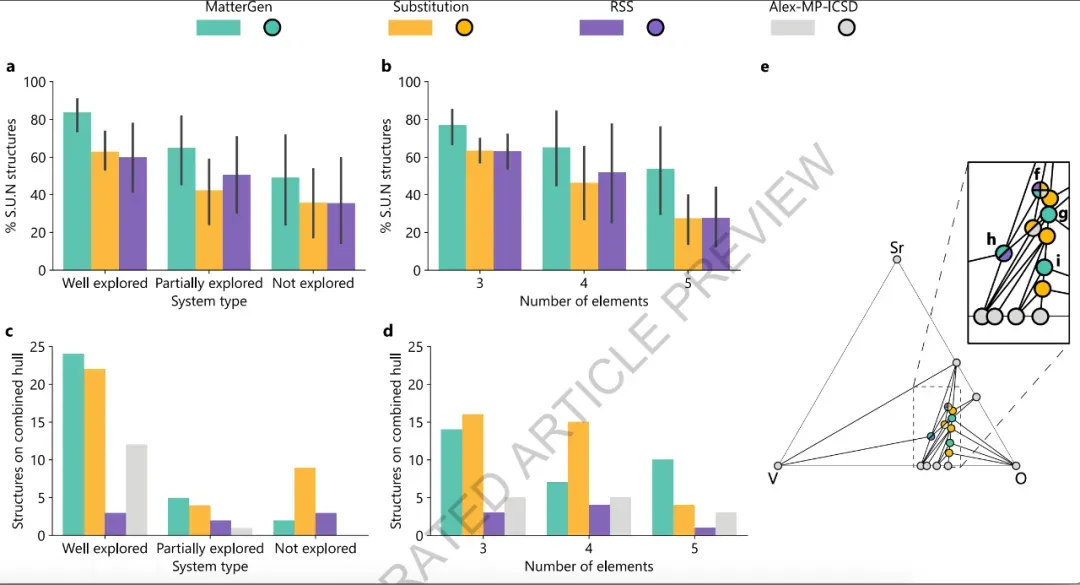

与现有模型对比: 通过与CDVAE, DiffCSP等先前先进生成模型进行对比,MatterGen显著提升了S.U.N(稳定、独特、新颖)材料的生成比例,同时显著降低了生成结构与DFT弛豫结构之间的均方根偏差(RMSD),证明了MatterGen在生成稳定材料和逼近真实结构方面的优异性能

化学成分引导: MatterGen 在目标化学系统中的表现也超越了传统的替代法和随机结构搜索(RSS)方法,能够更加高效地生成在目标体系中处于能量凸包上的稳定结构,尤其是在成分复杂的五元体系中优势更加显著

物理性质引导: MatterGen 能够根据特定的磁性密度、带隙和体积模量等物理性质进行微调,生成符合目标要求的材料,这也表明了 MatterGen 在逆向设计材料方面的强大能力,甚至能克服训练数据分布中出现的极端值的问题

多目标优化: 为了满足更复杂的实际需求,MatterGen 可以针对多个性质同时进行优化,例如同时满足高磁密度和低供应链风险的永磁材料

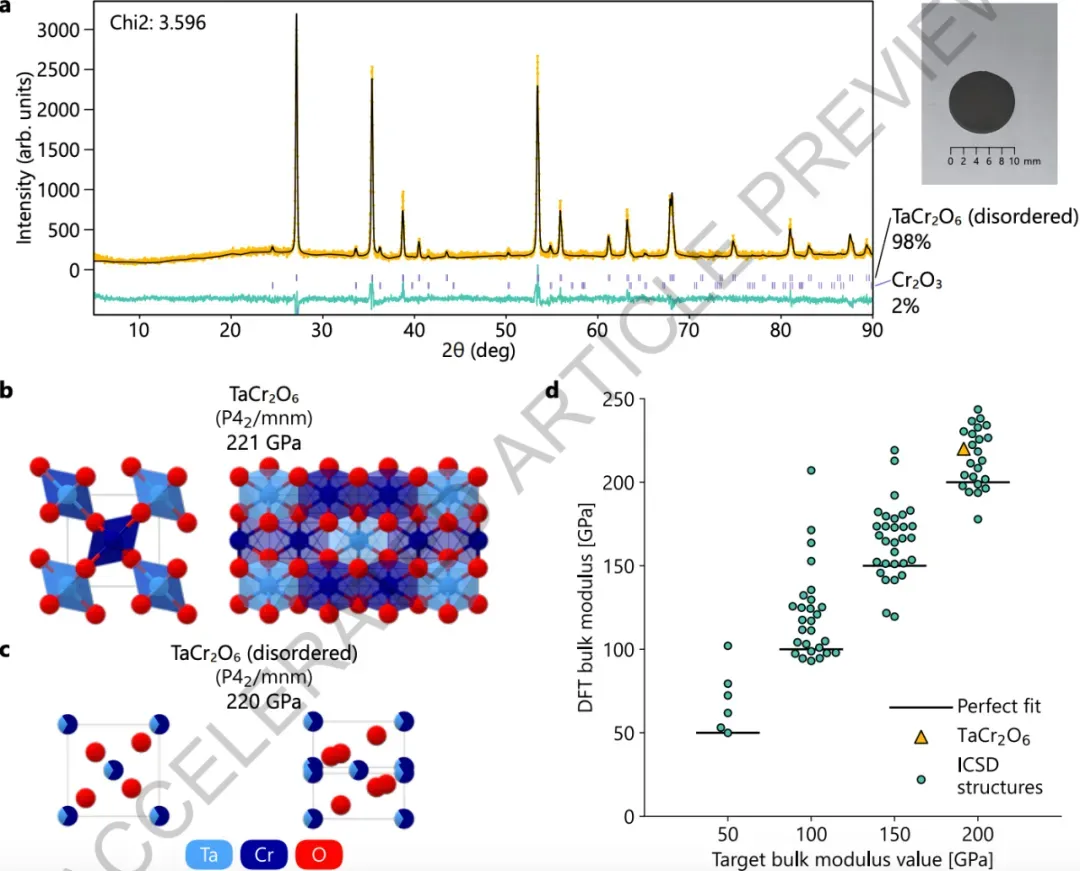

实验验证: 作为概念验证,研究团队通过实验合成了MatterGen设计的一种材料 (TaCr2O6 ),并测量了其杨氏模量,推导出其体积模量与MatterGen的预测值相差仅20%,这有力地证明了MatterGen的实际应用潜力

写在最后:

MatterGen的发布不仅仅是一项技术突破,它更代表着材料科学研究范式的转变。研究团队相信,MatterGen的卓越性能和广泛适用性使其有潜力成为未来材料科学领域的核心工具