图像生成中的多指标一致性问题,被字节团队解决了!

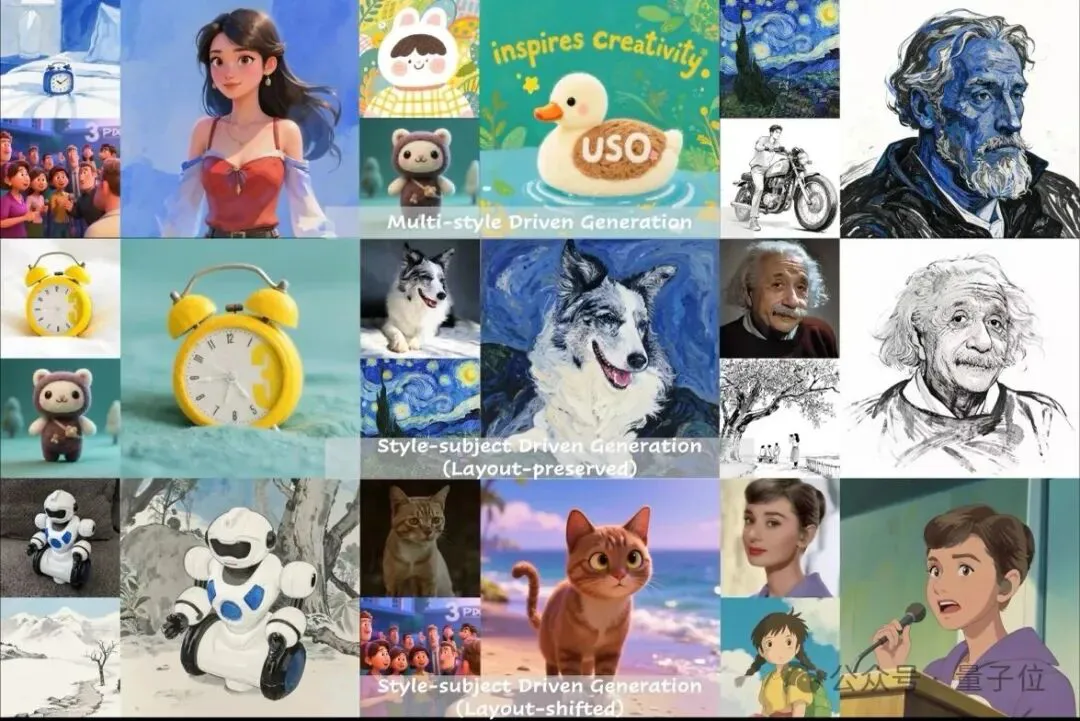

字节UXO团队设计并开源了统一框架USO,让看上去不关联的任务相互促进,实现风格迁移和主体保持单任务和组合任务的SOTA。

USO通过单一框架能统一之前那些看似孤立的任务包括主体、身份保持和风格化编辑,参考图风格迁移,同时保持主体和风格参考,甚至更抽象复杂的多风格迁移,是实打实的六边形战士。

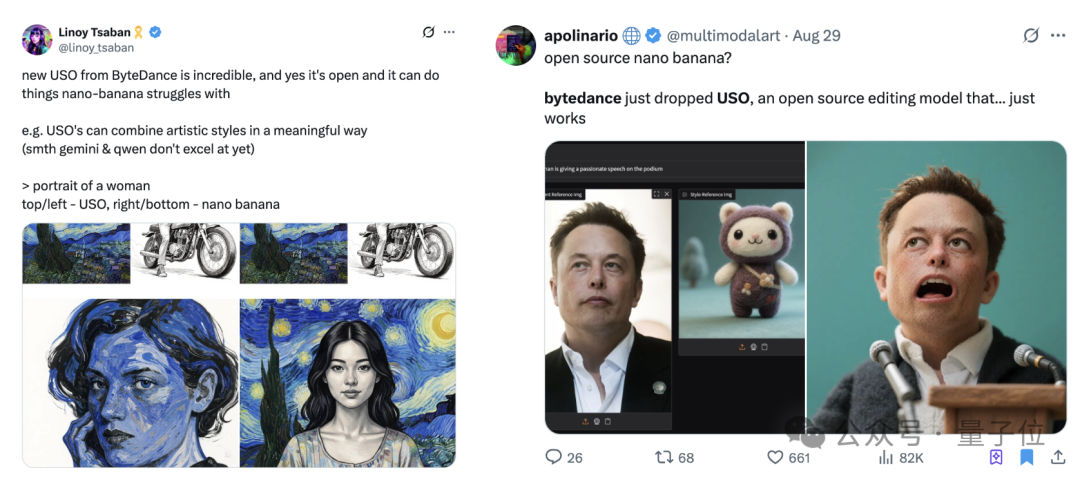

网友们争相围观,甚至有人直接拿来和当前火爆的闭源模型对比,发现USO弥补了难以同时做好主体保持和风格迁移的短板。

一个模型搞定人物/主体/风格保持

通过单一模型且仅通过一张参考图,USO就能搞定你想要的主体、人物或是风格。

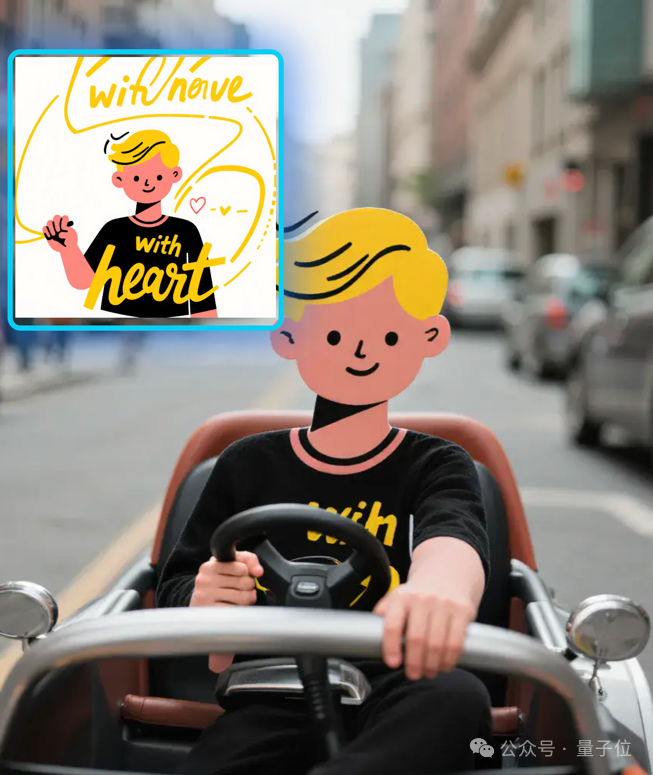

比如说,以卡通人物为例,让他在街上驾驶小车:

又比如说,积木风格,让这个男人在咖啡厅看书:

或者前阵子大火的吉卜力风格,也可以通过参考风格实现,比如一个男孩站在巨大的猫前“

或者抽象的材质参考,也能轻松处理,比如生成一个大厨在炒菜:

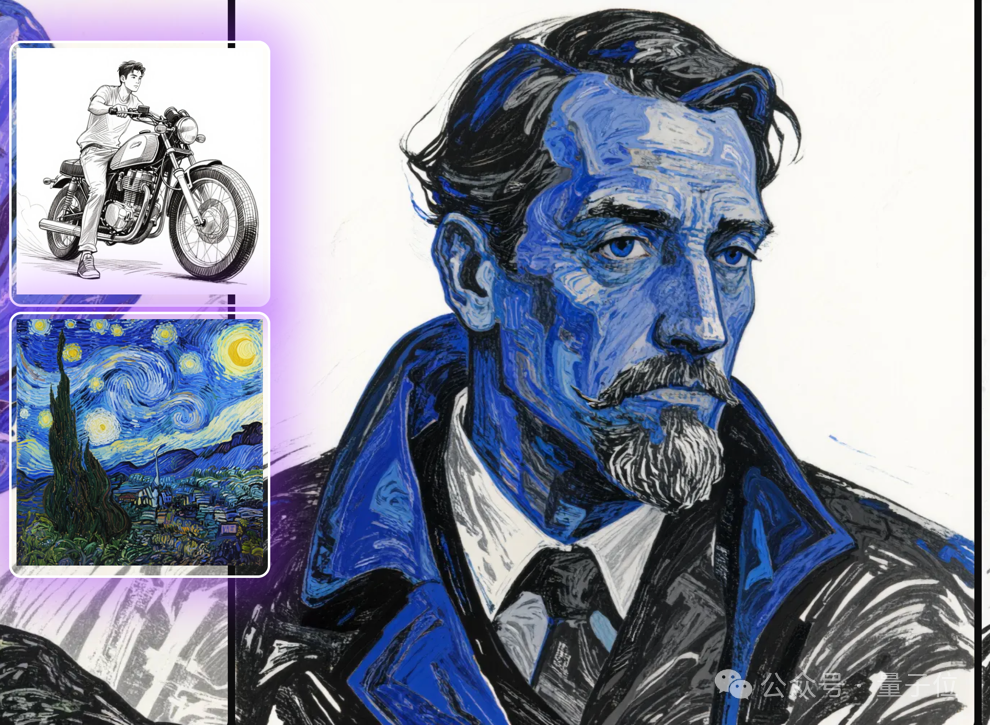

那么再大胆点,混合风格呢,比如生成一个男子:

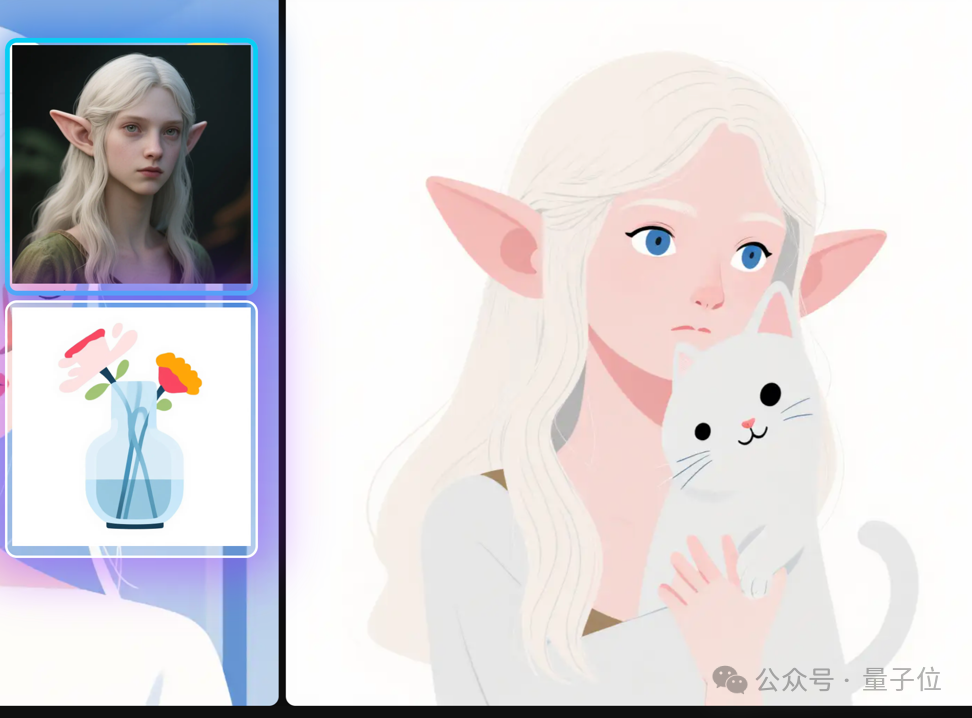

或者同时参考人物ID和风格图片,然后让她抱着一只猫呢,可以看到最终结果在保留ID基础上完美还原扁平风格(设计党狂喜):

以上种种应用场景,USO都能轻松处理,甚至画面质量不输一些商业大模型。

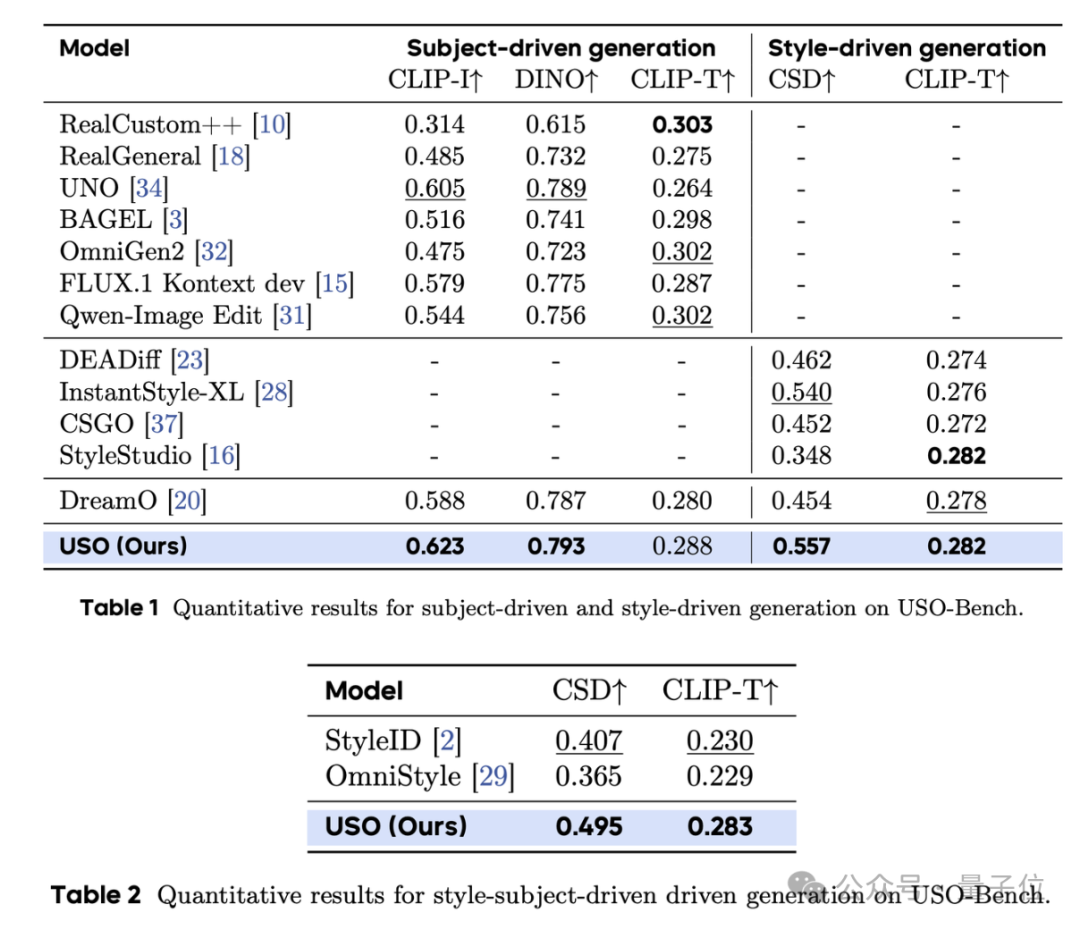

为了全面评估模型性能,团队首次设计了一个USO-Bench,全面评估不同任务类型的性能,分别包括主体驱动,风格驱动以及主体风格混合驱动生成,并且对比了一众最新模型。

最终,UNO在三大任务上都处于领先水平。

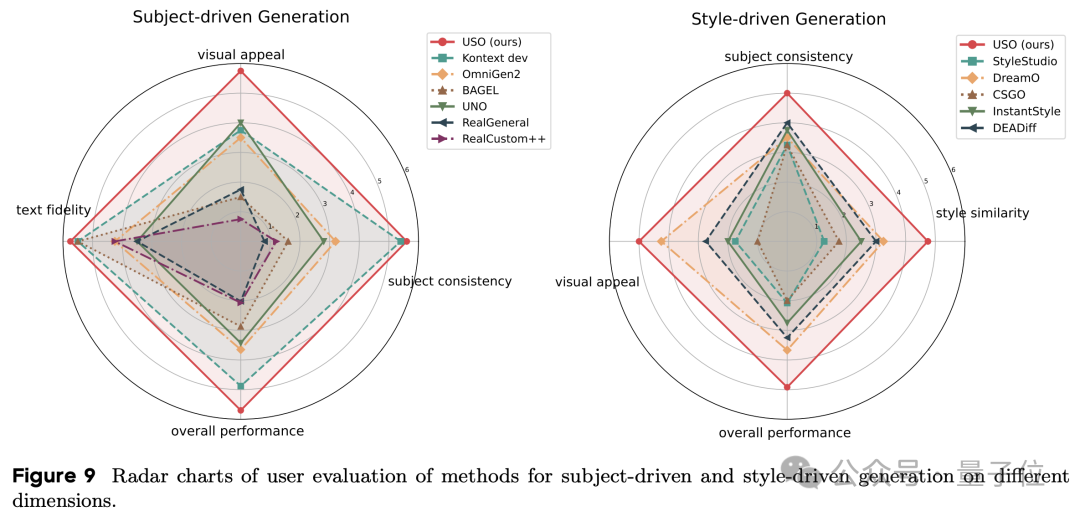

并且研究团队还进行了用户研究,结果显示,USO在所有评估维度上都获得了较高评价,特别是主体一致性、风格一致性和画面质量上表现最为突出。

跨任务自解耦

USO采用了一种“跨任务自解耦”的新范式,核心思想是让模型根据不同任务类型学习想要包含的特征,从而从根本上增强模型的学习能力。

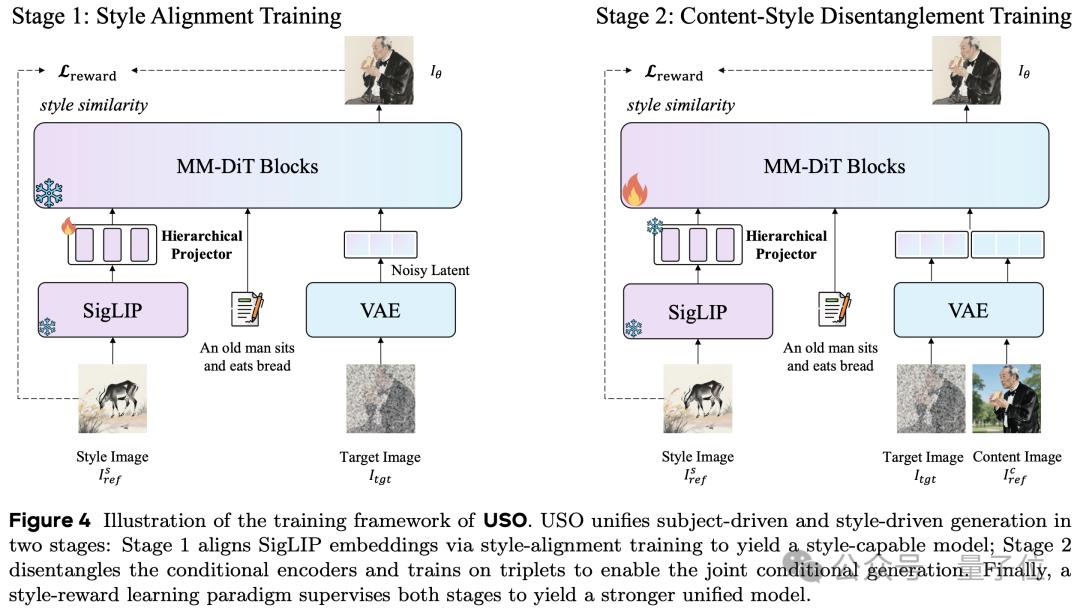

在模型架构上,USO以开源模型FLUX.1 dev为基础,设计了风格对齐训练以及内容-风格解耦训练:

- 首先将SigLIP提取的多层风格特征对齐到文本空间,使其成为一个具备风格迁移能力的模型;

- 随后引入VAE内容特征,基于三元组数据做风格-内容解耦训练。

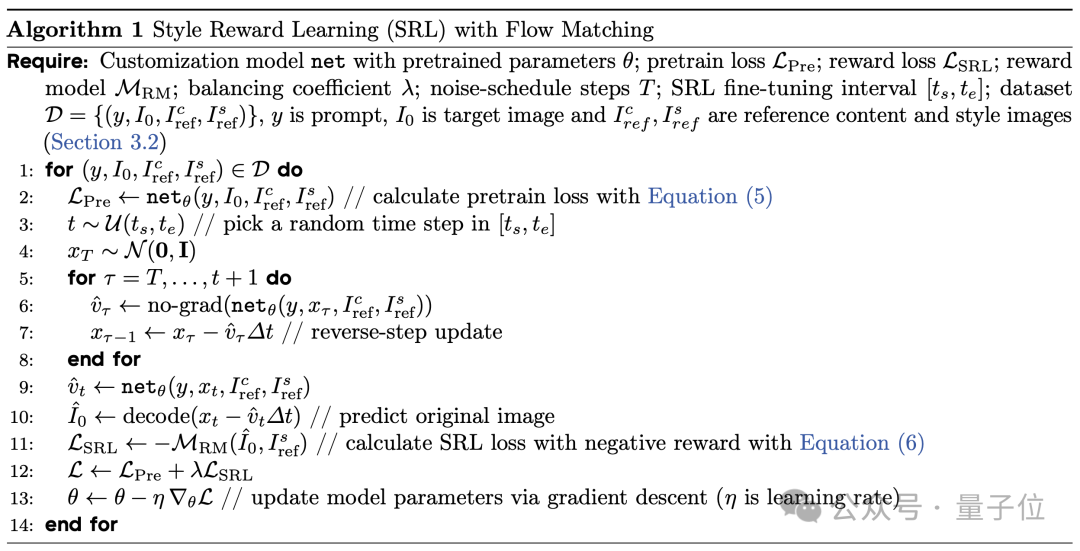

此外研究团队首次提出了风格奖励学习(SRL)算法,这是一种为Flow Matching设计的带参考图的强化学习算法。

其奖励函数来自衡量风格一致性的奖励模型数学映射,配合预训练损失监督模型训练,最终进一步促进内容和风格的解耦。

另外作者也提到,强化学习的加入让模型在别的任务上也得到了性能提升,进一步验证跨任务对齐的有效性。

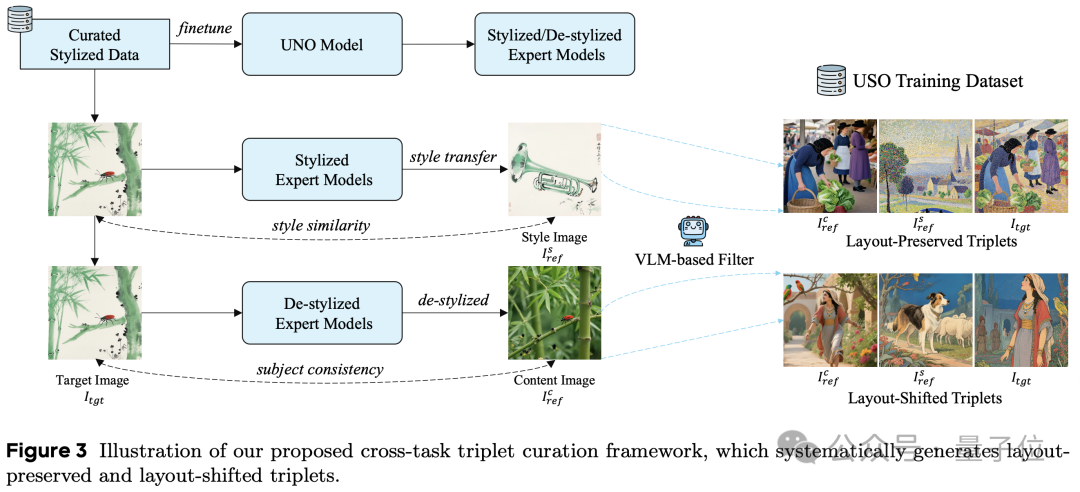

在数据方面,团队构建了一套跨任务数据合成框架,创新性地提出同时构建布局改变和布局保留的三元组数据。

通过训练UNO模型得到一个风格化和去风格化的专家模型,然后利用这两个专家模型生成大批量三元组数据,最后通过VLM过滤出用于训练USO的数据集。

更多细节请参考该方法的技术报告。

论文地址:https://arxiv.org/abs/2508.18966项目主页:https://bytedance.github.io/USO/代码仓库:https://github.com/bytedance/USOHuggingFace在线demo:https://huggingface.co/spaces/bytedance-research/USO