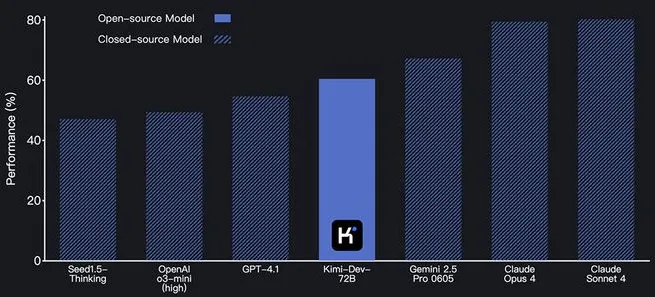

月之暗面(Moonshot AI)宣布推出其新开源模型 Kimi-Dev-72B,这一模型专注于软件工程任务,并在 AI 编程基准测试 SWE-bench Verified 中创下了全球最高的开源模型成绩。Kimi-Dev-72B 以仅72亿参数量的设计,成功超越了刚发布不久的 DeepSeek-R1,后者的参数量高达671亿。

在 SWE-bench Verified 测试中,Kimi-Dev-72B 获得了60.4% 的高分,成为当前开源模型中的新标杆。该模型的优化过程包括大规模强化学习,使其能够自动修复 Docker 环境中的真实存储库。Kimi-Dev-72B 在测试中仅在所有测试用例通过后才能获得奖励,从而确保所生成解决方案的正确性和稳健性,符合现实开发的高标准。

Kimi-Dev-72B 目前已在 Hugging Face 和 GitHub 平台上开放下载,用户可获取模型权重、源代码,技术报告也即将发布。Hugging Face 链接为:huggingface.co/moonshotai/Kimi-Dev-72B,GitHub 链接为:github.com/MoonshotAI/Kimi-Dev。

在设计理念方面,Kimi-Dev-72B 结合了 BugFixer 和 TestWriter 的双重角色。BugFixer 负责修复错误,TestWriter 则编写相应的单元测试。这两个部分相互补充,确保模型在编程任务中的有效性。Kimi-Dev-72B 的工作流程简单明确,主要分为文件本地化和代码编辑两个阶段。

为了增强模型的能力,月之暗面使用了约1500亿个高质量数据进行中期训练,数据来自 GitHub 的真实问题和 PR 提交。通过严格的数据净化,该模型能够学习人类开发者如何解决问题并编写代码。强化学习阶段则重点提升其代码编辑能力,通过基于结果的奖励系统,逐步优化模型的表现。

在测试环节,Kimi-Dev-72B 能够协调 BugFixer 和 TestWriter 的角色,采用自我博弈机制,从而提升模型的性能和效果。每个问题最多可以生成40个补丁候选和测试候选,显示了自博弈机制的强大效应。

未来,月之暗面计划进一步扩展 Kimi-Dev-72B 的功能,探索与流行开发工具的深度集成,使其更无缝地融入开发者的工作流程。公司承诺将持续改进这一模型,进行严谨的红队测试,以便向社区推出更强大的版本。

Hugging Face地址:huggingface.co/moonshotai/Kimi-Dev-72B

GitHub地址:github.com/MoonshotAI/Kimi-Dev

划重点:

🔍 Kimi-Dev-72B 是新发布的开源模型,创下了编程基准测试的全球最高分。

🚀 该模型结合了 BugFixer 和 TestWriter 的功能,以提升编程效率和代码质量。

💡 月之暗面将继续优化 Kimi-Dev-72B,未来计划与流行开发工具进行更深入的整合。