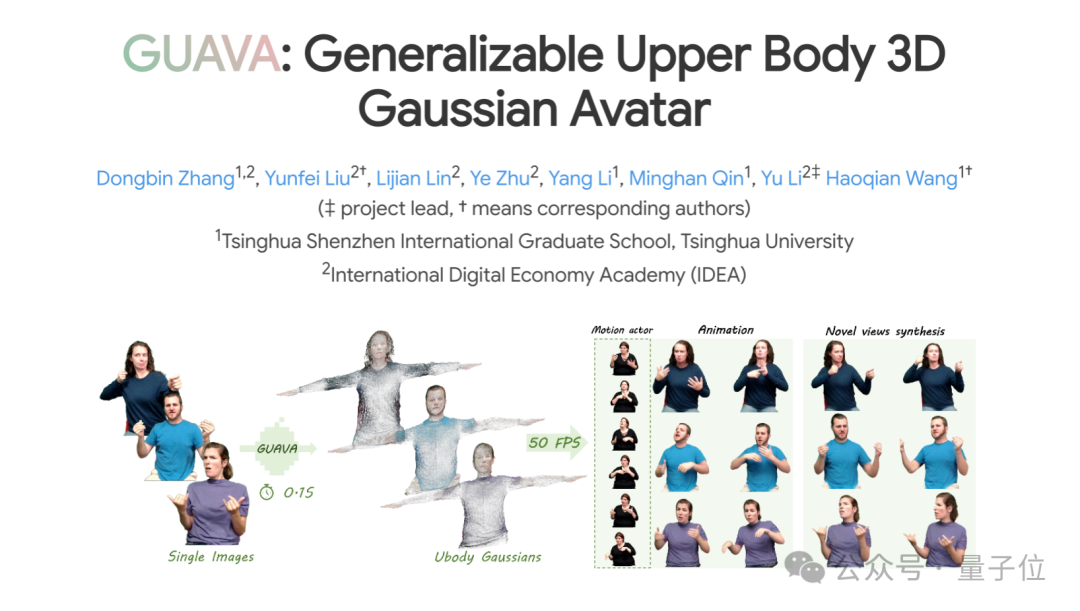

一张图就能创建上半身动作视频,方法还入选了ICCV 2025!

来自清华大学、IDEA(粤港澳大湾区数字经济研究院)的研究人员提出新框架GUAVA,不需要多视角视频、不需要针对不同个体单人训练,仅需0.1秒就能从单图创建一个上半身3D化身。

通常来说,创建逼真且富有表现力的上半身人体化身(如包含细致面部表情和丰富手势),在电影、游戏和虚拟会议等领域具有重要价值。

但截至目前,仅凭单张图像实现这一目标仍然是一个重大挑战,而且同时还需要易于创建和支持实时渲染。

而GUAVA,作为第一个从单张图像创建可驱动上半身3D高斯化身的框架,与需要多视图视频或单人训练的3D方法不同——可以在秒级时间内完成推理重建,并支持实时动画和渲染。

与基于扩散模型的2D方法相比,GUAVA使用3D高斯来确保更好的ID一致性和实时渲染。而且还引入一种富有表现力的人体模型EHM,解决了现有模型在捕捉细致面部表情方面的局限性。

此外,它还利用逆纹理映射技术以准确地预测高斯纹理,并结合一个神经渲染器来提高渲染质量。

实验结果显示,GUAVA在渲染质量和效率方面优于现有2D和3D方法。

下面详细来看GUAVA所采用的方法。

具体方法

3DGS的兴起催生了许多3D化身重建方法,然而这些方法仍然存在一些局限性:

- 逐ID练:每个个体都需要单独训练;

- 训练复杂性:该过程耗时,需要标定的多视图或单目视频;

- 表现力有限:头部重建方法缺乏身体动作表示,而全身方法则忽略了细致的面部表情。

另外,扩散模型在视频生成方面取得了显著成果。一些工作通过添加额外条件,如关键点或SMPLX渲染图,来引导扩散模型的生成过程,扩展了模型在生成可控人体动画视频上的应用。

但问题是,虽然这些方法实现了良好的视觉效果,其局限性却依旧存在:

- ID一致性:难以保持一致的ID,尤其是在姿势发生大变化时;

- 效率:高计算成本和多步去噪导致推理速度慢,阻碍了实时应用;

- 视点控制:2D方法无法轻松调整相机姿势,从而限制了视点控制。

而GUAVA则通过以下举措进行了改进。

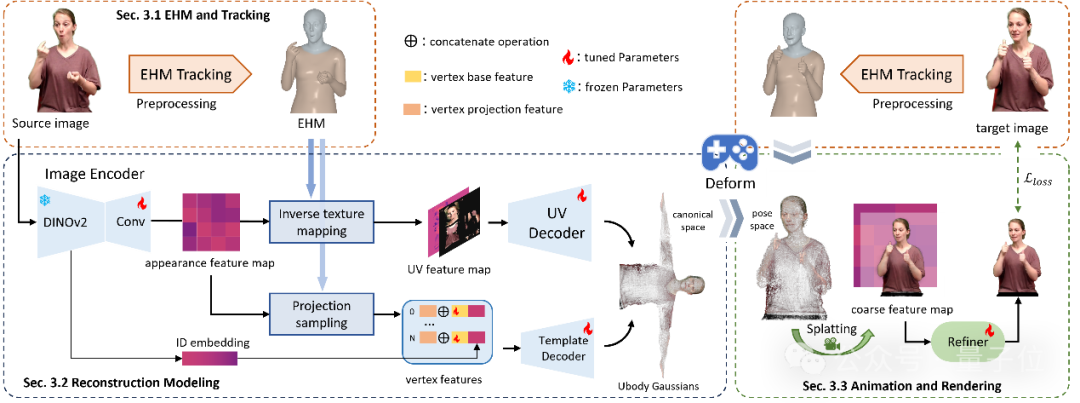

(1)EHM模型与精确跟踪

为了解决SMPLX模型在捕捉面部表情上的不足,GUAVA引入了EHM(Expressive Human Model)。

EHM结合了SMPLX和FLAME模型,能够实现更准确的面部表情表示。

同时,研究人员设计了对应的两阶段追踪方法,实现从单张图像到姿态的准确估计——首先利用预训练模型进行粗略估计,然后使用2D关键点损失进行精细优化,从而为重建提供精确的姿势和表情参数。

(2)快速重建与双分支模型

GUAVA基于追踪后的图像,通过单次前向推理方式完成化身的重建。

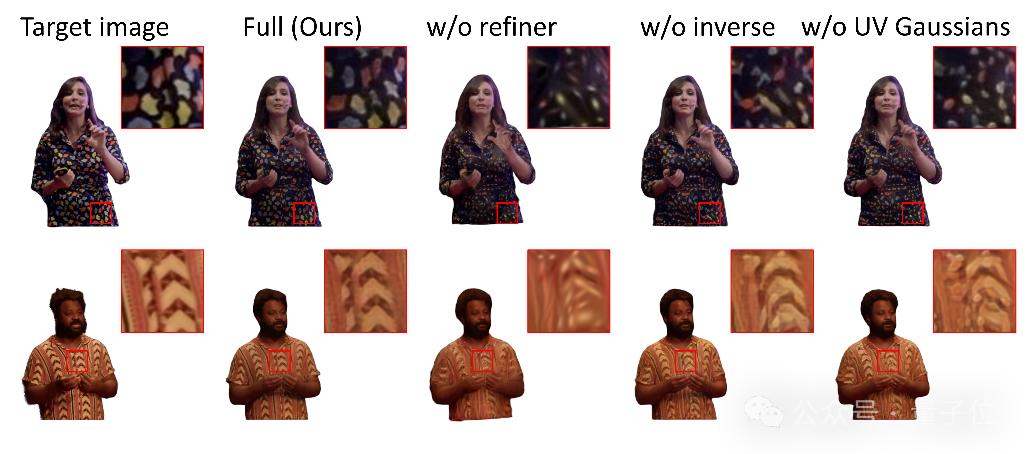

它包含两个分支:一个分支根据EHM顶点和投影特征预测粗略的“模板高斯”,另一个分支则通过“逆纹理映射”技术,将屏幕特征映射到UV空间,生成捕捉精细细节的“UV高斯”。

这两种高斯组合成完整的Ubody高斯,从而在保持几何结构的同时,捕捉丰富的纹理细节。

(3)实时动画与渲染

重建完成后,Ubody高斯可以根据新的姿势参数进行变形和动画。

最后,通过神经细化器对渲染的图像进行优化,以增强细节和渲染质量。

实验环节

实验设置方面,研究人员从YouTube、OSX和HowToSign收集视频数据集,主要关注人体上半身视频。

其中训练集包含超过62万帧,测试集包含58个ID。

为确保评估的全面性,实验采用了多种指标:

- 自重演(self-reenactment)场景下,通过PSNR、L1、SSIM和LPIPS评估动画结果的图像质量;

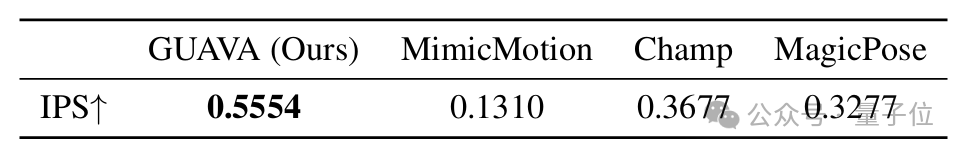

- 跨重演(cross-reenactment)场景下,使用ArcFace计算身份保留分数(IPS)以衡量ID一致性。

评估中与MagicPose、Champ、MimicMotion等2D方法以及GART、GaussianAvatar和ExAvatar 3D方法进行比较。

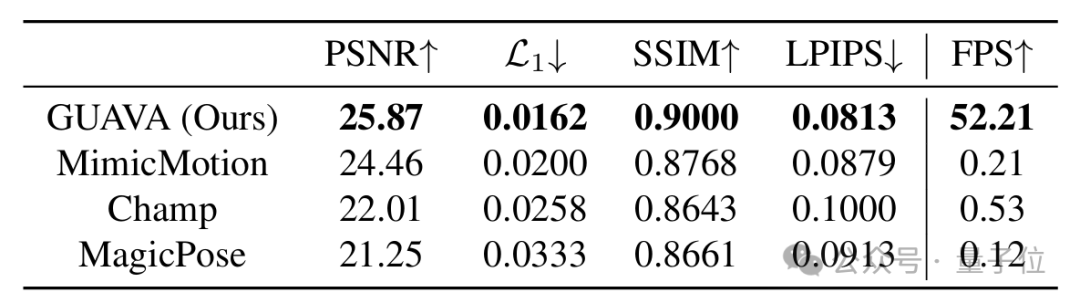

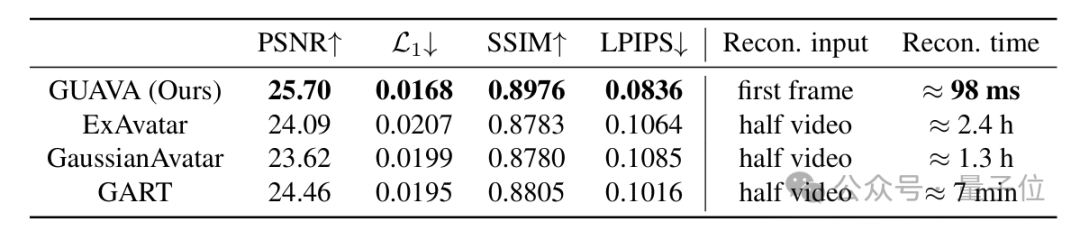

定量结果如下:

(1)Self-reenactment

与2D方法相比,GUAVA在所有指标(PSNR, L1, SSIM, LPIPS)上均表现最佳,并在动画和渲染速度上达到约50 FPS,而其他方法仅为每秒几帧。

与3D方法相比,GUAVA的重建时间仅为0.1秒左右,而其他方法需要数分钟到数小时。

(2)Cross-reenactment

GUAVA在身份保留分数(IPS)上显著优于其他所有2D方法,证明了其在不同姿势下保持ID一致性的能力。

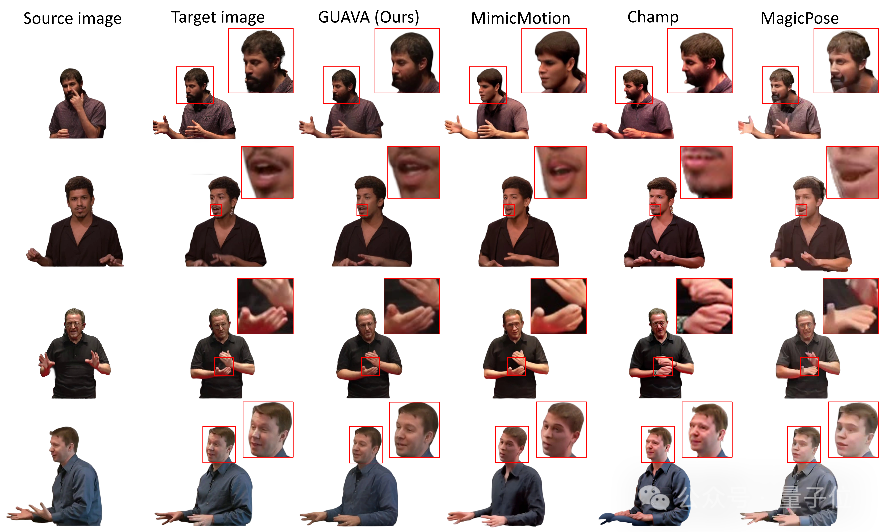

定性结果显示,尽管2D方法能生成高质量图像,但它们在保持ID一致性和准确恢复复杂手势及面部表情方面存在不足。

例如,Champ的手部模糊 ,MagicPose存在失真 ,而MimicMotion则无法保持ID一致性。

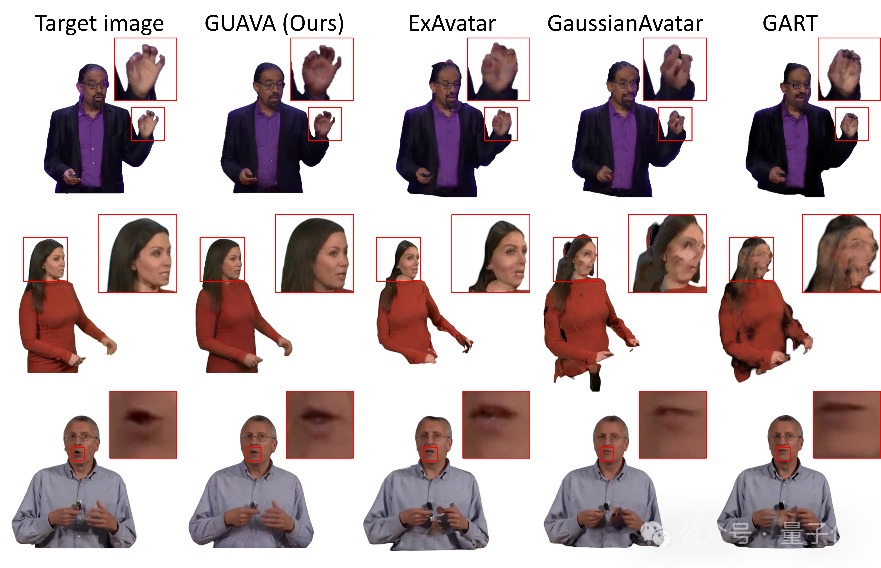

3D方法在处理精细的手指和面部表情方面存在困难,也缺乏泛化能力,在未见区域或极端姿势下会产生伪影。

GUAVA则能对未见区域生成合理的结果,在极端姿势下表现出更好的鲁棒性,并提供更准确、更细致的手部和面部表情。

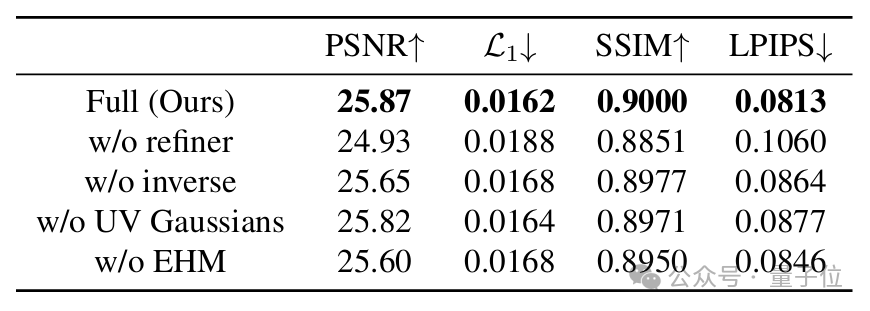

为了验证方法中各个部分的有效性,论文还进行了充分的消融实验。

小结一下,论文所提出的GUAVA,是一个用于从单张图像重建可动画、具有细腻表现力上半身3D化身的快速框架。

研究通过引入EHM模型及其精确跟踪方法,增强了面部表情、形状和姿势的捕捉能力,并通过UV高斯和模板高斯的两个推理分支共同构建一个上半身高斯。

实验结果表明,GUAVA在渲染质量和效率方面均优于现有方法。它实现了约0.1秒的重建时间,并支持实时动画和渲染。

目前相关代码已开源,感兴趣可以进一步关注。

论文地址: https://arxiv.org/pdf/2505.03351

项目主页:https://eastbeanzhang.github.io/GUAVA/

开源代码:https://github.com/Pixel-Talk/GUAVA

视频Demo: https://www.bilibili.com/video/BV1k45AzaEpW/