时令 发自 凹非寺

量子位 | 公众号 QbitAI

大模型老走重复步骤,导致思维链越来越长怎么办?

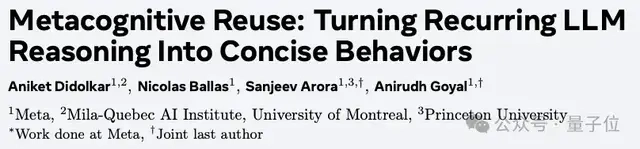

Meta、Mila-Quebec AI Institute、蒙特利尔大学和普林斯顿大学联合提出元认知复用(Metacognitive Reuse) 机制。

简单来说,就是让模型自己回顾、总结解题思路,将常用的推理套路提炼成更为简洁的“行为”,并将其存储于 “行为手册(Behavior Handbook)” 中。

当再遇到类似问题时,模型便可直接从手册中调用相应的行为,无需重新推导。

实验结果显示,该机制通过行为条件推理、行为引导自我改进、行为条件监督微调三种应用场景,在MATH、AIME等数学基准测试中实现了显著优化,在保持准确率不变的前提下,最多可减少46%的推理token使用量。

下面具体来看。

如今,大型语言模型在解决数学、编程等复杂任务时,广泛采用思维链进行推理,所以每次遇到新问题时,都需要重复推导通用子步骤。

这不仅会导致token用量膨胀、推理延迟增加,还会占用上下文窗口空间,降低模型探索新路径的能力。

与此同时,现有LLM的记忆系统(如RAG)仅存储 “是什么” 的陈述性知识,缺乏 “如何思考” 的程序性知识复用机制,无法解决重复推理的低效问题。

针对上述问题,研究团队提出了元认知复用(Metacognitive Reuse) 机制。

让模型面对问题时,先尝试解决它,随后回顾整个推理过程,从中识别出可复用的推理步骤,最终将其转化为一组标准化“行为”——带有规范名称的简短可执行指令。

这些“行为”会被收录进一本可检索的“行为手册”,既能在测试阶段通过上下文提示直接调用,也可通过监督微调内化为模型的固有能力。

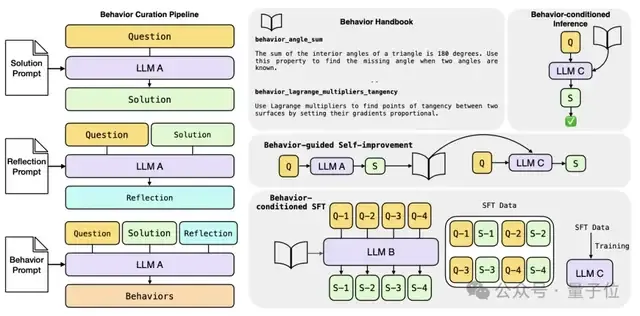

首先,研究人员描绘了“行为”构建的整个流程,该框架让模型在推理过程中扮演3种不同的角色。

- 元认知策略器(LLM A):负责从自身的推理轨迹中提取行为;

- 教师(LLM B):负责生成监督微调(SFT)训练的数据;

- 学生(LLM C):其推理过程可通过行为加以辅助,包括行为条件推理或行为条件SFT。

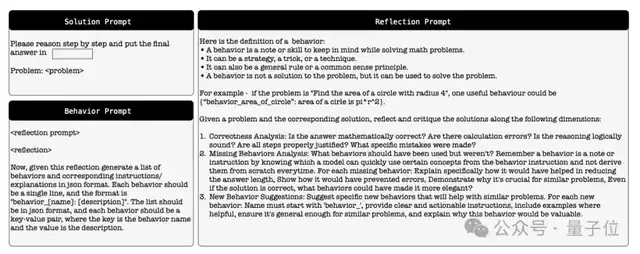

为了提取“行为”,元认知策略器首先会针对给定问题生成一个解决方案,包含推理轨迹+最终答案。

然后,将该问题–解答对再次输入元认知策略器,用以生成反思,主要是评估推理是否逻辑严密、答案是否正确,以及是否能提炼出新的可复用行为以简化未来的解题过程。

最后,通过另一次查询,元认知策略器将问题、解答和反思转化为一组“行为条目(包含名称和指令)”,并将添加到“行为手册”中。

研究团队在三种不同场景下测试了该模型的推理性能。

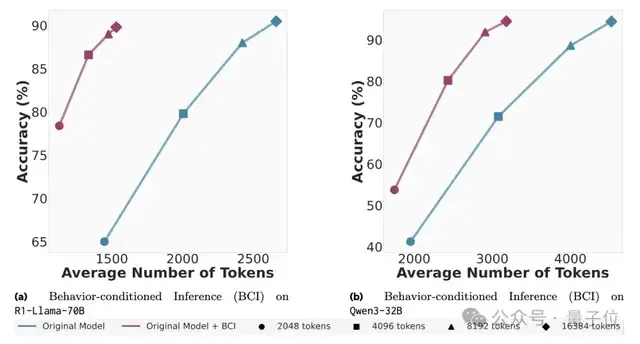

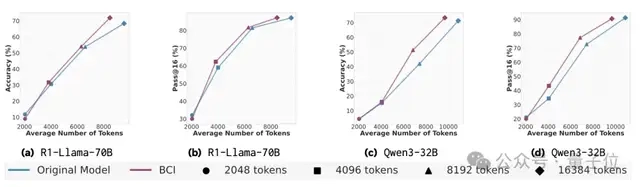

行为条件推理(BCI)

在首个场景中,BCI被用于MATH和AIME–24/25两个数据集,DeepSeek-R1-Distill-Llama-70B (R1-Llama-70B)和Qwen3-32B被用作候选学生模型。R1-Llama-70B被用作元认知策略生成器。

由上图可以看出,BCI可以在使用更少token的情况下,就能达到与基线相当或更优的性能。

此外,随着token的增加,该方法性能仍在提升,表明其不会对模型原有能力产生不良影响。

行为引导的自我改进

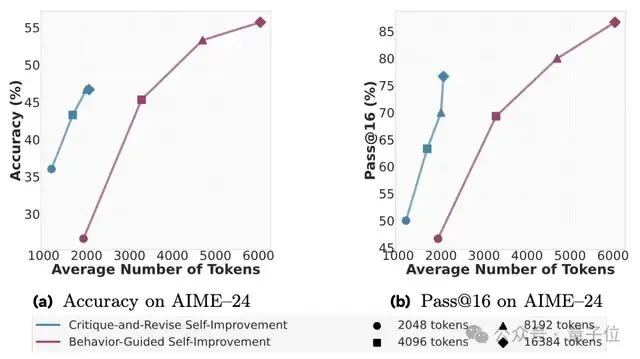

在此实验中,R1-Llama-70B同时担任元认知策略器和学生两个角色,具体做法是直接让模型对自身的推理轨迹进行批判并修正,以实现自我改进。

这个方法就像让大模型自己“改作业”。给模型一个问题Q,它先写出一条初步推理轨迹R1。然后,把问题Q和R1 一起交回给模型,让它检查并改进,生成新的推理轨迹R2,以修正错误或补充遗漏的步骤。

从下图可以看出,即使不更新参数,模型也能借助从过往解题过程中提取的行为模式,优化后续推理效果。相比朴素的“批判-修正”基线方法,该策略可将准确率最多提升10%。

行为条件监督微调(BC-SFT)

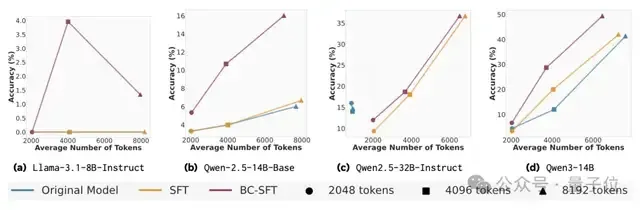

BC-SFT旨在将高质量的行为直接融入模型参数中,其中R1-Llama-70B同时担任元认知策略器和教师模型,Qwen2.5-14B、Qwen2.5-32B-Instruct、Qwen3-14B和Llama-3.1-8B被用作需要微调的学生模型。

与常规SFT相比,新方法可以更有效地将不具备推理能力的模型转化为具备推理能力的模型。

值得一提的是,BC-SFT不仅在token上使用更高效,而且几乎在所有情况下,其准确率都高于两个基线模型。

参考链接:[1]https://x.com/connordavis_ai/status/1971937767975498160[2]https://arxiv.org/abs/2509.13237